TFLearn 与 Tensorflow 一起使用

好用的不是一点点、、=-=、、

import tensorflow as tf

import tflearn

import tflearn.datasets.mnist as mnist

# Using MNIST Dataset

import tflearn.datasets.mnist as mnist

mnist_data = mnist.read_data_sets(one_hot=True)

# User defined placeholders

with tf.Graph().as_default():

# Placeholders for data and labels

X = tf.placeholder(shape=(None, 784), dtype=tf.float32)

Y = tf.placeholder(shape=(None, 10), dtype=tf.float32)

net = tf.reshape(X, [-1, 28, 28, 1])

# Using TFLearn wrappers for network building

net = tflearn.conv_2d(net, 32, 3, activation='relu')

net = tflearn.max_pool_2d(net, 2)

net = tflearn.local_response_normalization(net)

net = tflearn.dropout(net, 0.8)

net = tflearn.conv_2d(net, 64, 3, activation='relu')

net = tflearn.max_pool_2d(net, 2)

net = tflearn.local_response_normalization(net)

net = tflearn.dropout(net, 0.8)

net = tflearn.fully_connected(net, 128, activation='tanh')

net = tflearn.dropout(net, 0.8)

net = tflearn.fully_connected(net, 256, activation='tanh')

net = tflearn.dropout(net, 0.8)

net = tflearn.fully_connected(net, 10, activation='linear')

# Defining other ops using Tensorflow

loss = tf.reduce_mean(tf.nn.softmax_cross_entropy_with_logits(logits=net, labels=Y))

optimizer = tf.train.AdamOptimizer(learning_rate=0.01).minimize(loss)

# Initializing the variables

init = tf.initialize_all_variables()

# Launch the graph

with tf.Session() as sess:

sess.run(init)

batch_size = 128

for epoch in range(2): # 2 epochs

avg_cost = 0.

total_batch = int(mnist_data.train.num_examples/batch_size)

for i in range(total_batch):

batch_xs, batch_ys = mnist_data.train.next_batch(batch_size)

sess.run(optimizer, feed_dict={X: batch_xs, Y: batch_ys})

cost = sess.run(loss, feed_dict={X: batch_xs, Y: batch_ys})

avg_cost += cost/total_batch

if i % 20 == 0:

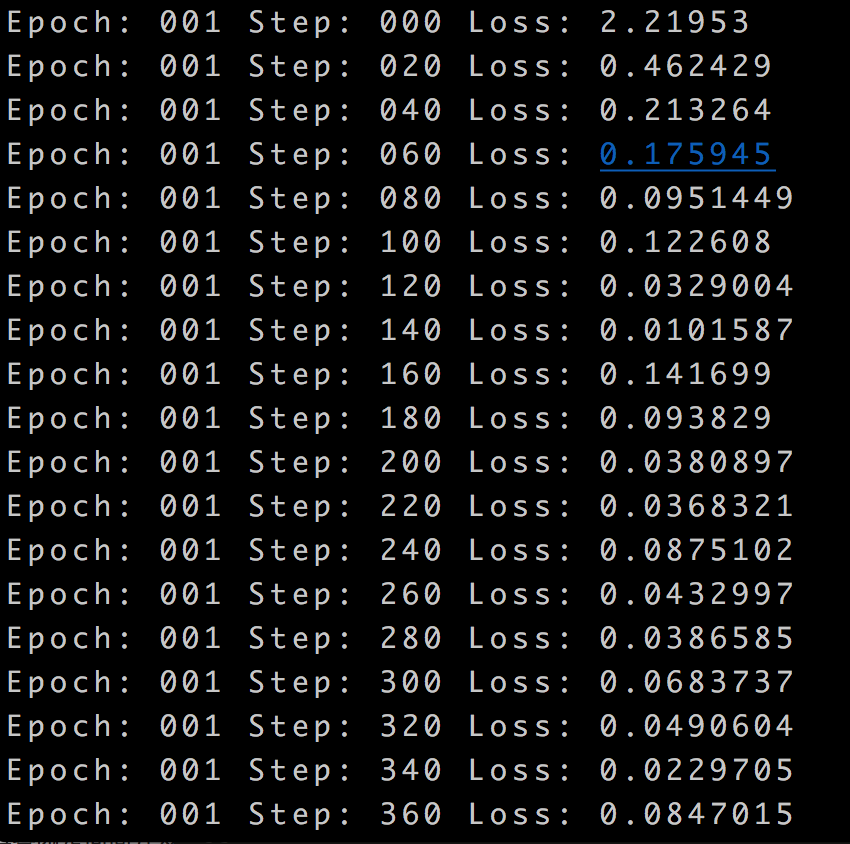

print "Epoch:", '%03d' % (epoch+1), "Step:", '%03d' % i, "Loss:", str(cost)

结果:

TFLearn 与 Tensorflow 一起使用的更多相关文章

- NN tutorials:

确实“人话”解释清楚了 ^_^ 池化不只有减少参数的作用,还可以: 不变性,更关注是否存在某些特征而不是特征具体的位置.可以看作加了一个很强的先验,让学到的特征要能容忍一些的变化.防止过拟合,提高模型 ...

- Tensorflow tflearn 编写RCNN

两周多的努力总算写出了RCNN的代码,这段代码非常有意思,并且还顺带复习了几个Tensorflow应用方面的知识点,故特此总结下,带大家分享下经验.理论方面,RCNN的理论教程颇多,这里我不在做详尽说 ...

- tflearn tensorflow LSTM predict sin function

from __future__ import division, print_function, absolute_import import tflearn import numpy as np i ...

- TensorFlow 之 高层封装slim,tflearn,keras

tensorflow资源整合 使用原生态TensorFlow API来实现各种不同的神经网络结构.虽然原生态的TensorFlow API可以很灵活的支持不同的神经网络结构,但是其代码相对比较冗长,写 ...

- tflearn 中文汉字识别,训练后模型存为pb给TensorFlow使用——模型层次太深,或者太复杂训练时候都不会收敛

tflearn 中文汉字识别,训练后模型存为pb给TensorFlow使用. 数据目录在data,data下放了汉字识别图片: data$ ls0 1 10 11 12 13 14 15 ...

- anaconda tensorflow tflearn 自动安装脚本 anaconda使用-b可以非交互式安装

install_dir=/usr/local/anaconda3 DIR="$( cd "$( dirname "${BASH_SOURCE[0]}" )&qu ...

- 将tflearn的模型保存为pb,给TensorFlow使用

参考:https://github.com/tflearn/tflearn/issues/964 解决方法: """ Tensorflow graph freezer C ...

- TensorFlow实战笔记(17)---TFlearn

目录: 分布式Estimator 自定义模型 建立自己的机器学习Estimator 调节RunConfig运行时的参数 Experiment和LearnRunner 深度学习Estimator 深度神 ...

- 吴裕雄--天生自然TensorFlow高层封装:使用TFLearn处理MNIST数据集实现LeNet-5模型

# 1. 通过TFLearn的API定义卷机神经网络. import tflearn import tflearn.datasets.mnist as mnist from tflearn.layer ...

随机推荐

- 浅谈table、form 标签

1.<table> 标签 1.1包含的元素 <caption></caption>:表头信息. <tr></tr> :定义一个表格行: &l ...

- 随机森林(Random Forest),决策树,bagging, boosting(Adaptive Boosting,GBDT)

http://www.cnblogs.com/maybe2030/p/4585705.html 阅读目录 1 什么是随机森林? 2 随机森林的特点 3 随机森林的相关基础知识 4 随机森林的生成 5 ...

- ubuntu 双硬盘挂载 windows分区自动挂载

sudo fdisk -l 查看硬盘情况 1:新建一个目录,例:old 2:mount /dev/sdb1 old 3:cd old 4:ls (就可以看到新硬盘的内容了) 取消挂载:umoun ...

- linux下文件内容查找 转

find | xargs grep test find命令和xargs命令 网友:wuye_chinaunix 发布于: : (共有条评论) 查看评论 | 我要评论 青云 分配文件 - -| 回首页 ...

- linux系统管理 计划任务

一次性计划任务 命令: at 语法: at [-f 文件名] 时间 绝对计时方法 HH:MM yyyy-MM-dd 相对计时方法 now + n minutes now+n hours now + n ...

- Java:将Excel数据导入到数据库(一眼就看会)

所用Jar包 1. sqljdbc4.jar 连接数据库的Jar包(根据数据库的不同进行选择,我用的SqlServer2008) 2.Jxl.jar 访问Excel的Jar包 注意:支持以.xls结尾 ...

- vue-10-混合

混合对象可以包含任意组件选项, // 定义一个混合对象 var myMixin = { created: function () { this.hello() }, methods: { hello: ...

- nginx负载均衡实验

Nginx负载均衡概述 Web服务器,直接面向用户,往往要承载大量并发请求,单台服务器难以负荷,我使用多台WEB服务器组成集群,前端使用Nginx负载均衡,将请求分散的打到我们的后端服务器集群中,实现 ...

- U盘如何去除写保护

用一个简单而粗暴的方法去除U盘写保护: www.upantool.com/hfxf/xiufu//FormatTool.html#softdown 没有比这个更牛的软件了.

- SpringMVC学习四(@ModelMap @RequestBody等等的说明)

参考如下 http://www.cnblogs.com/HD/p/4107674.html http://www.cnblogs.com/qiankun-site/p/5774325.html @re ...