wget 指令学习之递归抓取文档技巧

在线上阅读文档的时候,有没有想将它抓取到本地,以备没有网的时候阅读只需?

先上指令:

$ wget --user-agent="Mozilla/5.0 (X11; Linux x86_64) AppleWebKit/537.36 (KHTML, like Gecko) Ubuntu Chromium/53.0.2785.143 Chrome/53.0.2785.143 Safari/537.36" -p -np -k -r --wait=1 http://www.tornadoweb.org/en/stable/

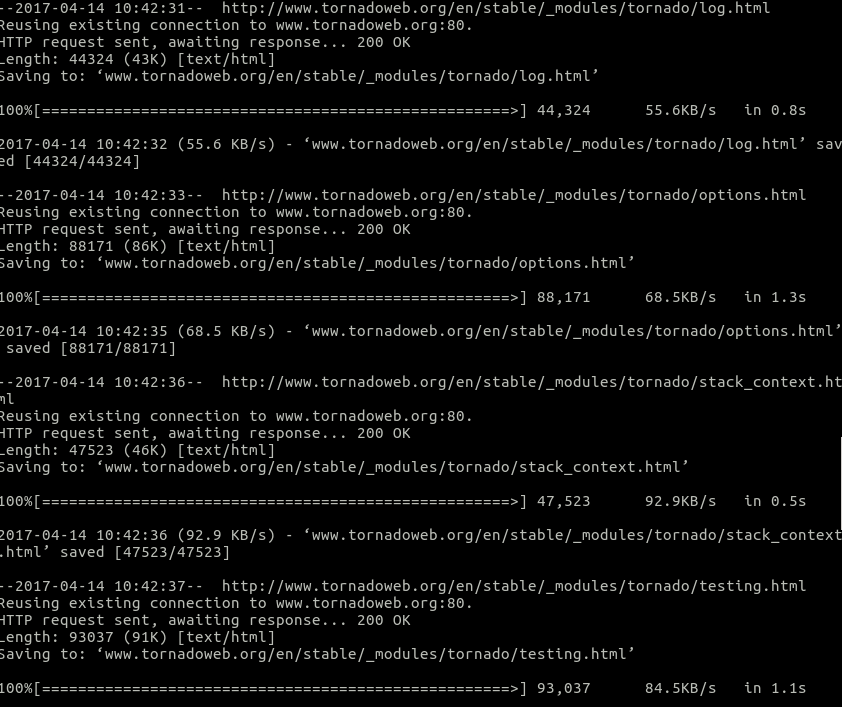

你会看到如下的页面:

过段时间,就会抓取完成,并在本地生成了一个相关联的目录。

这个命令就是 wget。它是开发者在Linux下面非常喜欢使用的下载指令。经常,我们会看到一些技术文档在指导你下载安装包的时候,也会用到,比如: wget xxx.tar.gz 之类的。

我们可以通过 man wget 或 wget -h 来查阅 wget 的参数。下面挑出几个常用的参数介绍下。

HTTP 相关的:

--http-user=USER 设置 http 用户名为 USER。

--http-password=PASS 设置 http 密码为 PASS。

--no-cache 不在服务器上缓存数据。

-U, --user-agent=AGENT 标识为 AGENT 而不是 Wget/VERSION。

--no-http-keep-alive 禁用 HTTP keep-alive (永久连接)。

--no-cookies 不使用 cookies。

--load-cookies=FILE 会话开始前从 FILE 中载入 cookies。

--save-cookies=FILE 会话结束后保存 cookies 至 FILE。

--keep-session-cookies 载入并保存会话 (非永久) cookies。

--post-data=STRING 使用 POST 方式;把 STRING 作为数据发送。

--post-file=FILE 使用 POST 方式;发送 FILE 内容。

--content-disposition 当选中本地文件名时

允许 Content-Disposition 头部 (尚在实验)。

--auth-no-challenge 发送不含服务器询问的首次等待

的基本 HTTP 验证信息。

下载相关的:

-w, --wait=SECONDS 等待间隔为 SECONDS 秒。

--waitretry=SECONDS 在获取文件的重试期间等待 1..SECONDS 秒。

--random-wait 获取多个文件时,每次随机等待间隔

0.5*WAIT...1.5*WAIT 秒。

-O --output-document=FILE 将文档写入 FILE。

递归下载:

-r, --recursive 指定递归下载。

-p, --page-requisites 下载所有用于显示 HTML 页面的图片之类的元素。

-k, --convert-links 让下载得到的 HTML 或 CSS 中的链接指向本地文件。

-np, --no-parent 不追溯至父目录。

原文网址 http://www.cnblogs.com/scharfsinnig/p/6707859.html 参考文档:

http://linux.51yip.com/search/wget

wget 指令学习之递归抓取文档技巧的更多相关文章

- scrapy递归抓取网页数据

scrapy spider的parse方法能够返回两种值:BaseItem.或者Request.通过Request能够实现递归抓取. 假设要抓取的数据在当前页,能够直接解析返回item(代码中带**凝 ...

- Xml学习笔记(3)利用递归解析Xml文档添加到TreeView中

利用递归解析Xml文档添加到TreeView中 private void Form1_Load(object sender, EventArgs e) { XmlDocument doc = new ...

- SpringBoot学习笔记:Swagger实现文档管理

SpringBoot学习笔记:Swagger实现文档管理 Swagger Swagger是一个规范且完整的框架,用于生成.描述.调用和可视化RESTful风格的Web服务.Swagger的目标是对RE ...

- python爬虫学习:分布式抓取

前面的文章都是基于在单机操作,正常情况下,一台机器无论配置多么高,线程开得再多,也总会有一个上限,或者说成本过于巨大.因此,本文将提及分布式的爬虫,让爬虫的效率提高得更快. 构建分布式爬虫首先需要有多 ...

- Node.js的学习--使用cheerio抓取网页数据

打算要写一个公开课网站,缺少数据,就决定去网易公开课去抓取一些数据. 前一阵子看过一段时间的Node.js,而且Node.js也比较适合做这个事情,就打算用Node.js去抓取数据. 关键是抓取到网页 ...

- Java学习-046-日志抓取合并后排序问题解决方案之 --- log4j 二次定制,实现日志输出添加延时10ms

自3月25至今,已经好久没有写学习日志了,今天在写日志抓取合并的小方法,发现抓取后的日志并米有依据系统执行的日志顺序排序.日志抓取排列逻辑如下: 通过日志标识,从各个日志文件(例如 use.log,e ...

- Nodejs全站开发学习系列 & 深入浅出Node学习笔记 & Spider抓取

https://course.tianmaying.com/node 这个系列的文章看起来很不错,值得学习一下. /Users/baidu/Documents/Data/Interview/Web-S ...

- Nutch学习笔记二——抓取过程简析

在上篇学习笔记中http://www.cnblogs.com/huligong1234/p/3464371.html 主要记录Nutch安装及简单运行的过程. 笔记中 通过配置抓取地址http://b ...

- hibernate框架学习之数据抓取(加载)策略helloworld

package cn.itcast.h3.query.hql; import java.util.List; import org.hibernate.Query; import org.hibern ...

随机推荐

- Object-C,文件路径API

犀利吐槽 1.同样都是"文件和目录操作",java中,就用java.util.File一个类,就封装了很多API,而Object-C搞了这么多类和函数.具体原因,有待分析啊. 2. ...

- WHU 1537 Stones I

题目见: http://acm.whu.edu.cn/land/problem/detail?problem_id=1537 这个题相当无语,学长给的解法是:枚举取的个数k,然后对每个k贪心,取其中的 ...

- C#版清晰易懂TCP通信原理解析(附demo)

[转] C#版清晰易懂TCP通信原理解析(附demo) (点击上方蓝字,可快速关注我们) 来源:周见智 cnblogs.com/xiaozhi_5638/p/4244797.html 对.NET中网络 ...

- 一种基于RBAC模型的动态访问控制改进方法

本发明涉及一种基于RBAC模型的动态访问控制改进方法,属于访问控制领域.对原有RBAC模型进行了权限的改进和约束条件的改进,具体为将权限分为静态权限和动态权限,其中静态权限是非工作流的权限,动态权限是 ...

- cxf 实例解读

1.sample 实例之一---java_first_pojo 服务端发布服务的方法: 1 HelloWorldImpl helloworldImpl = new HelloWorldImpl(); ...

- OpenCV图像处理篇之腐蚀与膨胀

转载请注明出处:http://xiahouzuoxin.github.io/notes 腐蚀与膨胀 腐蚀和膨胀是图像的形态学处理中最主要的操作,之后遇见的开操作和闭操作都是腐蚀和膨胀操作的结合运算. ...

- google浏览器修改网页字符编码

google浏览器修改网页字符编码 直接在google浏览器的应用拓展程序里面搜 Charset,第一个就是 于是就有了

- Rapidjson的简单使用示例

很早就想用用Markdown了,一直没机会.今天就来试一下 先放个目录: Rapidjson的简单使用示例 rapidjson官方教程 本示例所用环境 示例代码与注释 rapidjson官方教程 如果 ...

- dedecms关键词维护里面字数多的词优先字数少的词的解决办法

织梦后台的关键词维护默认的情况是字数少的词优先于字数多的词,比如我们有两个这样的词:创业.创业方向,第二个词包含了第一个词,在文章中如果出现“创业方向”这个词,默认情况下只会给创业两个字添加关键词超链 ...

- 5G时代即将到来,有线网络WiFi会消失不见吗?

说到WiFi大家都不陌生了,特别是智能手机出现后,WiFi发展的速度更是可以用“神速”来形容,几乎到处都有WiFi覆盖.以致于现在大家无论去到哪里,往往第一句话就是问“这里有没有WiFi?”或者“Wi ...