爬虫,爬取景点信息采用pandas整理数据

一、首先需要导入我们的库函数

导语:通过看网上直播学习得到,如有雷同纯属巧合。

import requests#请求网页链接

import pandas as pd#建立数据模型

from bs4 import BeautifulSoup

import io

import sys#防止乱码

sys.stdout=io.TextIOWrapper(sys.stdout.buffer,encoding='gb18030')

注:如有库安装不了,可参考上一篇随笔。

二、源代码:

1 import requests

import pandas as pd

from bs4 import BeautifulSoup

import io

import sys#防止乱码

sys.stdout=io.TextIOWrapper(sys.stdout.buffer,encoding='gb18030')

def get_url(n):

#获取网页链接

urls=[]

for i in range(1,n+1):

urls.append('https://travel.qunar.com/p-cs299878-shanghai-jingdian-1-%s' %i)#获取n段网页链接

return urls pass def get_data(url):#获取一段网页链接的数据

r=requests.get(url)

soup=BeautifulSoup(r.text,'lxml')#lxml一种不错的编译器

ul=soup.find('ul',class_='list_item clrfix')#在网页中通过查找元素信息找到其名称

lis=ul.find_all('li')#查找所有信息

datalst=[]#定义一个数据字典

for li in lis:

dic={}#将需要查找的信息写入数据字典

dic['景点名称']=li.find('span',class_='cn_tit').text

dic['星级']=li.find('span',class_='cur_star')['style'].split(':')[1].replace('%','')#将数据中的百分号去掉实现初步数据清洗

dic['经度']=li['data-lng']

dic['纬度']=li['data-lat']

datalst.append(dic)

return datalst def get_alldata(n):#按要求查找多段网页链接的数据

alldata=[]

for url in get_url(n):

alldata.extend(get_data(url))

return alldata

#print(get_alldata(2))

df=pd.DataFrame(get_alldata(2))#建立pandas模型,按要求输出

print(df)

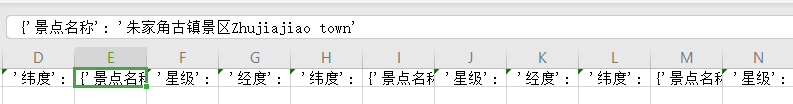

三、运行结果:

四、存储:

这里采用csv存储,在获取信息时写入以下代码把取得的信息写入表格中。

def get_alldata(n):

alldata=[]

for url in get_url(n):

alldata.extend(get_data(url))

alldata=[str(x) for x in alldata]

with open('describe.csv','a',encoding='utf8')as f:#在自己的运行目录下新建一个csv后缀名的文件夹然后打开以读写的方式

f.write(','.join('%s' %id for id in alldata))#为了防止数字转字符串出错首先逐个遍历我们的列表然后再写入

f.close()#操作完成应记住关闭文件夹。

return alldata

运行结果:

如上图所示数据已成功写入csv文件夹中。

小有瑕疵,初学见谅!!!

爬虫,爬取景点信息采用pandas整理数据的更多相关文章

- python爬虫爬取get请求的页面数据代码样例

废话不多说,上代码 #!/usr/bin/env python # -*- coding:utf-8 -*- # 导包 import urllib.request import urllib.pars ...

- 用Python写爬虫爬取58同城二手交易数据

爬了14W数据,存入Mongodb,用Charts库展示统计结果,这里展示一个示意 模块1 获取分类url列表 from bs4 import BeautifulSoup import request ...

- Python爬虫爬取异步加载的数据

前言 本文的文字及图片来源于网络,仅供学习.交流使用,不具有任何商业用途,版权归原作者所有,如有问题请及时联系我们以作处理.作者:努力努力再努力 爬取qq音乐歌手数据接口数据 https://y.qq ...

- 养只爬虫当宠物(Node.js爬虫爬取58同城租房信息)

先上一个源代码吧. https://github.com/answershuto/Rental 欢迎指导交流. 效果图 搭建Node.js环境及启动服务 安装node以及npm,用express模块启 ...

- (转)Python网络爬虫实战:世纪佳缘爬取近6万条数据

又是一年双十一了,不知道从什么时候开始,双十一从“光棍节”变成了“双十一购物狂欢节”,最后一个属于单身狗的节日也成功被攻陷,成为了情侣们送礼物秀恩爱的节日. 翻着安静到死寂的聊天列表,我忽然惊醒,不行 ...

- MATLAB爬虫爬取股票数据

近年来,大数据盛行,有关爬虫的教程层次不穷.那么,爬虫到底是什么呢? 什么是爬虫? 百度百科是这样定义的: 网络爬虫(又被称为网页蜘蛛,网络机器人,在FOAF社区中间,更经常的称为网页追逐者),是一种 ...

- 爬虫爬数据时,post数据乱码解决办法

最近在写一个爬虫,目标网站是:http://zx.bjmemc.com.cn/,可能是为了防止被爬取数据,它给自身数据加了密.用谷歌自带的抓包工具也不能捕获到数据.于是下了Fiddler. F ...

- 爬虫(二)Python网络爬虫相关基础概念、爬取get请求的页面数据

什么是爬虫 爬虫就是通过编写程序模拟浏览器上网,然后让其去互联网上抓取数据的过程. 哪些语言可以实现爬虫 1.php:可以实现爬虫.php被号称是全世界最优美的语言(当然是其自己号称的,就是王婆 ...

- Python网络爬虫第三弹《爬取get请求的页面数据》

一.urllib库 urllib是Python自带的一个用于爬虫的库,其主要作用就是可以通过代码模拟浏览器发送请求.其常被用到的子模块在Python3中的为urllib.request和urllib. ...

随机推荐

- vs中 Stack around the variable 'XXX' was corrupted.

https://blog.csdn.net/hou09tian/article/details/75042206 把 project->配置属性->c/c++->代码生成->基 ...

- 小小见解之python循环依赖

a.py from b import b print '---------this is module a.py----------' def a(): print "hello, a&qu ...

- 移动端js触摸touch详解(附带案例源码)

移动端触摸滑动原理详解案例,实现过程通过添加DOM标签的触摸事件监听,并计算触摸距离,通过距离坐标计算触摸角度,最后通过触摸角度去判断往哪个方向触摸的. 触摸的事件列表 触摸的4个事件: touchs ...

- HTML+css基础 css的几种形式

1.行间样式:将style写在标签内的充当标签标签属性 2.行内样式

- Socket超时时间设置

你知道在 Java 中怎么对 Socket 设置超时时间吗?他们的区别是什么?想一想和女朋友打电话的场景就知道了,如果实在想不到,那我们就一起来来看一下是咋回事吧 设置方式 主要有以下两种方式,我们来 ...

- Prometheus 监控K8S集群资源监控

Prometheus 监控K8S集群中Pod 目前cAdvisor集成到了kubelet组件内,可以在kubernetes集群中每个启动了kubelet的节点使用cAdvisor提供的metrics接 ...

- Linbux下的Bash对拍

下面是\(Linux\)下的\(bash\)对拍程序: #!/bin/bash t=0 //数据组数 while true; do let "t=$t + 1" echox pri ...

- springboot 1.4 CXF配置

启动类: package com.eshore.main; import org.apache.catalina.connector.Connector; import org.apache.coyo ...

- Jenkins配置LDAP认证

managerdn即为连接到AD的账号

- java socket通信:聊天器(1)

目的:实现多个客户之间的通信 首先,这个聊天器的框架是这样的: 对于服务器端:建立socket,连接到服务器,并且开始监听. import java.io.*; import java.util.Ar ...