logistic回归 python代码实现

1. 读取数据集

def load_data(filename,dataType):

return np.loadtxt(filename,delimiter=",",dtype = dataType) def read_data():

data = load_data("data2.txt",np.float64)

X = data[:,0:-1]

y = data[:,-1]

return X,y

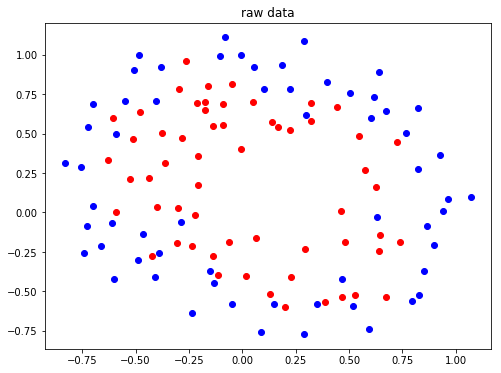

2. 查看原始数据的分布

def plot_data(x,y):

pos = np.where(y==1) # 找到标签为1的位置

neg = np.where(y==0) #找到标签为0的位置 plt.figure(figsize=(8,6))

plt.plot(x[pos,0],x[pos,1],'ro')

plt.plot(x[neg,0],x[neg,1],'bo')

plt.title("raw data")

plt.show() X,y = read_data()

plot_data(X,y)

结果:

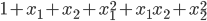

3. 将数据映射为多项式

由原图数据分布可知,数据的分布是非线性的,这里将数据变为多项式的形式,使其变得可分类。

映射为二次方的形式:

def mapFeature(x1,x2):

degree = 2; #映射的最高次方

out = np.ones((x1.shape[0],1)) # 映射后的结果数组(取代X) for i in np.arange(1,degree+1):

for j in range(i+1):

temp = x1 ** (i-j) * (x2**j)

out = np.hstack((out,temp.reshape(-1,1)))

return out

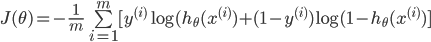

4. 定义交叉熵损失函数

可以综合起来为:

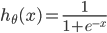

其中:

为了防止过拟合,加入正则化技术:

注意j是重1开始的,因为theta(0)为一个常数项,X中最前面一列会加上1列1,所以乘积还是theta(0),feature没有关系,没有必要正则化

def sigmoid(x):

return 1.0 / (1.0+np.exp(-x)) def CrossEntropy_loss(initial_theta,X,y,inital_lambda): #定义交叉熵损失函数

m = len(y)

h = sigmoid(np.dot(X,initial_theta))

theta1 = initial_theta.copy() # 因为正则化j=1从1开始,不包含0,所以复制一份,前theta(0)值为0

theta1[0] = 0 temp = np.dot(np.transpose(theta1),theta1)

loss = (-np.dot(np.transpose(y),np.log(h)) - np.dot(np.transpose(1-y),np.log(1-h)) + temp*inital_lambda/2) / m

return loss

5. 计算梯度

对上述的交叉熵损失函数求偏导:

利用梯度下降法进行优化:

def gradientDescent(initial_theta,X,y,initial_lambda,lr,num_iters):

m = len(y) theta1 = initial_theta.copy()

theta1[0] = 0

J_history = np.zeros((num_iters,1)) for i in range(num_iters):

h = sigmoid(np.dot(X,theta1))

grad = np.dot(np.transpose(X),h-y)/m + initial_lambda * theta1/m

theta1 = theta1 - lr*grad

#print(theta1)

J_history[i] = CrossEntropy_loss(theta1,X,y,initial_lambda)

return theta1,J_history

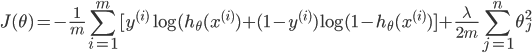

6. 绘制损失值随迭代次数的变化曲线

def plotLoss(J_history,num_iters):

x = np.arange(1,num_iters+1)

plt.plot(x,J_history)

plt.xlabel("num_iters")

plt.ylabel("loss")

plt.title("Loss value changes with the number of iterations")

plt.show()

7. 绘制决策边界

def plotDecisionBoundary(theta,x,y):

pos = np.where(y==1) #找到标签为1的位置

neg = np.where(y==0) #找到标签为2的位置 plt.figure(figsize=(8,6))

plt.plot(x[pos,0],x[pos,1],'ro')

plt.plot(x[neg,0],x[neg,1],'bo')

plt.title("Decision Boundary") #生成和原数据类似的数据

u = np.linspace(-1,1.5,50)

v = np.linspace(-1,1.5,50)

z = np.zeros((len(u),len(v)))

#利用训练好的参数做预测

for i in range(len(u)):

for j in range(len(v)):

z[i,j] = np.dot(mapFeature(u[i].reshape(1,-1),v[j].reshape(1,-1)),theta) z = np.transpose(z)

plt.contour(u,v,z,[0,0.01],linewidth=2.0) # 画等高线,范围在[0,0.01],即近似为决策边界

plt.legend()

plt.show()

8.主函数

if __name__ == "__main__":

#数据的加载

x,y = read_data()

X = mapFeature(x[:,0],x[:,1])

Y = y.reshape((-1,1))

#参数的初始化

num_iters = 400

lr = 0.1

initial_theta = np.zeros((X.shape[1],1)) #初始化参数theta

initial_lambda = 0.1 #初始化正则化系数

#迭代优化

theta,loss = gradientDescent(initial_theta,X,Y,initial_lambda,lr,num_iters)

plotLoss(loss,num_iters)

plotDecisionBoundary(theta,x,y)

9.结果

logistic回归 python代码实现的更多相关文章

- 机器学习实战 logistic回归 python代码

# -*- coding: utf-8 -*- """ Created on Sun Aug 06 15:57:18 2017 @author: mdz "&q ...

- Logistic回归 python实现

Logistic回归 算法优缺点: 1.计算代价不高,易于理解和实现2.容易欠拟合,分类精度可能不高3.适用数据类型:数值型和标称型 算法思想: 其实就我的理解来说,logistic回归实际上就是加了 ...

- Logistic回归python实现

2017-08-12 Logistic 回归,作为分类器: 分别用了梯度上升,牛顿法来最优化损失函数: # -*- coding: utf-8 -*- ''' function: 实现Logistic ...

- Logistic回归python实现小样例

假设现在有一些点,我们用一条直线对这些点进行拟合(该线称为最佳拟合直线),这个拟合过程就称作回归.利用Logistic回归进行分类的主要思想是:根据现有数据对分类边界线建立回归公式,依次进行分类.Lo ...

- logistic 回归Matlab代码

function a alpha = 0.0001; [m,n] = size(q1x); max_iters = 500; X = [ones(size(q1x,1),1), q1x]; % app ...

- 神经网络、logistic回归等分类算法简单实现

最近在github上看到一个很有趣的项目,通过文本训练可以让计算机写出特定风格的文章,有人就专门写了一个小项目生成汪峰风格的歌词.看完后有一些自己的小想法,也想做一个玩儿一玩儿.用到的原理是深度学习里 ...

- 机器学习/逻辑回归(logistic regression)/--附python代码

个人分类: 机器学习 本文为吴恩达<机器学习>课程的读书笔记,并用python实现. 前一篇讲了线性回归,这一篇讲逻辑回归,有了上一篇的基础,这一篇的内容会显得比较简单. 逻辑回归(log ...

- Logistic回归分类算法原理分析与代码实现

前言 本文将介绍机器学习分类算法中的Logistic回归分类算法并给出伪代码,Python代码实现. (说明:从本文开始,将接触到最优化算法相关的学习.旨在将这些最优化的算法用于训练出一个非线性的函数 ...

- Logistic回归模型和Python实现

回归分析是研究变量之间定量关系的一种统计学方法,具有广泛的应用. Logistic回归模型 线性回归 先从线性回归模型开始,线性回归是最基本的回归模型,它使用线性函数描述两个变量之间的关系,将连续或离 ...

随机推荐

- gym102346题解

B Buffoon 判断最大值是不是第一个数,签到题. H Hour for a Run 输出\(n*m\)的\(10\%\)到\(90\%\),签到题,注意别用浮点数和ceil,有精度问题. M M ...

- 【系统设计】分布式唯一ID生成方案总结

目录 分布式系统中唯一ID生成方案 1. 唯一ID简介 2. 全局ID常见生成方案 2.1 UUID生成 2.2 数据库生成 2.3 Redis生成 2.4 利用zookeeper生成 2.5 雪花算 ...

- Julia初学备忘

println("hello!") println("hello!") print("hello!") print("hello! ...

- 通过父级id获取到其下所有子级(无穷级)——Mysql函数实现

[需求]某用户只能查看其自己信息及其下级信息,涉及通过该用户所在部门获取其下所有部门(多层)id集合. 步骤一:对数据库进行设置: set global log_bin_trust_function_ ...

- 简单动态字符串(SDS)

SDS 前提:在redis中,C字符串只会作为字符串字面量用在一些无须对字符串进行修改的地方,比如打印日志: redisLog(REDIS_WARNING, “Redis is ready to ex ...

- 我的mongoDb之旅(二)

题序:上一回,咱们简单的操作了一些增减改查的操作,这一次,再来进行一场奇妙之旅 一.案例讲解 (1).字段有值与没值时的单条数据 第一条数据title这个字段(mysql用久了,习惯这么叫了)是没有数 ...

- php常用操作(第二版)

1.多个字段多重排序 function sortArrByManyField(){ $args = func_get_args(); // 获取函数的参数的数组 if(empty($args)){ r ...

- 3. Git与TortoiseGit基本操作

1. GitHub操作 本节先简单介绍 git 的使用与操作, 然后再介绍 TortoiseGit 的使用与操作. 先看看SVN的操作吧, 最常见的是 检出(Check out ...), 更新 (U ...

- 夯实Java基础系列20:从IDE的实现原理聊起,谈谈那些年我们用过的Java命令

本系列文章将整理到我在GitHub上的<Java面试指南>仓库,更多精彩内容请到我的仓库里查看 https://github.com/h2pl/Java-Tutorial 喜欢的话麻烦点下 ...

- Java面试----01.JavaSE

1.面向对象和面向过程的区别 面向过程:面向过程性能比面向对象高. 因为类调用时需要实例化,比较消耗资源,所以当性能是最重要的考虑因素时,比如单片机.嵌入式开发.Linux/Unix等一般采用面向对象 ...