TF中conv2d和kernel_initializer方法

tf.nn.conv2d

在使用TF搭建CNN的过程中,卷积的操作如下

convolution = tf.nn.conv2d(X, filters, strides=[1,2,2,1], padding="SAME")

这个函数中各个参数的含义是什么呢?

- X:输入数据的mini-batch,为一个4D tensor;分别表示的含义为[n_batch,height,width,channel]

- filters:为卷积核,为一个4D tensor,分别表示的含义为 [filter_height, filter_width, in_channels, out_channels]

- stride:为步长,使用方法为[1,stride,stride,1]

该方法先将filter展开为一个2D的矩阵,形状为[filter_heightfilter_width in_channels, out_channels],再在图片上面选择一块大小进行卷积计算的到一个大小为[batch, out_height, out_width, filter_height * filter_width * in_channels]的虚拟张量。

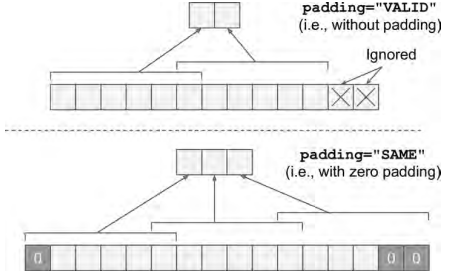

再将上面两部相乘(右乘filter矩阵) - padding:string类型的量,只能是"SAME","VALID"其中之一,这个值决定了不同的卷积方式。下面使用图表示两种的计算形式

当使用VALID的时候,如果卷积计算过程中,剩下的不够一步,则剩下的像素会被抛弃,SAME则会补0.

filter_primes = np.array([2., 3., 5., 7., 11., 13.], dtype=np.float32)

x = tf.constant(np.arange(1, 13+1, dtype=np.float32).reshape([1, 1, 13, 1]))

filters = tf.constant(filter_primes.reshape(1, 6, 1, 1))

valid_conv = tf.nn.conv2d(x, filters, strides=[1, 1, 5, 1], padding='VALID')

same_conv = tf.nn.conv2d(x, filters, strides=[1, 1, 5, 1], padding='SAME')

with tf.Session() as sess:

print("VALID:\n", valid_conv.eval())

print("SAME:\n", same_conv.eval())

输出内容为

VALID:

[[[[ 184.]

[ 389.]]]]

SAME:

[[[[ 143.]

[ 348.]

[ 204.]]]]

实际计算向量如下所示:

print("VALID:")

print(np.array([1,2,3,4,5,6]).T.dot(filter_primes))

print(np.array([6,7,8,9,10,11]).T.dot(filter_primes))

print("SAME:")

print(np.array([0,1,2,3,4,5]).T.dot(filter_primes))

print(np.array([5,6,7,8,9,10]).T.dot(filter_primes))

print(np.array([10,11,12,13,0,0]).T.dot(filter_primes))

>>

VALID:

184.0

389.0

SAME:

143.0

348.0

204.0

再来做一个小实验,使用VALID的时候:

input = tf.Variable(tf.random_normal([1,5,5,5]))

filter = tf.Variable(tf.random_normal([3,3,5,1]))

op = tf.nn.conv2d(input, filter, strides=[1, 2, 2, 1], padding='VALID')

init = tf.global_variables_initializer()

with tf.Session() as sess:

sess.run(init)

print(op)

# print(sess.run(op))

>>Tensor("Conv2D:0", shape=(1, 2, 2, 1), dtype=float32)

使用SAME的时候

input = tf.Variable(tf.random_normal([1,5,5,5]))

filter = tf.Variable(tf.random_normal([3,3,5,1]))

op = tf.nn.conv2d(input, filter, strides=[1, 2, 2, 1], padding='SAME')

init = tf.global_variables_initializer()

with tf.Session() as sess:

sess.run(init)

print(op)

# print(sess.run(op))

>>Tensor("Conv2D:0", shape=(1, 3, 3, 1), dtype=float32)

note:在做卷积的过程中filter的shape为[hight,width,channel],也就是说如果为如果输入只有一个channel的时候,filter为一个矩阵,如果channel为3的时候,这个时候的filter就有了厚度为3。

tf.layer.conv2d

同时TF也提供了tf.layer.conv2d的方法

def conv2d(inputs,

filters,

kernel_size,

strides=(1, 1),

padding='valid',

data_format='channels_last',

dilation_rate=(1, 1),

activation=None,

use_bias=True,

kernel_initializer=None,

bias_initializer=init_ops.zeros_initializer(),

kernel_regularizer=None,

bias_regularizer=None,

activity_regularizer=None,

trainable=True,

name=None,

reuse=None):

这个方法和tf.nn.conv2d有着相同的作用,相当于对其的更高层的api。两个方法的调用过程如下:

tf.layers.conv2d-> tf.nn.convolution .

tf.layers.conv2d->Conv2D->Conv2D.apply()->_Conv->_Conv.apply()->_Layer.apply()->_Layer.\__call__()->_Conv.call()->nn.convolution()...

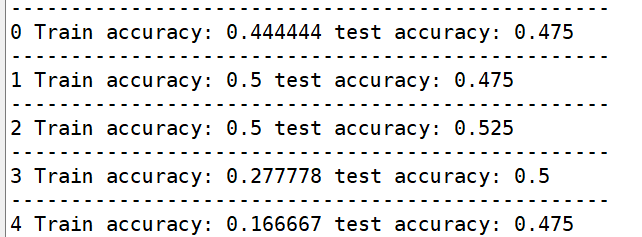

我用这两个方法搭建了相同的神经网络,可是得到的准确率相差很大,其他部分代码一张样。代码和准确率如下。为何差别这么的大?

def conv2d(self,input,ksize,stride,name):

with tf.name_scope(name):

with tf.variable_scope(name):

w = tf.get_variable("%s-w" %name,shape= ksize,initializer=tf.truncated_normal_initializer())

b = tf.get_variable("%s-b" %name,shape = [ksize[-1]],initializer = tf.constant_initializer())

out = tf.nn.conv2d(input,w,strides=[1,stride,stride,1],padding="SAME",name="%s-conv"%name)

out = tf.nn.bias_add(out,b,name='%s-bias_add' %name)

out = tf.nn.relu(out,name="%s-relu"%name)

return out

conv1 = tf.layers.conv2d(X,filters=conv1_fmaps, \

kernel_size = conv1_ksize,strides=conv1_stride,\

padding=conv1_pad,activation=tf.nn.relu,name='conv1')

为何差异这么大呢?我现在还没弄查出结果,如果知道答案请指出,先谢过。

tf.layers.conv2d中默认的kernel_initializer

tf.layer.conv2d这里面默认的kernel_initializer为None,经查阅源码

self.kernel = vs.get_variable('kernel',

shape=kernel_shape,

initializer=self.kernel_initializer,

regularizer=self.kernel_regularizer,

trainable=True,

dtype=self.dtype)

这里面有一段说明

If initializer is `None` (the default), the default initializer passed in

the constructor is used. If that one is `None` too, we use a new

`glorot_uniform_initializer`. If initializer is a Tensor, we use

it as a value and derive the shape from the initializer.

也就是说使用的是

glorot_uniform_initializer来进行初始化的。这种方法又被称为Xavier uniform initializer,相关的文献在这里 。另外TF中tf.layers.dense也是使用的这个初始化方法。我把初始化方法都改成了使用tf.truncated_normal_initializer,上面模型的结果没有什么改善。看来初始化方法不是主要原因。求解。

TF中conv2d和kernel_initializer方法的更多相关文章

- TensorFlow走过的坑之---数据读取和tf中batch的使用方法

首先介绍数据读取问题,现在TensorFlow官方推荐的数据读取方法是使用tf.data.Dataset,具体的细节不在这里赘述,看官方文档更清楚,这里主要记录一下官方文档没有提到的坑,以示" ...

- TensorFlow使用记录 (二): 理解tf.nn.conv2d方法

方法定义 tf.nn.conv2d(input, filter, strides, padding, use_cudnn_on_gpu=True, data_format="NHWC&quo ...

- 对抗生成网络-图像卷积-mnist数据生成(代码) 1.tf.layers.conv2d(卷积操作) 2.tf.layers.conv2d_transpose(反卷积操作) 3.tf.layers.batch_normalize(归一化操作) 4.tf.maximum(用于lrelu) 5.tf.train_variable(训练中所有参数) 6.np.random.uniform(生成正态数据

1. tf.layers.conv2d(input, filter, kernel_size, stride, padding) # 进行卷积操作 参数说明:input输入数据, filter特征图的 ...

- 【TensorFlow】理解tf.nn.conv2d方法 ( 附代码详解注释 )

最近在研究学习TensorFlow,在做识别手写数字的demo时,遇到了tf.nn.conv2d这个方法,查阅了官网的API 发现讲得比较简略,还是没理解.google了一下,参考了网上一些朋友写得博 ...

- tf.nn.conv2d 和 tf.nn.max_pool 中 padding 分别为 'VALID' 和 'SAME' 的直觉上的经验和测试代码

这个地方一开始是迷糊的,写代码做比较分析,总结出直觉上的经验. 某人若想看精准的解释,移步这个网址(http://blog.csdn.net/fireflychh/article/details/73 ...

- TF-卷积函数 tf.nn.conv2d 介绍

转自 http://www.cnblogs.com/welhzh/p/6607581.html 下面是这位博主自己的翻译加上测试心得 tf.nn.conv2d是TensorFlow里面实现卷积的函数, ...

- tf.nn.conv2d。卷积函数

tf.nn.conv2d是TensorFlow里面实现卷积的函数,参考文档对它的介绍并不是很详细,实际上这是搭建卷积神经网络比较核心的一个方法,非常重要 tf.nn.conv2d(input, fil ...

- tf.nn.conv2d 参数介绍

tf.nn.conv2d是TensorFlow里面实现卷积的函数,参考文档对它的介绍并不是很详细,实际上这是搭建卷积神经网络比较核心的一个方法,非常重要 tf.nn.conv2d(input, fil ...

- tf.nn.conv2d()需要搞清楚的几个变量。

惯例先展示函数: tf.nn.conv2d(input, filter, strides, padding, use_cudnn_on_gpu=None, name=None) 除去name参数用以指 ...

随机推荐

- MongoDB存储引擎(下)——In-Memory

前两篇文章分别介绍了MMAPv1和WiredTiger,这两个存储引擎都是会将数据持久化存储到硬盘的,除此之外,MongoDB也有只将数据存储在内存的存储引擎,那就是In-Memory. In-Mem ...

- CLOB型转成字符型

//oracle.sql.Clob类型转换成String类型 public static String ClobToString(Clob clob) { String reString = &quo ...

- 为eclipse安装subclipse(SVN插件)

1.打开eclipse,点击菜单Help->Install New Software 2.进入安装窗体后,点击安装窗体的右侧的Add按钮,然后在弹出的窗体中输入名称:Subclipse 1.12 ...

- oled

gnd.vcc.clk.miso.rst.mosi.cs

- Problem : (1.2.1) Text Reverse

#include<iostream> using namespace std; void main() { char arr[1000]; int a,n; int s,t; cin> ...

- sys模块和序列化模块

import sysprint(sys.version) #查看当前pycharm版本print(sys.path )#返回模块的搜索路径print(sys.platform )#返回操作系统的版本p ...

- delphi GDI 图片压缩代码 据说是位图缩放保持原图视觉效果最好的算法

delphi 图片压缩代码 据说是位图缩放保持原图视觉效果最好的算法 若有更好的,请大神留言我也学习下,感谢! uses WinAPI.GDIPAPI, WinAPI.GDIPOBJ; var Bi ...

- 智能合约语言 Solidity 教程系列7 - 以太单位及时间单位

这是Solidity教程系列文章第7篇介绍以太单位及时间单位,系列带你全面深入理解Solidity语言. 写在前面 Solidity 是以太坊智能合约编程语言,阅读本文前,你应该对以太坊.智能合约有所 ...

- iOS 用户体验之音频

早期某知名公司的应用有这么一个问题,如果我在听音乐时打开该应用,播放一段小视频,视频播放完成之后,音乐没有继续播放.这个问题被很多用户吐槽,很久以后,该公司终于修复了这个问题. 无论声音是应用体验的重 ...

- mybatis返回list

1 Model类 public class Vo { /** * this is used for receive data partly from table user_question_secti ...