YARN 的深入简出

1.YARN的产生背景

2.YARN的执行流程

3.YARN的概述

4.YARN的环境搭建

5.YARN的架构

6.如何提交作业到YaRN上执行

YARN的产生MapReduce1.x存在多种问题单节点故障&节点压力大&不支持除了MapReduce之外的计算框架

MapReduce:Master/Slave架构 1个JobTracker带多个TaskTrack

JobTracker :负责资源管理和作业调度

TaskTracker : 定期向JT汇报本节点的健康状况,资源使用情况,作业执行情况

接收来自JT的命令:启动任务/杀死任务

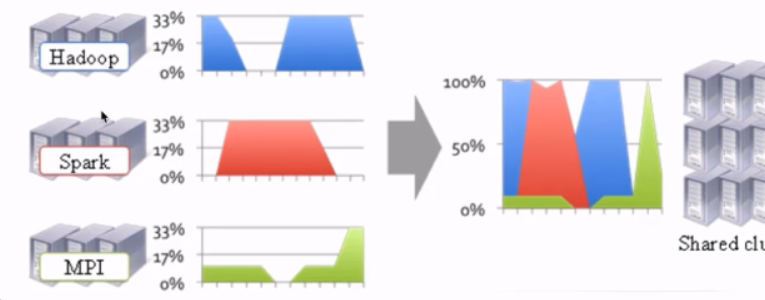

YARN资源的利用率&运维成本

集群多且资源利用率低&运维成本高&数据移动成本高催生了UARN

YARN:不同的计算框架可以享受同一个HDFS集群上的数据,享受整体的资源调度

xxx on YARN 的好处 :与其他计算框架共享集群资源,按资源需要分配:进而提高集群资源的利用率

xx :Spark/MapReduce/Strom/Flink

YARN的概述

Yet Another Resource Negotiator

通用的资源管理系统

为上层应用提供统一的资源管理和调度'

YARN的架构

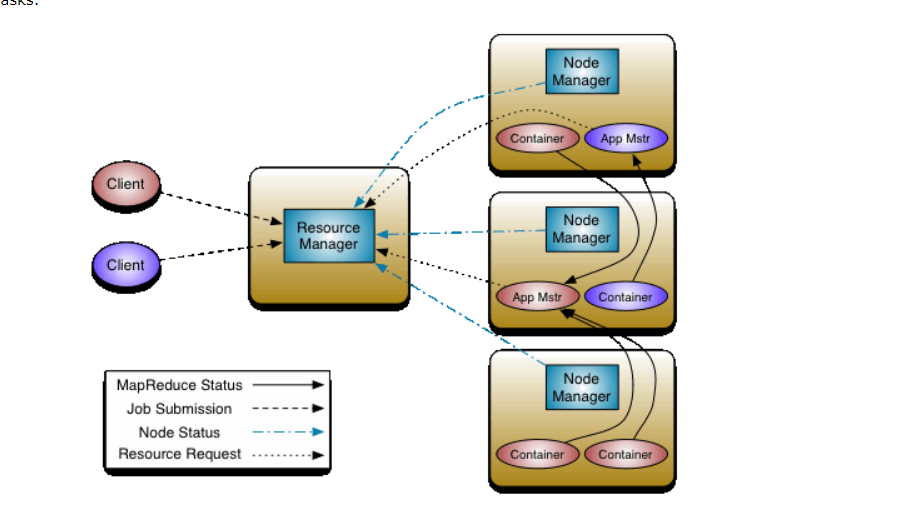

YARN架构:

1)ResourceManageer:RM

整个集群提供服务的RM只有一个,负责整个集群的统一资源的统一管理和调度/工业上实际有两个\

处理客户端的请求:提交一个作业,杀死一个作业

监控NM,一旦某个NM挂了,那么该NM运行的任务需要告诉AM来如何处理

2)NodeManager:NM

整个集群中有多个,负责自身的资源管理和使用

定时向RM汇报本节点的使用情况

接受并处理来自RM的各种命令,启动Container

处理来自AM的命令

单个节点资源管理是由自己来完成的

3)ApplicationMaster:AM

每个应用程序对应一个:MR,spark,负责应用程序的管理

为应用程序向RM申请资源(core,memory),分配给内部task

需要与NM通信:启动/停止task是运行在Container里面,AM也是运行在Container里面

4)Container

封装了CPU,Memory等资源的一个容器

5)Client

提交作业

查询作业的运行精度

杀死作业

YARN的作业应用

通用架构,无论是改哪个,它就改MapReduceApplicationMaster或者为SparkApplicationMaster

YARN环境搭建

hadoop-2.6.0-cdh5.7.0

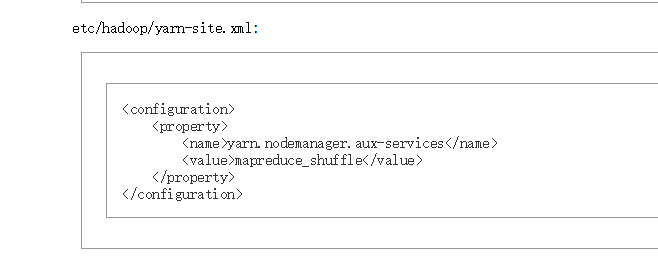

yarn-site.xml

mapred-site.xml

YARN ON Single Node

1)

marpred-site.xml

2)yarn-site.xml

如果在Spark则将marpreduce_shuffle 改为 spqrk_shuffle

3)启动进程

Sbin/start-yarn.sh

4)验证

jps

http://hadoop000:8088

5)

停止YARN相关的进程

Sbin/stop-yarn.sh

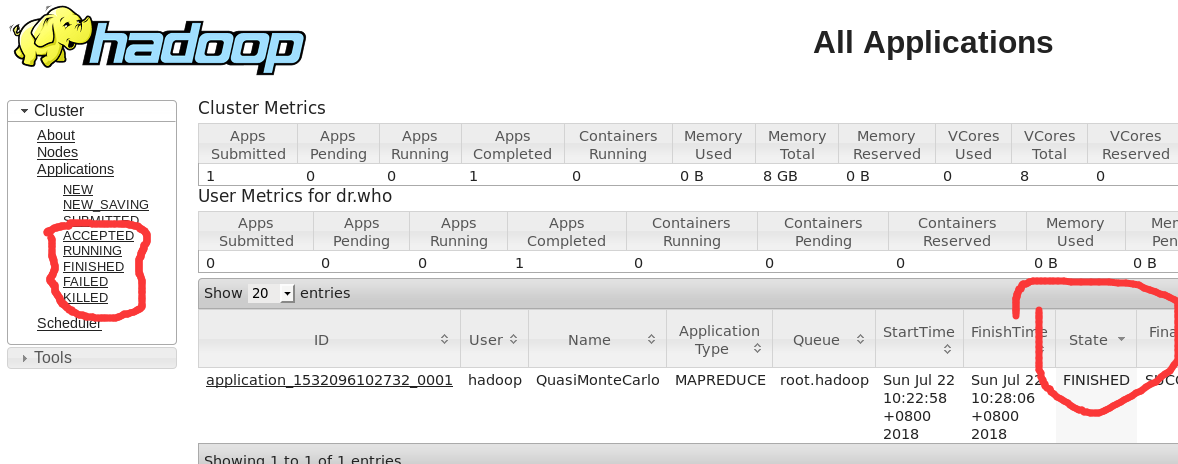

MapReduce提交作业到YARN上运行

hadoop-mapReduce-examples-2.6.0-5.7.0

这行命令是算Pi的

hadoop jar hadoop-mapreduce-examples-2.6.0-cdh5.7.0.jar pi 2 3

这是hadoop UI展示的hadoop的运行状态

YARN 的深入简出的更多相关文章

- 深入简出的nginx

深入简出的nginx hosts的简单介绍 nginx的简单介绍 hosts介绍 谈到nginx我们不得不说hosts hosts的存放在C:\Windows\System32\drivers\etc ...

- Vuex 2.0 深入简出

最近面试充斥了流行框架Vue的各种问题,其中Vuex的使用就相当有吸引力.下面我就将自己深入简出的心得记录如下: 1.在vue-init webpack project (创建vue项目) 2.src ...

- 大数据系列博客之 --- 深入简出 Shell 脚本语言(高级篇)

首先声明,此系列shell系列博客分为四篇发布,分别是: 基础篇:https://www.cnblogs.com/lsy131479/p/9914747.html 提升篇:https://www.cn ...

- HDFS之深入简出(一)

分布式文件系统HDFS 一:概述 1.HDFS设计目标 2.HDFS核心组件 3.HDFS副本机制 4.HDFS环境搭建 5.HDFS shell命令 java api 6.HDFS读写流程 7.H ...

- 深入简出mysql--第一部分

第二章: 1.sql分类 DDL(Data Definition Languages)语句:数据定义语言,这些语句定义了不同的数据段.数据库.表.列.索引等数据库对象的定义. 常用的语句关键字主要包括 ...

- 大数据系列博客之 --- 深入简出 Shell 脚本语言(提升篇)

首先声明,此系列shell系列博客分为四篇发布,分别是: 基础篇:https://www.cnblogs.com/lsy131479/p/9914747.html 提升篇:https://www.cn ...

- 大数据系列博客之 --- 深入简出 Shell 脚本语言(基础篇)

首先声明,此系列shell系列博客分为四篇发布,分别是: 基础篇:https://www.cnblogs.com/lsy131479/p/9914747.html 提升篇:https://www.cn ...

- 分布式处理框架MapReduce的深入简出

1).MapReduce的概述 2).MapReduce 编程模型 3).MapReduce架构 4).MapReduce编程 Google MapReduce论文,论文发表于2004年 Hadoop ...

- hadoop深入简出(二)

1.上传文件 Hadoop fs -put hello.txt / 2.查看上传的文件 hadoop fs -ls / hadoop fs -text /hello.txt 两个命令都可以 3.创建文 ...

随机推荐

- 一、Jmeter环境介绍

1.安装 从Apache网站http://jmeter.apache.org/download_jmeter.cgi下载二进制包. .tgz后缀名的为Linux使用的包 .zip后缀的为windows ...

- new date() 计算本周周一日期

new date() 计算本周周一日期 需求:计算某天的那一周周一的日期 1.new Date() date.getDay(); //获取周几 0-6 date.getTime();//获取时间戳 1 ...

- SSO单点登录、跨域重定向、跨域设置Cookie、京东单点登录实例分析

最近在研究SSO单点登录技术,其中有一种就是通过js的跨域设置cookie来达到单点登录目的的,下面就已京东商城为例来解释下跨域设置cookie的过程 涉及的关键知识点: 1.jquery ajax跨 ...

- sqlserver中 事物 索引及视图

事务 1.什么是事务 事务是一个不可分割的工作逻辑单元,它包含了一组数据库的操作命令,并且所有命令作为一个整体一起向系统提交或撤销操作请求,即要么都执行,要么都不执行 2.事务的4个属性 (1). ...

- postman 请求种添加用户权限

1. 打开postman, 在Tests输入以下内容: var jsonData =JSON.parse(responseBody);//获取body中返回的所有参数 postman.setGloba ...

- 正则表达式(Kotlin)

课题 使用正则表达式匹配字符串 使用正则表达式 "\d{3}-(\d{4})-\d{2}" 匹配字符串 "123-4567-89" 返回匹配结果:'" ...

- vue中嵌套页面(iframe)

vue中嵌套iframe,将要嵌套的文件放在static下面.(要将打包文件整体放在statici里,我的文件名是canvas) src可以使用相对路径,也可使用服务器根路径http:localhos ...

- Excel导入oracle的几种方法

http://www.jb51.net/list/list_154_1.htm 方法一.使用SQL*Loader这个是用的较多的方法,前提必须oracle数据中目的表已经存在.大体步骤如下:1.将ex ...

- mac使用brew安装sshpass

brew安装sshpass brew install https://raw.githubusercontent.com/kadwanev/bigboybrew/master/Library/Form ...

- 修改maven项目的编译版本

在pom.xml中添加如下代码 <build> <!-- 配置了很多插件 --> <plugins> <plugin> <groupId>o ...