网页解析 -- bs4 和 xpath 的简单使用

bs4

BeautifulSoup 是一个可以从HTML或XML文件中提取数据的Python库,它的使用方式相对于正则来说更加的简单方便

中文文档:https://beautifulsoup.readthedocs.io/zh_CN/v4.4.0

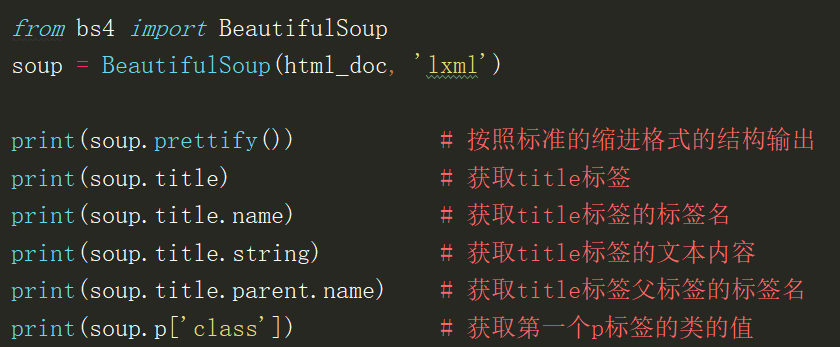

Tag

name:每一个tag对象都有name属性,为标签的名字

Attributes:在HTML中,tag可能有多个属性,所以tag属性的取值跟字典相同

get_text():通过get_text()方法可以获取某个tag下所有的文本内容

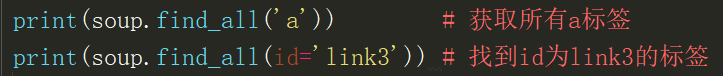

find_all()

通过name搜索,find_all('a')可以直接查找出整个文档树中所有的a标签,并返回列表

通过属性搜索,通过传递给attrs一个字典参数来搜索属性:soup.find_all(attrs={'class': 'sister'})

通过文本搜索,soup.find_all(text="Lacie")

通过正则表达式来筛选,将re.compile编译的对象传入find_all()方法,tags = soup.find_all(re.compile("^b"))

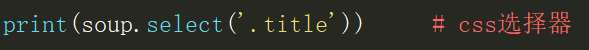

CSS选择器

使用select(),在其中传入字符串参数,就可以使用CSS选择器的语法来找到tag

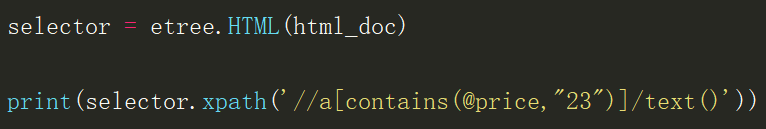

xpath

相比于BeautifulSoup,Xpath在提取数据时会更有效率

from lxml import etree

表达式

nodename 选取当前节点的所有nodename子节点

/ 根路径

// 从整个文档当中搜索,不考虑位置

. 当前节点

.. 当前节点的父节点

@ 选取属性

路径表达式

//bookstore/book[1] 选取属于bookstore子元素的第一个 book元素

//bookstore/book[last()] 选取属于bookstore子元素的最后一个book元素

//bookstore/book[|ast()-1] 选取属于bookstore子元素的倒数第二个 book元素

//bookstore/book[position0)<3] 选取最前面的两个属于bookstore元素的子元素的book元素

//title[@lang] 选取所有拥有名为lang的属性的title 元素

//title[@lang='eng'] 选取所有title 元素,且这些元素拥有值为eng的lang属性

//bookstore/book[price>35.00] 选取bookstore元素的所有book元素,且其中的price元素的值须大于35.00

//bookstore/book[price> 35.00]/title 选取bookstore元素中的book元素的所有title元素,且其中的price元素的值须大于35.00

选取未知节点

* 匹配任何元素节点 //bookstore/* 选取bookstore元素的所有子元素

@* 匹配任何属性节点 //* 选取文档中的所有元素

node() 匹配任何类型的节点 //title[@*] 选取所有带有属性的title元素

选取多个路径

//book/title| //book/price 选取book元素的所有title和price元素

//title | //price 选取文档中所有的title和price元素

//bookstore/book/title| //price 选取bookstore元素的book元素的所有title元素,以及文档中所有的price元素

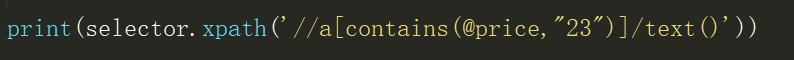

获取文本

用text()获取某个节点下的文本 //a/text()

用string()获取某个节点下所有的文本 string(//book[1])

其它

contains() 包含于 //div[contains(@id,'note')]

strats-with() 以什么开头

多个属性组合 //input(@id='ffff' and @name ='username')

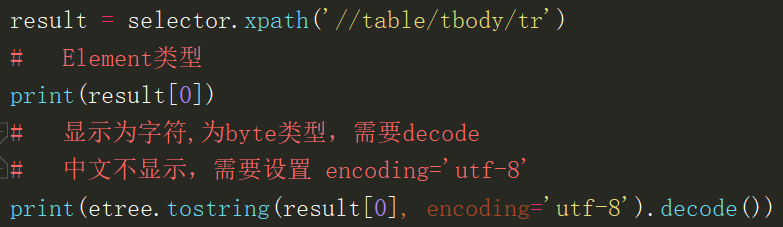

将Element显示为字符

网页解析 -- bs4 和 xpath 的简单使用的更多相关文章

- 爬虫——网页解析利器--re & xpath

正则解析模块re re模块使用流程 方法一 r_list=re.findall('正则表达式',html,re.S) 方法二 创建正则编译对象 pattern = re.compile('正则表达式 ...

- 网页解析:Xpath 与 BeautifulSoup

1. Xpath 1.1 Xpath 简介 1.2 Xpath 使用案例 2. BeautifulSoup 2.1 BeautifulSoup 简介 2.2 BeautifulSoup 使用案例 1) ...

- 关于爬虫中常见的两个网页解析工具的分析 —— lxml / xpath 与 bs4 / BeautifulSoup

http://www.cnblogs.com/binye-typing/p/6656595.html 读者可能会奇怪我标题怎么理成这个鬼样子,主要是单单写 lxml 与 bs4 这两个 py 模块名可 ...

- python爬虫的页面数据解析和提取/xpath/bs4/jsonpath/正则(1)

一.数据类型及解析方式 一般来讲对我们而言,需要抓取的是某个网站或者某个应用的内容,提取有用的价值.内容一般分为两部分,非结构化的数据 和 结构化的数据. 非结构化数据:先有数据,再有结构, 结构化数 ...

- 爬虫的三种解析方式(正则解析, xpath解析, bs4解析)

一 : 正则解析 : 常用正则回顾: 单字符: . : 除换行符以外的所有字符 [] : [aoe] [a-w] 匹配集合中任意一个字符 \d : 数字 [0-9] \D : 非数字 \w : 非数字 ...

- 网页解析库-Xpath语法

网页解析库 简介 除了正则表达式外,还有其他方便快捷的页面解析工具 如:lxml (xpath语法) bs4 pyquery等 Xpath 全称XML Path Language, 即XML路径语言, ...

- 【XPath Helper:chrome爬虫网页解析工具 Chrome插件】XPath Helper:chrome爬虫网页解析工具 Chrome插件下载_教程_安装 - 开发者插件 - Chrome插件网

[XPath Helper:chrome爬虫网页解析工具 Chrome插件]XPath Helper:chrome爬虫网页解析工具 Chrome插件下载_教程_安装 - 开发者插件 - Chrome插 ...

- Android Studio下的简单网页解析

Android Studio下的简单网页解析 一.导入数据 导入前添加依赖 implementation 'org.jsoup:jsoup:1.11.3' 使用字符串导入 String html = ...

- Python网页解析

续上篇文章,网页抓取到手之后就是解析网页了. 在Python中解析网页的库不少,我最开始使用的是BeautifulSoup,貌似这个也是Python中最知名的HTML解析库.它主要的特点就是容错性很好 ...

随机推荐

- Java - IO 内存流和打印流

IO 内存流和打印流操作 字符编码 计算机中所有的信息组成都是二进制数据,所有能够描述的中文文字都是经过处理后的结果:所有的语言文字都会使用编码来进行描述,例如:ASCII码 常见编码 GBK/GB2 ...

- php代码如何加域名授权?开源php项目如何保护版权 商业授权?

php在web开发领域是最热门的语言,也是开发项目的不二选择,许多PHP开发者说它是当今世界上最好的开发语言,php开发项目效率高,是因为开源项目太多了,不管是国内,还是国外,开源的框架,开源的CMS ...

- OpenCV:图像的颜色空间转换

导包: import numpy as np import cv2 import matplotlib.pyplot as plt def show(image): plt.imshow(image) ...

- UIView设置阴影

UI设计师有时候希望我们的产品比较酷. 阴影是他们喜欢的效果之一. 怎么设置阴影呢? 1.设置一个四边都相同的阴影 UIImageView *testImgView = [[UIImageView a ...

- Linux-3.14.12内存管理笔记【构建内存管理框架(1)】

传统的计算机结构中,整个物理内存都是一条线上的,CPU访问整个内存空间所需要的时间都是相同的.这种内存结构被称之为UMA(Uniform Memory Architecture,一致存储结构).但是随 ...

- 苏州市java岗位的薪资状况(2)

上一篇已经统计出了起薪最高的top 10: 接着玩,把top 10 中所有职位的详细信息爬取下来.某一职位的详情是这样: 我们需要把工作经验.学历.职能.关键字爬取下来. from urllib.re ...

- JAVA笔试题(全解)

目录 一. Java基础部分................................................................. 9 1.一个".java& ...

- deepin/debian 安装docker

简介 Docker 是一个开源的应用容器引擎,让开发者可以打包他们的应用以及依赖包到一个可移植的容器中,然后发布到任何流行的 Linux 机器上,也可以实现虚拟化.容器是完全使用沙箱机制,相互之间不会 ...

- 使用 Hbuilder 连接手机调试移动端项目

点击界面上的浏览器右侧的倒三角. 弹出列表以后,点击最后一行 “设置web服务器...”.继续弹出,点击右下角的“外置Web服务器设置”. 点新建. 弹出框后,填入“名称”和“浏览器运行U ...

- 第04组 Beta冲刺(2/5)

队名:new game 组长博客 作业博客 组员情况 鲍子涵(队长) 过去两天完成了哪些任务 验收游戏素材 学习Unity 2D Animation系统 基本做完了人物的各个动画 接下来的计划 冲击E ...