Celery框架实现异步执行任务

Celery

官方

Celery 官网:http://www.celeryproject.org/

Celery 官方文档英文版:http://docs.celeryproject.org/en/latest/index.html

Celery 官方文档中文版:http://docs.jinkan.org/docs/celery/

Celery架构

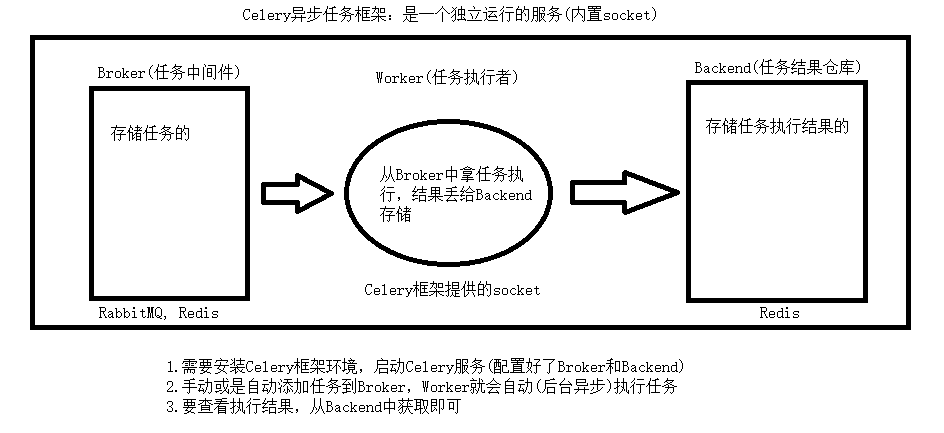

Celery的架构由三部分组成,消息中间件(message broker)、任务执行单元(worker)和 任务执行结果存储(task result store)组成。

消息中间件

Celery本身不提供消息服务,但是可以方便的和第三方提供的消息中间件集成。包括,RabbitMQ, Redis等等

任务执行单元

Worker是Celery提供的任务执行的单元,worker并发的运行在分布式的系统节点中。

任务结果存储

Task result store用来存储Worker执行的任务的结果,Celery支持以不同方式存储任务的结果,包括AMQP, redis等

使用场景

异步任务:将耗时操作任务提交给Celery去异步执行,比如发送短信/邮件、消息推送、音视频处理等等

定时任务:定时执行某件事情,比如每天数据统计

Celery的安装配置

pip install celery

消息中间件:RabbitMQ/Redis

app=Celery('任务名', broker='xxx', backend='xxx')

Celery执行异步任务

包架构封装

project

├── celery_task # celery包

│ ├── __init__.py # 包文件

│ ├── celery.py # celery连接和配置相关文件,且名字必须是celery.py

│ └── tasks.py # 所有任务函数

├── add_task.py # 添加任务

└── get_result.py # 获取结果

基本使用(添加立即执行任务)

执行流程:

1)创建app + 任务

2)启动celery(app)服务:

非windows

命令:celery worker -A celery_task -l info

windows:

pip3 install eventlet

celery worker -A celery_task -l info -P eventlet

3)添加任务:手动添加,要自定义添加任务的脚本,右键执行脚本

4)获取结果:手动获取,要自定义获取任务的脚本,右键执行脚本

celery.py

from celery import Celery

# broker: 任务仓库

broker = 'redis://127.0.0.1:6379/5'

# backend: 任务结果仓库

backend = 'redis://127.0.0.1:6379/6'

# include: 任务(函数)所在文件

app = Celery(broker=broker, backend=backend, include=['celery_task.tasks'])

tasks.py(任务文件)

from .celery import app

import time

@app.task

def add(n, m):

print(n)

print(m)

time.sleep(10)

print('n+m的结果:%s' % (n + m))

return n + m

@app.task

def low(n, m):

print(n)

print(m)

print('n-m的结果:%s' % (n - m))

return n - m

add_task.py(添加要执行的任务)

# 右键执行该文件,下面的导入环境是合理的

from celery_task.tasks import add, low

# 往celery的Broker中添加立即任务

# 先启动celery: celery worker -A celery_task -l info -P eventlet ,然后右键运行执行

t1 = add.delay(10, 20)

t2 = low.delay(50, 10)

print(t2.id)

get_result.py(查看任务结果)

from celery_task.celery import app

from celery.result import AsyncResult

# 任务执行的id,可从上方任务执行完获取

id = '21325a40-9d32-44b5-a701-9a31cc3c74b5'

if __name__ == '__main__':

async = AsyncResult(id=id, app=app)

if async.successful():

# 拿到任务执行完的结果

result = async.get()

print(result)

elif async.failed():

print('任务失败')

elif async.status == 'PENDING':

print('任务等待中被执行')

elif async.status == 'RETRY':

print('任务异常后正在重试')

elif async.status == 'STARTED':

print('任务已经开始被执行')

高级使用(执行延迟任务)

celery.py

from celery import Celery

# broker:任务仓库

broker = 'redis://127.0.0.1:6379/15'

# backend:任务结果仓库

backend = 'redis://127.0.0.1:6379/15'

# include:任务(函数)所在文件

app = Celery(broker=broker, backend=backend, include=['celery_package.tasks'])

tasks.py

from .celery import app

@app.task

def jump(n1, n2):

res = n1 * n2

print('n1 * n2 = %s' % res)

return res

add_task.py(添加延迟任务)

注:

args是jump任务需要的参数,没有就设置为空()

eta是该任务执行的UTC格式的时间

from celery_package.tasks import jump

# # 直接执行函数

# jump(10, 20)

# 添加celery立即任务

# jump.delay(10, 20)

from datetime import datetime, timedelta

# 以秒为单位添加延迟时间

def eta_second(second):

ctime = datetime.now()

utc_ctime = datetime.utcfromtimestamp(ctime.timestamp())

time_delay = timedelta(seconds=second)

return utc_ctime + time_delay

# 以天为单位添加延迟时间

def eta_days(days):

ctime = datetime.now()

utc_ctime = datetime.utcfromtimestamp(ctime.timestamp())

time_delay = timedelta(days=days)

return utc_ctime + time_delay

# apply_async就是添加延迟任务

jump.apply_async(args=(200, 50), eta=eta_second(10))

高级使用(自动任务)

执行流程:

1)创建app + 任务

2)启动celery(app)服务:

非windows

命令:celery worker -A celery_task -l info

windows:

pip3 install eventlet

celery worker -A celery_task -l info -P eventlet

3)添加任务:自动添加任务,所以要启动一个添加任务的服务

命令:celery beat -A celery_task -l info

4)获取结果:手动获取,要自定义获取任务的脚本,右键执行脚本

celery.py

from celery import Celery

broker = 'redis://127.0.0.1:6379/15'

backend = 'redis://127.0.0.1:6379/15'

app = Celery(broker=broker, backend=backend, include=['celery_task.tasks'])

# 时区

app.conf.timezone = 'Asia/Shanghai'

# 是否使用UTC

app.conf.enable_utc = False

# 自动任务的定时配置

from celery.schedules import crontab

from datetime import timedelta

app.conf.beat_schedule = {

# 定时任务:任务名自定义

'fall_task': {

'task': 'celery_task.tasks.fall', # 任务源

'args': (30, 10), # 任务参数

'schedule': timedelta(seconds=3), # 定时添加任务的时间

# 'schedule': crontab(hour=8, day_of_week=1), # 每周一早八点

}

}

tasks.py

from .celery import app

@app.task

def fall(n1, n2):

res = n1 / n2

print('n1 / n2 = %s' % res)

return res

get_result.py

from celery_task.celery import app

from celery.result import AsyncResult

id = '21325a40-9d32-44b5-a701-9a31cc3c74b5'

if __name__ == '__main__':

async = AsyncResult(id=id, app=app)

if async.successful():

result = async.get()

print(result)

elif async.failed():

print('任务失败')

elif async.status == 'PENDING':

print('任务等待中被执行')

elif async.status == 'RETRY':

print('任务异常后正在重试')

elif async.status == 'STARTED':

print('任务已经开始被执行')

django中使用

注意点:

添加自动任务时,需要另外启动一个添加任务的服务,就是再起一个服务端运行下面的命令。

命令:celery beat -A celery_task -l info

celery.py

# 加载django环境

import os, django

os.environ.setdefault("DJANGO_SETTINGS_MODULE", "luffyapi.settings.dev")

django.setup()

from celery import Celery

# 任务仓库

broker = 'redis://127.0.0.1:6379/15'

# 任务结果仓库

backend = 'redis://127.0.0.1:6379/15'

# include任务函数文件的位置

app = Celery(broker=broker, backend=backend, include=['celery_task.tasks'])

# 时区

app.conf.timezone = 'Asia/Shanghai'

# 是否使用UTC

app.conf.enable_utc = False

# 自动任务的定时配置

from celery.schedules import crontab

from datetime import timedelta

app.conf.beat_schedule = {

# 定时任务:任务名自定义

'update_banner_cache': {

'task': 'celery_task.tasks.update_banner_cache', # 任务源

'args': (), # 任务参数

'schedule': timedelta(seconds=10), # 定时添加任务的时间

# 'schedule': crontab(hour=8, day_of_week=1), # 每周一早八点

}

}

tasks.py

from .celery import app

# 获取项目中的模型类

from api.models import Banner

@app.task

def test_django_celery():

banner_query = Banner.objects.filter(is_delete=False).all()

print(banner_query)

Celery框架实现异步执行任务的更多相关文章

- Celery+python+redis异步执行定时任务

我之前的一篇文章中写了[Celery+django+redis异步执行任务] 博文:http://blog.csdn.net/apple9005/article/details/54236212 你会 ...

- 如何使用django+celery+RabbitMQ实现异步执行

1)安装需要安装RabbitMQ.Celery和Django-celeryCelery和Django-celery的安装直接pip就好 2)修改settings.py在INSTALLED_APPS中加 ...

- 使用django+celery+RabbitMQ实现异步执行

http://www.yu180.com/group/view/259 推荐一个解决框架 https://github.com/maccman/juggernaut Realtime server p ...

- 第六章并发编程,异步执行框架executor

异步执行框架executor是一个接口,只有一个方法.接受一个Runnable做为参数,执行任务. 将任务的执行与提交解耦. 1:executor package java.util.concurre ...

- celery 框架

转自:http://www.cnblogs.com/forward-wang/p/5970806.html 生产者消费者模式 在实际的软件开发过程中,经常会碰到如下场景:某个模块负责产生数据,这些数据 ...

- Celery 框架学习笔记

在学习Celery之前,我先简单的去了解了一下什么是生产者消费者模式. 生产者消费者模式 在实际的软件开发过程中,经常会碰到如下场景:某个模块负责产生数据,这些数据由另一个模块来负责处理(此处的模块是 ...

- django celery的分布式异步之路(一) 起步

如果你看完本文还有兴趣的话,可以看看进阶篇:http://www.cnblogs.com/kangoroo/p/7300433.html 设想你遇到如下场景: 1)高并发 2)请求的执行相当消耗机器资 ...

- Celery框架

在学习Celery之前,我先简单的去了解了一下什么是生产者消费者模式. 生产者消费者模式 在实际的软件开发过程中,经常会碰到如下场景:某个模块负责产生数据,这些数据由另一个模块来负责处理(此处的模块是 ...

- 使用redis原生list结构作为消息队列取代celery框架。

1.web后台对大批量的繁重的io任务需要解耦使用分布式异步技术,否则会使接口阻塞,并发延迟,一般就选celery好了.此篇的取代主要是针对取代celery的worker模式.没有涉及到周期和定时模式 ...

随机推荐

- Android 禁止截屏、录屏 — 解决PopupWindow无法禁止录屏问题

项目开发中,为了用户信息的安全,会有禁止页面被截屏.录屏的需求. 这类资料,在网上有很多,一般都是通过设置Activity的Flag解决,如: //禁止页面被截屏.录屏 getWindow().add ...

- mybatis-spring 启动过程和调用过程

mybatis-spring 可以为我们做什么 mybatis框架已经很不错了,它把配置和执行sql的通用过程抽象出来.只要你符合mybatis框架的要求,首先有正确的配置,然后有model,inte ...

- CPS Tester

将测出10s的平均cps值 在窗内点击即可 github已编译程序:https://github.com/Ice-watermelon233/cps-tester #include <bits/ ...

- JavaScript权威指南----一个JavaScript贷款计算器

废话不多说上例子代码: <!DOCTYPE html> <html> <head> <meta charset="UTF-8"> & ...

- csps模拟测试70

又炸了,T1没开$long long$,炸掉$50pts$,昨天因为SB错误挂掉$100pts$. 我kuku了,以后细心点吧.

- C# WebApi 根据实体类检查传参或字典检查参数

根据实体类或字典检查传参,是否缺少参数并返回缺少参数 值类型必须声明可空 /// <summary> /// 根据 Dictionary<string, string> 得到实 ...

- thinkphp5.1长连接-单例模式测试!

在控制器中 使用以下代码测试 for ($i = 0; $i < 1000; $i++) { $tmp['name'] = 'f_'.$i; $tmp['times'] = date('Y-m ...

- js解析json报错Unexpected token i in JSON at position 1

因为后台json是手动拼接的,在拼接时偷了懒,不想转义,所以就用了单引号,结果js解析时悲催了 这里记录一下,被解析的json字符串必须键值对都用双引号包起来,必须是双引号 默默罚抄一百遍

- Linux 学习(1) | 学习方向导图

方向导图 文件系统导图 内核导图

- SpringBoot RESTful api

一.REST简单介绍 REST代表Representational State Transfer,是一种URI风格,是一组架构约束条件和原则.REST风格服务调用就是解析URL请求,将请求由逻辑构建处 ...