【原创】大叔问题定位分享(5)Kafka客户端报错SocketException: Too many open files 打开的文件过多

kafka0.8.1

一 问题

10月22号应用系统忽然报错:

[2014/12/22 11:52:32.738]java.net.SocketException: 打开的文件过多

[2014/12/22 11:52:32.738] at java.net.Socket.createImpl(Socket.java:447)

[2014/12/22 11:52:32.738] at java.net.Socket.connect(Socket.java:577)

[2014/12/22 11:52:32.738] at java.net.Socket.connect(Socket.java:528)

[2014/12/22 11:52:32.738] at sun.net.NetworkClient.doConnect(NetworkClient.java:180)

[2014/12/22 11:52:32.738] at sun.net.www.http.HttpClient.openServer(HttpClient.java:432)

[2014/12/22 11:52:32.738] at sun.net.www.http.HttpClient.openServer(HttpClient.java:527)

[2014/12/22 11:52:32.738] at sun.net.www.http.HttpClient.<init>(HttpClient.java:211)

[2014/12/22 11:52:32.738] at sun.net.www.http.HttpClient.New(HttpClient.java:308)

[2014/12/22 11:52:32.738] at sun.net.www.http.HttpClient.New(HttpClient.java:326)

[2014/12/22 11:52:32.738] at sun.net.www.protocol.http.HttpURLConnection.getNewHttpClient(HttpURLConnection.java:996)

[2014/12/22 11:52:32.738] at sun.net.www.protocol.http.HttpURLConnection.plainConnect(HttpURLConnection.java:932)

[2014/12/22 11:52:32.738] at sun.net.www.protocol.http.HttpURLConnection.connect(HttpURLConnection.java:850)

[2014/12/22 11:52:32.738] at sun.net.www.protocol.http.HttpURLConnection.getOutputStream(HttpURLConnection.java:1091)

[2014/12/22 11:52:32.738] at com.rbc.http.client.RbcHttpClient.callCptService(RbcHttpClient.java:50)

[2014/12/22 11:52:32.738] at com.rbc.http.client.RbcHttpClient.callCptService(RbcHttpClient.java:144)

[2014/12/22 11:52:32.738] at com.rbc.http.bean.BaseBean.call(BaseBean.java:54)

[2014/12/22 11:52:32.739] at app.package.APPClass.send2Center(APPClass.java:852)

[2014/12/22 11:52:32.739] at sun.reflect.GeneratedMethodAccessor4312.invoke(Unknown Source)

[2014/12/22 11:52:32.739] at sun.reflect.DelegatingMethodAccessorImpl.invoke(DelegatingMethodAccessorImpl.java:43)

[2014/12/22 11:52:32.739] at java.lang.reflect.Method.invoke(Method.java:606)

[2014/12/22 11:52:32.739] at org.springframework.aop.support.AopUtils.invokeJoinpointUsingReflection(AopUtils.java:307)

[2014/12/22 11:52:32.739] at org.springframework.aop.framework.JdkDynamicAopProxy.invoke(JdkDynamicAopProxy.java:198)

[2014/12/22 11:52:32.739] at com.sun.proxy.$Proxy157.send2Center(Unknown Source)

[2014/12/22 11:52:32.739] at java.util.concurrent.Executors$RunnableAdapter.call(Executors.java:471)

[2014/12/22 11:52:32.739] at java.util.concurrent.FutureTask.run(FutureTask.java:262)

[2014/12/22 11:52:32.739] at java.util.concurrent.ThreadPoolExecutor.runWorker(ThreadPoolExecutor.java:1145)

[2014/12/22 11:52:32.739] at java.util.concurrent.ThreadPoolExecutor$Worker.run(ThreadPoolExecutor.java:615)

[2014/12/22 11:52:32.739] at java.lang.Thread.run(Thread.java:745)

发现是因为上午打开一个开关,即应用系统将访问日志发送到消息平台kafka,但是应用系统服务器没有配置消息平台kafka的host,导致出现问题;

二 问题重现

将kafka客户端的broker-list配置为一个不存在的host,并且不断发送消息,执行:

lsof –p $pid|wc -l

会发现该java进程的文件描述符不断增长,其中包含大量的socket连接,并最终超过限制,可以通过:

ulimit -a|grep 'open files'

来查看文件描述符数量限制,超出限制之后,会就不断报错:

java.net.SocketException: Too many open files

问题重现;

但是如果将broker-list配置为一个不存在的ip,则不能重现问题;

三 背景

1 File Descriptor

Generally, a file descriptor is an index for an entry in a kernel-resident array data structure containing the details of open files. In POSIX this data structure is called a file descriptor table, and each process has its own file descriptor table. The process passes the file descriptor to the kernel through a system call, and the kernel will access the file on behalf of the process. The process itself cannot read or write the file descriptor table directly.

On Linux, the set of file descriptors open in a process can be accessed under the path /proc/PID/fd/, where PID is the process identifier.

ulimit -a|grep 'open files'

查看进程文件描述符限制

cat /proc/sys/fs/file-max

查看系统总的文件描述符限制

lsof –p $pid

查看某个进程具体打开的文件描述符

ulimit –n $num

临时修改文件描述符限制

2 Kafka Async Producer

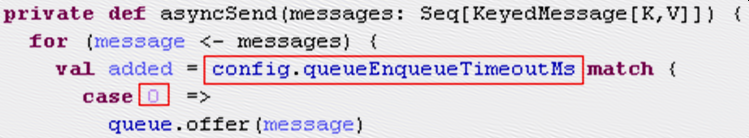

为了避免kafka出现问题影响应用系统,使用kafka异步producer,发送消息后会将消息添加到内存队列并立即返回,另外有一个线程不断处理内存队列中的消息并发送到kafka:

当kafka服务器出现问题,消息发送不出去的时候,只要配置queue.enqueue.timeout.ms=0,则内存队列满时消息直接抛弃掉,不会阻塞:

四 问题原因

Kafka客户端发送消息前,首先会通过broker-list中的配置连接到任一台broker获取metadata:

ERROR [2014-12-22 14:05:04,687] (Logging.scala:103) - Producer connection to $kafka_server_1:9096 unsuccessful

java.nio.channels.UnresolvedAddressException

at sun.nio.ch.Net.checkAddress(Net.java:127)

at sun.nio.ch.SocketChannelImpl.connect(SocketChannelImpl.java:613)

at kafka.network.BlockingChannel.connect(BlockingChannel.scala:57)

at kafka.producer.SyncProducer.connect(SyncProducer.scala:141)

at kafka.producer.SyncProducer.getOrMakeConnection(SyncProducer.scala:156)

at kafka.producer.SyncProducer.kafka$producer$SyncProducer$$doSend(SyncProducer.scala:68)

at kafka.producer.SyncProducer.send(SyncProducer.scala:112)

at kafka.client.ClientUtils$.fetchTopicMetadata(ClientUtils.scala:53)

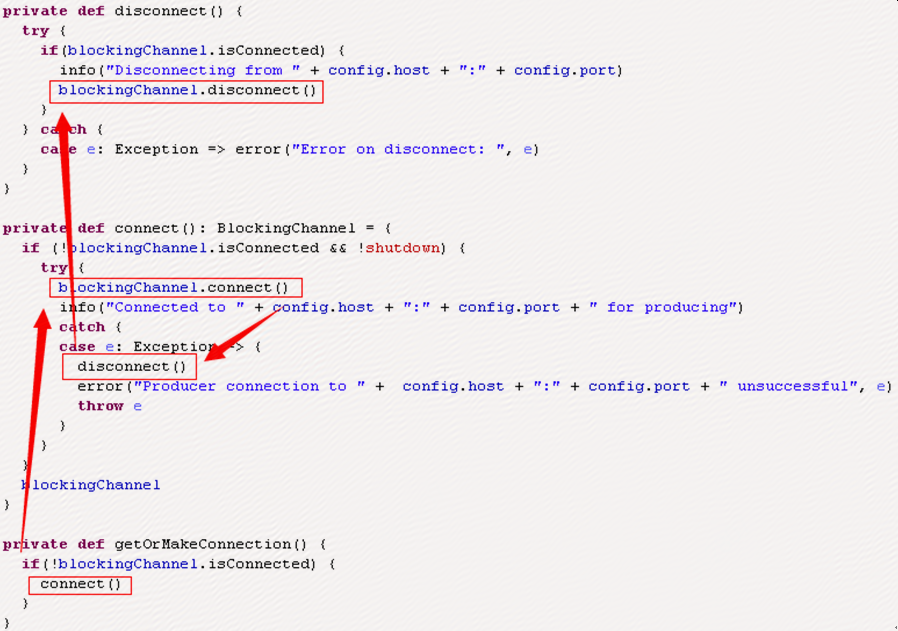

在这个过程报错UnresolvedAddressException,SyncProducer部分代码如下:

BlockingChannel代码如下:

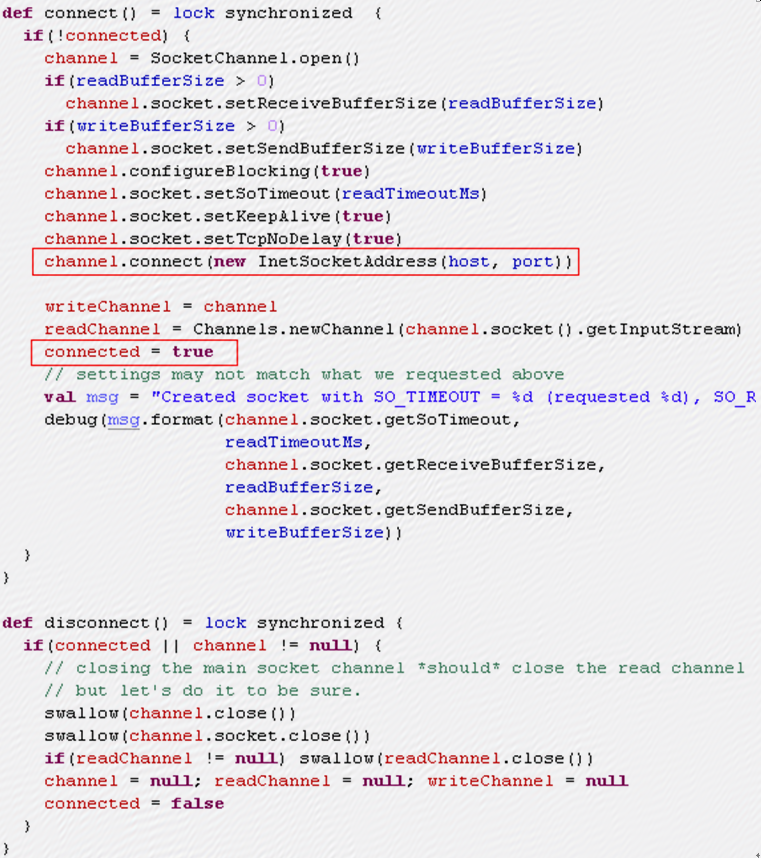

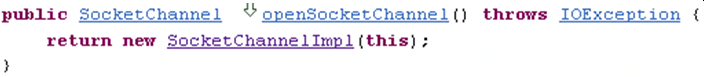

发现问题原因:BlockingChannel的connect方法中,channel.connect这行抛异常,此时connected为false,但是SyncProducer的disconnect中只有当BlockingChannel的connected为true时才会调用BlockingChannel的disconnect方法,所以导致一直在调用Blockingchannel的connect方法而没有调用disconnect方法,而connect方法中会调用SocketChannel.open方法:

->

->

->

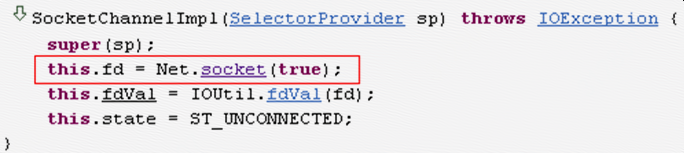

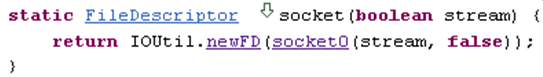

可见每次调用SocketChannel.open方法都会创建一个文件描述符,这样文件描述符会不断增加,为什么只有配host时出问题,而配ip时没有问题,SocketChannelImpl部分代码:

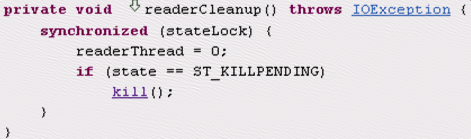

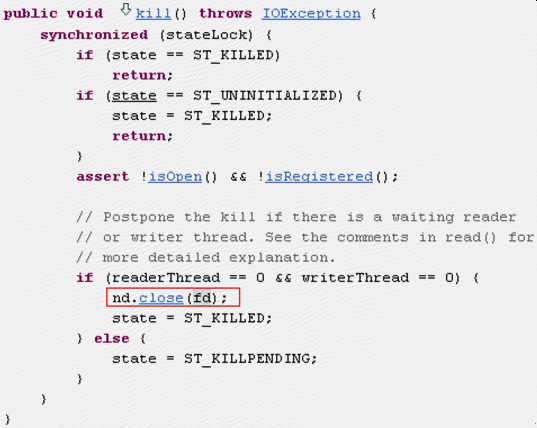

当配host时,是Net.checkAddress时抛UnresolvedAddressException异常,这时直接退出;当配ip时,是在Net.connect时抛ConnectionTimeoutException异常,这时会有后续的finally和catch代码执行,其中readerCleanup代码如下:

->

可见虽然没有调用disconnect,也会关闭文件描述符,所以配ip时不会出现文件描述符过多的问题;

五 修复

修改kafka.network.SocketChannel代码如下:

增加try-catch,并在UnresolvedAddressException异常发生时调用disconnect,问题解决;

这是当时发现问题之后在kafka jira上提交的issues: https://issues.apache.org/jira/browse/KAFKA-1832

【原创】大叔问题定位分享(5)Kafka客户端报错SocketException: Too many open files 打开的文件过多的更多相关文章

- nfs客户端报错解决Stale file handle

NFS故障: 场景:客户端挂载是好的.服务端磁盘满了,重新给挂了一快.客户端df -h nfs挂载消失. 客户端报错:Stale file handle 现象如下: [root@test63-spri ...

- linux下svn客户端报错Cannot negotiate authentication mechanism的解决方法

svn客户端报错Cannot negotiate authentication mechanism的解决方法: 问题出现的原因之一: 因为SVN服务器配置了saslauthd服务用来实现与ldap的对 ...

- [svc]nfs客户端报错解决Stale file handle

NFS故障: 问题背景: 客户端挂载是好的.服务端磁盘满了,重新给挂了一快.客户端df -h 发现nfs挂载消失. 查看目录客户端报错:Stale file handle 现象如下: [root@n1 ...

- kafka启动报错&问题解决

kafka启动报错&问题解决 一早上班,就收到运维同事通知说有一台物理机宕机,导致虚拟机挂了.只得重启kafka服务器. 1.启动 启动zookeeper bin/zkServer.sh st ...

- (未解决)flume监控目录,抓取文件内容推送给kafka,报错

flume监控目录,抓取文件内容推送给kafka,报错: /export/datas/destFile/220104_YT1013_8c5f13f33c299316c6720cc51f94f7a0_2 ...

- Kafka 启动报错java.io.IOException: Can't resolve address.

阿里云上 部署Kafka 启动报错java.io.IOException: Can't resolve address. 本地调试的,报错 需要在本地添加阿里云主机的 host 映射 linux ...

- 【原创】大叔问题定位分享(4)Kafka集群broker节点从zookeeper上消失

kafka_2.8.0-0.8.1 一 现象 生产环境一组kafka集群经常发生问题,现象是kafka在zookeeper上的broker节点消失,此时kafka进程和端口都在,然后每个broker都 ...

- 【原创】大叔问题定位分享(3)Kafka集群broker进程逐个报错退出

kafka0.8.1 一 问题现象 生产环境kafka服务器134.135.136分别在10月11号.10月13号挂掉: 134日志 [2014-10-13 16:45:41,902] FATAL [ ...

- 【原创】大叔问题定位分享(9)oozie提交spark任务报 java.lang.NoClassDefFoundError: org/apache/kafka/clients/producer/KafkaProducer

oozie中支持很多的action类型,比如spark.hive,对应的标签为: <spark xmlns="uri:oozie:spark-action:0.1"> ...

随机推荐

- 占位符的使用和PreparedStatement接口使用:

一.PreparedStatement 接口的使用 首先占位符我们可以使用 Statement 接口来操作数据, 但是这个接口存在两个问题: 1.使用 Statement 接口对象发送的 sql ...

- Python-序列号和模块复习-64

# 序列化模块 # 数据类型转化成字符串的过程就是序列化 # 为了方便存储和网络传输 # json # dumps # loads # dump 和文件有关 # load load不能load多次 i ...

- offsetof(s,m)解析

https://www.cnblogs.com/jingzhishen/p/3696293.html sizeof()用法汇总 sizeof()功能:计算数据空间的字节数1.与strlen()比较 ...

- REST命令控制Player

本文用Postman工具演示通过REST控制Cnario Playr 注意:Player的REST通信默认关闭,使用前需要从Setting>>Remote devices打开Use RES ...

- python多线程和多进程

1 概念梳理: 1.1 线程 1.1.1 什么是线程 线程是操作系统能够进行运算调度的最小单位.它被包含在进程之中,是进程中的实际运作单位.一条线程指的是进程中一个单一顺序的控制流,一个进程中可以并发 ...

- nginx代理部署Vue与React项目

nginx代理部署Vue与React项目 一,介绍与需求 1.1,介绍 Nginx (engine x) 是一个高性能的HTTP和反向代理服务,也是一个IMAP/POP3/SMTP服务.Nginx是由 ...

- 使用Gradle构建web工程配置详解

- CodeForces 280B Maximum Xor Se

题目链接:http://codeforces.com/contest/280/problem/B 题目大意: 给定一个由n个数组成的一个序列,s[l..r] (1 ≤ l < r ≤ n)代表原 ...

- Linux(Ubuntu 16) 下Java开发环境的配置(三)------Mysql配置

前言 吐槽一句,如果在Ubuntu在默认情况下是只有最新的MySQL源的,即如果使用"sudo apt-get install mysql-server mysql-client " ...

- LODOP直线px转换mm变斜线

LODOP中打印项顶边距左边距,宽高,可以选择的单位很多,详细可在LODOP官网下载参考LODOP技术手册. 关于LODOP打印直线和虚线,可查看本博客相关博文:Lodop如何打印直线.Lodop打印 ...