spark之RDD练习

一、基础练习

练习一:翻倍列表中的数值并排序列表,并选出其中大于等于10的元素。

//通过并行化生成rdd

val rdd1 = sc.parallelize(List(5, 6, 14, 7, 3, 8, 2, 9, 1, 10))

//对rdd1里的每一个元素乘2然后排序

val rdd2 = rdd1.map(_ * 2).sortBy(x => x, true)

rdd1.collect

res0: Array[Int] = Array(2, 4, 6, 10, 12, 14, 16, 18, 20, 28)

//过滤出大于等于十的元素

val rdd3 = rdd2.filter(_ >= 10)

//将元素以数组的方式在客户端显示

rdd2.collect

res1: Array[Int] = Array(10, 12, 14, 16, 18, 20, 28)

练习二:将字符数组里面的每一个元素先切分在压平。

val rdd1 = sc.parallelize(Array("a b c", "d e f", "h i j"))

//将rdd1里面的每一个元素先切分在压平

val rdd2 = rdd1.flatMap(_.split(' '))

rdd1.collect

res2: Array[String] = Array(a, b, c, d, e, f, h, i, j)

练习三:求两个列表中的交集、并集、及去重后的结果

val rdd1 = sc.parallelize(List(5, 6, 4, 3))

val rdd2 = sc.parallelize(List(1, 2, 3, 4))

//求并集

val rdd3 = rdd1.union(rdd2)

rdd3.collect

res3: Array[Int] = Array(5, 6, 4, 3, 1, 2, 3, 4)

//去重

rdd3.distinct.collect

res5: Array[Int] = Array(4, 6, 2, 1, 3, 5)

//求交集

val rdd4 = rdd1.intersection(rdd2)

rdd4.collect

res4: Array[Int] = Array(4, 3)

练习四:对List列表中的kv对进行join与union操作

val rdd1 = sc.parallelize(List(("tom", 1), ("jerry", 3), ("kitty", 2)))

val rdd2 = sc.parallelize(List(("jerry", 2), ("tom", 1), ("shuke", 2)))

//求jion

val rdd3 = rdd1.join(rdd2)

rdd3.collect

res0: Array[(String, (Int, Int))] = Array((tom,(1,1)), (jerry,(3,2)))

//求并集

val rdd4 = rdd1 union rdd2

rdd4.collect

res1: Array[(String, Int)] = Array((tom,1), (jerry,3), (kitty,2), (jerry,2), (tom,1), (shuke,2))

//按key进行分组

val rdd5 = rdd4.groupByKey

rdd5.collect

res5: Array[(String, Iterable[Int])] =

Array((tom,CompactBuffer(1, 1)),

(jerry,CompactBuffer(3, 2)),

(shuke,CompactBuffer(2)),

(kitty,CompactBuffer(2)))

练习五:cogroup与groupByKey的区别

val rdd1 = sc.parallelize(List(("tom", 1), ("tom", 2), ("jerry", 3), ("kitty", 2)))

val rdd2 = sc.parallelize(List(("jerry", 2), ("tom", 1), ("shuke", 2)))

//cogroup

val rdd3 = rdd1.cogroup(rdd2)

//注意cogroup与groupByKey的区别

rdd3.collect

res0: Array[(String, (Iterable[Int], Iterable[Int]))] =

Array((tom,(CompactBuffer(1, 2),CompactBuffer(1))),

(jerry,(CompactBuffer(3),CompactBuffer(2))),

(shuke,(CompactBuffer(),CompactBuffer(2))),

(kitty,(CompactBuffer(2),CompactBuffer())))

//可看出groupByKey中对于每个key只有一个CompactBuffer(2),且CompactBuffer括号内的数值进行了合并成了列表

//而对于cogroup有多少个key就有几个CompactBuffer,且CompactBuffer括号内的数值就是原来的value

练习六:reduce聚合操作

val rdd1 = sc.parallelize(List(1, 2, 3, 4, 5))

//reduce聚合

val rdd2 = rdd1.reduce(_ + _)

rdd2: Int = 15

练习七:对List的kv对进行合并后聚合及排序

val rdd1 = sc.parallelize(List(("tom", 1), ("jerry", 3), ("kitty", 2), ("shuke", 1)))

val rdd2 = sc.parallelize(List(("jerry", 2), ("tom", 3), ("shuke", 2), ("kitty", 5)))

val rdd3 = rdd1.union(rdd2)

rdd3.collect

res5: Array[(String, Int)] = Array((tom,1), (jerry,3), (kitty,2), (shuke,1), (jerry,2), (tom,3), (shuke,2), (kitty,5))

//按key进行聚合

val rdd4 = rdd3.reduceByKey(_ + _)

rdd4.collect

res6: Array[(String, Int)] = Array((tom,4), (jerry,5), (shuke,3), (kitty,7))

//按value的降序排序

val rdd5 = rdd4.map(t => (t._2, t._1)).sortByKey(false).map(t => (t._2, t._1))

rdd5.collect

res9: Array[(String, Int)] = Array((kitty,7), (jerry,5), (tom,4), (shuke,3))

//第一个map进行kv调换,然后sortByKey(false)降序排序,之后再一次map对kv调换回来

二、Spark RDD的高级算子

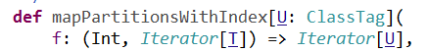

1、mapPartitionsWithIndex

接收一个函数参数:

- 第一个参数:分区号

- 第二个参数:分区中的元素

//创建一个函数返回RDD中的每个分区号和元素:

val rdd1 = sc.parallelize(List(1,2,3,4,5,6,7,8,9), 2)

def func1(index:Int, iter:Iterator[Int]):Iterator[String] ={

iter.toList.map( x => "[PartID:" + index + ", value=" + x + "]" ).iterator

}

//调用:

rdd1.mapPartitionsWithIndex(func1).collect

res2: Array[String] =

Array([PartID:0, value=1], [PartID:0, value=2], [PartID:0, value=3],

[PartID:0, value=4], [PartID:1, value=5], [PartID:1, value=6],

[PartID:1, value=7], [PartID:1, value=8], [PartID:1, value=9])

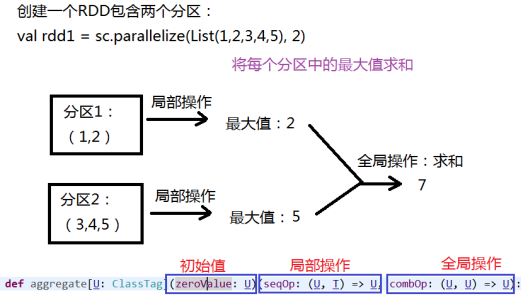

2、aggregate

先对局部聚合,再对全局聚合

- 查看每个分区中的元素:

//创建一个函数返回RDD中的每个分区号和元素:

val rdd1 = sc.parallelize(List(1,2,3,4,5,6,7,8,9), 2)

def func1(index:Int, iter:Iterator[Int]):Iterator[String] ={

iter.toList.map( x => "[PartID:" + index + ", value=" + x + "]" ).iterator

}

//调用:

rdd1.mapPartitionsWithIndex(func1).collect

res2: Array[String] =

Array([PartID:0, value=1], [PartID:0, value=2], [PartID:0, value=3],

[PartID:0, value=4], [PartID:1, value=5], [PartID:1, value=6],

[PartID:1, value=7], [PartID:1, value=8], [PartID:1, value=9])

//将每个分区中的最大值求和(注意:初始值是0):

rdd1.aggregate(0)(math.max(_,_),_+_)

res3: Int = 7

//如果初始值时候10,则结果为:30。

rdd1.aggregate(10)(math.max(_,_),_+_)

res4: Int = 30

//如果是求和,注意:初始值是0:

scala> rdd1.aggregate(0)(_+_,_+_)

res5: Int = 15

//如果初始值是10,则结果是:45

scala> rdd1.aggregate(10)(_+_,_+_)

res6: Int = 45

- 一个字符串的例子:

val rdd2 = sc.parallelize(List("a","b","c","d","e","f"),2)

//修改一下刚才的查看分区元素的函数

scala> def func2(index:Int, iter:Iterator[(String)]):Iterator[String]=

{iter.toList.map(x=>"partID:" + index + ",val:" + x + "]").iterator}

//两个分区中的元素:

scala> rdd2.mapPartitionsWithIndex(func2).collect

res7: Array[String] = Array(partID:0,val:a], partID:0,val:b], partID:0,val:c], partID:1,val:d], partID:1,val:e], partID:1,val:f])

//运行结果:

scala> rdd2.aggregate("")(_+_,_+_)

res1: String = abcdef

scala> rdd2.aggregate("|")(_+_,_+_)

res2: String = ||abc|def

- 更复杂一点的例子

scala> val rdd3 = sc.parallelize(List("12","23","345","4567"),2)

//最后是x+y

scala> rdd3.aggregate("")((x,y)=>math.max(x.length,y.length).toString,(x,y)=>x+y)

res5: String = 24

//最后是y+x

scala> rdd3.aggregate("")((x,y)=>math.max(x.length,y.length).toString,(x,y)=>y+x)

res13: String = 42

val rdd4 = sc.parallelize(List("12","23","345",""),2)

//最后是x+y

scala> rdd4.aggregate("")((x,y) => math.min(x.length,y.length).toString,(x,y)=>x+y)

res17: String = 10

//最后是y+x

scala> rdd4.aggregate("")((x,y) => math.min(x.length,y.length).toString,(x,y)=>y+x)

res18: String = 01

spark之RDD练习的更多相关文章

- [Spark] Spark的RDD编程

本篇博客中的操作都在 ./bin/pyspark 中执行. RDD,即弹性分布式数据集(Resilient Distributed Dataset),是Spark对数据的核心抽象.RDD是分布式元素的 ...

- Spark核心—RDD初探

本文目的 最近在使用Spark进行数据清理的相关工作,初次使用Spark时,遇到了一些挑(da)战(ken).感觉需要记录点什么,才对得起自己.下面的内容主要是关于Spark核心-RDD的相关 ...

- 关于Spark中RDD的设计的一些分析

RDD, Resilient Distributed Dataset,弹性分布式数据集, 是Spark的核心概念. 对于RDD的原理性的知识,可以参阅Resilient Distributed Dat ...

- [Spark][Python][RDD][DataFrame]从 RDD 构造 DataFrame 例子

[Spark][Python][RDD][DataFrame]从 RDD 构造 DataFrame 例子 from pyspark.sql.types import * schema = Struct ...

- spark中RDD的转化操作和行动操作

本文主要是讲解spark里RDD的基础操作.RDD是spark特有的数据模型,谈到RDD就会提到什么弹性分布式数据集,什么有向无环图,本文暂时不去展开这些高深概念,在阅读本文时候,大家可以就把RDD当 ...

- Spark核心RDD、什么是RDD、RDD的属性、创建RDD、RDD的依赖以及缓存、

1:什么是Spark的RDD??? RDD(Resilient Distributed Dataset)叫做弹性分布式数据集,是Spark中最基本的数据抽象,它代表一个不可变.可分区.里面的元素可并行 ...

- [转]Spark学习之路 (三)Spark之RDD

Spark学习之路 (三)Spark之RDD https://www.cnblogs.com/qingyunzong/p/8899715.html 目录 一.RDD的概述 1.1 什么是RDD? ...

- Spark学习之路 (三)Spark之RDD

一.RDD的概述 1.1 什么是RDD? RDD(Resilient Distributed Dataset)叫做弹性分布式数据集,是Spark中最基本的数据抽象,它代表一个不可变.可分区.里面的元素 ...

- Spark之 RDD

简介 RDD(Resilient Distributed Dataset)叫做弹性分布式数据集,是Spark中最基本的数据抽象,它代表一个不可变.可分区.里面的元素可并行计算的集合. Resilien ...

- 解读Spark Streaming RDD的全生命周期

本节主要内容: 一.DStream与RDD关系的彻底的研究 二.StreamingRDD的生成彻底研究 Spark Streaming RDD思考三个关键的问题: RDD本身是基本对象,根据一定时间定 ...

随机推荐

- 基于MATLAB的单级倒立摆仿真

有关代码及word文档请关注公众号“浮光倾云”,后台回复A010.02即可获取 一.单级倒立摆概述 倒立摆是处于倒置不稳定状态,人为控制使其处于动态平衡的一种摆,是一类典型的快速.多变量.非线性.强耦 ...

- django的自定义权限

最近在写发布系统,涉及到权限的控制 参考 黄小墨同学的博客实现了 如下 1:定义一张权限控制的表 [root@localhost app01]# tailf -25 models.py class P ...

- Python应用——自定义排序全套方案

本文始发于个人公众号:TechFlow,原创不易,求个关注 今天的这篇文章和大家聊聊Python当中的排序,和很多高级语言一样,Python封装了成熟的排序函数.我们只需要调用内部的sort函数,就可 ...

- codewars--js--Happy numbers++无穷大判断

问题描述: A happy number is a number defined by the following process: starting with any positive intege ...

- [Wpf学习] 2.代码导入Xaml

废话不说,直接上代码 using System.ComponentModel; using System.Runtime.CompilerServices; using System.Windows; ...

- 关于使用kms时遇到的there is nothing to do here

我讲一下我自己的解决方法 ------------------------------------ 这个错误还是很明显的,没事干,如果不是kms的锅的话,那么就是字面上的问题了 ----------- ...

- 原创:mysql5 还原至mysql 8.0.11数据库链接配置提示错误(修改内容有三处

原创:mysql5 还原至mysql 8.0.11数据库链接配置提示错误改有三: a) mysql 连接jar包版修改 b)类路径修改 c)配置连接池地址修改 因版本升级,首先要修改 1:mysql- ...

- JSP其余内置对象及四大范围对象的使用

一.application String getContextPath():获取虚拟路径String getRealPath():获取虚拟路径对应的绝对路径 实例 application.jsp &l ...

- C#设计模式学习笔记:(8)装饰模式

本笔记摘抄自:https://www.cnblogs.com/PatrickLiu/p/7723225.html,记录一下学习过程以备后续查用. 一.引言 今天我们要讲结构型设计模式的第三个模式--装 ...

- VMvare桥接网络连接不上解决办法

记一次学习中的突发状况.由于本人的pc时长要在不同的网络中进行切换,ip地址一般都是不固定的,所以我使用虚拟机的时候一般使用的都是让VMvare自动识别网络环境.直到今天遇到一种突发情况,VMvare ...