[Bayesian] “我是bayesian我怕谁”系列 - Boltzmann Distribution

使用Boltzmann distribution还是Gibbs distribution作为题目纠结了一阵子,选择前者可能只是因为听起来“高大上”一些。本章将会聊一些关于信息、能量这方面的东西,体会“交叉学科”的魅力。

In statistical mechanics and mathematics, a Boltzmann distribution (also called Gibbs distribution) is a probability distribution, probability measure, or frequency distribution of particles in a system over various possible states.

Hi 菜鸡,

神经网络的Boltzmann Machine;

期望传播中提及的Ising model;

强化学习中涉及的训练收敛问题;

够了么?问问自己有没有必要了解?

本系列文章乃自娱自乐,防止衰老;只“雪中送炭”,不提供”全套服务“。

Softmax与分子运动学

一个用于描述稳态系统的内部粒子状态的分布:

任何(宏观)物理系统的温度都是组成该系统的分子和原子的运动的结果。

对于大量粒子来说,处于一个特定的速度范围的粒子所占的比例却几乎不变,如果系统处于或接近处于平衡。---- 分布的期望是”稳定的“,是不是这么个感觉

麦克斯韦-玻尔兹曼分布具体说明了这个比例。

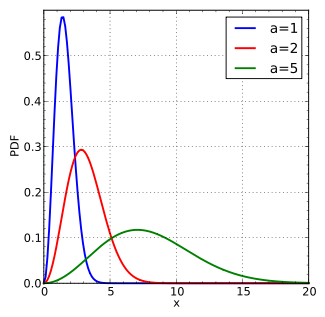

既然是个分布,概率密度函数的样子是:

百度百科:click me

写到这里,内心是湿润的,远古时期的物理奥赛底子竟然到今天还发挥着余热,啊哈哈哈哈哈……

Ni是单粒子微观状态i中的平均粒子数,

N是系统中的粒子总数,

Ei是microstate i的能量,

T是系统的平衡温度,

k是波尔兹曼常数。

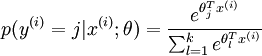

再瞧:Softmax回归

可能你只是看到了”e族函数处处可导“的性质,想到了”归一化“这样的概念,但在另一个层次,有人可能会这样理解:

“神经网络Softmax的公式形式是分子运动学的热能公式的变种,output对应了能量输出,分类的物理意义对应的就是不同能量层级的分子的个数比,也就是成为某类的概率比。如此看来,NN的各个权值的意义,原来就是能量值。NN的收敛,就是能量的分配,系统entropy最大的过程。”

这,又是一个如同pca章节讲述的故事,是否点醒了菜鸡。

Cross Entropy与KL Divergence

Cross Entropy是求loss的一种方式,对于菜鸡起初难以理解,毕竟另一个“最小二乘”的loss计算方式理解起来会简单的多。

表面美,不一定内在美。

Cross Entropy的依据显然是信息论。

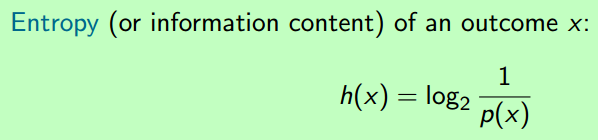

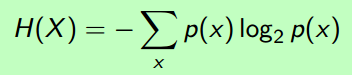

(1) X=x时的Entropy :

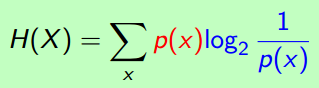

(2) 变量X的Entropy (the average amount of information) :

形式好看了些。

(3) 举个栗子

0-1离散分布,0的概率是θ,1的概率是(1 − θ),那么:

H(X) = −θ log θ − (1 − θ) log(1 − θ)

可见,当θ=0.5时,这样的变量X才拥有最大H。

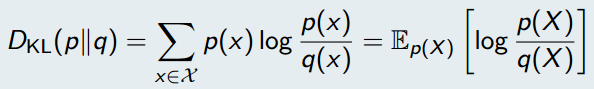

基础概念过后,有请Cross Entropy的姐姐Relative Entropy:

原来Relative Entropy就是Kullback-Leibler (KL) divergence。

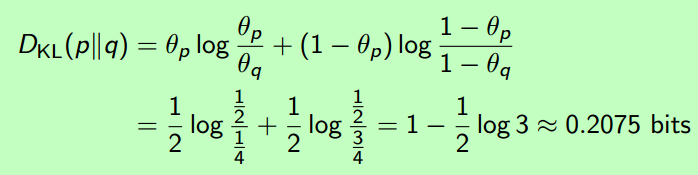

举个栗子:两个参数不同的0-1分布的度量,如下:

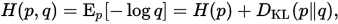

(4) 那么,Cross Entropy又是什么?

可以看出,交叉熵与相对熵仅相差了H(p)

当p已知时,可以把H(p)看做一个常数,此时交叉熵与KL距离在行为上是等价的,都反映了分布p,q的相似程度。

也就是说,收敛的过程就是逐渐接近ground truth分布的过程。

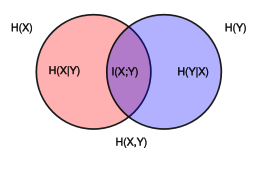

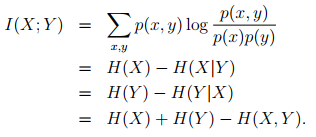

Entropy与Mutual Information

From: http://www.ece.tufts.edu/ee/194NIT/lect01.pdf

The mutual information between two discreet random variables X, Y jointly distributed according to p(x, y) is given by :

表示两个变量之间的依赖关系。

知道这个东西做什么?一点浅显的见解:能量是一种宏观的体现,信息往往也是如此,如何度量是个问题,这至少给你提供了一套度量方法。

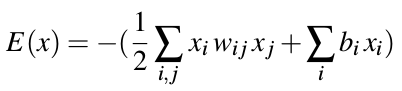

Hopfield Nets与非线性动力学

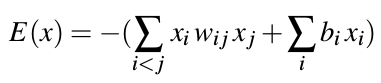

主要是看中了其中所涉及的能量公式,一起来个赏析。

信息存储的原理、例子见此链接:https://wenku.baidu.com/view/ef6e6fbec77da26925c5b0af.html

有点马尔科夫迭代收敛到稳态的感觉。

网络的稳定性度量。

为何将能量函数定义为如此形式?如下解答,一种“仿生学”。

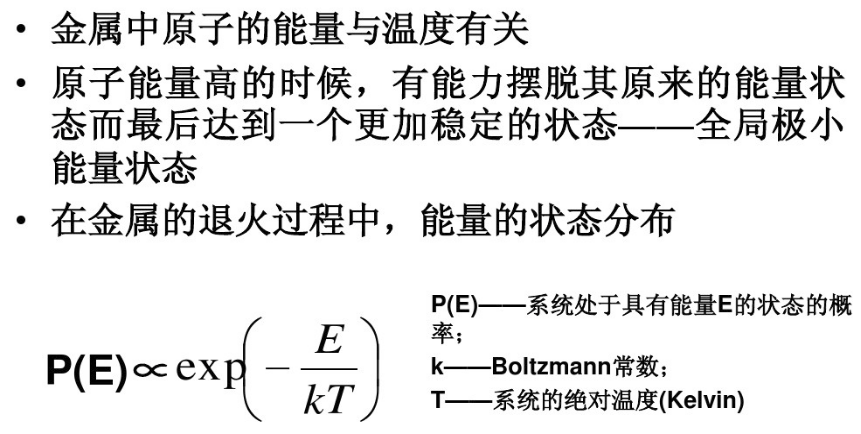

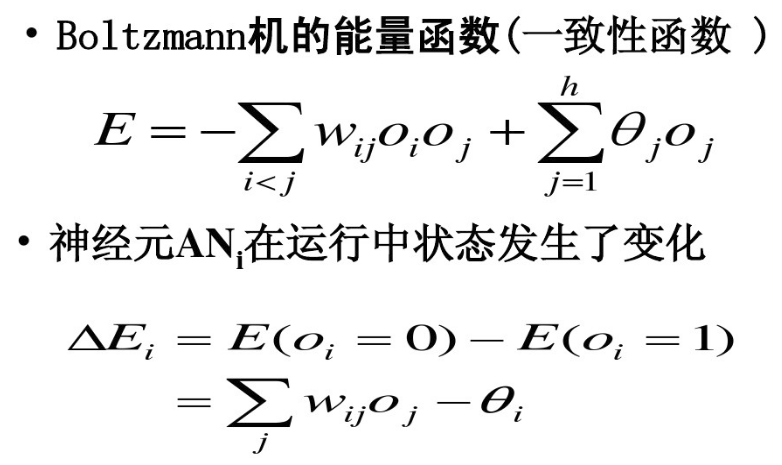

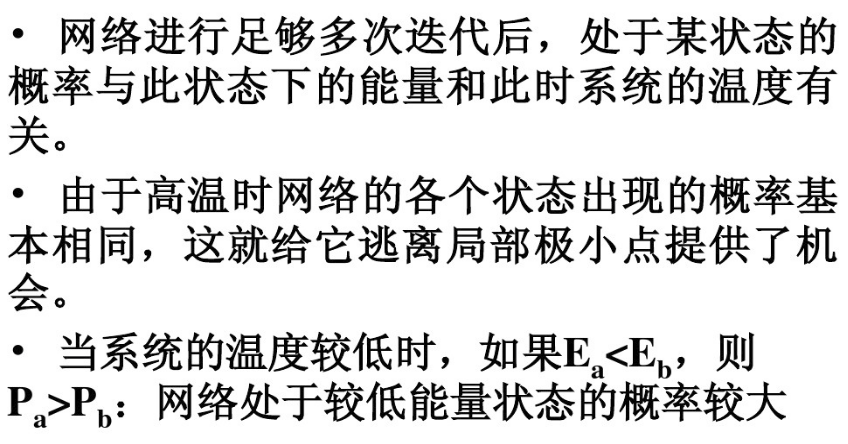

Boltzmann Machine与模拟退火

Ref:最通俗的方法解释退火算法

这里有一个Bolzmann常数。

能量的变化作为什么角色?

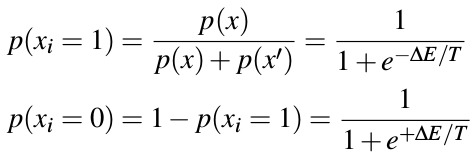

可见,求的是:Oi = 1的概率,也就是Pa的概率。

Therefore, if all other components are fixed, the probability of xi taking the value 1 or 0 must be:

In other words, there is some probability of moving to a higher energy state (or remaining in a higher energy state even when a lower one is available).

可见,具备了模拟退火的feature,为了防止局部极小值,也可能以一定的概率走一奇招!这个概率就与当前的能量大小有关!

Restricted Boltzmann Machine

The aim is that the hidden units should learn some hidden features or “latent variables” which help the system to model the distribution of the inputs.

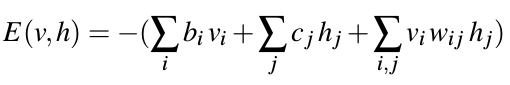

Two-layer bi-directional neural network,新的能量公式:

关于训练的具体细节,可参见:http://www.cnblogs.com/neopenx/p/4399336.html

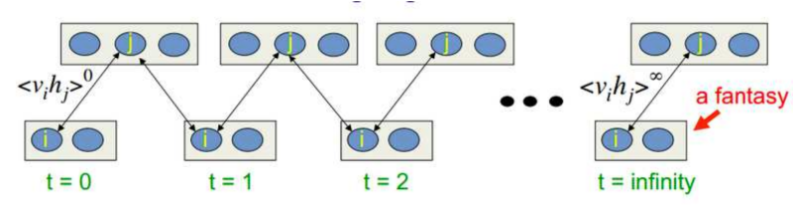

但下图所示,训练的基本过程,Gibbs sampling。

到这里,便终于揭示出本文开头提及的一个真相:Boltzmann为何与Gibbs有了关系。

关于能量,总结套路于此:

”由能量决定概率分布,根据概率分布随机变换神经元的状态,直到收敛,整个网络达到稳定状态。“

读完此文,也希望你对神经网络有新的认识。

[Bayesian] “我是bayesian我怕谁”系列 - Boltzmann Distribution的更多相关文章

- [Bayesian] “我是bayesian我怕谁”系列 - Gaussian Process

科班出身,贝叶斯护体,正本清源,故拿”九阳神功“自比,而非邪气十足的”九阴真经“: 现在看来,此前的八层功力都为这第九层作基础: 本系列第九篇,助/祝你早日hold住神功第九重,加入血统纯正的人工智能 ...

- [Bayesian] “我是bayesian我怕谁”系列 - Variational Autoencoders

本是neural network的内容,但偏偏有个variational打头,那就聊聊.涉及的内容可能比较杂,但终归会 end with VAE. 各个概念的详细解释请点击推荐的链接,本文只是重在理清 ...

- [Bayesian] “我是bayesian我怕谁”系列 - Exact Inferences

要整理这部分内容,一开始我是拒绝的.欣赏贝叶斯的人本就不多,这部分过后恐怕就要成为“从入门到放弃”系列. 但,这部分是基础,不管是Professor Daphne Koller,还是统计学习经典,都有 ...

- [Bayesian] “我是bayesian我怕谁”系列 - Exact Inference

要整理这部分内容,一开始我是拒绝的.欣赏贝叶斯的人本就不多,这部分过后恐怕就要成为“从入门到放弃”系列. 但,这部分是基础,不管是Professor Daphne Koller,还是统计学习经典,都有 ...

- [Bayesian] “我是bayesian我怕谁”系列 - Naive Bayes+prior

先明确一些潜规则: 机器学习是个collection or set of models,一切实践性强的模型都会被归纳到这个领域,没有严格的定义,’有用‘可能就是唯一的共性. 机器学习大概分为三个领域: ...

- [Bayesian] “我是bayesian我怕谁”系列 - Variational Inference

涉及的领域可能有些生僻,骗不了大家点赞.但毕竟是人工智能的主流技术,在园子却成了非主流. 不可否认的是:乃值钱的技术,提高身价的技术,改变世界观的技术. 关于变分,通常的课本思路是: GMM --&g ...

- [Bayesian] “我是bayesian我怕谁”系列 - Naive Bayes with Prior

先明确一些潜规则: 机器学习是个collection or set of models,一切实践性强的模型都会被归纳到这个领域,没有严格的定义,’有用‘可能就是唯一的共性. 机器学习大概分为三个领域: ...

- [Bayesian] “我是bayesian我怕谁”系列 - Continuous Latent Variables

打开prml and mlapp发现这部分目录编排有点小不同,但神奇的是章节序号竟然都为“十二”. prml:pca --> ppca --> fa mlapp:fa --> pca ...

- [Bayesian] “我是bayesian我怕谁”系列 - Markov and Hidden Markov Models

循序渐进的学习步骤是: Markov Chain --> Hidden Markov Chain --> Kalman Filter --> Particle Filter Mark ...

随机推荐

- Windows 编程中恼人的各种字符以及字符指针类型

在Windows编程中,很容易见到这些数据类型:LPSTR,LPTSTR,LPCTSTR... 像很多童鞋一样,当初在学Windows编程的时候,对着些数据类型真的是丈二和尚,摸不着头脑,长时间不用就 ...

- mybatis运行时错误Illegal argument exception argument type mismatch

使用注解时遇到该错误 使用XML应该也会有相应的错误 解决办法:查看是不是Dao接口的参数列表没有加@Param注解 参数过多时需要该注解指明参数

- PE文件格式详解,第二讲,NT头文件格式,以及文件头格式

PE文件格式详解,第二讲,NT头文件格式,以及文件头格式 作者:IBinary出处:http://www.cnblogs.com/iBinary/版权所有,欢迎保留原文链接进行转载:) PS:本篇博客 ...

- Python实战之实现简单的购物车系统

#!usr/bin/env Python3 # -*-coding:utf-8-*- # 程序:购物车程序 # # 需求: # # 启动程序后,让用户输入工资,然后打印商品列表 # 允许用户根据商品编 ...

- 【转】Python中实现远程调用(RPC、RMI)简单例子

远程调用使得调用远程服务器的对象.方法的方式就和调用本地对象.方法的方式差不多,因为我们通过网络编程把这些都隐藏起来了.远程调用是分布式系统的基础. 远程调用一般分为两种,远程过程调用(RPC)和远程 ...

- cocos2dx - 在MFC中使用cocos2dx

本节主要讲一下如何在MFC窗口中使用cocos2dx 在做比较复杂的游戏,有时需要通过一些工具来编辑生成关卡或者特效,技能等的配置文件.为了方便配置,需要可以通过修改参数直观得到显示的效果.这就需要将 ...

- cocos2dx - 伤害实现

接上一节内容:cocos2dx - 生成怪物及AI 本节主要讲如何通过创建简单的矩形区域来造成伤害 在小游戏中简单的碰撞需求应用box2d等引擎会显得过于臃肿复杂,且功能不是根据需求定制,还要封装,为 ...

- iOS多线程基本使用

大家都知道,在开发过程中应该尽可能减少用户等待时间,让程序尽可能快的完成运算.可是无论是哪种语言开发的程序最终往往转换成汇编语言进而解释成机器码来执行.但是机器码是按顺序执行的,一个复杂的多步操作只能 ...

- 【转载】CSS3的calc()使用

文章转载自 w3cplus http://www.w3cplus.com/ 原文链接:http://www.w3cplus.com/css3/how-to-use-css3-calc-function ...

- 压缩感知“Hello World”代码初步学习

压缩感知代码初学 实现:1-D信号压缩传感的实现 算法:正交匹配追踪法OMP(Orthogonal Matching Pursuit) >几个初学问题 1. 原始信号f是什么?我采集的是 ...