【爬虫】Python2 爬虫初学笔记

爬虫,个人理解就是:利用模拟“操作浏览器”的过程,自动获取我们想要的数据(或者说信息,比如图片啊)

为何要学爬虫:爬取数据,为我所用(相当于可以把一类数据整合起来)

一.简单静态网页爬虫架构:

1.Background Knowledge:URL(统一资源定位符,能帮助我们定位到网页在网络中的位置,URI 是统一资源标志符),HTTP协议

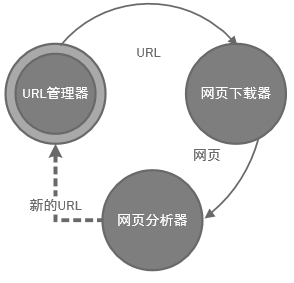

2.构架:

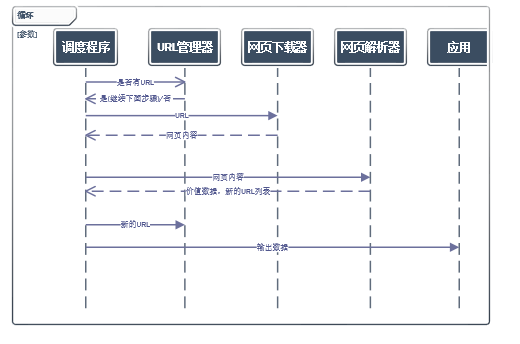

需要一个爬虫调度器管理下面的程序,涉及多线程管理等(比如说申请网页的阻塞时间可以用来建立新的申请,这些资源分配由操作系统完成)

URL管理器,防止URL重复使用,获取URL,未爬取和已爬取的管理

3.工作流程:

4.URL管理器实现方式:

a.存储在内存(set)

b.关系数据库(可永久保存)

c.缓存数据库(大部分公司使用这种方式)

5.网页下载器:

以HTML形式保存网页,可以使用urllib和urllib2实现下载

实现方法:

a.简单的使用urllib2.open(url)

b.添加Request方法,发送包头,伪装成浏览器

c.添加cookiejar cookie 容器

# coding=utf-8

import urllib2

import cookielib

url = "http://www.baidu.com"

print '方法1'

#请确保url 的合法性

response1 = urllib2.urlopen(url)

if response1.getcode()==200:

print ' 读取网页成功'

print ' Length:',

print len(response1.read())

else:

print ' 读取网页失败' print 'Method2:'

request = urllib2.Request(url)

request.add_header("usr_agent","Mozilla/6.0")

response2 = urllib2.urlopen(request)

if response2.getcode()==200:

print ' 读取网页成功'

print ' Length:',

print len(response2.read())

else:

print ' 读取网页失败' print 'Method3:'

cj = cookielib.CookieJar()

opener = urllib2.build_opener(urllib2.HTTPCookieProcessor(cj))

urllib2.install_opener(opener)

response3 = urllib2.urlopen(url)

if response3.getcode()==200:

print ' 读取网页成功'

print ' Length:',

print len(response3.read())

print cj

print response3.read()

else:

print ' 读取网页失败'

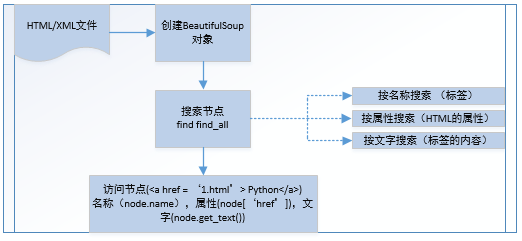

6.网页解析器:

以下载好的HTML当成字符串,查找出

1.正则表达式匹配

2.html.parser

3.lxml解析器

4.BeautifulSoup

以DOM(Document Object Model) 结构化解析,下面是其语法

# coding=utf-8

import re from bs4 import BeautifulSoup

html_doc = """

<html><head><title>The Dormouse's story</title></head>

<body>

<p class="title"><b>The Dormouse's story</b></p> <p class="story">Once upon a time there were three little sisters; and their names were

<a href="http://example.com/elsie" class="sister" id="link1">Elsie</a>,

<a href="http://example.com/lacied" class="sister" id="link2">Lacie</a> and

<a href="http://example.com/tillie" class="sister" id="link3">Tillie</a>;

and they lived at the bottom of a well.</p> <p class="story">...</p>

"""

#创建

ccsSoup = BeautifulSoup(html_doc,'html.parser',from_encoding='utf8')

#获取所有链接

links= ccsSoup.find_all('a')

for link in links:

print link.name,link['href'],link.get_text()

print ccsSoup.p('class') print '正则匹配'

link_node = ccsSoup.find('a',href= re.compile(r"h"),class_='sister')

print link_node

link_node = ccsSoup.find('a',href= re.compile(r"d"))

print link_node

5.调度程序

参考:

http://www.imooc.com/video/10686

https://www.crummy.com/software/BeautifulSoup/bs4/doc/index.zh.html

正则表达式:

http://www.cnblogs.com/huxi/archive/2010/07/04/1771073.html

PyCharm:使用教程

http://blog.csdn.net/pipisorry/article/details/39909057

【爬虫】Python2 爬虫初学笔记的更多相关文章

- python3爬虫--反爬虫应对机制

python3爬虫--反爬虫应对机制 内容来源于: Python3网络爬虫开发实战: 网络爬虫教程(python2): 前言: 反爬虫更多是一种攻防战,针对网站的反爬虫处理来采取对应的应对机制,一般需 ...

- Python 爬虫1——爬虫简述

Python除了可以用来开发Python Web之后,其实还可以用来编写一些爬虫小工具,可能还有人不知道什么是爬虫的. 一.爬虫的定义: 爬虫——网络爬虫(又被称为网页蜘蛛,网络机器人,在FOAF社区 ...

- C++ STL初学笔记

C++ STL初学笔记 更系统的版本见徐本柱的PPT set 在这儿:http://www.cnblogs.com/pdev/p/4035020.html #include <vector&g ...

- 【java爬虫】---爬虫+基于接口的网络爬虫

爬虫+基于接口的网络爬虫 上一篇讲了[java爬虫]---爬虫+jsoup轻松爬博客,该方式有个很大的局限性,就是你通过jsoup爬虫只适合爬静态网页,所以只能爬当前页面的所有新闻.如果需要爬一个网站 ...

- Spring 初学笔记

Spring 初学笔记: https://blog.csdn.net/weixin_35909255/article/category/7470388

- [爬虫]Python爬虫基础

一.什么是爬虫,爬虫能做什么 爬虫,即网络爬虫,大家可以理解为在网络上爬行的一直蜘蛛,互联网就比作一张大网,而爬虫便是在这张网上爬来爬去的蜘蛛咯,如果它遇到资源,那么它就会抓取下来.比如它在抓取一个网 ...

- (Pyhton爬虫03)爬虫初识

原本的想法是这样的:博客整理知识学习的同时,也记录点心情...集中式学习就没这么多好记录的了! 要学习一门技术,首先要简单认识一下爬虫!其实可以参考爬虫第一章! 整体上介绍该技术包含技能,具体能做什么 ...

- laravel 5.6初学笔记

laravel 5.6初学笔记 http://note.youdao.com/noteshare?id=bf4b701b49dd035564e7145ba2d978b4 框架简介 laravel文档齐 ...

- csapp网络编程初学笔记

csapp网络编程初学笔记 客户端-服务器编程模型 每个网络应用都是基于客户端-服务器模型,服务器管理某种资源,并且通过操作来为它的客户提供某种服务 客户端-服务器模型中的基本操作是transacti ...

- PYTHON爬虫实战_垃圾佬闲鱼爬虫转转爬虫数据整合自用二手急速响应捡垃圾平台_3(附源码持续更新)

说明 文章首发于HURUWO的博客小站,本平台做同步备份发布. 如有浏览或访问异常图片加载失败或者相关疑问可前往原博客下评论浏览. 原文链接 PYTHON爬虫实战_垃圾佬闲鱼爬虫转转爬虫数据整合自用二 ...

随机推荐

- CSS基础总结

CSS基础总结链接地址:http://segmentfault.com/a/1190000002773955

- 五大主流浏览器 CSS3 和 HTML5 兼容性大比拼

各大主流浏览器对 CSS3 和 HTML5 的支持越来越完善,曾经让多少前端开发人员心碎的IE系也开始拥抱标准.就在前几天,W3C的 HTML5 社区领袖 Shelley 宣布,HTML5的开发工作已 ...

- FTP下载文件失败

这几天的定时任务下载文件的脚本失败了. 于是手工执行测试,发现报550 Permission denied. Passive mode refused. 意思就是被动模式下,没有权限获取文件. 解决方 ...

- jquery load 和 iframe 比较

如果要加载的东西比较简单,里面的没有复杂的数据和逻辑,可以使用load.如果要加载的页面自身有复杂的逻辑.操作,还是建议使用ifame,因为iframe里面可以引入自身的js和样式,而load引入的东 ...

- I18n问题 国际化

http://www.cnblogs.com/guaniu/archive/2012/01/18/2325556.html java国际化 1.了解缺省Locale是由操作系统决定的,Locale是由 ...

- bzoj4691: Let There Be Light

如果原点能被一个光源照到,那么这两个点之间一定没有任何球.我们可以通过三分距离来确定某线段和球是否有交点. 注意到m非常小,于是我们可以枚举原点被哪些光源照到.由于\(O(2^{n}*m)\)会超时, ...

- 学习 opencv---(7) 线性邻域滤波专场:方框滤波,均值滤波,高斯滤波

本篇文章中,我们一起仔细探讨了OpenCV图像处理技术中比较热门的图像滤波操作.图像滤波系列文章浅墨准备花两次更新的时间来讲,此为上篇,为大家剖析了"方框滤波","均值滤 ...

- Linux下的压缩和解压缩命令——zip/unzip

zip命令 zip是个使用广泛的压缩程序,文件经它压缩后会另外产生具有".zip"扩展名 的压缩文件. 选项: -A 调整可执行的自动解压缩文件. -b<工作目录> ...

- matlab更改打开时候默认路径

每次打开matlab都会的修改默认路径,是一件有些烦恼的事情.所以,就想尝试更改默认路径 方法如下: 1.在matlab安装目录,找到toolbox文件夹,打开local文件件,打开matlabrc. ...

- PHP之打开文件

今天在看<PHP与MySQL程序设计(第四版)>(ISBN: 9787115253521)的时候,183页,如下图: 尝试:$file = fopen("F:\Books\投行笔 ...