增强学习--Sarsa算法

import numpy as np

import random

from collections import defaultdict

from environment import Env # SARSA agent learns every time step from the sample <s, a, r, s', a'>

class SARSAgent:

def __init__(self, actions):

self.actions = actions

self.learning_rate = 0.01

self.discount_factor = 0.9

self.epsilon = 0.1

self.q_table = defaultdict(lambda: [0.0, 0.0, 0.0, 0.0])#动作值函数表,q表,要更新的表,不同于mc的更新v表 # with sample <s, a, r, s', a'>, learns new q function

def learn(self, state, action, reward, next_state, next_action):

current_q = self.q_table[state][action]

next_state_q = self.q_table[next_state][next_action]

new_q = (current_q + self.learning_rate *

(reward + self.discount_factor * next_state_q - current_q))#q表更新公式

self.q_table[state][action] = new_q # get action for the state according to the q function table

# agent pick action of epsilon-greedy policy

def get_action(self, state):#获取下一步动作

#epsilon-greedy policy,exploration

if np.random.rand() < self.epsilon:

# take random action

action = np.random.choice(self.actions)

else:

# take action according to the q function table

state_action = self.q_table[state]

action = self.arg_max(state_action)

return action @staticmethod

def arg_max(state_action):

max_index_list = []

max_value = state_action[0]

for index, value in enumerate(state_action):

if value > max_value:

max_index_list.clear()

max_value = value

max_index_list.append(index)

elif value == max_value:

max_index_list.append(index)

return random.choice(max_index_list) if __name__ == "__main__":

env = Env()

agent = SARSAgent(actions=list(range(env.n_actions))) for episode in range(1000):

# reset environment and initialize state state = env.reset()

# get action of state from agent

action = agent.get_action(str(state)) while True:

env.render() # take action and proceed one step in the environment

next_state, reward, done = env.step(action)

next_action = agent.get_action(str(next_state)) # with sample <s,a,r,s',a'>, agent learns new q function

agent.learn(str(state), action, reward, str(next_state), next_action) state = next_state

action = next_action # print q function of all states at screen

env.print_value_all(agent.q_table) # if episode ends, then break

if done:

break

增强学习--Sarsa算法的更多相关文章

- 增强学习贪心算法与Softmax算法

(一) 这个算法是基于一个概率来对探索和利用进行折中:每次尝试时,以概率进行探索,即以均匀概率随机选取一个摇臂,以的概率进行利用,即以这个概率选择当前平均奖赏最高的摇臂(如有多个,则随机选取). 其中 ...

- 增强学习--TRPO算法

理论部分参考 推导 数学上的分析 代码

- 马里奥AI实现方式探索 ——神经网络+增强学习

[TOC] 马里奥AI实现方式探索 --神经网络+增强学习 儿时我们都曾有过一个经典游戏的体验,就是马里奥(顶蘑菇^v^),这次里约奥运会闭幕式,日本作为2020年东京奥运会的东道主,安倍最后也已经典 ...

- 增强学习(五)----- 时间差分学习(Q learning, Sarsa learning)

接下来我们回顾一下动态规划算法(DP)和蒙特卡罗方法(MC)的特点,对于动态规划算法有如下特性: 需要环境模型,即状态转移概率\(P_{sa}\) 状态值函数的估计是自举的(bootstrapping ...

- (zhuan) 大牛讲堂 | 算法工程师入门第二期-穆黎森讲增强学习

大牛讲堂 | 算法工程师入门第二期-穆黎森讲增强学习 2017-07-13 HorizonRobotics

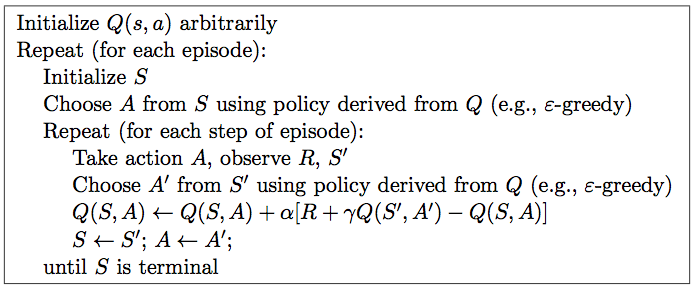

- 强化学习-学习笔记7 | Sarsa算法原理与推导

Sarsa算法 是 TD算法的一种,之前没有严谨推导过 TD 算法,这一篇就来从数学的角度推导一下 Sarsa 算法.注意,这部分属于 TD算法的延申. 7. Sarsa算法 7.1 推导 TD ta ...

- 增强学习(三)----- MDP的动态规划解法

上一篇我们已经说到了,增强学习的目的就是求解马尔可夫决策过程(MDP)的最优策略,使其在任意初始状态下,都能获得最大的Vπ值.(本文不考虑非马尔可夫环境和不完全可观测马尔可夫决策过程(POMDP)中的 ...

- 增强学习(四) ----- 蒙特卡罗方法(Monte Carlo Methods)

1. 蒙特卡罗方法的基本思想 蒙特卡罗方法又叫统计模拟方法,它使用随机数(或伪随机数)来解决计算的问题,是一类重要的数值计算方法.该方法的名字来源于世界著名的赌城蒙特卡罗,而蒙特卡罗方法正是以概率为基 ...

- 增强学习————K-摇臂赌博机

探索与利用增强学习任务的最终奖赏是在多步动作之后才能观察到,于是我们先考虑最简单的情形:最大化单步奖赏,即仅考虑一步操作.不过,就算这样,强化学习仍与监督学习有显著不同,因为机器要通过尝试来发现各个动 ...

随机推荐

- HDU1143(3*N的地板铺1*2的砖)

Tri Tiling Time Limit: 2000/1000 MS (Java/Others) Memory Limit: 65536/32768 K (Java/Others)Total ...

- kernel_read【转】

转自:http://blog.csdn.net/echoisland/article/details/7101097http://lxr.oss.org.cn/source/fs/exec.c 798 ...

- Linux C程序异常退出怎么办——core文件帮你忙

Linux C程序异常退出怎么办——core文件帮你忙 http://blog.csdn.net/zhu2695/article/details/51512138

- bp神经网络模型推导与c语言实现(转载)

转载出处:http://www.cnblogs.com/jzhlin/archive/2012/07/28/bp.html BP 神经网络中的 BP 为 Back Propagation 的简写,最 ...

- 怎样用css来美化一个html页面

# 转载请留言联系 我们都知道html写出来的东西是一个文本内容,很单调.和我们平时刷网页看到的内容不一样.那普通的网页是怎样对html超文本进行装饰的呢?没错,就是CSS. css的基本语法 选择器 ...

- python中的闭包与装饰器

#原创,转载请留言联系 装饰器的本质就是闭包,所以想知道装饰器是什么,首先要理解一下什么是闭包. 闭包 1. 外部函数返回内部函数的引用.2. 内部函数使用外部函数的变量或者参数. def outer ...

- pipreqs------查找python项目依赖并生成requirements.txt

项目开发的时候,总是要搭建和部署环境,这时,就需要一个python第三方包的list,一般叫做requirements.txt.如果项目使用virtualenv环境,直接使用pip freeze即可, ...

- 平滑部署war包到tomcat-deploy.sh

#!/bin/sh #check war exists echo "check war exists" war_file_path=/data/tomcat8/webapps wa ...

- Codeforces 651 B. Beautiful Paintings

B. Beautiful Paintings time limit per test 1 second memory limit per test 256 megabytes input stan ...

- 前端学习blog

有一些js写的小游戏,很有趣 http://oldj.net