K8s存储卷、pv和pvc的使用

emptyDIR 临时目录

hostPath :使用主机的路径

网络存储:

传统的设备存储:NAS,SAN

分布式存储:glusterfs,rbd,cephfs

云存储:EBS,Azure,阿里云的

一、emptyDir 的类型:一个pod里面2个容器,挂载同一个目录,

注意:emptyDir的生命周期同pod周期,简单来说,pod删除了,emptyDir也随之删除

apiVersion: v1

kind: Pod

metadata:

name: pod-demo

namespace: default

labels:

app: myapp

tier: frontend

spec:

containers:

- name: myapp

image: ikubernetes/myapp:v1

ports:

- name: http

containerPort: 80

volumeMounts: #容器挂载

- name: html

mountPath: /data/web/html/

- name: busybox

image: busybox:latest

command: ["/bin/sh" ,"-c","sleep 3600"]

volumeMounts: #容器挂载

- name: html

mountPath: /data/

volumes: #定义存储

- name: html

emptyDir: {}

二、hostPath 类型存储(pod删除后,hostPa存储数据仍然存在)

apiVersion: v1

kind: Pod

metadata:

name: nginx-volume

namespace: default

spec:

containers:

- name: nginx

image: nginx

ports:

- containerPort: 80

volumeMounts:

- name: html

mountPath: /usr/share/nginx/html/ #Pod内容器中被挂载的目录

volumes:

- name: html

hostPath:

path: /data/nginx/v1/ #宿主机path

type: DirectoryOrCreate

三、nfs 类型存储

首先要准备好nfs,我在172.17.1.36的机器上安装nfs,到处的目录为/nfs/data

yum install nfs-utils

vim vim /etc/exports

/nfs/data/ 172.17.0.0/16(rw,no_root_squash)

systemctl start nfs

nfs准备好了,注意,在pod的节点机器要一定确定可以挂载nfs类型的,否则创建pod会出错。执行yum install nfs-utils 就可以挂载了

nfs pod 的yaml文件:

apiVersion: v1

kind: Pod

metadata:

name: nginx-volume-nfs

namespace: default

spec:

containers:

- name: nginx-nfs

image: nginx

ports:

- containerPort: 80

volumeMounts:

- name: html

mountPath: /usr/share/nginx/html/

volumes:

- name: html

nfs:

path: /nfs/data/

server: 172.17.1.36

四、pv,pvc的使用

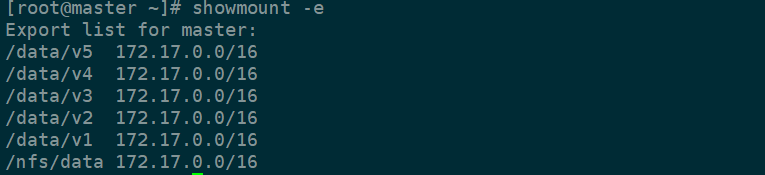

对于pv和pvc,首先要准备存储的,我用的是nfs,在172.17.1.36的节点上划分了5个路径作为存储的设备。

mkdir /data/{v1,v2,v3,v4,v5} -pv

vim /etc/exports

添加如下的内容:

/data/v1 172.17.0.0/16(rw,no_root_squash)

/data/v2 172.17.0.0/16(rw,no_root_squash)

/data/v3 172.17.0.0/16(rw,no_root_squash)

/data/v4 172.17.0.0/16(rw,no_root_squash)

/data/v5 172.17.0.0/16(rw,no_root_squash)

保存,导出下。

exportfs -avr

查看下是否正常。

nfs的存储的好了。下一步要先创建pv,yaml文件如下

apiVersion: v1

kind: PersistentVolume

metadata:

name: pv01

labels:

name: pv01

spec:

nfs:

path: /data/v1/

server: 172.17.1.36

accessModes: ["ReadWriteOnce","ReadWriteMany"]

capacity:

storage: 5Gi

---

apiVersion: v1

kind: PersistentVolume

metadata:

name: pv02

labels:

name: pv02

spec:

nfs:

path: /data/v2/

server: 172.17.1.36

accessModes: ["ReadWriteOnce","ReadWriteMany"]

capacity:

storage: 3Gi

---

apiVersion: v1

kind: PersistentVolume

metadata:

name: pv03

labels:

name: pv03

spec:

nfs:

path: /data/v3/

server: 172.17.1.36

accessModes: ["ReadWriteOnce","ReadWriteMany"]

capacity:

storage: 5Gi

---

apiVersion: v1

kind: PersistentVolume

metadata:

name: pv04

labels:

name: pv04

spec:

nfs:

path: /data/v4/

server: 172.17.1.36

accessModes: ["ReadWriteOnce","ReadWriteMany"]

capacity:

storage: 10Gi

---

apiVersion: v1

kind: PersistentVolume

metadata:

name: pv05

labels:

name: pv05

spec:

nfs:

path: /data/v5/

server: 172.17.1.36

accessModes: ["ReadWriteOnce","ReadWriteMany"]

capacity:

storage: 10Gi

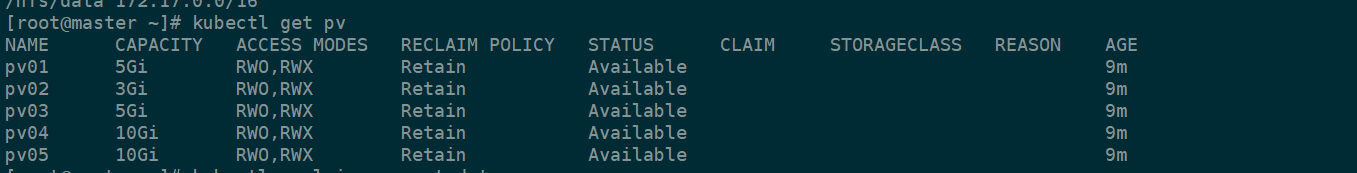

kubectl apply -f pv-nfs.yaml

显示,pv创建完成

接下来创建pvc 和pod,yaml文件如下

apiVersion: v1

kind: PersistentVolumeClaim

metadata:

name: mypvc

namespace: default

spec:

accessModes: ["ReadWriteMany"]

resources:

requests:

storage: 5Gi #到这里是创建pvc的

---

apiVersion: v1

kind: Pod

metadata:

name: nginx-volume-pvc

namespace: default

spec:

containers:

- name: nginx-pvc

image: nginx

ports:

- containerPort: 80

volumeMounts:

- name: html

mountPath: /usr/share/nginx/html/

volumes: #这里是选择volume的类型

- name: html

persistentVolumeClaim:

claimName: mypvc

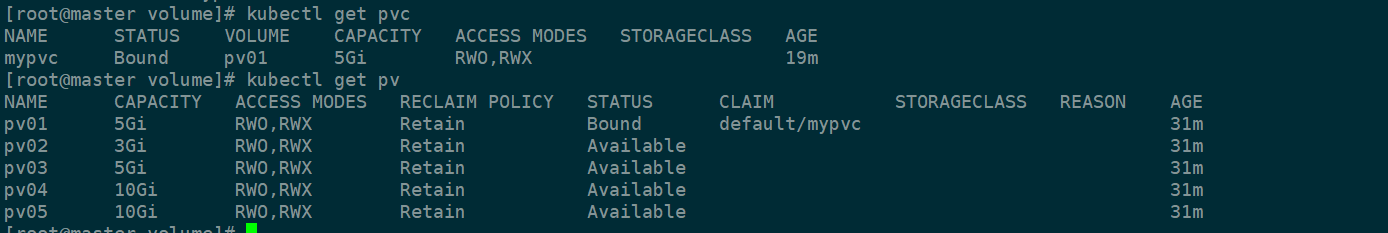

显示pvc创建好了,同时pvc绑定了一个pv,到此pv和pvc的安装部署完成。

注意:pv和pvc是一对一绑定的。但是多个pod可以挂载同一个pvc。而且处于绑定状态下的pv无法直接被删除,如果需要删除被绑定的pv,需要先删除申请绑定的PVC

通常使用的流程是,首先创建存储,在创建pv,接着创建pvc,pod挂载到相应的pvc。

-----------------------------------------------------------------------------------------------------------

PV对第三方存储的访问模式支持:

访问模式

PV可以使用存储资源提供商支持的任何方法来映射到host中。如下的表格中所示,提供商有着不同的功能,每个PV的访问模式被设置为卷支持的指定模式。比如,NFS可以支持多个读/写的客户端,但可以在服务器上指定一个只读的NFS PV。每个PV有它自己的访问模式。

访问模式包括:

▷ ReadWriteOnce —— 该volume只能被单个节点以读写的方式映射

▷ ReadOnlyMany —— 该volume只能被多个节点以只读方式映射

▷ ReadWriteMany —— 该volume可以被多个节点以读写的方式映射

在CLI中,访问模式可以简写为:

▷ RWO - ReadWriteOnce

▷ ROX - ReadOnlyMany

▷ RWX - ReadWriteMany

注意:即使volume支持很多种访问模式,但它同时只能使用一种方式来映射。比如,GCEPersistentDisk可以被单个节点映射为ReadWriteOnce,或者多个节点映射为ReadOnlyMany,但不能同时使用这两种方式来映射。

| Volume Plugin | ReadWriteOnce | ReadOnlyMany | ReadWriteMany |

|---|---|---|---|

| AWSElasticBlockStore | ✓ | - | - |

| AzureFile | ✓ | ✓ | ✓ |

| AzureDisk | ✓ | - | - |

| CephFS | ✓ | ✓ | ✓ |

| Cinder | ✓ | - | - |

| FC | ✓ | ✓ | - |

| FlexVolume | ✓ | ✓ | - |

| Flocker | ✓ | - | - |

| GCEPersistentDisk | ✓ | ✓ | - |

| Glusterfs | ✓ | ✓ | ✓ |

| HostPath | ✓ | - | - |

| iSCSI | ✓ | ✓ | - |

| PhotonPersistentDisk | ✓ | - | - |

| Quobyte | ✓ | ✓ | ✓ |

| NFS | ✓ | ✓ | ✓ |

| RBD | ✓ | ✓ | - |

| VsphereVolume | ✓ | - | - |

| PortworxVolume | ✓ | - | ✓ |

| ScaleIO | ✓ | ✓ | - |

K8s存储卷、pv和pvc的使用的更多相关文章

- k8s系列---存储卷pv/pvc。configMap/secert

因为pod是有生命周期的,pod一重启,里面的数据就没了.所以我们需要数据持久化存储. 在k8s中,存储卷不属于容器,而是属于pod.也就是说同一个pod中的容器可以共享一个存储卷. 存储卷可以是宿主 ...

- 6.k8s.存储Volume.PV.PVC

#Volume Volume 解决数据持久化和容器间共享数据 Kubernetes支持几十种类型的后端存储卷 #hostPath挂载实例,挂载Node节点/tmp/test-volume目录到容器/t ...

- 持久化存储之 PV、PVC、StorageClass

PV介绍: PersistentVolume(PV)是群集中由管理员配置的一块存储. 它是集群中的资源,就像节点是集群资源一样. PV是容量插件,如Volumes,但其生命周期独立于使用PV的任何单个 ...

- k8s存储卷概述

pod本身具有生命周期,故其内部运行的容器及其相关数据自身均无法持久存在.docker支持配置容器使用存储卷将数据持久存储于容器自身文件系统之外的存储空间中,它们可以是节点文件系统或网络文件系统之上的 ...

- k8s入门之PV和PVC(八)

某些应用是要持久化数据的,如果直接持久化在pod所在节点,当pod因为某种原因重建或被调度另外一台节点,是无法访问到之前持久化的数据,所以需要一个公共存储数据的地方,无论pod删除重建或重新调度到其他 ...

- k8s的pv和pvc简述

pvc:资源需要指定:1.accessMode:访问模型:对象列表: ReadWriteOnce – the volume can be mounted as read-write by a s ...

- 容器编排系统K8s之PV、PVC、SC资源

前文我们聊到了k8s中给Pod添加存储卷相关话题,回顾请参考:https://www.cnblogs.com/qiuhom-1874/p/14180752.html:今天我们来聊一下持久存储卷相关话题 ...

- k8s之PV、PVC

目录 一.PVC和PV 1.1 PV概念 1.2 PVC概念 1.3 PV与PVC之间的关系 1.4 两种PV的提供方式 二.基于nfs创建静态PV资源和PVC资源 2.1 配置nfs存储(192.1 ...

- Kubernetes学习之路(十六)之存储卷

目录 一.存储卷的概念和类型 二.emptyDir存储卷演示 三.hostPath存储卷演示 四.nfs共享存储卷演示 五.PVC和PV的概念 六.NFS使用PV和PVC 1.配置nfs存储 2.定义 ...

随机推荐

- Xshell5一打开就提示要使用该程序,请更新至最新版本

网上有两种方法 方法一:临时 修改系统时间,修改为一年前的时间即可.但是你会发现修改回当前时间后,xshell又打不开了 方法二:替换xshell文件 找到xshell安装位置,如果是快捷方式,可以右 ...

- Battle Zone 战争地带

发售年份 1980 平台 街机 开发商 雅达利(Atari) 类型 射击 https://www.youtube.com/watch?v=Ctr54kopo8I

- 20175202 《Java程序设计》第三周学习总结

20175209 2018-2019-2 <Java程序设计>第三周学习总结 教材知识点总结 1.编程语言发展阶段: 面向机器语言——面向过程语言——面向对象语言. 2.类声明: 类名必须 ...

- flutter 容器 几种写法

1.Stack: 取代线性布局 (译者语:和Android中的LinearLayout相似),Stack允许子 widget 堆叠, 你可以使用 Positioned 来定位他们相对于Stack的上下 ...

- MySQL is running but PID file could not be found

在Linux 中,当你启动或者重启 MySQL 时,报 关于 PID file 的错误 解决方法 第一步:找到 mysql 中 data 目录下的 mysql-bin.index 文件,然后删除 ...

- GP中Geoprocessor.Execute(string name, IVariantArray parameters, ITrackCancel trackCancel)

在做一个项目的过程中,发现GP运算方法 Execute(string name, IVariantArray parameters, ITrackCancel trackCancel) 与Execut ...

- linux 中 && 及|| 判断原理

[root@linuxprobe ~]# [ $USER = root ] && echo "root" || echo "user"root[ ...

- 用最简单的话告诉你什么是ElasticSearch

介绍 Elasticsearch 是一个分布式可扩展的实时搜索和分析引擎,一个建立在全文搜索引擎 Apache Lucene(TM) 基础上的搜索引擎.当然 Elasticsearch 并不仅仅是 L ...

- 微信小程序+没有找到node_modules目录

第一步:设置-->项目设置-->使用npm模块 第二步:右键目录下miniprogram-->终端打开-->输入npm init-->在packagename下输入:sm ...

- Java BASE58 以及 md5,sha256,sha1

package cn.ubibi.wsblog.utils; import java.io.UnsupportedEncodingException; import java.math.BigInte ...