流式大数据计算实践(2)----Hadoop集群和Zookeeper

一、前言

1、上一文搭建好了Hadoop单机模式,这一文继续搭建Hadoop集群

二、搭建Hadoop集群

1、根据上文的流程得到两台单机模式的机器,并保证两台单机模式正常启动,记得第二台机器core-site.xml内的fs.defaultFS参数值要改成本机的来启动,启动完毕后再改回来

2、清空数据,首先把运行单机模式后生成的数据全部清理掉

rm -rf /work/hadoop/nn/current rm -rf /work/hadoop/dn/current hdfs namenode -format

3、启动集群

(1)storm1作为namenode节点,所以在这台机上面执行命令启动namenode

$HADOOP_PREFIX/sbin/hadoop-daemon.sh --script hdfs start namenode

(2)storm2作为datanode节点,所以在这台机上面执行命令启动datanode

$HADOOP_PREFIX/sbin/hadoop-daemon.sh --script hdfs start datanode

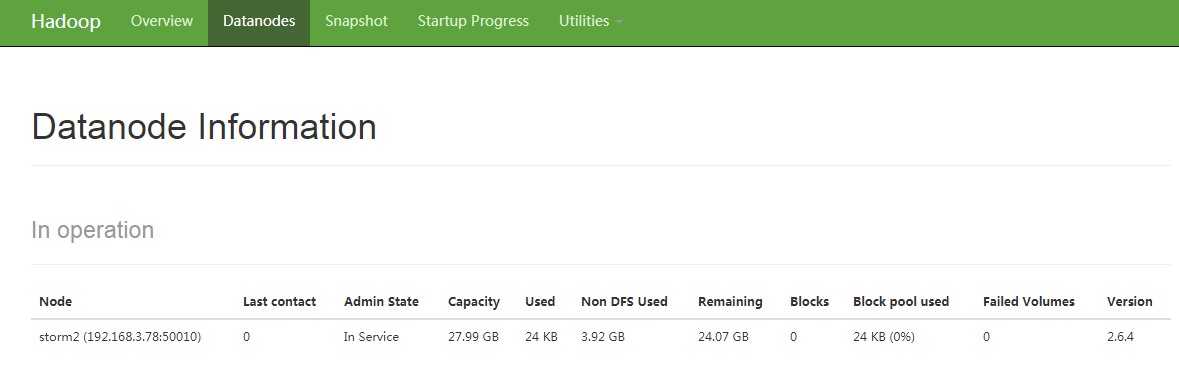

(3)通过jps命令可以看到对应的节点,然后通过50070的控制台可以看到storm2的datanode节点

三、ZooKeeper

1、Zookeeper是分布式框架经常要用到的应用协调服务,相当于让分布式内的每个组件同步起来

2、Zookeeper安装

(1)下载Zookeeper的tar.gz包,并解压

(2)配置环境变量

vim /etc/profile #set zookeeper env

export ZOOKEEPER_HOME=/work/soft/zookeeper-3.4.

export PATH=$PATH:$ZOOKEEPER_HOME/bin source /etc/profile

(3)配置ZooKeeper

①进入到Zookeeper目录的conf文件夹,可以看到里面有一个配置文件的模板zoo_sample.cfg,将模板复制一份到zoo.cfg

②然后编辑内容,只需要修改Zookeeper的存放数据的目录(记得创建对应文件夹)

vim /work/soft/zookeeper-3.4./conf/zoo.cfg dataDir=/work/zookeeper/data

③继续编辑bin目录下的zkEnv.sh文件来修改Zookeeper存放日志的目录(记得创建对应文件夹)

vim /work/soft/zookeeper-3.4./bin/zkEnv.sh ZOO_LOG_DIR=/work/zookeeper/logs

④进入到刚刚设定的数据目录,创建一个文件myid,并写入本台机器的Zookeeper Id,这个id的取值范围是1-255,我这里取得分别是1和2

vim /work/zookeeper/data/myid

(4)启动单机版Zookeeper

①首先启动Zookeeper

$ZOOKEEPER_HOME/bin/zkServer.sh start

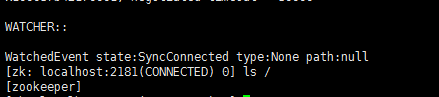

②进入到Zookeeper的控制台查看数据目录是否正常

$ZOOKEEPER_HOME/bin/zkCli.sh ls /

(5)启动集群版Zookeeper

①先停止单机版

$ZOOKEEPER_HOME/bin/zkServer.sh stop

②把刚刚单机版产生的数据删除,执行删除目录时,一定要小心不要输错,还有记得再把刚才的myid文件创建出来- -

rm -rf /work/zookeeper/data/*

rm -rf /work/zookeeper/logs/*

③进入Zookeeper的conf目录,编辑zoo.cfg,在文件末尾配置Zookeeper集群的节点信息

vim /work/soft/zookeeper-3.4./conf/zoo.cfg server.=storm1::

server.=storm2::

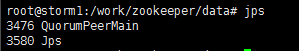

④在每台机器启动Zookeeper,然后通过jps命令查看进程是否存在

$ZOOKEEPER_HOME/bin/zkServer.sh start jps

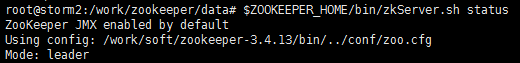

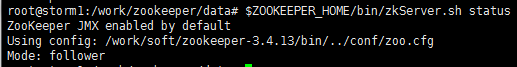

⑤使用查看集群状态命令,在每台机器执行,可以发现一台是leader,另一台是follower,说明集群是OK的

$ZOOKEEPER_HOME/bin/zkServer.sh status

流式大数据计算实践(2)----Hadoop集群和Zookeeper的更多相关文章

- 流式大数据计算实践(1)----Hadoop单机模式

一.前言 1.从今天开始进行流式大数据计算的实践之路,需要完成一个车辆实时热力图 2.技术选型:HBase作为数据仓库,Storm作为流式计算框架,ECharts作为热力图的展示 3.计划使用两台虚拟 ...

- 流式大数据计算实践(3)----高可用的Hadoop集群

一.前言 1.上文中我们已经搭建好了Hadoop和Zookeeper的集群,这一文来将Hadoop集群变得高可用 2.由于Hadoop集群是主从节点的模式,如果集群中的namenode主节点挂掉,那么 ...

- 流式大数据计算实践(4)----HBase安装

一.前言 1.前面我们搭建好了高可用的Hadoop集群,本文正式开始搭建HBase 2.HBase简介 (1)Master节点负责管理数据,类似Hadoop里面的namenode,但是他只负责建表改表 ...

- 流式大数据计算实践(6)----Storm简介&使用&安装

一.前言 1.这一文开始进入Storm流式计算框架的学习 二.Storm简介 1.Storm与Hadoop的区别就是,Hadoop是一个离线执行的作业,执行完毕就结束了,而Storm是可以源源不断的接 ...

- 流式大数据计算实践(5)----HBase使用&SpringBoot集成

一.前言 1.上文中我们搭建好了一套HBase集群环境,这一文我们学习一下HBase的基本操作和客户端API的使用 二.shell操作 先通过命令进入HBase的命令行操作 /work/soft/hb ...

- 流式大数据计算实践(7)----Hive安装

一.前言 1.这一文学习使用Hive 二.Hive介绍与安装 Hive介绍:Hive是基于Hadoop的一个数据仓库工具,可以通过HQL语句(类似SQL)来操作HDFS上面的数据,其原理就是将用户写的 ...

- 大数据运维尖刀班 | 集群_监控_CDH_Docker_K8S_两项目_腾讯云服务器

说明:大数据时代,传统运维向大数据运维升级换代很常见,也是个不错的机会.如果想系统学习大数据运维,个人比较推荐通信巨头运维大咖的分享课:https://url.cn/5HIqOOr,主要是实战强.含金 ...

- 本地日志数据实时接入到hadoop集群的数据接入方案

1. 概述 本手册主要介绍了,一个将传统数据接入到Hadoop集群的数据接入方案和实施方法.供数据接入和集群运维人员参考. 1.1. 整体方案 Flume作为日志收集工具,监控一个文件目录或者一个文 ...

- 大数据学习路线:Hadoop集群同步技术分享

今天给大家带来的技术分享是——Hadoop集群同步. 一.同步方式 选择一个机器,作为时间服务器(这里选择hadoop01),所有的机器与这台集群时间进行定时的同步,比如,每隔十分钟,同步一次时间. ...

随机推荐

- Linux 防火墙管理及操作

1.关闭firewall:systemctl stop firewalld.service #停止firewallsystemctl disable firewalld.service #禁止fire ...

- REdis MASTER aborted replication NOAUTH Authentication required

对于REdis集群,如果设置了requirepass,则一定要设置masterauth,否则从节点无法正常工作,查看从节点日志可以看到哪下内容:19213:S 22 Apr 2019 10:52:17 ...

- U-Boot Makefile分析(4)具体子Makefile的分析

前面分析的都是多数Makefile要读入的文件,这次我们以drivers/mtd/nand/Makefile为例,分析一个具体的子Makefile是如何工作的. 子Makefile的结构是固定的: i ...

- 第2周个人作业:WordCount

Github地址: https://github.com/hddddd/Wordcount 1.PSP表格 PSP2.1 PSP阶段 预估耗时(分钟) 实际耗时(分钟) Planning 计划 30 ...

- document,element,node方法

document方法: getElementById(id) 返回指定结点的引用 getElementsByTagName_r(name) ...

- vb越界

想起来一个项目当中,遇到了一个问题,就是老是显示数据溢出. 后来查查查,发现是由于vb的特性造成的.例如cbyte()函数.此函数()里面的数据运算也不能超过cbyte的范围,不然就回发生溢出问题.

- asp.net执行顺速

理解ASP.NET的运行机制(例:通过HttpModule来计算页面执行时间) 一:简要介绍一下asp.net的执行步骤 1.IIS接收到客户请求 2. IIS把请求交给aspnet_isapi.dl ...

- post推送消息时的乱码

URL realUrl = new URL(url); // 打开和URL之间的连接 URLConnection conn = realUrl.openConnection(); // 设置通用的请求 ...

- Java对象序列化和返序列化

public class SerializeUtil { /** * 序列化 * * @param object * @return */ public static byte[] serialize ...

- Oracle 树操作、递归查询(select…start with…connect by…prior)

一.Oracle中start with…connect by prior子句用法 connect by 是结构化查询中用到的,其基本语法是:select … from tablename start ...