10分钟go crawler colly从入门到精通

Introduction

本文对colly如何使用,整个代码架构设计,以及一些使用实例的收集。

Colly是Go语言开发的Crawler Framework,并不是一个完整的产品,Colly提供了类似于Python的同类产品(BeautifulSoup 或 Scrapy)相似的表现力和灵活性。

Colly这个名称源自 Collector 的简写,而Collector 也是 Colly的核心。

Colly Official Docs,内容不是很多,最新的消息也很就远了,仅仅是活跃在Github

Concepts

Architecture

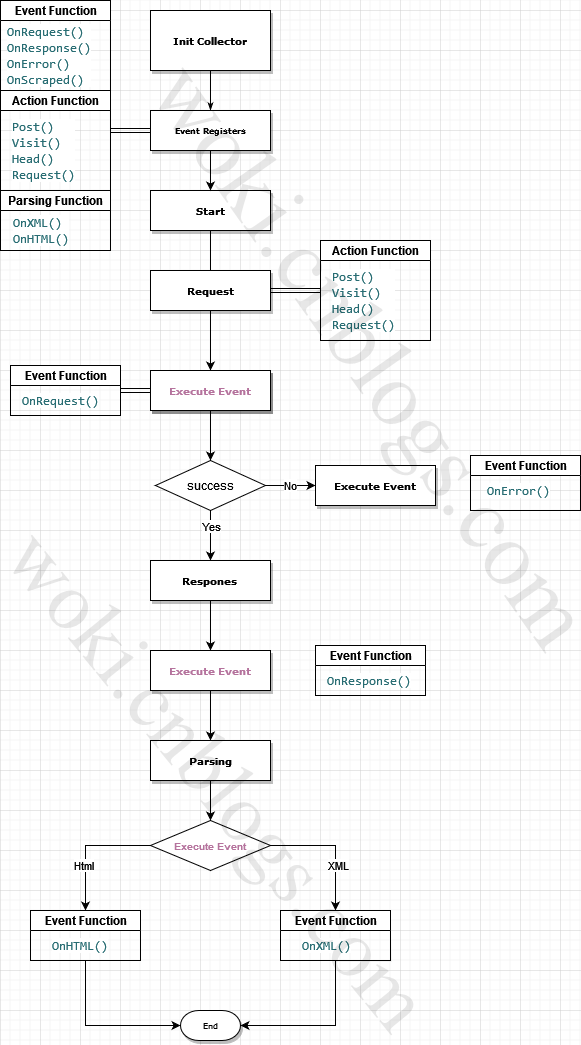

从理解上来说,Colly的设计分为两层,核心层和解析层,

Collector:是Colly实现,该组件负责网络通信,并负责在Collector作业运行时执行对应事件的回调。Parser:这个其实是抽象的,官网并未对此说明,goquery和一些htmlquery,通过这些就可以将访问的结果解析成类Jquery对象,使html拥有了,XPath选择器和CSS选择器

通常情况下Crawler的工作流生命周期大致为

- 构建客户端

- 发送请求

- 获取响应的数据

- 将相应的数据解析

- 对所需数据处理

- 持久化

而Colly则是将这些概念进行封装,通过将事件注册到每个步骤中,通过事件的方式对数据进行清理,抽象来说,Colly面向的是过程而不是对象。大概的工作架构如图

event

通过上述的概念,可以大概了解到 Colly 是一个基于事件的Crawler,通过开发者自行注册事件函数来触发整个流水线的工作

Colly 具有以下事件处理程序:

- OnRequest:在请求之前调用

- OnError :在请求期间发生错误时调用

- OnResponseHeaders :在收到响应头后调用

- OnResponse: 在收到响应后调用

- OnHTML:如果接收到的内容是 HTML,则在 OnResponse 之后立即调用

- OnXML :如果接收到的内容是 HTML 或 XML,则在 OnHTML 之后立即调用

- OnScraped:在 OnXML 回调之后调用

- OnHTMLDetach:取消注册一个OnHTML事件函数,取消后,如未执行过得事件将不会再被执行

- OnXMLDetach:取消注册一个OnXML事件函数,取消后,如未执行过得事件将不会再被执行

Reference

Utilities

简单使用

package main

import (

"fmt"

"github.com/gocolly/colly"

)

func main() {

// Instantiate default collector

c := colly.NewCollector(

// Visit only domains: hackerspaces.org, wiki.hackerspaces.org

colly.AllowedDomains("hackerspaces.org", "wiki.hackerspaces.org"),

)

// On every a element which has href attribute call callback

c.OnHTML("a[href]", func(e *colly.HTMLElement) {

link := e.Attr("href")

// Print link

fmt.Printf("Link found: %q -> %s\n", e.Text, link)

// Visit link found on page

// Only those links are visited which are in AllowedDomains

c.Visit(e.Request.AbsoluteURL(link))

})

// Before making a request print "Visiting ..."

c.OnRequest(func(r *colly.Request) {

fmt.Println("Visiting", r.URL.String())

})

// Start scraping on https://hackerspaces.org

c.Visit("https://hackerspaces.org/")

}

错误处理

package main

import (

"fmt"

"github.com/gocolly/colly"

)

func main() {

// Create a collector

c := colly.NewCollector()

// Set HTML callback

// Won't be called if error occurs

c.OnHTML("*", func(e *colly.HTMLElement) {

fmt.Println(e)

})

// Set error handler

c.OnError(func(r *colly.Response, err error) {

fmt.Println("Request URL:", r.Request.URL, "failed with response:", r, "\nError:", err)

})

// Start scraping

c.Visit("https://definitely-not-a.website/")

}

处理本地文件

word.html

<!DOCTYPE html>

<html lang="en">

<head>

<meta charset="UTF-8">

<title>Document title</title>

</head>

<body>

<p>List of words</p>

<ul>

<li>dark</li>

<li>smart</li>

<li>war</li>

<li>cloud</li>

<li>park</li>

<li>cup</li>

<li>worm</li>

<li>water</li>

<li>rock</li>

<li>warm</li>

</ul>

<footer>footer for words</footer>

</body>

</html>

package main

import (

"fmt"

"net/http"

"github.com/gocolly/colly/v2"

)

func main() {

t := &http.Transport{}

t.RegisterProtocol("file", http.NewFileTransport(http.Dir(".")))

c := colly.NewCollector()

c.WithTransport(t)

words := []string{}

c.OnHTML("li", func(e *colly.HTMLElement) {

words = append(words, e.Text)

})

c.Visit("file://./words.html")

for _, p := range words {

fmt.Printf("%s\n", p)

}

}

使用代理交换器

通过 ProxySwitcher , 可以直接使用一批代理IP池进行访问了,然而这里只有RR,如果需要其他的均衡算法,需要有自己实现了

package main

import (

"bytes"

"log"

"github.com/gocolly/colly"

"github.com/gocolly/colly/proxy"

)

func main() {

// Instantiate default collector

c := colly.NewCollector(colly.AllowURLRevisit())

// Rotate two socks5 proxies

rp, err := proxy.RoundRobinProxySwitcher("socks5://127.0.0.1:1337", "socks5://127.0.0.1:1338")

if err != nil {

log.Fatal(err)

}

c.SetProxyFunc(rp)

// Print the response

c.OnResponse(func(r *colly.Response) {

log.Printf("Proxy Address: %s\n", r.Request.ProxyURL)

log.Printf("%s\n", bytes.Replace(r.Body, []byte("\n"), nil, -1))

})

// Fetch httpbin.org/ip five times

for i := 0; i < 5; i++ {

c.Visit("https://httpbin.org/ip")

}

}

随机延迟

该功能可以对行为设置一种特征,以免被反扒机器人检测,并禁止我们,如速率限制和延迟

package main

import (

"fmt"

"time"

"github.com/gocolly/colly"

"github.com/gocolly/colly/debug"

)

func main() {

url := "https://httpbin.org/delay/2"

// Instantiate default collector

c := colly.NewCollector(

// Attach a debugger to the collector

colly.Debugger(&debug.LogDebugger{}),

colly.Async(true),

)

// Limit the number of threads started by colly to two

// when visiting links which domains' matches "*httpbin.*" glob

c.Limit(&colly.LimitRule{

DomainGlob: "*httpbin.*",

Parallelism: 2,

RandomDelay: 5 * time.Second,

})

// Start scraping in four threads on https://httpbin.org/delay/2

for i := 0; i < 4; i++ {

c.Visit(fmt.Sprintf("%s?n=%d", url, i))

}

// Start scraping on https://httpbin.org/delay/2

c.Visit(url)

// Wait until threads are finished

c.Wait()

}

多线程请求队列

package main

import (

"fmt"

"github.com/gocolly/colly"

"github.com/gocolly/colly/queue"

)

func main() {

url := "https://httpbin.org/delay/1"

// Instantiate default collector

c := colly.NewCollector(colly.AllowURLRevisit())

// create a request queue with 2 consumer threads

q, _ := queue.New(

2, // Number of consumer threads

&queue.InMemoryQueueStorage{MaxSize: 10000}, // Use default queue storage

)

c.OnRequest(func(r *colly.Request) {

fmt.Println("visiting", r.URL)

if r.ID < 15 {

r2, err := r.New("GET", fmt.Sprintf("%s?x=%v", url, r.ID), nil)

if err == nil {

q.AddRequest(r2)

}

}

})

for i := 0; i < 5; i++ {

// Add URLs to the queue

q.AddURL(fmt.Sprintf("%s?n=%d", url, i))

}

// Consume URLs

q.Run(c)

}

异步

默认情况下,Colly的工作模式是同步的。可以使用 Async 函数启用异步模式。在异步模式下,我们需要调用Wait 等待Collector 工作完成。

package main

import (

"fmt"

"github.com/gocolly/colly/v2"

)

func main() {

urls := []string{

"http://webcode.me",

"https://example.com",

"http://httpbin.org",

"https://www.perl.org",

"https://www.php.net",

"https://www.python.org",

"https://code.visualstudio.com",

"https://clojure.org",

}

c := colly.NewCollector(

colly.Async(),

)

c.OnHTML("title", func(e *colly.HTMLElement) {

fmt.Println(e.Text)

})

for _, url := range urls {

c.Visit(url)

}

c.Wait()

}

最大深度

深度是在访问这个页面时,其页面还有link,此时需要采集到入口link几层的link?默认1

package main

import (

"fmt"

"github.com/gocolly/colly"

)

func main() {

// Instantiate default collector

c := colly.NewCollector(

// MaxDepth is 1, so only the links on the scraped page

// is visited, and no further links are followed

colly.MaxDepth(1),

)

// On every a element which has href attribute call callback

c.OnHTML("a[href]", func(e *colly.HTMLElement) {

link := e.Attr("href")

// Print link

fmt.Println(link)

// Visit link found on page

e.Request.Visit(link)

})

// Start scraping on https://en.wikipedia.org

c.Visit("https://en.wikipedia.org/")

}

Reference

10分钟go crawler colly从入门到精通的更多相关文章

- 一起学react (1) 10分钟 让你dva从入门到精通

前言 如果文章中有错误的地方的话 可以直接加我QQ:469373256 自己针对一些问题做的优化版本 目前刚启动 还不是很成熟 https://github.com/fangkyi03/fastkit ...

- C# 10分钟完成百度人脸识别——入门篇

嗨咯,小编在此祝大家新年快乐财多多! 今天我们来盘一盘人脸注册.人脸识别等相关操作,这是一个简单入门教程. 话不多说,我们进入主题: 完成人脸识别所需的步骤: 注册百度账号api,创建自己的应用: 创 ...

- C# 10分钟完成百度图片提取文字(文字识别)——入门篇

现在图片文字识别已经很成熟了,比如qq长按图片,点击图片识别就可以识别图片的文字,将不认识的.文字数量大的.或者不能赋值的值进行二次可复制功能. 我们现在就基于百度Ai开放平台进行个人文字识别,dem ...

- C# 10分钟完成百度语音技术(语音识别与合成)——入门篇

我们已经讲了人脸识别(入门+进阶).图片识别(入门).下面是链接: C# 10分钟完成百度人脸识别——入门篇 C# 30分钟完成百度人脸识别——进阶篇(文末附源码) C# 10分钟完成百度图片提取文字 ...

- C# 10分钟完成百度翻译(机器翻译)——入门篇

我们之前基于百度ai开发平台实现了人脸识别 [1].文字识别 [2].语音识别 [3] 与合成的入门和进阶,今天我们来实现百度翻译的实现. 随着"一带一路"政策的开展,各种项目迎接 ...

- Apache Shiro系列三,概述 —— 10分钟入门

一.介绍 看完这个10分钟入门之后,你就知道如何在你的应用程序中引入和使用Shiro.以后你再在自己的应用程序中使用Shiro,也应该可以在10分钟内搞定. 二.概述 关于Shiro的废话就不多说了 ...

- JavaScript 10分钟入门

JavaScript 10分钟入门 随着公司内部技术分享(JS进阶)投票的失利,先译一篇不错的JS入门博文,方便不太了解JS的童鞋快速学习和掌握这门神奇的语言. 以下为译文,原文地址:http://w ...

- emacs最简单入门,只要10分钟

macs最简单入门,只要10分钟 windwiny @2013 无聊的时候又看到鼓吹emacs的文章,以前也有几次想尝试,结果都是玩不到10分钟就退出删除了. 这次硬着头皮,打开几篇文章都看完 ...

- 不用搭环境的10分钟AngularJS指令简易入门01(含例子)

不用搭环境的10分钟AngularJS指令简易入门01(含例子) `#不用搭环境系列AngularJS教程01,前端新手也可以轻松入坑~阅读本文大概需要10分钟~` AngularJS的指令是一大特色 ...

随机推荐

- 基于COCO数据集验证的目标检测算法天梯排行榜

基于COCO数据集验证的目标检测算法天梯排行榜 AP50 Rank Model box AP AP50 Paper Code Result Year Tags 1 SwinV2-G (HTC++) 6 ...

- 五、Java控制流程

Java流程控制* 用户交互Scanner.Scanner进阶使用 用户交互Scanner 之前我们学习的基本语法中我们并没有实现程序和人的交互,但是Java给我们提供了这样一个工具类,我们可以获 ...

- 零基础,三个月内,找到??? java后端开发工作

一.分析你的问题 出于尊重,先分析一下你的原问题吧,从您的问题,我提取到关键信息:"零基础"."三个月内"."找到工作",最后一个关键词&q ...

- glibc2.29以上 IO_FILE 及 house of pig

摆烂很长时间之后,终于下定决心来看点新的东西.正好 winmt 师傅前不久把他 pig 修好的附件发给我了,我就借此来学习一下新版本的 IO_FILE 及 house of pig. 新版本的 IO_ ...

- x86-4-任务(task)

x86-4-任务(task) 4.1 任务: CPU将一整段正在运行的代码称作任务,可以类比操作系统的线程.比如说:你在Windows写了个程序进行运行,这个程序的运行在操作系统层面上来说就是进程里的 ...

- jq计算总时长

1: <style> .item { width: 500px; height: 50px; margin: 0 auto; text-align: center; font-size: ...

- 路径查找算法应用之A*算法

环境:Visual Studio 2017 + .Net Framework 4.5 应用场景:在画板上查找起始点和目标点之间的最短最直路径,最后画出连接两个点之间的折线. 算法简介:A*算法是一种性 ...

- EXSI6.7 中给虚拟机磁盘扩容

[admin@localhost ~]$ sudo fdisk -l Disk /dev/sda: 214.7 GB, 214748364800 bytes, 419430400 sectors Un ...

- 【数据结构与算法】Trie(前缀树)模板和例题

Trie 树的模板 Trie 树的简介 Trie树,又称字典树,单词查找树或者前缀树,是一种用于快速检索的多叉树结构,如英文字母的字典树是一个26叉树,数字的字典树是一个10叉树.他的核心思想是空间换 ...

- Net中委托之一

1.委托的用法 委托是一种特殊的类型 a. 委托可以类外定义,也可以在类里面定义 b. 委托的操作步骤 1.委托的声明 2.委托的实例化 3.委托的调用 2.委托实例 amespace MyDeleg ...