Tensorflow中神经网络的激活函数

激励函数的目的是为了调节权重和误差。

relu

max(0,x)

relu6

min(max(0,x),6)

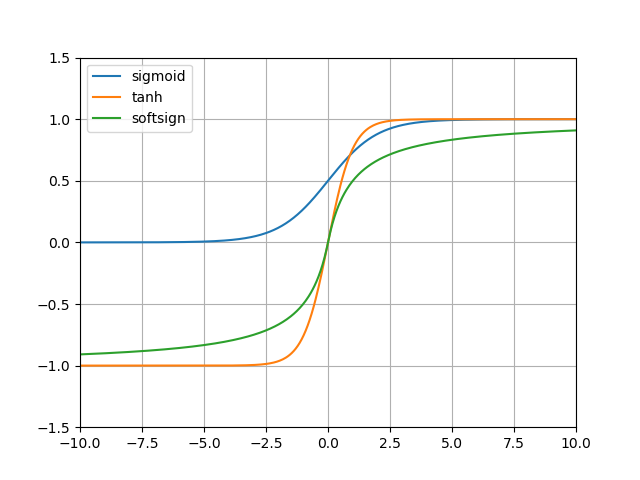

sigmoid

1/(1+exp(-x))

tanh

((exp(x)-exp(-x))/(exp(x)+exp(-x))

双曲正切函数的值域是(-1,1)

softsign

x/(abs(x)+1)

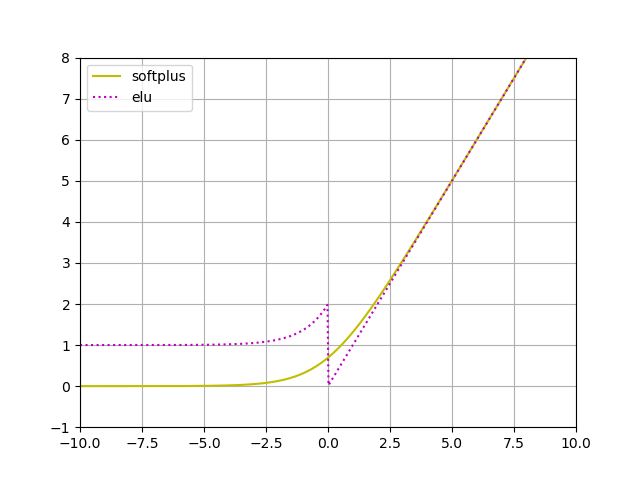

softplus

log(exp(x)+1)

elu

(exp(x)+1)if x<0 else x

import math

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt x = np.linspace(-10, 10, 500) relu = list(map(lambda m: max(0, m), x))

relu6 = list(map(lambda m: min(max(0, m), 6), x))

sigmoid = 1 / (np.exp(-x) + 1)

tanh = (np.exp(x) - np.exp(-x)) / (np.exp(x) + np.exp(-x))

softsign = x / (np.abs(x) + 1)

softplus = np.log(np.exp(x) + 1)

elu = list(map(lambda m: math.exp(m) + 1 if m < 0 else m, x)) data = {

'relu': relu,

'relu6': relu6,

'sigmoid': sigmoid,

'tanh': tanh,

'softsign': softsign,

'softplus': softplus,

'elu': elu

}

df = pd.DataFrame(data, index=x)

# print(df) df[["relu", "relu6"]].plot(

kind="line", grid=True,

style={"relu": "y-", "relu6": "r:"},

yticks=np.linspace(-1, 8, 10),

xlim=[-10, 10], ylim=[-1, 8]) df[["softplus", "elu"]].plot(

kind="line", grid=True,

style={"softplus": "y-", "elu": "m:"},

yticks=np.linspace(-1, 8, 10),

xlim=[-10, 10], ylim=[-1, 8]) df[["sigmoid", "tanh", "softsign"]].plot(

kind="line", grid=True,

yticks=np.linspace(-1.5, 1.5, 7),

xlim=[-10, 10], ylim=[-1.5, 1.5]) plt.show()

Tensorflow中神经网络的激活函数的更多相关文章

- SELU︱在keras、tensorflow中使用SELU激活函数

arXiv 上公开的一篇 NIPS 投稿论文<Self-Normalizing Neural Networks>引起了圈内极大的关注,它提出了缩放指数型线性单元(SELU)而引进了自归一化 ...

- 深度学习原理与框架-Tensorflow卷积神经网络-cifar10图片分类(代码) 1.tf.nn.lrn(局部响应归一化操作) 2.random.sample(在列表中随机选值) 3.tf.one_hot(对标签进行one_hot编码)

1.tf.nn.lrn(pool_h1, 4, bias=1.0, alpha=0.001/9.0, beta=0.75) # 局部响应归一化,使用相同位置的前后的filter进行响应归一化操作 参数 ...

- 笔记+R︱信用风险建模中神经网络激活函数与感知器简述

每每以为攀得众山小,可.每每又切实来到起点,大牛们,缓缓脚步来俺笔记葩分享一下吧,please~ --------------------------- 本笔记源于CDA-DSC课程,由常国珍老师主讲 ...

- 在 TensorFlow 中实现文本分类的卷积神经网络

在TensorFlow中实现文本分类的卷积神经网络 Github提供了完整的代码: https://github.com/dennybritz/cnn-text-classification-tf 在 ...

- tensorflow中使用mnist数据集训练全连接神经网络-学习笔记

tensorflow中使用mnist数据集训练全连接神经网络 ——学习曹健老师“人工智能实践:tensorflow笔记”的学习笔记, 感谢曹老师 前期准备:mnist数据集下载,并存入data目录: ...

- 在TensorFlow中实现文本分类的卷积神经网络

在TensorFlow中实现文本分类的卷积神经网络 Github提供了完整的代码: https://github.com/dennybritz/cnn-text-classification-tf 在 ...

- Pytorch_第九篇_神经网络中常用的激活函数

神经网络中常用的激活函数 Introduce 理论上神经网络能够拟合任意线性函数,其中主要的一个因素是使用了非线性激活函数(因为如果每一层都是线性变换,那有啥用啊,始终能够拟合的都是线性函数啊).本文 ...

- (转)一文学会用 Tensorflow 搭建神经网络

一文学会用 Tensorflow 搭建神经网络 本文转自:http://www.jianshu.com/p/e112012a4b2d 字数2259 阅读3168 评论8 喜欢11 cs224d-Day ...

- 使用TensorFlow中的Batch Normalization

问题 训练神经网络是一个很复杂的过程,在前面提到了深度学习中常用的激活函数,例如ELU或者Relu的变体能够在开始训练的时候很大程度上减少梯度消失或者爆炸问题.但是却不能保证在训练过程中不出现该问题, ...

随机推荐

- JS自学笔记04

JS自学笔记04 arguments[索引] 实参的值 1.对象 1)创建对象 ①调用系统的构造函数创建对象 var obj=new Object(); //添加属性.对象.名字=值; obj.nam ...

- [asp.net core]The requested page cannot be accessed because the related configuration data for the page is invalid.

bug HTTP Error 500.19 - Internal Server Error The requested page cannot be accessed because the rela ...

- SpringBoot无废话入门04:MyBatis整合

1.Parent引入及pom配置 首先,如果要支持mybatis,那么我们就应该引入mybatis的starter.同时,由于连接本身还需要用jdbc的connetor和连接池,所以一并需要引入这些依 ...

- RestTemplate发送请求并携带header信息 RestTemplate post json格式带header信息

原文地址: http://www.cnblogs.com/hujunzheng/p/6018505.html RestTemplate发送请求并携带header信息 v1.使用restTempl ...

- 理解Docker镜像分层

关于base镜像 base 镜像有两层含义: 不依赖其他镜像,从 scratch 构建. 其他镜像可以之为基础进行扩展. 所以,能称作 base 镜像的通常都是各种 Linux 发行版的 Docker ...

- Docker 安装和基础用法

理解Docker(1):Docker 安装和基础用法 本系列文章将介绍Docker的有关知识: (1)Docker 安装及基本用法 (2)Docker 镜像 (3)Docker 容器的隔离性 - 使用 ...

- IDEA攻略合辑

AS使用lombok注解报错:Annotation processors must be explicitly declared now. The following dependencies on ...

- 【.NET 深呼吸】.net core 中的轻量级 Composition

记得前面老周写过在.net core 中使用 Composition 的烂文.上回老周给大伙伴们介绍的是一个“重量级”版本—— System.ComponentModel.Composition.应该 ...

- NOIP2011普及组 瑞士轮

OJ地址: https://www.luogu.org/problemnew/show/P1309 http://bailian.openjudge.cn/practice/4031/ 总时间限制: ...

- 同步IO、异步IO、阻塞IO、非阻塞IO之间的联系与区别

POSIX 同步IO.异步IO.阻塞IO.非阻塞IO,这几个词常见于各种各样的与网络相关的文章之中,往往不同上下文中它们的意思是不一样的,以致于我在很长一段时间对此感到困惑,所以想写一篇文章整理一下. ...