Tensorflow中神经网络的激活函数

激励函数的目的是为了调节权重和误差。

relu

max(0,x)

relu6

min(max(0,x),6)

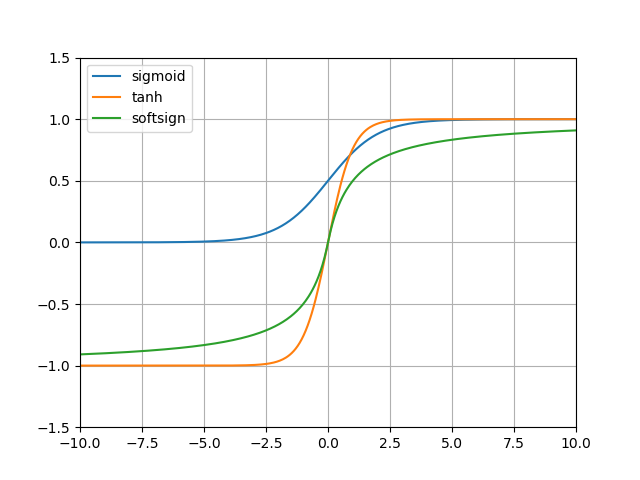

sigmoid

1/(1+exp(-x))

tanh

((exp(x)-exp(-x))/(exp(x)+exp(-x))

双曲正切函数的值域是(-1,1)

softsign

x/(abs(x)+1)

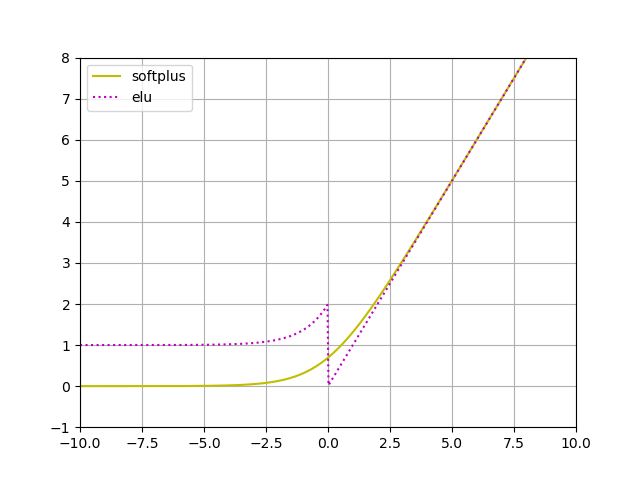

softplus

log(exp(x)+1)

elu

(exp(x)+1)if x<0 else x

import math

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt x = np.linspace(-10, 10, 500) relu = list(map(lambda m: max(0, m), x))

relu6 = list(map(lambda m: min(max(0, m), 6), x))

sigmoid = 1 / (np.exp(-x) + 1)

tanh = (np.exp(x) - np.exp(-x)) / (np.exp(x) + np.exp(-x))

softsign = x / (np.abs(x) + 1)

softplus = np.log(np.exp(x) + 1)

elu = list(map(lambda m: math.exp(m) + 1 if m < 0 else m, x)) data = {

'relu': relu,

'relu6': relu6,

'sigmoid': sigmoid,

'tanh': tanh,

'softsign': softsign,

'softplus': softplus,

'elu': elu

}

df = pd.DataFrame(data, index=x)

# print(df) df[["relu", "relu6"]].plot(

kind="line", grid=True,

style={"relu": "y-", "relu6": "r:"},

yticks=np.linspace(-1, 8, 10),

xlim=[-10, 10], ylim=[-1, 8]) df[["softplus", "elu"]].plot(

kind="line", grid=True,

style={"softplus": "y-", "elu": "m:"},

yticks=np.linspace(-1, 8, 10),

xlim=[-10, 10], ylim=[-1, 8]) df[["sigmoid", "tanh", "softsign"]].plot(

kind="line", grid=True,

yticks=np.linspace(-1.5, 1.5, 7),

xlim=[-10, 10], ylim=[-1.5, 1.5]) plt.show()

Tensorflow中神经网络的激活函数的更多相关文章

- SELU︱在keras、tensorflow中使用SELU激活函数

arXiv 上公开的一篇 NIPS 投稿论文<Self-Normalizing Neural Networks>引起了圈内极大的关注,它提出了缩放指数型线性单元(SELU)而引进了自归一化 ...

- 深度学习原理与框架-Tensorflow卷积神经网络-cifar10图片分类(代码) 1.tf.nn.lrn(局部响应归一化操作) 2.random.sample(在列表中随机选值) 3.tf.one_hot(对标签进行one_hot编码)

1.tf.nn.lrn(pool_h1, 4, bias=1.0, alpha=0.001/9.0, beta=0.75) # 局部响应归一化,使用相同位置的前后的filter进行响应归一化操作 参数 ...

- 笔记+R︱信用风险建模中神经网络激活函数与感知器简述

每每以为攀得众山小,可.每每又切实来到起点,大牛们,缓缓脚步来俺笔记葩分享一下吧,please~ --------------------------- 本笔记源于CDA-DSC课程,由常国珍老师主讲 ...

- 在 TensorFlow 中实现文本分类的卷积神经网络

在TensorFlow中实现文本分类的卷积神经网络 Github提供了完整的代码: https://github.com/dennybritz/cnn-text-classification-tf 在 ...

- tensorflow中使用mnist数据集训练全连接神经网络-学习笔记

tensorflow中使用mnist数据集训练全连接神经网络 ——学习曹健老师“人工智能实践:tensorflow笔记”的学习笔记, 感谢曹老师 前期准备:mnist数据集下载,并存入data目录: ...

- 在TensorFlow中实现文本分类的卷积神经网络

在TensorFlow中实现文本分类的卷积神经网络 Github提供了完整的代码: https://github.com/dennybritz/cnn-text-classification-tf 在 ...

- Pytorch_第九篇_神经网络中常用的激活函数

神经网络中常用的激活函数 Introduce 理论上神经网络能够拟合任意线性函数,其中主要的一个因素是使用了非线性激活函数(因为如果每一层都是线性变换,那有啥用啊,始终能够拟合的都是线性函数啊).本文 ...

- (转)一文学会用 Tensorflow 搭建神经网络

一文学会用 Tensorflow 搭建神经网络 本文转自:http://www.jianshu.com/p/e112012a4b2d 字数2259 阅读3168 评论8 喜欢11 cs224d-Day ...

- 使用TensorFlow中的Batch Normalization

问题 训练神经网络是一个很复杂的过程,在前面提到了深度学习中常用的激活函数,例如ELU或者Relu的变体能够在开始训练的时候很大程度上减少梯度消失或者爆炸问题.但是却不能保证在训练过程中不出现该问题, ...

随机推荐

- pygame-KidsCanCode系列jumpy-part8-记录历史最高分

通常在多玩家的游戏中,每个玩家都会有自己的得分,最高分数会成为该游戏的最佳记录.这一篇,学习下如何记录最高得分:(为了简化代码,本文采用文件方式,仅记录本机得分,明白原理后,可以将得分保存在云端或数据 ...

- xhprof 运行结果名词解释

Overall Summary Inclusive Time (或子树时间):包括子函数所有执行时间. Exclusive Time/Self Time:函数执行本身花费的时间,不包括子树执行时间. ...

- 14、Spark的核心术语

Application:spark应用程序,就是用户基于spark api开发的程序,一定是通过一个有main方法的类执行的,比如java开发spark,就是在eclipse中,建立的一个工程 App ...

- 用GO开发企业级分布式云存储系统

一.基础架构 二.开发工具

- redis 简单使用总结

作者:王清培(Plen wang) 沪江Java资深架构师 最近一段时间与redis接触比较频繁.发现有些东西还是工作中经常会用到的,自己也花了点时间巩固下.本篇文章主要是以总结性的方式梳理,因为r ...

- springMVC4(7)模型视图方法源代码综合分析

在完整web开发中.springMVC主要充当了控制层的角色.它接受视图层的请求.获取视图层请求数据,再对数据进行业务逻辑处理.然后封装成视图层须要的模型数据,再将数据导向到jsp等视图界面. 在前面 ...

- Spring中的CharacterEncodingFilter

spring的配置文件如下: <?xml version="1.0" encoding="UTF-8"?> <web-app xmlns=&q ...

- iframe之间操作记录

1.watch.js (function ($) { $.fn.watch = function (callback) { return this.each(function () { //缓存以前的 ...

- __NSArrayI __NSArray0 __NSSingleObjectArrayI __NSPlaceholderArray __NSArrayM

如果你的 全局 可变数组 前面 用了 copy修饰,那么 调用 arr addObjectsFromArray: 的时候 就 会崩溃,而且提示你 是 [__NSArray0 addObje ...

- Canny 边缘检测及相关应用

该内容为 <学习图像局部特征检测和描述-基于OpenCV源码分析的算法与实现> <OpenCV 3 计算机视觉-Python语言实现> OpenCV官方网站的 https:// ...