A Tutorial on Energy-Based Learning

概

从能量的角度看一些函数, 这里就记录一下这些损失.

主要内容

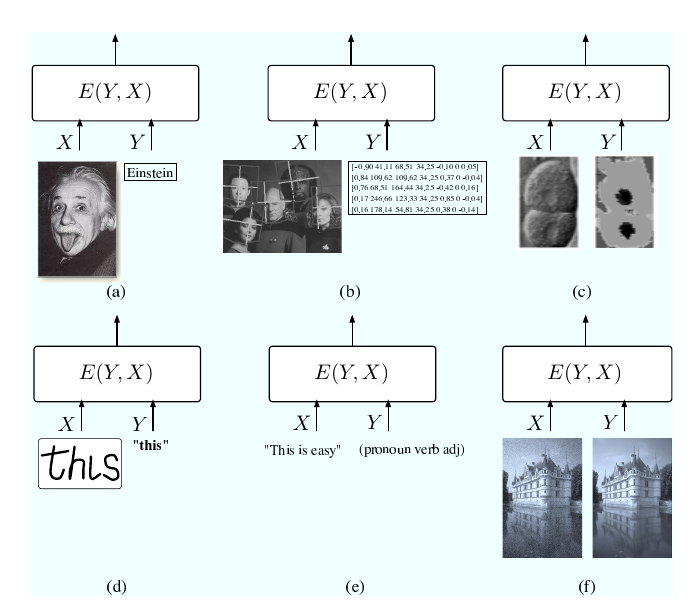

\(E(Y, X)\)反映了\(X, Y\)的关系, 认为能量越低, 而且的关系越紧密, 从下图中可以发现, \(X, Y\)的组合多种多样.

通常情况下, 我们需要训练一个映射, 其参数为\(W\), 一个好的参数可以使得

\]

很小. 不过我们通常会选取一些损失函数, 来间接最小化上面的能量函数

\]

其中\(R(W)\)是正则化项. 自然, 损失函数至少需要满足其最优点是最小化损失函数的, 当然应该还有一些其他的条件.

如果\(\mathcal{Y}\)是离散的, 我们可以令

\]

相应的连续情况下

\]

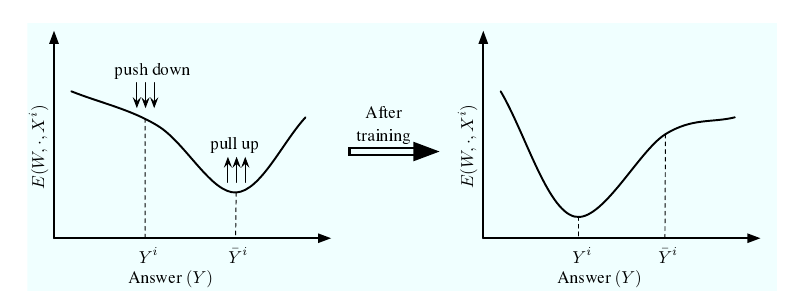

即\(\bar{Y}\)是我们最不爽的点. 很自然, 我们希望损失函数将我们希望的点\(Y^i\)的能量降低, 而拔高我们讨厌的\(\bar{Y}^i\)的能量.

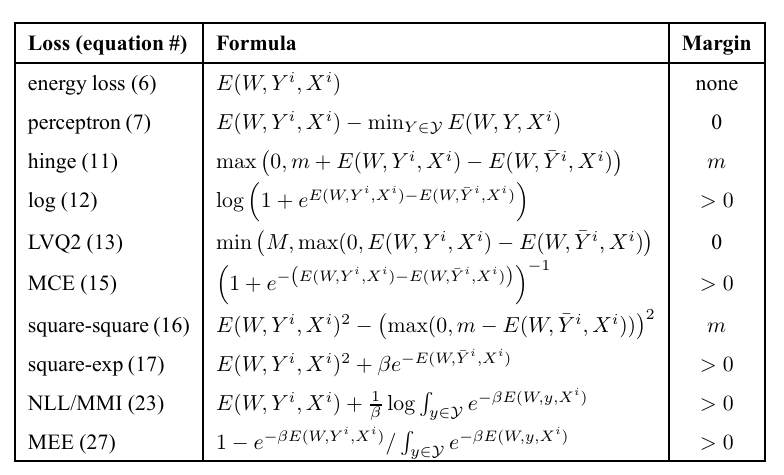

损失函数

Energy Loss

\]

Generalized Perceptron Loss

\]

Generalized Margin Loss

Hinge Loss

\]

Log Loss

\]

LVQ2 Loss

\]

虽然LVQ2 Loss和上面的非margin loss一样, 似乎是没margin的, 但是作者说最后二者有一个饱和的比例\(1+\delta\), 但是不是特别理解.

MCE Loss

\]

其中\(\sigma\)是sigmoid.

Square-Square Loss

\]

Square-Exponential

\]

Negative Log-Likelihood Loss

\]

其中

\]

Empirical Error Loss

\]

好的损失应该满足的一些条件

都是充分条件, 所以不满足也有可能是满足所需要的性质的.

条件1

对于样本\((X^i, Y^i)\), 如果预测满足

\]

则推断结果应当为\(Y^i\).

条件2

对于变量\(Y\)以及样本\((X^i, Y^i)\)和margin \(m\), 若

\]

则推断结果应当为\(Y^i\).

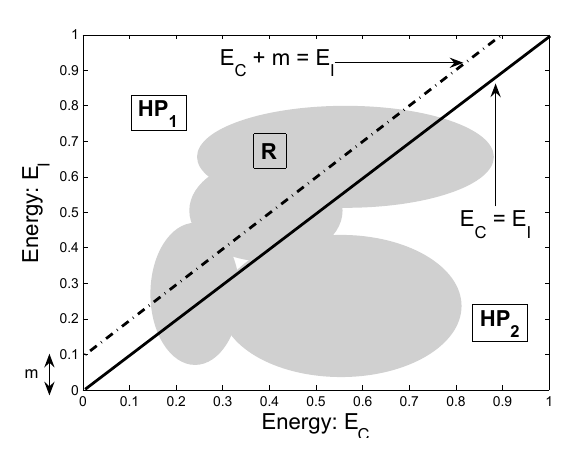

条件3

这个条件就用语言描述吧.

即, 要求\(HP_1\)与可行域\(R\)的交集中存在一解, 是的\((X^i, Y^i)\)在该点处的能量比\(HP_2\)与\(R\)交集的所有解的能量都要小, 其中

HP_2: E_C + m > E_I.

\]

\(E_C=E(W, Y^i, X^i)\), \(E_I=E(W, \bar{Y}^i, X^i)\).

下图给出了满足上述三个条件的损失及其对应的\(m\).

A Tutorial on Energy-Based Learning的更多相关文章

- A Complete Tutorial on Tree Based Modeling from Scratch (in R & Python)

A Complete Tutorial on Tree Based Modeling from Scratch (in R & Python) MACHINE LEARNING PYTHON ...

- 强化学习之 免模型学习(model-free based learning)

强化学习之 免模型学习(model-free based learning) ------ 蒙特卡罗强化学习 与 时序查分学习 ------ 部分节选自周志华老师的教材<机器学习> 由于现 ...

- Tutorial on GoogleNet based image classification --- focus on Inception module and save/load models

Tutorial on GoogleNet based image classification 2018-06-26 15:50:29 本文旨在通过案例来学习 GoogleNet 及其 Incep ...

- Pros and Cons of Game Based Learning

https://www.gamedesigning.org/learn/game-based-learning/ I remember days gone by at elementary schoo ...

- Octave Tutorial(《Machine Learning》)之第一课《数据表示和存储》

Octave Tutorial 第一课 Computation&Operation 数据表示和存储 1.简单的四则运算,布尔运算,赋值运算(a && b,a || b,xor( ...

- Game Based Learning: Why Does it Work?

Forty years of research[i] says yes, games are effective learning tools. People learn from games, an ...

- Octave Tutorial(《Machine Learning》)之第五课《控制语句和方程及向量化》

第五课 控制语句和方程 For,while,if statements and functions (1)For loop v=zeros(10,1) %initial vectors for i=1 ...

- Octave Tutorial(《Machine Learning》)之第四课《绘图数据》

第四课 Plotting Data 绘图数据 t = [0,0.01,0.98]; y1 = sin(2*pi*4*t); y2 = cos(2*pi*4*t); plot(t,y1);(绘制图1) ...

- Octave Tutorial(《Machine Learning》)之第三课《数据计算》

第三课 Culculating Data 数据计算 矩阵计算 1.简单的四则运算 2.相乘除,乘方运算(元素位运算) ".*"为对应元素的相乘计算 "./"为对 ...

- Octave Tutorial(《Machine Learning》)之第二课《数据移动》

第二课 Moving Data 数据移动 常用内置函数 (1)加载文件 load 文件名.dat(或load('文件名.dat')) 接着输入文件名便可查看文件里的数据 (2)显示当前工作空间的所有变 ...

随机推荐

- MapReduce08 数据清洗(ETL)和压缩

目录 数据清洗(ETL) ETL清洗案例 需求 需求分析 实现代码 编写WebLogMapper类 编写WebLogDriver类 打包到集群运行 压缩 概念 MR支持的压缩编码 压缩算法对比 压缩性 ...

- 为构建大型复杂系统而生的微服务框架 Erda Infra

作者|宋瑞国(尘醉) 来源|尔达 Erda 公众号 导读:Erda Infra 微服务框架是从 Erda 项目演进而来,并且完全开源.Erda 基于 Erda Infra 框架完成了大型复杂项目的 ...

- Java、Scala类型检查和类型转换

目录 Java 1.类型检查 2.类型转换 Scala 1.类型检查 2.类型转换 Java 1.类型检查 使用:变量 instanceof 类型 示例 String name = "zha ...

- java加密方式

加密,是以某种特殊的算法改变原有的信息数据,使得未授权的用户即使获得了已加密的信息,但因不知解密的方法,仍然无法了解信息的内容.大体上分为双向加密和单向加密,而双向加密又分为对称加密和非对称加密(有些 ...

- ORACEL 创建DIRECTORY

oracle要直接对文件进行读写必须先创建一个DIRECTORY. 语法如下: CREATE DIRECTORY UTL_FILE_DIR AS '/home/oracle/oradir'; 可以通过 ...

- Linux学习 - shell脚本执行

一.shell概述 shell是一个命令行解释器,为用户提供一个向Linux内核发送请求以便运行程序的界面系统级程序,用户可以用shell来启动.挂起.停止甚至是编写一些程序 shell还是一个功能强 ...

- go channel 概述

精髓 将资源读进内存-->共享内存,一个个进程/线程进行处理,这是常见模式.go channel 是一种直接在进程/线程之间传递资源的方式,即以通信来共享内存.这便是go的精髓. 扩展-一些名词 ...

- Plist文件和字典转模型

模型与字典 1. 用模型取代字典的好处 使用字典的坏处 编译器没有自动提醒的功能,需要手敲 key如果写错了编译器也不会报错 2. 模型概念 概念 专门用来存放数据的对象 特点 一般继承自NSObje ...

- 网页设计单位 px,em,rem,vm,vh,%

px(pixels) 像素 (px) 是一种绝对单位,因为无论其他相关的设置怎么变化,像素指定的值是不会变化的. px就是设备或者图片最小的一个点,比如常常听到的电脑像素是1024x768的,表示的是 ...

- Socket通信和多线程的总结

1.ServerSocket进行多线程接收 package com.yh.chat; import java.io.IOException; import java.net.ServerSocket; ...