XGBoost特征选择

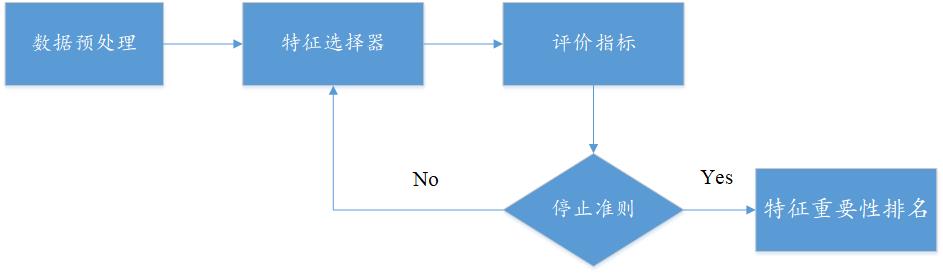

1. 特征选择的思维导图

2. XGBoost特征选择算法

(1) XGBoost算法背景

2016年,陈天奇在论文《 XGBoost:A Scalable Tree Boosting System》中正式提出该算法。XGBoost的基本思想和GBDT相同,但是做了一些优化,比如二阶导数使损失函数更精准;正则项避免树过拟合;Block存储可以并行计算等。XGBoost具有高效、灵活和轻便的特点,在数据挖掘、推荐系统等领域得到广泛的应用。

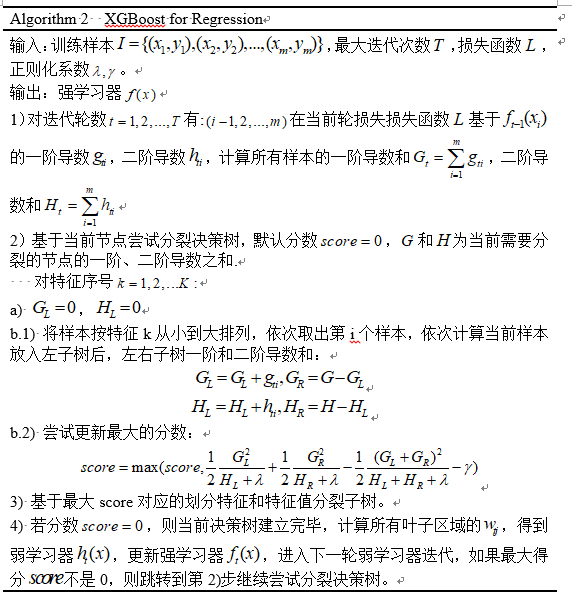

(2) 算法原理

(3) 算法实现--python

from sklearn.model_selection import train_test_split

from sklearn import metrics

import xgboost as xgb

import matplotlib.pyplot as plt

from sklearn.model_selection import GridSearchCV

import pandas as pd, numpy as np

import matplotlib as mpl # mpl.rcParams['font.sans-serif']=['FangSong']

# mpl.rcParams['axes.unicode_minus']=False fpath = r".\processData\filter.csv"

Dataset = pd.read_csv(fpath) x = Dataset.loc[:, "nAcid":"Zagreb"]

y1 = Dataset.loc[:, "IC50_nM"]

y2 = Dataset.loc[:, "pIC50"] names = x.columns

names = list(names)

key = list(range(0, len(names)))

names_dict = dict(zip(key, names))

names_dicts = pd.DataFrame([names_dict]) x_train, x_test, y_train, y_test = train_test_split(x, y2, test_size=0.33, random_state=7)

"""

max_depth:树的最大深度

"""

model = xgb.XGBRegressor(max_depth=6, learning_rate=0.12, n_estimators=90, min_child_weight=6, objective="reg:gamma")

model.fit(x_train, y_train) feature_important = model.feature_importances_

rank_idx = np.argsort(feature_important)[::-1]

rank_idx30 = rank_idx[:30] rank_names30 = names_dicts.loc[:, rank_idx30]

label = rank_names30.values[0, :]

path1 = r"Xgboost排名前30的特征.csv"

pd.DataFrame(label).to_csv(path1, index=False) x_score = np.sort(feature_important)[::-1]

path = r"Xgboost排名前30的得分.csv"

pd.DataFrame(x_score[:30]).to_csv(path, index=False)

# xgboost网格搜索调参

gsCv = GridSearchCV(model,

{'max_depth':list(range(3, 10, 1)),

'learning_rate':[0.03, 0.04, 0.05, 0.06, 0.07, 0.08, 0.09, 0.1, 0.12, 0.13, 0.14, 0.15, 0.16, 0.17, 0.18, 0.19, 0.2],

'min_child_weight':list(range(2, 8, 2)),

'n_estimators':list(range(10, 101, 10))}) gsCv.fit(x_train, y_train)

print(gsCv.best_params_)

cv_results = pd.DataFrame(gsCv.cv_results_)

path = r"paramRank.csv"

cv_results.to_csv(path, index=False) # 可视化

plt.figure()

plt.bar(range(len(model.feature_importances_)), model.feature_importances_)

plt.xlabel("Feature")

plt.ylabel("Feature Score")

plt.title("Feature Importance")

plt.savefig("Xgboost") # 可视化

plt.figure()

plt.barh(label[::-1], x_score[:30][::-1], 0.6, align='center')

plt.grid(ls=':', color='gray', alpha=0.4)

plt.title("Xgboost Feature Importance")

# 添加数据标签

# for a, b in enumerate(rf_score[:30][::-1]):

# plt.text(b+0.1, a-0.6/2, '%s' % b, ha='center', va='bottom') plt.savefig("前30名特征")

plt.show()

注意:该算法没有数据是不能运行的,需要做适当的修改,后面使用网格调参,找到最优参数。

(4) 算法可视化

XGBoost特征选择的更多相关文章

- xgboost 特征选择,筛选特征的正要性

import pandas as pd import xgboost as xgb import operator from matplotlib import pylab as plt def ce ...

- 从信用卡欺诈模型看不平衡数据分类(1)数据层面:使用过采样是主流,过采样通常使用smote,或者少数使用数据复制。过采样后模型选择RF、xgboost、神经网络能够取得非常不错的效果。(2)模型层面:使用模型集成,样本不做处理,将各个模型进行特征选择、参数调优后进行集成,通常也能够取得不错的结果。(3)其他方法:偶尔可以使用异常检测技术,IF为主

总结:不平衡数据的分类,(1)数据层面:使用过采样是主流,过采样通常使用smote,或者少数使用数据复制.过采样后模型选择RF.xgboost.神经网络能够取得非常不错的效果.(2)模型层面:使用模型 ...

- XGBoost、LightGBM的详细对比介绍

sklearn集成方法 集成方法的目的是结合一些基于某些算法训练得到的基学习器来改进其泛化能力和鲁棒性(相对单个的基学习器而言)主流的两种做法分别是: bagging 基本思想 独立的训练一些基学习器 ...

- Stacking:Catboost、Xgboost、LightGBM、Adaboost、RF etc

python风控评分卡建模和风控常识(博客主亲自录制视频教程) https://study.163.com/course/introduction.htm?courseId=1005214003&am ...

- Xgboost总结

从决策树.随机森林.GBDT最终到XGBoost,每个热门算法都不是孤立存在的,而是基于一系列算法的改进与优化.决策树算法简单易懂可解释性强,但是过拟合风险很大,应用场景有限:随机森林采用Baggin ...

- Python机器学习笔记:XgBoost算法

前言 1,Xgboost简介 Xgboost是Boosting算法的其中一种,Boosting算法的思想是将许多弱分类器集成在一起,形成一个强分类器.因为Xgboost是一种提升树模型,所以它是将许多 ...

- 机器学习-树模型理论(GDBT,xgboost,lightBoost,随机森林)

tree based ensemble algorithms 主要介绍以下几种ensemble的分类器(tree based algorithms) xgboost lightGBM: 基于决策树算法 ...

- 随机森林RF、XGBoost、GBDT和LightGBM的原理和区别

目录 1.基本知识点介绍 2.各个算法原理 2.1 随机森林 -- RandomForest 2.2 XGBoost算法 2.3 GBDT算法(Gradient Boosting Decision T ...

- RF/GBDT/XGBoost/LightGBM简单总结(完结)

这四种都是非常流行的集成学习(Ensemble Learning)方式,在本文简单总结一下它们的原理和使用方法. Random Forest(随机森林): 随机森林属于Bagging,也就是有放回抽样 ...

随机推荐

- Netcat基础使用

netcat命令选项 本文参考文章链接 本文参考文章链接1 本文参考文章链接2 本文参考文章链接3 常用命令选项 ## 网络模式和代理相关 -l 监听,作服务器.不填时作客户端. -u UDP模式.不 ...

- [loj3366]嘉年华奖券

联系绝对值的几何意义/分类讨论,不难发现若$n$张奖券上的数从小到大依次为$a_{i}$,则收益为$\sum_{i=1}^{\frac{n}{2}}a_{i+\frac{n}{2}}-a_{i}$ 假 ...

- [hdu6761]Minimun Index

$lyndon\ word$(以下简写为Lw):对于一个字符串s,其为Lw当且仅当其的最小后缀为自身 性质:若$u<v$为LW,那么$uv$也为Lw(反证法即可证) $lyndon$分解:将一个 ...

- 1、使用ValueOperations操作redis(String字符串)

文章来源:https://www.cnblogs.com/shiguotao-com/p/10559997.html 方法 c参数 s说明 void set(K key, V value); ke ...

- 前台json遍历拼装

//添加角色. $.ajax({ type: "post", url: "/sysRole/list", data: {page: 1, limit: 1000 ...

- uniapp中vuex的基本使用

1. 创建一个uniapp项目 2. 在项目目录下用npm安装 vuex npm install vuex --save 3. 在项目根目录下创建 store文件夹,在store文件夹中创建 inde ...

- CF1418G Three Occurrences

统计满足某些性质的区间个数. 我们考虑移动 \(r\) 指针. 然后考虑把不能选的区间 \(ban\)掉. 具体看下细节吧. #include<iostream> #include< ...

- 【贾志豪NOIP模拟题】慰问员工 cheer 【最小生成树】【对边权值的一些处理】

Description LongDD 变得非常懒, 他不想再继续维护供员工之间供通行的道路. 道路被用来连接 N(5 <= N <= 10,000)个房子, 房子被连续地编号为 1..N. ...

- P5599【XR-4】文本编辑器

题目传送门. 题意简述:给定长度为 \(n\) 的文本串 \(a\) 和有 \(m\) 个单词的字典 \(s_i\).\(q\) 次操作,每次求出字典内所有单词在 \(a[l,r]\) 的出现次数,或 ...

- pcm.x代码分析

简介 运行说明 pcm 监控结果可以分为核心.socket 和系统三部分.在核心监控部分,结果包括如下内容: • EXEC • IPC:每 CPU 周期指令数 • FREQ:普通CPU频率系数 • A ...