缓存算法LRU笔记

LRU原理与分析

LRU是Least Recently Used 的缩写,翻译过来就是“最近最少使用”,也就是说,LRU缓存把最近最少使用的数据移除,让给最新读取的数据。而往往最常读取的,也是读取次数最多的,所以,利用LRU缓存,我们能够提高系统的performance.

LRU实现

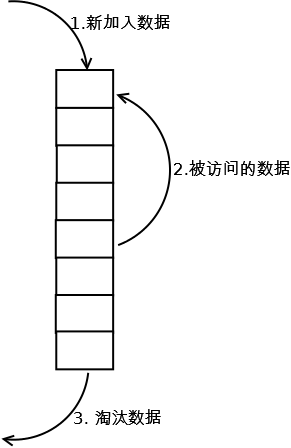

1. 新数据插入到链表头部;

2. 每当缓存命中(即缓存数据被访问),则将数据移到链表头部;

3. 当链表满的时候,将链表尾部的数据丢弃。

LRU分析

【命中率】

当存在热点数据时,LRU的效率很好,但偶发性的、周期性的批量操作会导致LRU命中率急剧下降,缓存污染情况比较严重。

【复杂度】

实现简单。

【代价】

命中时需要遍历链表,找到命中的数据块索引,然后需要将数据移到头部。

LRU实现

细节

添加元素时,放到链表头

缓存命中,将元素移动到链表头

缓存满了之后,将链表尾的元素删除

LRU算法实现

- 可以用一个双向链表保存数据

- 使用hash实现O(1)的访问

groupcache中LRU算法实现(Go语言)

https://github.com/golang/groupcache/blob/master/lru/lru.go

源码简单注释:

package lru import "container/list" // Cache 结构体,定义lru cache 不是线程安全的

type Cache struct {

// 数目限制,0是无限制

MaxEntries int // 删除时, 可以添加可选的回调函数

OnEvicted func(key Key, value interface{}) ll *list.List // 使用链表保存数据

cache map[interface{}]*list.Element // map

} // Key 是任何可以比较的值 http://golang.org/ref/spec#Comparison_operators

type Key interface{} type entry struct {

key Key

value interface{}

} // 创建新的cache 对象

func New(maxEntries int) *Cache {

return &Cache{

MaxEntries: maxEntries,

ll: list.New(),

cache: make(map[interface{}]*list.Element),

}

} // 添加新的值到cache里

func (c *Cache) Add(key Key, value interface{}) {

if c.cache == nil {

c.cache = make(map[interface{}]*list.Element)

c.ll = list.New()

}

if ee, ok := c.cache[key]; ok {

// 缓存命中移动到链表的头部

c.ll.MoveToFront(ee)

ee.Value.(*entry).value = value

return

}

// 添加数据到链表头部

ele := c.ll.PushFront(&entry{key, value})

c.cache[key] = ele

if c.MaxEntries != 0 && c.ll.Len() > c.MaxEntries {

// 满了删除最后访问的元素

c.RemoveOldest()

}

} // 从cache里获取值.

func (c *Cache) Get(key Key) (value interface{}, ok bool) {

if c.cache == nil {

return

}

if ele, hit := c.cache[key]; hit {

// 缓存命中,将命中元素移动到链表头

c.ll.MoveToFront(ele)

return ele.Value.(*entry).value, true

}

return

} // 删除指定key的元素

func (c *Cache) Remove(key Key) {

if c.cache == nil {

return

}

if ele, hit := c.cache[key]; hit {

c.removeElement(ele)

}

} // 删除最后访问的元素

func (c *Cache) RemoveOldest() {

if c.cache == nil {

return

}

ele := c.ll.Back()

if ele != nil {

c.removeElement(ele)

}

} func (c *Cache) removeElement(e *list.Element) {

c.ll.Remove(e)

kv := e.Value.(*entry)

delete(c.cache, kv.key)

if c.OnEvicted != nil {

c.OnEvicted(kv.key, kv.value)

}

} // cache 缓存数

func (c *Cache) Len() int {

if c.cache == nil {

return 0

}

return c.ll.Len()

}

LRU-K

LRU-K中的K代表最近使用的次数,因此LRU可以认为是LRU-1。LRU-K的主要目的是为了解决LRU算法“缓存污染”的问题,其核心思想是将“最近使用过1次”的判断标准扩展为“最近使用过K次”。

实现

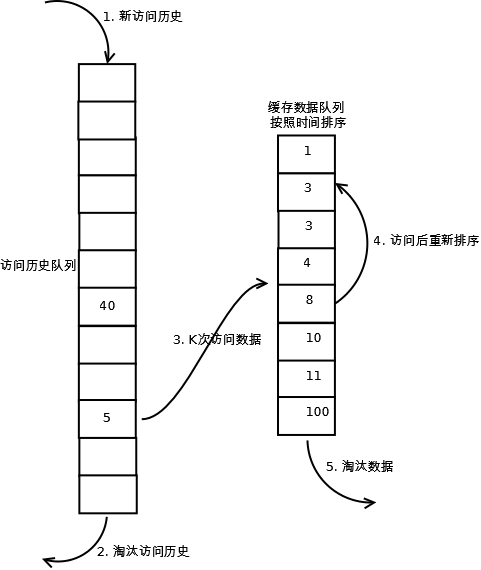

相比LRU,LRU-K需要多维护一个队列,用于记录所有缓存数据被访问的历史。只有当数据的访问次数达到K次的时候,才将数据放入缓存。当需要淘汰数据时,LRU-K会淘汰第K次访问时间距当前时间最大的数据。详细实现如下:

1. 数据第一次被访问,加入到访问历史列表;

2. 如果数据在访问历史列表里后没有达到K次访问,则按照一定规则(FIFO,LRU)淘汰;

3. 当访问历史队列中的数据访问次数达到K次后,将数据索引从历史队列删除,将数据移到缓存队列中,并缓存此数据,缓存队列重新按照时间排序;

4. 缓存数据队列中被再次访问后,重新排序;

5. 需要淘汰数据时,淘汰缓存队列中排在末尾的数据,即:淘汰“倒数第K次访问离现在最久”的数据。

LRU-K具有LRU的优点,同时能够避免LRU的缺点,实际应用中LRU-2是综合各种因素后最优的选择,LRU-3或者更大的K值命中率会高,但适应性差,需要大量的数据访问才能将历史访问记录清除掉。

分析

【命中率】

LRU-K降低了“缓存污染”带来的问题,命中率比LRU要高。

【复杂度】

LRU-K队列是一个优先级队列,算法复杂度和代价比较高。

【代价】

由于LRU-K还需要记录那些被访问过、但还没有放入缓存的对象,因此内存消耗会比LRU要多;当数据量很大的时候,内存消耗会比较可观。

LRU-K需要基于时间进行排序(可以需要淘汰时再排序,也可以即时排序),CPU消耗比LRU要高。

缓存算法LRU笔记的更多相关文章

- 缓存算法–LRU

LRU LRU是Least Recently Used 的缩写,翻译过来就是“最近最少使用”,也就是说,LRU缓存把最近最少使用的数据移除,让给最新读取的数据.而往往最常读取的,也是读取次数最多的,所 ...

- Android图片缓存之Lru算法

前言: 上篇我们总结了Bitmap的处理,同时对比了各种处理的效率以及对内存占用大小.我们得知一个应用如果使用大量图片就会导致OOM(out of memory),那该如何处理才能近可能的降低oom发 ...

- 面试挂在了 LRU 缓存算法设计上

好吧,有人可能觉得我标题党了,但我想告诉你们的是,前阵子面试确实挂在了 RLU 缓存算法的设计上了.当时做题的时候,自己想的太多了,感觉设计一个 LRU(Least recently used) 缓存 ...

- 缓存算法(FIFO 、LRU、LFU三种算法的区别)

FIFO算法 FIFO 算法是一种比较容易实现的算法.它的思想是先进先出(FIFO,队列),这是最简单.最公平的一种思想,即如果一个数据是最先进入的,那么可以认为在将来它被访问的可能性很小.空间满的时 ...

- Android图片缓存之Lru算法(二)

前言: 上篇我们总结了Bitmap的处理,同时对比了各种处理的效率以及对内存占用大小.我们得知一个应用如果使用大量图片就会导致OOM(out of memory),那该如何处理才能近可能的降低oom发 ...

- Android ImageCache图片缓存,使用简单,支持预取,支持多种缓存算法,支持不同网络类型,扩展性强

本文主要介绍一个支持图片自动预取.支持多种缓存算法的图片缓存的使用及功能.图片较大需要SD卡保存情况推荐使用ImageSDCardCache. 与Android LruCache相比主要特性:(1). ...

- 缓存算法之belady现象

前言 在使用FIFO算法作为缺页置换算法时,分配的缺页增多,但缺页率反而提高,这样的异常现象称为belady Anomaly. 虽然这种现象说明的场景是缺页置换,但在运用FIFO算法作为缓存算法时,同 ...

- android上的缓存、缓存算法和缓存框架

1.使用缓存的目的 缓存是存取数据的临时地,因为取原始数据代价太大了,加了缓存,可以取得快些.缓存可以认为是原始数据的子集,它是从原始数据里复制出来的,并且为了能被取回,被加上了标志. 在andr ...

- java缓存算法【转】

http://my.oschina.net/u/866190/blog/188712 提到缓存,不得不提就是缓存算法(淘汰算法),常见算法有LRU.LFU和FIFO等算法,每种算法各有各的优势和缺点及 ...

随机推荐

- 阶段3 1.Mybatis_11.Mybatis的缓存_8 mybatis的二级缓存

二级缓存: 它指的是Mybatis中SqlSessionFactory对象的缓存.由同一个SqlSessionFactory对象创建的SqlSession共享其缓存. ...

- HTTP学习记录:一、协议基础

学习资源主要为:@小坦克HTTP相关博客 1.HTTP简介: HTTP协议是Hyper Text Transfer Portocol(超文本传输协议)的缩写,它是一种通信协议,允许将超文本(即:htm ...

- C# 文件打开对话框 图片fitter

"All Image Files|*.bmp;*.ico;*.gif;*.jpeg;*.jpg;*.png;*.tif;*.tiff|""Windows Bitmap(* ...

- spring boot + mybatis 连接 oracle 出现 ORA-00923: 未找到要求的 FROM 关键字 错误

1.原因 hikari 连接池配置错误,mysql和oracle的配置不一样 2.修改 spring: datasource: hikari: connection-test-query: selec ...

- mysql --> select * from Employee group by name这样的语法有什么意义?

神奇的mysql才会支持select * from Employee group by name 这种反逻辑的SQL(假定该表非仅name一个列) mysql 的逻辑是:select 的返回字段,如果 ...

- 虚拟化 RemoteApp 远程接入 源码 免费

远程接入 RemoteApp 虚拟化 源码 免费 1.终端安装与配置: 此远程接入组件的运行原理与瑞友天翼.异速连.CTBS等市面上常见的远程接入产品一样,是透过Windows的终端服务来实现的,速度 ...

- LTUI v1.1, 一个基于lua的跨平台字符终端UI界面库

简介 LTUI是一个基于lua的跨平台字符终端UI界面库. 此框架源于xmake中图形化菜单配置的需求,类似linux kernel的menuconf去配置编译参数,因此基于curses和lua实现了 ...

- input输入框的的input事件和change事件以及change和blur事件的区别

input输入框的 oninput事件 ,在用户输入的时候触发,只要元素值发生变化就会触发 input输入框的 onchange事件 ,要在输入框失去焦点的时候触发事件,当鼠标在其他地方点击一下才会触 ...

- tensorflow学习笔记七----------RNN

和神经网络不同的是,RNN中的数据批次之间是有相互联系的.输入的数据需要是要求序列化的. 1.将数据处理成序列化: 2.将一号数据传入到隐藏层进行处理,在传入到RNN中进行处理,RNN产生两个结果,一 ...

- Spring KafkaTemplate 注解式实现 工厂模式

实现注解式注入kafkaTemplate 生产者和消费者,简化配置文件 目录 消费者工厂 /** * 消费者工厂 */ @EnableKafka @Configuration public class ...