springboot中统一日志输出logback

1.背景

为了便于分析和记录系统的运行,一个系统输出其运行的关键日志是非常必要的

比如输出:请求参数、请求url、请求方式、执行的sql、重要操作的日志、响应结果等

而这些日志中,大部分不需要我们手动对每个接口去输出,主需要统一配置就可以了

2.实际生产运用步骤

步骤一:在resources下添加logback文件,这个问价基本上每个项目都是一样的,拷贝过来就可以使用

<?xml version="1.0" encoding="UTF-8"?>

<!--

scan:当此属性设置为true时,配置文件如果发生改变,将会被重新加载,默认值为true。

scanPeriod:设置监测配置文件是否有修改的时间间隔,如果没有给出时间单位,默认单位是毫秒;当scan为true时,此属性生效。默认的时间间隔为1分钟。

debug:当此属性设置为true时,将打印出logback内部日志信息,实时查看logback运行状态。默认值为false。

-->

<configuration scan="false" scanPeriod="60 seconds" debug="false">

<!--

property:定义变量,相当于java中定义一个 String name="张无忌";

变量名LOG_HOME,用于日志根目录文件夹定义,可以任意命名

变量名appName,用于日志文件名定义,可以任意命名

变量名logLevel,用于日志输出级别定义,可以为 debug,info,error

-->

<property name="LOG_HOME" value="logs"/>

<property name="appName" value="log"></property>

<property name="logLevel" value="info"></property>

<!-- 获取当前日期,一般生产上按照每天一个文件夹,文件夹的名称就是年月日

<timestamp key="dateTime" datePattern="yyyy-MM-dd"/>

-->

<!--

1.ch.qos.logback.core.ConsoleAppender 表示控制台输出

2.name 可以任意取名字

3.每个appender为一个日志类型

-->

<appender name="stdout" class="ch.qos.logback.core.ConsoleAppender">

<!--

日志输出格式:

%d表示日期时间,

%thread表示线程名,

%-5level:级别从左显示5个字符宽度

%logger{50} 表示logger名字最长50个字符,否则按照句点分割。

%msg:日志消息,

%n是换行符 一般不输出年份 案例一:<pattern>%d{yyyy-MM-dd HH:mm:ss.SSS} ==> [%thread] ==> %-5level %logger{50} - %msg%n</pattern>

-->

<encoder>

<pattern>%d{MM-dd HH:mm:ss.SSS} [%thread] %level %logger{50} - %msg%n</pattern>

<charset>UTF-8</charset>

</encoder>

</appender> <!-- 滚动记录文件,先将日志记录到指定文件,当符合某个条件时,将日志记录到其他文件 -->

<appender name="all" class="ch.qos.logback.core.rolling.RollingFileAppender">

<!--append:如果是 true,日志被追加到文件结尾,如果是 false,清空现存文件,默认是true。-->

<append>true</append>

<!-- 日志输出等级

如果需要输出mybatis执行的sql日志,需要使用debug

-->

<filter class="ch.qos.logback.classic.filter.ThresholdFilter">

<level>debug</level>

</filter>

<!-- 指定日志文件的名称与输出位置 -->

<file>${LOG_HOME}/${appName}-all.log</file>

<!--

归档日志处理规则

当发生滚动时,决定 RollingFileAppender 的行为,涉及文件移动和重命名

TimeBasedRollingPolicy: 最常用的滚动策略,它根据时间来制定滚动策略,既负责滚动也负责出发滚动。

-->

<rollingPolicy class="ch.qos.logback.core.rolling.TimeBasedRollingPolicy">

<!--

滚动时产生的文件的存放位置及文件名称 %d{yyyy-MM-dd}:按天进行日志滚动

%i:当文件大小超过maxFileSize时,按照i进行文件滚动

.zip:表示生成的归档文件进行压缩

-->

<fileNamePattern>${LOG_HOME}/%d{yyyy-MM-dd}/${appName}-all.%d.%i.log.zip</fileNamePattern>

<!--

可选节点,控制保留的归档文件的最大数量,超出数量就删除旧文件。假设设置每天滚动,

且maxHistory是30,则只保存最近30天的文件,删除之前的旧文件。注意,删除旧文件是,

那些为了归档而创建的目录也会被删除。

实际生中一般日志保留30天,可以根据特殊业务设置保留时间

-->

<MaxHistory>30</MaxHistory>

<!--

当日志文件超过maxFileSize指定的大小时,根据上面提到的%i进行日志文件滚动

注意此处配置SizeBasedTriggeringPolicy是无法实现按文件大小进行滚动的,必须配置timeBasedFileNamingAndTriggeringPolicy

一般10M一个文件

这里为了测试滚动产生日志文件,设置为10KB

-->

<timeBasedFileNamingAndTriggeringPolicy class="ch.qos.logback.core.rolling.SizeAndTimeBasedFNATP">

<maxFileSize>10KB</maxFileSize>

<!--<maxFileSize>10MB</maxFileSize>-->

</timeBasedFileNamingAndTriggeringPolicy>

</rollingPolicy>

<!--

日志输出格式:

%d表示日期时间,

%thread表示线程名,

%-5level:级别从左显示5个字符宽度

%logger{50} 表示logger名字最长50个字符,否则按照句点分割。

%msg:日志消息,

%line: 行号显示,建议删除,这个有很多的性能损耗,报错的时候有堆栈信息

%n是换行符

案例: <pattern>%d{yyyy-MM-dd HH:mm:ss.SSS} [ %thread ] - [ %-5level ] [ %logger{50} : %line ] - %msg%n</pattern>

-->

<encoder class="ch.qos.logback.classic.encoder.PatternLayoutEncoder">

<pattern>%d{MM-dd HH:mm:ss.SSS} [%thread] %level - %msg%n</pattern>

<charset>UTF-8</charset>

</encoder>

</appender> <!--输出到error-->

<appender name="error" class="ch.qos.logback.core.rolling.RollingFileAppender">

<append>true</append>

<filter class="ch.qos.logback.classic.filter.ThresholdFilter">

<level>error</level>

</filter>

<file>${LOG_HOME}/${appName}-error.log</file>

<rollingPolicy class="ch.qos.logback.core.rolling.TimeBasedRollingPolicy">

<fileNamePattern>${LOG_HOME}/%d{yyyy-MM-dd}/${appName}-error.%d.%i.log.zip</fileNamePattern>

<MaxHistory>30</MaxHistory>

<timeBasedFileNamingAndTriggeringPolicy class="ch.qos.logback.core.rolling.SizeAndTimeBasedFNATP">

<maxFileSize>10MB</maxFileSize>

</timeBasedFileNamingAndTriggeringPolicy>

</rollingPolicy>

<encoder class="ch.qos.logback.classic.encoder.PatternLayoutEncoder">

<pattern>%d{MM-dd HH:mm:ss.SSS} [%thread] %level - %msg%n</pattern>

<charset>UTF-8</charset>

</encoder>

</appender> <!--

logger主要用于存放日志对象,也可以定义日志类型、级别

name:表示匹配的logger类型前缀,也就是包的前半部分

level:要记录的日志级别,包括 TRACE < DEBUG < INFO < WARN < ERROR

additivity:作用在于children-logger是否使用 rootLogger配置的appender进行输出,

false:表示只用当前logger的appender-ref,true:

表示当前logger的appender-ref和rootLogger的appender-ref都有效 root与logger是父子关系,没有特别定义则默认为root,任何一个类只会和一个logger对应,

要么是定义的logger,要么是root,判断的关键在于找到这个logger,然后判断这个logger的appender和level。

-->

<root level="${logLevel}">

<appender-ref ref="stdout"/>

<appender-ref ref="all"/>

<appender-ref ref="error"/>

</root>

</configuration>

步骤二:添加一个过滤器,在过滤器中统一输出日志

package com.ldp.user.common.interceptor; import cn.hutool.core.util.RandomUtil;

import cn.hutool.core.util.StrUtil;

import cn.hutool.extra.servlet.ServletUtil;

import lombok.extern.slf4j.Slf4j;

import org.springframework.http.HttpHeaders;

import org.springframework.http.MediaType;

import org.springframework.stereotype.Component; import javax.servlet.*;

import javax.servlet.http.HttpServletResponse;

import java.io.IOException; /**

* @Copyright (C) XXXXX科技有限公司

* @Author: LI DONG PING

* @Date: 2019/4/22 17:47

* @Description:

*/

@Component

@Slf4j

public class HttpServletRequestWrapperFilter implements Filter {

private final String CHARSET = "UTF-8"; @Override

public void doFilter(ServletRequest request, final ServletResponse response, FilterChain chain) throws IOException, ServletException {

// 自定义线程名称

Thread.currentThread().setName(RandomUtil.randomString(10));

MultiReadHttpServletRequest requestWrapper = new MultiReadHttpServletRequest(request);

ResponseWrapper responseWrapper = new ResponseWrapper((HttpServletResponse) response, CHARSET);

String contentType = requestWrapper.getHeader(HttpHeaders.CONTENT_TYPE);

String url = requestWrapper.getRequestURL().toString();

if (url.contains("actuator") || url.contains("swagger") || url.contains("csrf")) {

chain.doFilter(requestWrapper, responseWrapper);

byte[] bytes = responseWrapper.getBytes();

response.getOutputStream().write(bytes);

return;

}

if (!url.contains("actuator")) {

log.info("ContentType: {}", contentType);

log.info("请求地址: {}", url);

log.info("请求方法: {}", requestWrapper.getMethod().toUpperCase());

if (isTextContentType(contentType)) {

String params = requestWrapper.getQueryString();

if (!StrUtil.isEmpty(params)) {

log.info("请求参数: {}", params);

}

String body = ServletUtil.getBody(requestWrapper);

if (!StrUtil.isEmpty(body)) {

log.info("请求参数[body]: {}", body);

}

}

long start = System.currentTimeMillis();

chain.doFilter(requestWrapper, responseWrapper);

long end = System.currentTimeMillis();

byte[] bytes = responseWrapper.getBytes();

if (isTextContentType(response.getContentType())) {

try {

log.info("响应结果: {}", new String(bytes, CHARSET));

} catch (Exception ex) {

log.error("响应异常", ex);

}

}

log.info("HTTP状态: {}", responseWrapper.getStatus());

long diff = end - start;

if (diff < 1000) {

log.info("处理时长: {}毫秒", diff);

} else {

log.error("处理时长: {}毫秒,url:{}", diff, url);

}

response.getOutputStream().write(bytes);

} else {

chain.doFilter(requestWrapper, responseWrapper);

byte[] bytes = responseWrapper.getBytes();

response.getOutputStream().write(bytes);

}

} private boolean isTextContentType(String contentType) {

return contentType != null && (contentType.contains(MediaType.TEXT_PLAIN_VALUE) ||

contentType.contains(MediaType.TEXT_XML_VALUE) ||

contentType.contains(MediaType.TEXT_HTML_VALUE) ||

contentType.contains(MediaType.APPLICATION_FORM_URLENCODED_VALUE) ||

contentType.contains(MediaType.APPLICATION_JSON_VALUE) ||

contentType.contains(MediaType.APPLICATION_XML_VALUE));

}

}

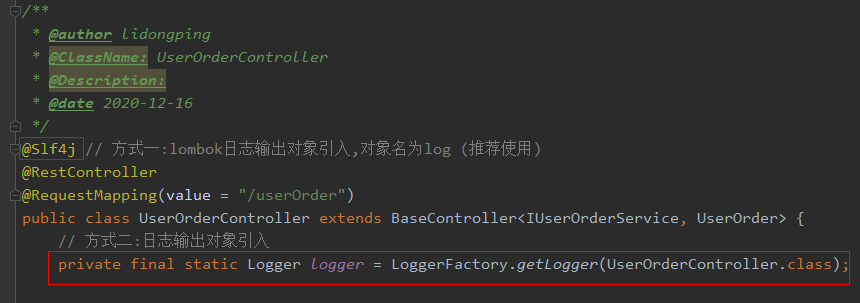

步骤三:引入日志输出对象

// 方式一:lombok日志输出对象引入,变量名为log (推荐使用)

@Slf4j // 方式二:日志输出对象引入 变量名为logger

private final static Logger logger = LoggerFactory.getLogger(UserOrderController.class);

步骤四:使用

/**

* 测试统一日志输出

*

* @param message

* @return

*/

@GetMapping("/log")

public BaseResponse log(String message) {

// 注意这个System.out.println的输出,只会输出到控制台,不能输出到日志文件,

// 而且效率很低,只用于平时开发,实际生产几乎不可能使用

System.out.println("message=" + message);

logger.debug("debug日志输出,message={}", message);

// 这两种写法一样

logger.debug("debug日志输出,message=" + message);

logger.info("info日志输出,message={}", message);

logger.error("error 日志输出,message={}", message);

// 模拟输出错误堆栈信息

try {

if ("abc".equals(message)) {

Integer value = Integer.valueOf(message);

logger.info("value=" + value);

}

} catch (Exception e) {

logger.error("数字转换异常:", e.getMessage());

logger.error("数字转换异常:", e);

}

// 不处理的异常

Integer value2 = Integer.valueOf(message);

logger.info("value2=" + value2);

return ResponseBuilder.success("统一参数检查.....");

}

步骤五:模拟请求测试

/**

* 统一日志输出测试

*/

@Test

void logTest() {

String url = urlLocal + "/userOrder/log";

System.out.println("请求地址:" + url);

HttpRequest request = HttpUtil.createRequest(Method.GET, url);

Map<String, Object> map = new TreeMap<>();

// 业务参数

map.put("message", "1000"); // 公用参数

map.put("appid", "1001");

map.put("sequenceId", "seq" + System.currentTimeMillis());

map.put("timeStamp", System.currentTimeMillis());

map.put("sign", signApi(map, "123456"));

request.form(map);

System.out.println("请求参数:" + map);

request.header("Authorization", token);

request.setConnectionTimeout(60 * 1000);

String response = request.execute().body();

System.out.println("请求结果:" + response);

}

日志输出结果:

01-02 08:59:51.760 [rptudgh22m] INFO com.ldp.user.controller.UserOrderController - info日志输出,message=1000

01-02 08:59:51.760 [rptudgh22m] ERROR com.ldp.user.controller.UserOrderController - error 日志输出,message=1000

01-02 08:59:51.760 [rptudgh22m] INFO com.ldp.user.controller.UserOrderController - value2=1000

01-02 08:59:51.796 [rptudgh22m] INFO c.l.u.c.i.HttpServletRequestWrapperFilter - 响应结果: {"message":"success","code":100,"data":"统一参数检查....."}

01-02 08:59:51.797 [rptudgh22m] INFO c.l.u.c.i.HttpServletRequestWrapperFilter - HTTP状态: 200

01-02 08:59:51.798 [rptudgh22m] INFO c.l.u.c.i.HttpServletRequestWrapperFilter - 处理时长: 275毫秒

生成的日志文件夹

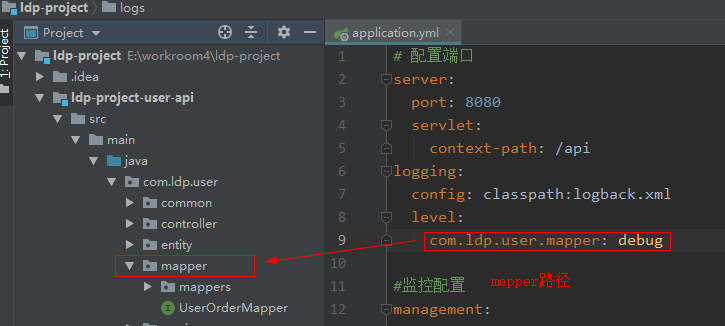

3.mybatis中sql日志输出

步骤一:配置

步骤二:sql输出

/**

* 测试统一sql日志输出

*

* @param message

* @return

*/

@GetMapping("/logSql")

public BaseResponse logSql(String message) {

logger.info("message=" + message);

List<UserOrder> list = service.list(null);

return ResponseBuilder.success(list);

}

步骤三:测试

/**

* 统一日志输出测试

*/

@Test

void logTest() {

for (int i = 100; i < 200; i++) {

String url = urlLocal + "/userOrder/logSql";

System.out.println("请求地址:" + url);

HttpRequest request = HttpUtil.createRequest(Method.GET, url);

Map<String, Object> map = new TreeMap<>();

// 业务参数

map.put("message", i); // 公用参数

map.put("appid", "1001");

map.put("sequenceId", "seq" + System.currentTimeMillis());

map.put("timeStamp", System.currentTimeMillis());

map.put("sign", signApi(map, "123456"));

request.form(map);

System.out.println("请求参数:" + map);

request.header("Authorization", token);

request.setConnectionTimeout(60 * 1000);

String response = request.execute().body();

System.out.println("请求结果:" + response);

}

}

测试结果

01-02 09:47:34.119 [l280fegb2i] INFO com.ldp.user.controller.UserOrderController - message=199

01-02 09:47:34.119 [l280fegb2i] DEBUG com.ldp.user.mapper.UserOrderMapper.selectList - ==> Preparing: SELECT id,`order_no`,`buy_account`,`status`,`product_name`,`price`,`pay_status`,`update_time`,`create_time`,`version`,`deleted` FROM `user_order`

01-02 09:47:34.119 [l280fegb2i] DEBUG com.ldp.user.mapper.UserOrderMapper.selectList - ==> Parameters:

01-02 09:47:34.134 [l280fegb2i] DEBUG com.ldp.user.mapper.UserOrderMapper.selectList - <== Total: 5

01-02 09:47:34.134 [l280fegb2i] INFO c.l.u.c.i.HttpServletRequestWrapperFilter - 响应结果: {"message":"success","code":100,"data":[{"id":1,"orderNo":"LDP001","buyAccount":"string","status":0,"productName":"string","price":0.0,"payStatus":0,"updateTime":"2020-12-16T10:28:25","createTime":"2020-12-16T10:28:25","version":0,"deleted":0},{"id":2,"orderNo":"LDP001","buyAccount":"string","status":0,"productName":"string","price":0.0,"payStatus":0,"updateTime":"2020-12-16T10:28:25","createTime":"2020-12-16T10:28:25","version":0,"deleted":0},{"id":3,"orderNo":"LDP001","buyAccount":"string","status":0,"productName":"string","price":0.0,"payStatus":0,"updateTime":"2020-12-16T10:28:25","createTime":"2020-12-16T10:28:25","version":0,"deleted":0},{"id":4,"orderNo":"LDP003","buyAccount":"wx001","status":null,"productName":"苹果手机","price":6990.0,"payStatus":null,"updateTime":null,"createTime":null,"version":0,"deleted":0},{"id":5,"orderNo":"NO003","buyAccount":"lidongping","status":null,"productName":"iPhone12","price":8000.0,"payStatus":null,"updateTime":null,"createTime":null,"version":0,"deleted":0}]}

01-02 09:47:34.134 [l280fegb2i] INFO c.l.u.c.i.HttpServletRequestWrapperFilter - HTTP状态: 200

01-02 09:47:34.134 [l280fegb2i] INFO c.l.u.c.i.HttpServletRequestWrapperFilter - 处理时长: 15毫秒

文字描述内容有限,如果还是不明白可以直接问我,或者在看视频讲解与演示

完美!

springboot中统一日志输出logback的更多相关文章

- Logback 整合 RabbitMQ 实现统一日志输出

原文地址:Logback 整合 RabbitMQ 实现统一日志输出 博客地址:http://www.extlight.com 一.前言 公司项目做了集群实现请求分流,由于线上或多或少会出现请求失败或系 ...

- SpringBoot中的日志使用:

SpringBoot中的日志使用(一) 一:日志简介: 常用的日志接口 commons-logging/slf4j 日志框架:log4j/logback/log4j2 日志接口屏蔽了日志框架的底层实现 ...

- springboot项目中的日志输出

#修改默认输出级别,trace < debug < info < warn < errorlogging.level.com.lagou=trace#控制台输出logging. ...

- logback在springBoot项目中的使用 springboot中使用日志进行持久化保存日志信息

文章目录 1.xml文件的编写 2.实现的效果 2.1 日志保存到磁盘 2.2 控制台输出的效果 放置的位置 1.xml文件的编写 logback-spring.xml <?xml versio ...

- SpringBoot(三) SpringBoot中的日志配置

SLF4J Spring Boot在所有内部日志中使用Commons Logging,但是默认配置也提供了对常用日志的支持,如:Java Util Logging,Log4J, Log4J2和Logb ...

- springboot开启access_log日志输出

由于在调试时需要查看access_log日志,但是springboot默认并没有开启,因此查看了一下文档,在springboot的配置文件中添加如下设置,即可将日志输出当磁盘文件中以供查看. #日志开 ...

- Spring AOP实现统一日志输出

目的: 统一日志输出格式 思路: 1.针对不同的调用场景定义不同的注解,目前想的是接口层和服务层. 2.我设想的接口层和服务层的区别在于: (1)接口层可以打印客户端IP,而服务层不需要 (2)接口层 ...

- SpringBoot中的日志

默认情况下,Spring Boot会用SLF4J + Logback来记录日志,并用INFO级别输出到控制台. SLF4J,即简单日志门面(Simple Logging Facade for Java ...

- Springboot中使用ibatis输出日志

logging.level.org.apache.ibatis=DEBUG logging.level.org.mybatis=DEBUG logging.level.java.sql.Connect ...

- springboot中的日志配置

日志方式:每天日志存放在一个文件中,info和warn日志存放一个文件,error存放一个文件 创建文件 logback-spring.xml <?xml version="1.0&q ...

随机推荐

- 以 ZGC 为例,谈一谈 JVM 是如何实现 Reference 语义的

本文基于 OpenJDK17 进行讨论 1. Reference 相关概念及其应用场景总览 Reference(引用)是 JVM 中非常核心且重要的一个概念,垃圾回收器判断一个对象存活与否都是围绕着这 ...

- MegaCli命令使用整理

1. 软件安装 rpm -ivh Lib_Utils-1.00-09.noarch.rpm rpm -ivh MegaCli-8.02.21-1.noarch.rpm 2. 常用命令 /opt/Meg ...

- nginx 反向代理(proxy)与负载均衡(upstream)应用实践

集群介绍 集群就是指一组(若干个)相互独立的计算机,利用高速通信网络组成的一个较大的计算机服务系统,每个集群节点(即集群中的每台计算机)都是运行各自服务的独立服务器.这些服务器之间可以彼此通信,协同向 ...

- 在 AWS 平台搭建 DolphinScheduler

AWS平台搭建 DolphinScheduler DolphinScheduler 是当前热门的调度器,提供了完善的可视化.拖拉拽式的调度.在 AWS 平台上提供了 airflow 与 step fu ...

- 高通Android Cam-x Actuator Bring up

高通Android Camera Bring Up Actuator reference:https://blog.csdn.net/mr_zjc/article/details/105736925 ...

- Nuxt3 的生命周期和钩子函数(八)

title: Nuxt3 的生命周期和钩子函数(八) date: 2024/6/30 updated: 2024/6/30 author: cmdragon excerpt: 摘要:本文介绍了Nuxt ...

- 两张图带你全面了解React状态管理库:zustand和jotai

zustand 和 jotai 是当下比较流行的react状态管理库.其都有着轻量.方便使用,和react hooks能够很好的搭配,并且性能方面,对比React自身提供的context要好得多,因此 ...

- Cannot add or update a child row: a foreign key constraint fails

在使用Django添加用户时出现报错: 1 django.db.utils.IntegrityError: (1452, 'Cannot add or update a child row: a fo ...

- 算法金 | 最难的来了:超参数网格搜索、贝叶斯优化、遗传算法、模型特异化、Hyperopt、Optuna、多目标优化、异步并行优化

大侠幸会,在下全网同名「算法金」 0 基础转 AI 上岸,多个算法赛 Top 「日更万日,让更多人享受智能乐趣」 今日 215/10000 为模型找到最好的超参数是机器学习实践中最困难的部分之一 ...

- 记一次 .NET某上位视觉程序 离奇崩溃分析

一:背景 1. 讲故事 前段时间有位朋友找到我,说他们有一个崩溃的dump让我帮忙看下怎么回事,确实有太多的人在网上找各种故障分析最后联系到了我,还好我一直都是免费分析,不收取任何费用,造福社区. 话 ...