【pytorch】学习笔记(四)-搭建神经网络进行关系拟合

【pytorch学习笔记】-搭建神经网络进行关系拟合

目标

1.创建一些围绕y=x^2+噪声这个函数的散点

2.用神经网络模型来建立一个可以代表他们关系的线条

建立数据集

import torch

from torch.autograd import Variable

import torch.nn.functional as F

import matplotlib.pyplot as plt

x=torch.unsqueeze(torch.linspace(-1,1,100),dim=1)#一维变二维,x从-1到1,切分为100份

y=x.pow(2)+0.2*torch.rand(x.size())#创建一些围绕着这y=x^2的随机点的散点

# plt.scatter(x.data.numpy(),y.data.numpy())#画图

# plt.show()

x,y=Variable(x),Variable(y)#构造神经网络要使用Variable类型

建立神经网络

1.继承torch.nn.Module模块

2.定义__init__函数,在初始化函数中定义输入层到隐藏层,从隐藏层再到输出层各个层的神经元个数

3.再一层层搭建(forward(x))层于层的关系链接

class Net(torch.nn.Module):

def __init__(self,n_feature,n_hidden,n_ouput):#初始化信息

super(Net, self).__init__()

self.hidden=torch.nn.Linear(n_feature,n_hidden,n_ouput)#隐藏层线性输出

self.predict=torch.nn.Linear(n_hidden,n_ouput)#输出层线性输出

def forward(self,x):#前向传递的过程

#正向传播输入值,神经网络输出预测值

x=F.relu(self.hidden(x))#激励函数加工一下

x=self.predict(x)#输出值预测值

return x

训练神经网络

1.定义训练工具optimizer,输入神经网络参数和学习效率

2.定义误差函数,使用均方差来计算实际值y和训练输出值之间的误差

3.每次训练向神经网络输入x,得到预测值,计算误差

4.注意要清空上一步的残余更新参数值

5.误差反向传播, 计算参数更新值

6.将参数更新值施加到 net 的 parameters 上

for t in range(200):#训练200次

prediction=net(x)#输入输入值

loss=loss_func(prediction,y)#计算误差预测值和真实值之间的误差,注意位置

optimizer.zero_grad()#梯度清零

loss.backward()#反向传递

optimizer.step()#优化梯度

可视化训练过程

for t in range(200):#训练200次

prediction=net(x)#输入输入值

loss=loss_func(prediction,y)#计算误差预测值和真实值之间的误差,注意位置

optimizer.zero_grad()#梯度清零

loss.backward()#反向传递

optimizer.step()#优化梯度

# 接着上面来

if t % 5 == 0:

# plot and show learning process

plt.cla()

plt.scatter(x.data.numpy(), y.data.numpy())

plt.plot(x.data.numpy(), prediction.data.numpy(), 'r-', lw=5)

plt.text(0.5, 0, 'Loss=%.4f' % loss.data.numpy(), fontdict={'size': 20, 'color': 'red'})

plt.pause(0.1)

完整代码

import torch

from torch.autograd import Variable

import torch.nn.functional as F

import matplotlib.pyplot as plt

x=torch.unsqueeze(torch.linspace(-1,1,100),dim=1)#一维变二维

y=x.pow(2)+0.2*torch.rand(x.size())

# plt.scatter(x.data.numpy(),y.data.numpy())

# plt.show()

x,y=Variable(x),Variable(y)#构造神经网络的是琥珀要使用Variable类型的

class Net(torch.nn.Module):

def __init__(self,n_feature,n_hidden,n_ouput):#初始化信息

super(Net, self).__init__()

self.hidden=torch.nn.Linear(n_feature,n_hidden,n_ouput)#隐藏层线性输出

self.predict=torch.nn.Linear(n_hidden,n_ouput)#输出层线性输出

def forward(self,x):#前向传递的过程

#正向传播输入值,神经网络输出预测值

x=F.relu(self.hidden(x))#激励函数加工一下

x=self.predict(x)#输出值预测值

return x

net=Net(n_feature=1,n_hidden=10,n_ouput=1)#输入值是一个,隐藏层有10个神经元,输出值为y值

print(net)

optimizer=torch.optim.SGD(net.parameters(),lr=0.5)#输入神经网络的所有参数,学习效率,这个是训练工具

loss_func=torch.nn.MSELoss()#误差处理均方差

plt.ion() # 画图

plt.show()

for t in range(200):#训练200次

prediction=net(x)#输入输入值

loss=loss_func(prediction,y)#计算误差预测值和真实值之间的误差,注意位置

optimizer.zero_grad()#梯度清零

loss.backward()#反向传递

optimizer.step()#优化梯度

# 接着上面来

if t % 5 == 0:

# plot and show learning process

plt.cla()

plt.scatter(x.data.numpy(), y.data.numpy())

plt.plot(x.data.numpy(), prediction.data.numpy(), 'r-', lw=5)

plt.text(0.5, 0, 'Loss=%.4f' % loss.data.numpy(), fontdict={'size': 20, 'color': 'red'})

plt.pause(0.1)

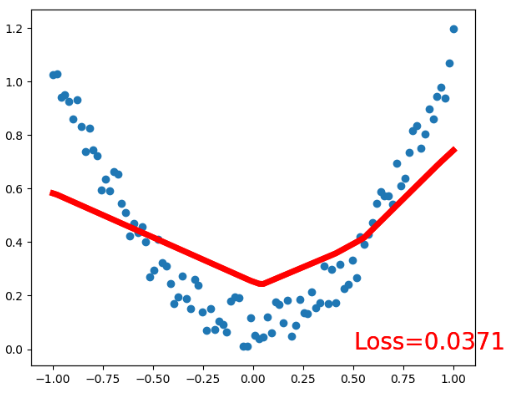

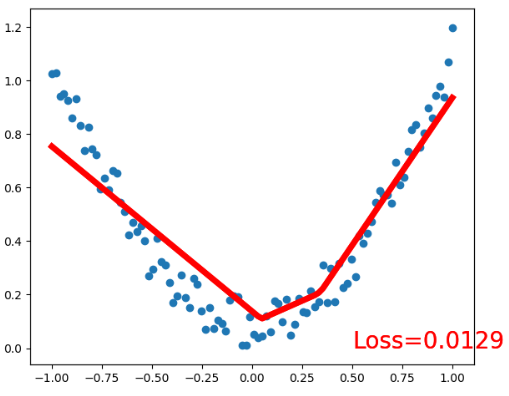

过程结果

中间过程省略一部分...

【pytorch】学习笔记(四)-搭建神经网络进行关系拟合的更多相关文章

- 莫烦PyTorch学习笔记(四)——回归

下面的代码说明个整个神经网络模拟回归的过程,代码含有详细注释,直接贴下来了 import torch from torch.autograd import Variable import torch. ...

- ensorflow学习笔记四:mnist实例--用简单的神经网络来训练和测试

http://www.cnblogs.com/denny402/p/5852983.html ensorflow学习笔记四:mnist实例--用简单的神经网络来训练和测试 刚开始学习tf时,我们从 ...

- Go语言学习笔记四: 运算符

Go语言学习笔记四: 运算符 这章知识好无聊呀,本来想跨过去,但没准有初学者要学,还是写写吧. 运算符种类 与你预期的一样,Go的特点就是啥都有,爱用哪个用哪个,所以市面上的运算符基本都有. 算术运算 ...

- kvm虚拟化学习笔记(四)之kvm虚拟机日常管理与配置

KVM虚拟化学习笔记系列文章列表----------------------------------------kvm虚拟化学习笔记(一)之kvm虚拟化环境安装http://koumm.blog.51 ...

- MySql学习笔记四

MySql学习笔记四 5.3.数据类型 数值型 整型 小数 定点数 浮点数 字符型 较短的文本:char, varchar 较长的文本:text, blob(较长的二进制数据) 日期型 原则:所选择类 ...

- 官网实例详解-目录和实例简介-keras学习笔记四

官网实例详解-目录和实例简介-keras学习笔记四 2018-06-11 10:36:18 wyx100 阅读数 4193更多 分类专栏: 人工智能 python 深度学习 keras 版权声明: ...

- ZooKeeper学习笔记四:使用ZooKeeper实现一个简单的分布式锁

作者:Grey 原文地址: ZooKeeper学习笔记四:使用ZooKeeper实现一个简单的分布式锁 前置知识 完成ZooKeeper集群搭建以及熟悉ZooKeeperAPI基本使用 需求 当多个进 ...

- C#可扩展编程之MEF学习笔记(四):见证奇迹的时刻

前面三篇讲了MEF的基础和基本到导入导出方法,下面就是见证MEF真正魅力所在的时刻.如果没有看过前面的文章,请到我的博客首页查看. 前面我们都是在一个项目中写了一个类来测试的,但实际开发中,我们往往要 ...

- IOS学习笔记(四)之UITextField和UITextView控件学习

IOS学习笔记(四)之UITextField和UITextView控件学习(博客地址:http://blog.csdn.net/developer_jiangqq) Author:hmjiangqq ...

随机推荐

- 微信小程序_(案例)简单中国天气网首页

Demo:简单中国天气网首页 Page({ data:{ name:"CynicalGary", temp:"4", low:"-1°C", ...

- [集训队作业2018]蜀道难——TopTree+贪心+树链剖分+链分治+树形DP

题目链接: [集训队作业2018]蜀道难 题目大意:给出一棵$n$个节点的树,要求给每个点赋一个$1\sim n$之内的权值使所有点的权值是$1\sim n$的一个排列,定义一条边的权值为两端点权值差 ...

- python3笔记十七:python文件读写

一:学习内容 读文件 写文件 编码与解码 二:读文件--步骤分解 1.过程 第一步:打开文件第二步:读文件内容第三步:关闭文件 2.第一步:打开文件 open(path,flag[,encoding] ...

- js对象之间的"继承"的五种方法

今天要介绍的是,对象之间的"继承"的五种方法. 比如,现在有一个"动物"对象的构造函数. function Animal(){ this.species = & ...

- redis5.0编译安装

##################### linux下运行redis 1.下载源码 https://redis.io/ 2.将源码上传到服务器中,进行编译安装 a)可以使用rz进行上传(sz是将服务 ...

- Python面向对象进阶和socket网络编程

写在前面 为什么坚持?想一想当初: 一.面向对象进阶 - 1.反射补充 - 通过字符串去操作一个对象的属性,称之为反射: - 示例1: class Chinese: def __init__(self ...

- dockerfile中配置时区

https://www.cnblogs.com/kevingrace/p/5570597.html #设置时区RUN /bin/cp /usr/share/zoneinfo/Asia/Shanghai ...

- C基础知识(14):命令行参数

命令行参数是使用main()函数参数来处理的,其中,argc是指传入参数的个数,argv[]是一个指针数组,指向传递给程序的每个参数. 应当指出的是,argv[0]存储程序的名称,argv[1]是一个 ...

- 12 mysql性能抖动

12 mysql性能抖动 sql语句为什么变”慢”了 在介绍WAL机制时,innodb在处理更新语句的时候,只做了写日志这一个磁盘操作,就是redo log,在更新内存写完redo log之后,就返回 ...

- 重启 hdfs and yarn datanode

1- start-all.sh and stop-all.sh: Used to start and stop hadoop daemons all at once. Issuing it on th ...