大数据学习笔记——Spark完全分布式完整部署教程

Spark完全分布式完整部署教程

继Mapreduce之后,作为新一代并且是主流的计算引擎,学好Spark是非常重要的,这一篇博客会专门介绍如何部署一个分布式的Spark计算框架,在之后的博客中,更会讲到Spark的基本模块的介绍以及底层原理,好了,废话不多说,直接开始吧!

1. 安装准备

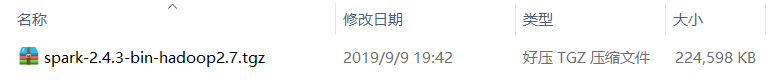

部署Spark时,我们使用的版本如下所示:

2. 正式安装

1. 将spark-2.4.3-bin-hadoop2.7.tgz文件使用远程传输软件发送至/home/centos/downloads目录下

2. 将spark-2.4.3-bin-hadoop2.7.tgz解压缩至/soft目录下

tar -xzvf spark-2.4.3-bin-hadoop2.7.tgz -C /soft

3. 进入到/soft目录下,配置spark的符号链接

cd /soft

ln -s spark-2.4.3-bin-hadoop2.7 spark

4. 修改并生效环境变量

nano /etc/profile

在文件末尾添加以下代码:

#spark环境变量

export SPARK_HOME=/soft/spark

export PATH=$PATH:$SPARK_HOME/bin

生效环境变量后保存退出

source /etc/profile

5. 规划集群部署方案

根据现有的虚拟机配置,集群部署方案为:s101节点作为master节点,s102 - s104作为worker节点

6. 使用脚本分发spark软件包以及/etc/profile文件到所有节点

cd /soft

xsync.sh spark-2.4.3-bin-hadoop2.7

xsync.sh /etc/profile

7. 使用ssh连接到除s101外的其他所有节点创建符号链接

ssh s102

cd /soft

ln -s spark-2.4.3-bin-hadoop2.7 spark

exit

其他节点同理

8. 配置spark的配置文件并分发到所有节点

cd /soft/spark/conf

cp spark-env.sh.template spark-env.sh

nano spark-env.sh

在文件末尾处添加后保存退出:

export JAVA_HOME=/soft/jdk

export HADOOP_CONF_DIR=/soft/hadoop/etc/hadoop

准备好如下文件,避免每次提交spark job上传spark类库:

先用WinScp将spark的类库放到/home/centos目录下

将spark的类库上传到HDFS文件系统上去:hdfs dfs -put /home/centos/spark_lib.zip /

修改spark-defaults配置文件:

cp spark-defaults.conf.template spark-defaults.conf

nano spark-defaults.conf

在文件末尾处添加后保存退出:

spark.yarn.archive hdfs://mycluster/spark_lib.zip

cp slaves.template slaves

nano slaves

在文件中末尾处删除localhost并添加以下命令后后保存退出:

s102

s103

s104

分发上述三个个配置文件

xsync.sh spark-env.sh

xsync.sh spark-defaults.conf

xsync.sh slaves

9. 启动spark集群

/soft/spark/sbin/start-all.sh

10. 查看进程

xcall.sh jps

出现以下画面:

11. 查看WebUI

http://s101:8080

配置大功告成!!!

12. 结合hadoop启动spark的各种模式检测是否都能正常启动

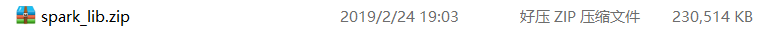

启动local模式:spark-shell --master local

启动hadoop集群:

xzk.sh start

start-all.sh

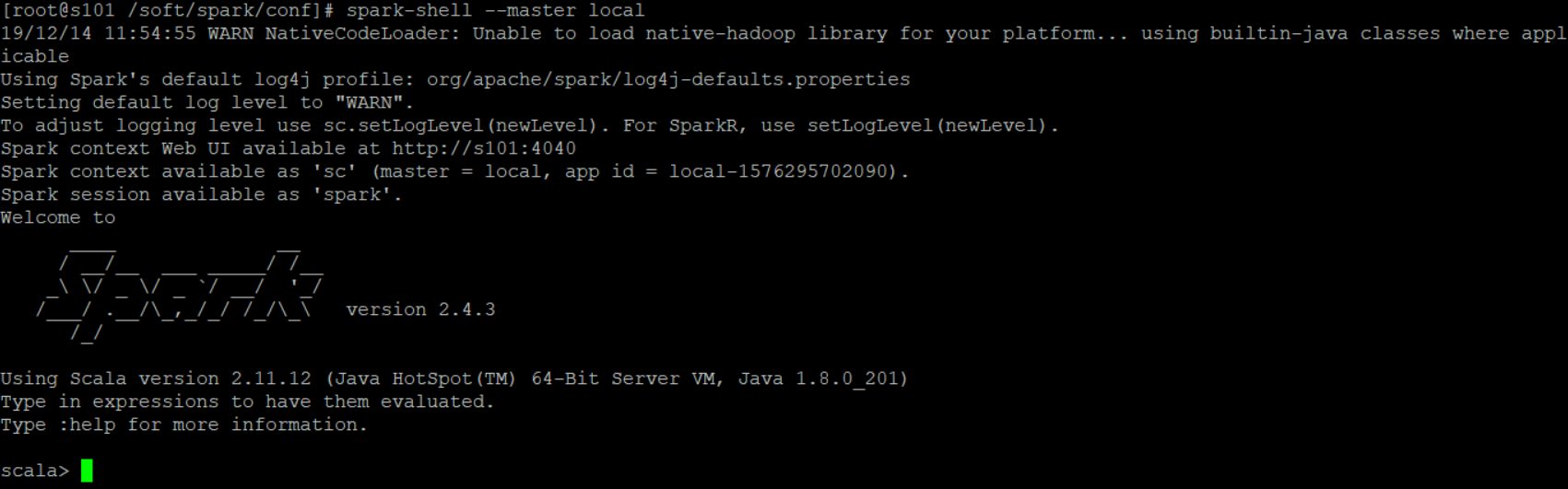

然后启动standalone模式:spark-shell --master spark://s101:7077

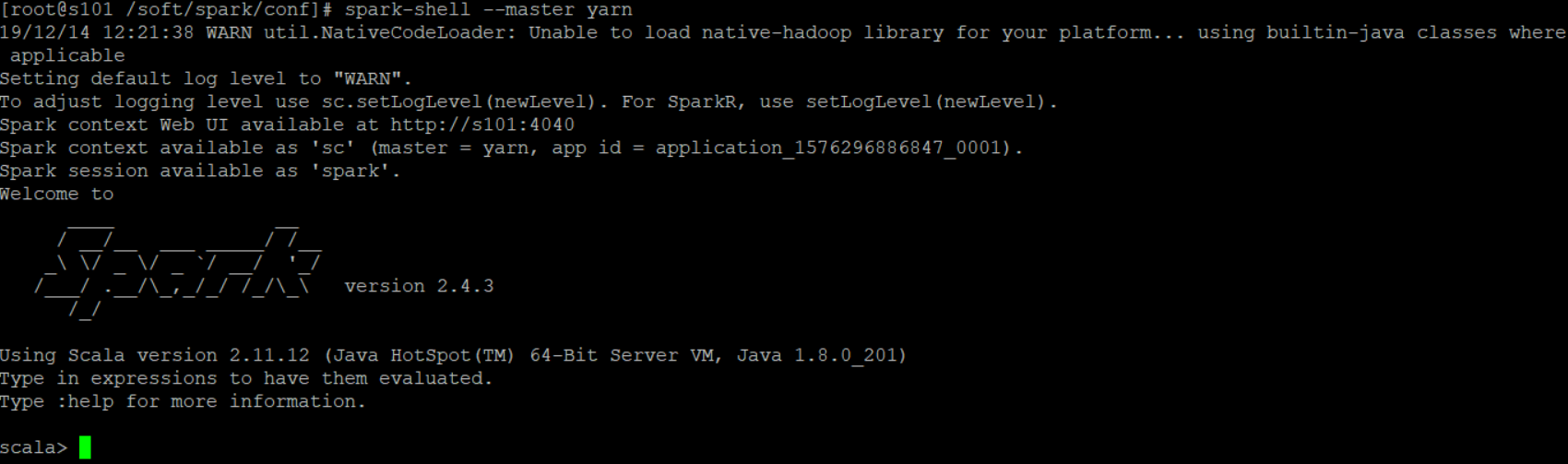

最后测试yarn模式是否能连接成功:spark-shell --master yarn

大数据学习笔记——Spark完全分布式完整部署教程的更多相关文章

- 大数据学习笔记——Spark工作机制以及API详解

Spark工作机制以及API详解 本篇文章将会承接上篇关于如何部署Spark分布式集群的博客,会先对RDD编程中常见的API进行一个整理,接着再结合源代码以及注释详细地解读spark的作业提交流程,调 ...

- 大数据学习笔记——Hbase高可用+完全分布式完整部署教程

Hbase高可用+完全分布式完整部署教程 本篇博客承接上一篇sqoop的部署教程,将会详细介绍完全分布式并且是高可用模式下的Hbase的部署流程,废话不多说,我们直接开始! 1. 安装准备 部署Hba ...

- 大数据学习笔记——Linux完整部署篇(实操部分)

Linux环境搭建完整操作流程(包含mysql的安装步骤) 从现在开始,就正式进入到大数据学习的前置工作了,即Linux的学习以及安装,作为运行大数据框架的基础环境,Linux操作系统的重要性自然不言 ...

- 大数据学习笔记——Hadoop编程实战之HDFS

HDFS基本API的应用(包含IDEA的基本设置) 在上一篇博客中,本人详细地整理了如何从0搭建一个HA模式下的分布式Hadoop平台,那么,在上一篇的基础上,我们终于可以进行编程实操了,同样,在编程 ...

- 大数据学习笔记——Java篇之集合框架(ArrayList)

Java集合框架学习笔记 1. Java集合框架中各接口或子类的继承以及实现关系图: 2. 数组和集合类的区别整理: 数组: 1. 长度是固定的 2. 既可以存放基本数据类型又可以存放引用数据类型 3 ...

- 大数据学习笔记——Hadoop高可用完全分布式模式完整部署教程(包含zookeeper)

高可用模式下的Hadoop集群搭建 本篇博客将会在之前写过的Linux的完整部署的基础上进行,暂时不会涉及到伪分布式或者完全分布式模式搭建,由于HA模式涉及到的配置文件较多,维护起来也较为复杂,相信学 ...

- 大数据学习笔记5 - Spark

Spark是一个基于内存计算的大数据并行计算框架.所以,Spark并不能完全替代Hadoop,主要用于替代Hadoop中的MapReduce计算模型. 在实际应用中,大数据处理无非是以下几个类型: 复 ...

- 大数据学习笔记——Sqoop完整部署流程

Sqoop详细部署教程 Sqoop是一个将hadoop与关系型数据库之间进行数据传输,批量数据导入导出的工具,注意,导入是指将数据从RDBMS导入到hadoop而导出则是指将数据从hadoop导出到R ...

- 大数据学习笔记之Hadoop(一):Hadoop入门

文章目录 大数据概论 一.大数据概念 二.大数据的特点 三.大数据能干啥? 四.大数据发展前景 五.企业数据部的业务流程分析 六.企业数据部的一般组织结构 Hadoop(入门) 一 从Hadoop框架 ...

随机推荐

- php Swoole实现毫秒级定时任务

项目开发中,如果有定时任务的业务要求,我们会使用linux的crontab来解决,但是它的最小粒度是分钟级别,如果要求粒度是秒级别的,甚至毫秒级别的,crontab就无法满足,值得庆幸的是swoole ...

- 同时发起TCP连接

如果你的socket编程只限于创建SOCK_STREAM的socket,用connect-accept建立连接,然后就是recv,send.你就会惊奇tcp连接还可以不用accept. 上图为两个AF ...

- GeoServer 查询sql视图

说明: 最近项目中遇到一个需求,需要统计管网的长度,但管网数据量非常大,前端用openlayers接口统计直接就奔溃了. 后尝试使用调后台接口查数据库的方式,虽然可行但是又要多一层与后台交互的工作. ...

- Java 数据类型、变量

Java 数据类型 在 Java 中,对于每一种数据都定义了明确的具体的数据类型,在内存中分配了不同大小的内存空间. 整数类型 (byte.short.int.long) 1.Java 各整数类型 ...

- SpringCloud Sleuth + Zipkin 实现链路追踪

一.Sleuth介绍 为什么要使用微服务跟踪? 它解决了什么问题? 1.微服务的现状? 随着业务的发展,单体架构变为微服务架构,并且系统规模也变得越来越大,各微服务间的调用关系也变得越来越复杂 ...

- SpringBoot项目集成Hystrix

Hystrix Hystrix是由Netflix开源的一个服务隔离组件,通过服务隔离来避免由于依赖延迟.异常,引起资源耗尽导致系统不可用的解决方案. 1.什么是服务熔断 服务熔断就是对该服务的调用 ...

- 使用echarts常用问题总结

1,echarts配合element ui的抽屉插件出现报错,上次解决方法是使用element ui 抽屉的open事件,让在打开事件重新加载,我们项目的需求是点击某个数据,要传递这条数据包含的其他值 ...

- mybatis中因为不理解$与#而出现的bug

最近项目中遇到一个bug,正常的流程是这样的:要上传一个应用,首先检查系统中是否已经存在这个应用的更高版本,如果存在,则上传操作将被取消. bug体现为当传入系统中存在的所有应用与新上传的应用的ver ...

- LVS+Keepalived-DR模式(Apache)

Environment:4台CentOS机器 两台LVS 两台web服务器 LVS主备的操作,都需要安装ipvsadm和keepalived LVS主机操作 : 1.更改Keepalived的配置文件 ...

- 白话OAuth2用户认证及鉴权标准流程

一.OAuth2需求场景 在说明OAuth2需求及使用场景之前,需要先介绍一下OAuth2授权流程中的各种角色: 资源拥有者(User) - 指应用的用户 认证服务器 (Authorization S ...