#Week6 Neural Networks : Representation

一、Non-linear Hypotheses

线性回归和逻辑回归在特征很多时,计算量会很大。

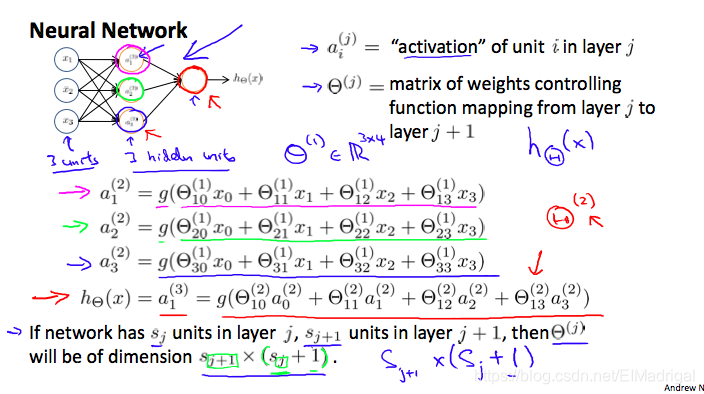

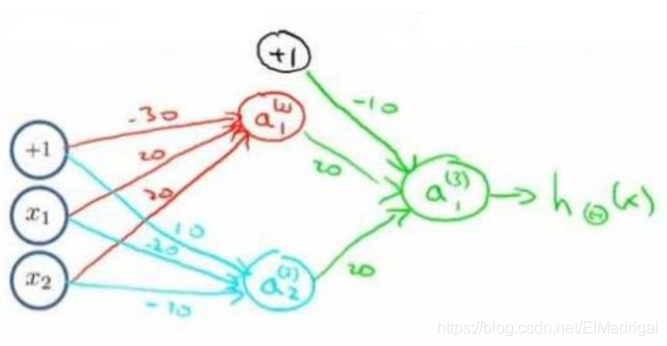

一个简单的三层神经网络模型:

\]

其中:$$a_1^{(2)} = g(\Theta_{10}^{(1)}x_0 + \Theta_{11}^{(1)}x_1 + \Theta_{12}^{(1)}x_2 + \Theta_{13}{(1)}x_3)$$$$a_2{(2)} = g(\Theta_{20}^{(1)}x_0 + \Theta_{21}^{(1)}x_1 + \Theta_{22}^{(1)}x_2 + \Theta_{23}{(1)}x_3)$$$$a_3{(2)} = g(\Theta_{30}^{(1)}x_0 + \Theta_{31}^{(1)}x_1 + \Theta_{32}^{(1)}x_2 + \Theta_{33}^{(1)}x_3)$$$$h_\Theta(x) = a_1^{(3)} = g(\Theta_{10}{(2)}a_0{(2)} + \Theta_{11}{(2)}a_1{(2)} + \Theta_{12}{(2)}a_2{(2)} + \Theta_{13}{(2)}a_3{(2)})$$

二、vectorized implementation

将上面公式中函数\(g\)中的东西用\(z\)代替:

\]

令\(x=a^{(1)}\):

\]

得到:

\]

这块的记号比较多,用例子梳理下:

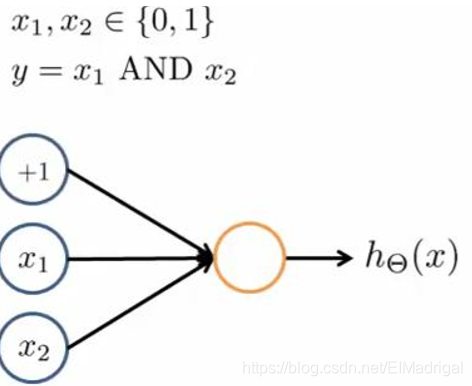

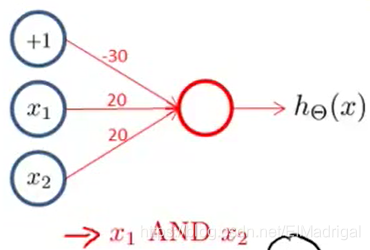

实现一个逻辑与的神经网络:

那么:

所以有:

再来一个多层的,实现XNOR功能(两输入都为0或都为1,输出才为1):

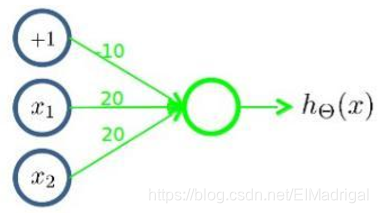

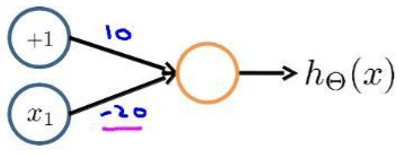

基本的神经元:

- 逻辑与

- 逻辑或

- 逻辑非

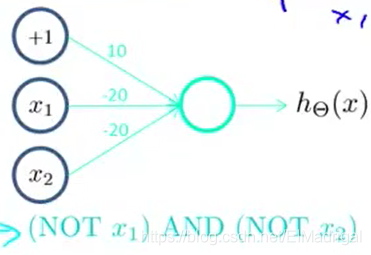

先构造一个表示后半部分的神经元:

这样的:

接着将前半部分组合起来:

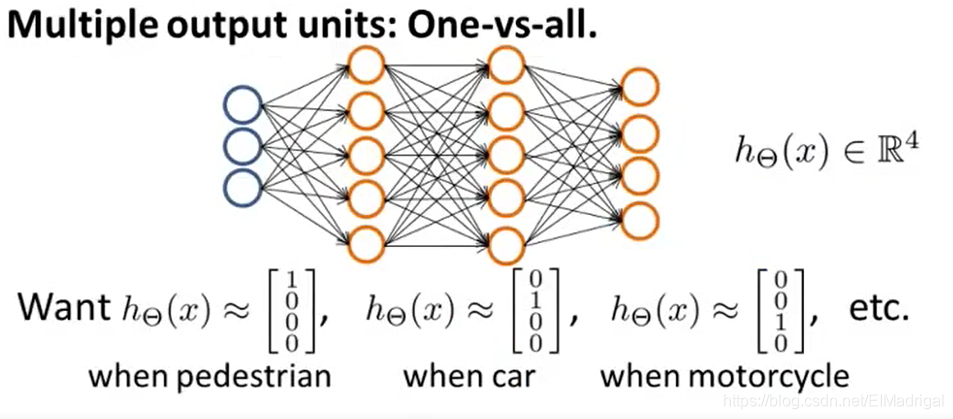

三、Multiclass Classification

#Week6 Neural Networks : Representation的更多相关文章

- Machine Learning - 第4周(Neural Networks: Representation)

Neural networks is a model inspired by how the brain works. It is widely used today in many applicat ...

- (原创)Stanford Machine Learning (by Andrew NG) --- (week 4) Neural Networks Representation

Andrew NG的Machine learning课程地址为:https://www.coursera.org/course/ml 神经网络一直被认为是比较难懂的问题,NG将神经网络部分的课程分为了 ...

- Stanford机器学习---第四讲. 神经网络的表示 Neural Networks representation

原文 http://blog.csdn.net/abcjennifer/article/details/7749309 本栏目(Machine learning)包括单参数的线性回归.多参数的线性回归 ...

- 机器学习之神经网络模型-下(Neural Networks: Representation)

3. Model Representation I 1 神经网络是在模仿大脑中的神经元或者神经网络时发明的.因此,要解释如何表示模型假设,我们不妨先来看单个神经元在大脑中是什么样的. 我们的大脑中充满 ...

- 机器学习之神经网络模型-上(Neural Networks: Representation)

在这篇文章中,我们一起来讨论一种叫作"神经网络"(Neural Network)的机器学习算法,这也是我硕士阶段的研究方向.我们将首先讨论神经网络的表层结构,在之后再具体讨论神经网 ...

- Coursera, Machine Learning, Neural Networks: Representation - week4/5

Neural Network Motivations 想要拟合一条曲线,在feature 很多的情况下,feature的组合也很多,在现实中不适用,比如在computer vision问题中featu ...

- Ng第八课:神经网络表述(Neural Networks: Representation)

8.1 非线性假设 8.2 神经元和大脑 8.3 模型表示 1 8.4 模型表示 2 8.5 特征和直观理解 1 8.6 样本和直观理解 II 8.7 多类分类 8.1 非线性假设 无 ...

- 8、神经网络:表述(Neural Networks: Representation)

8.1 非线性假设 我们之前学的,无论是线性回归还是逻辑回归都有这样一个缺点,即:当特征太多时,计算的负荷会非常大. 下面是一个例子: 当我们使用x1, x2 的多次项式进行预测时,我们可以应用的很好 ...

- (原创)Stanford Machine Learning (by Andrew NG) --- (week 5) Neural Networks Learning

本栏目内容来自Andrew NG老师的公开课:https://class.coursera.org/ml/class/index 一般而言, 人工神经网络与经典计算方法相比并非优越, 只有当常规方法解 ...

随机推荐

- MyBatis(二):基础CRUD

本文是按照狂神说的教学视频学习的笔记,强力推荐,教学深入浅出1便就懂!b站搜索狂神说即可 https://space.bilibili.com/95256449?spm_id_from=333.788 ...

- 登录窗口java

这次代码是登录窗口的制作. 主要的方面是是包括,用户名.密码.验证码.以及输入数据所需要的文本框,对于验证码可以通过点击验证码进行修改.同时对于验证码的前景色和背景色同时都得到修改. 点击注册(这里还 ...

- C++静态库和动态库

静态库与动态库 首先简单介绍一下gcc 指令 ubuntu 下安装gcc g++ 方法 sudo apt install gcc g++ gcc 的简单使用 建立hello.c 源文件 gcc hel ...

- 中阶d03 JDBC 使用

1.首先在数据库中创建表 2.安装mysql驱动 java开发环境中导入jdbc连接mysql的jar包 mysql-connector-java-5.1.7-bin.jar 下载地址:https:/ ...

- Struts2-学习笔记系列(3)-返回视图

Action执行execute返回字符串,又如何返回对应的页面呢? 关在在于struts中action节点配置的result.如下: 内置有的ERROR SUCCESS等好几种.看源码即可 publ ...

- CVE-2019-0232 远程代码执行漏洞-复现

0x00 漏洞介绍 该漏洞是由于Tomcat CGI将命令行参数传递给Windows程序的方式存在错误,使得CGIServlet被命令注入影响. 该漏洞只影响Windows平台,要求启用了CGISer ...

- 学习笔记分享之汇编---3. 堆栈&标志寄存器

前言: 此文章收录在本人的<学习笔记分享>分类中,此分类记录本人的学习心得体会,现全部分享出来希望和大家共同交流学习成长.附上分类链接: https://www.cnblogs.c ...

- Ajax 简述与基础语法

目录 Ajax 1. 原生 JS 实现 Ajax 2. 使用 Ajax 实现异步通信 a. Ajax 的基础语法 b. 用 Ajax 传递数据 i. 传递字符串数据 ii. 传递 JSON 数据 3. ...

- 解决同层hover事件重叠闪烁问题

完整代码如下: <!DOCTYPE html> <html lang="en"> <head> <meta charset="U ...

- 试验使用t检验

官方解释 Excel中使用T.TEST函数 T.TEST(array1,array2,tails,type) Array1 必需.第一个数据集. Array2 必需.第二个数据集. ...