HDFS伪分布式环境搭建

(一)、HDFS shell操作

以上已经介绍了如何搭建伪分布式的Hadoop,既然环境已经搭建起来了,那要怎么去操作呢?这就是本节将要介绍的内容:

HDFS自带有一些shell命令,通过这些命令我们可以去操作HDFS文件系统,这些命令与Linux的命令挺相似的,如果熟悉Linux的命令很容易就可以上手HDFS的命令,关于这些命令的官方文档地址如下:

http://archive.cloudera.com/cdh5/cdh/5/hadoop-2.6.0-cdh5.7.0/hadoop-mapreduce-client/hadoop-mapreduce-client-core/MapredCommands.html

1.1 首先我们在/data下创建一个测试文件:

[root@web02 data]# vim hello.txt

18/04/07 12:03:05 WARN util.NativeCodeLoader: Unable to load native-hadoop library for your platform... using builtin-java classes where applicable

如果遇到以上报错修改

[root@web02 hadoop]# pwd

/usr/local/src/hadoop-2.6.0-cdh5.7.0/etc/hadoop

[root@web02 hadoop]# vim log4j.properties

添加:

log4j.logger.org.apache.hadoop.util.NativeCodeLoader=ERROR1.2查看文件系统的根目录

[root@web02 data]# hdfs dfs -ls /1.3.将刚刚创建的文件拷贝到文件系统的根目录下:

[root@web02 data]# hdfs dfs -ls /

Found 1 items

-rw-r--r-- 1 root supergroup 37 2018-04-07 12:04 /hello.txt

[root@web02 data]#1.4.查看文件内容:

[root@web02 data]# hdfs dfs -cat /hello.txt

hello You 66 O

Hadoop HDFS mpareduce1.5创建目录

[root@web02 data]# hdfs dfs -mkdir /test

[root@web02 data]# hdfs dfs -ls /

Found 2 items

-rw-r--r-- 1 root supergroup 37 2018-04-07 12:04 /hello.txt

drwxr-xr-x - root supergroup 0 2018-04-07 12:20 /test

[root@web02 data]#1.6递归创建目录

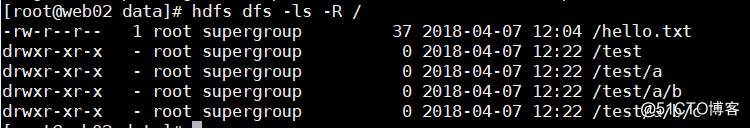

[root@web02 data]# hdfs dfs -mkdir -p /test/a/b/c1.7查看递归目录

[root@web02 data]# hdfs dfs -ls -R /

1.8复制文件

[root@web02 data]# hdfs dfs -copyFromLocal

./hello.txt /test/a/b

[root@web02 data]# hdfs dfs -ls -R /

-rw-r--r-- 1 root supergroup 37 2018-04-07 12:04 /hello.txt

drwxr-xr-x - root supergroup 0 2018-04-07 12:22 /test

drwxr-xr-x - root supergroup 0 2018-04-07 12:22 /test/a

drwxr-xr-x - root supergroup 0 2018-04-07 12:28 /test/a/b

drwxr-xr-x - root supergroup 0 2018-04-07 12:22 /test/a/b/c

-rw-r--r-- 1 root supergroup 37 2018-04-07 12:28 /test/a/b/hello.txt

[root@web02 data]#1.9从系统中拿出文件

[root@web02 data]# hdfs dfs -get /test/a/b/hello.txt2.0删除文件

[root@web02 data]# hdfs dfs -rm /hello.txt

Deleted /hello.txt

[root@web02 data]#2.1删除目录

[root@web02 data]# hdfs dfs -rm -R /test

Deleted /test

[root@web02 data]#以上就是最为常用的一些操作命令了,如果需要使用其他命令,直接执行hdfs dfs就可以查看到所支持的所有命令。

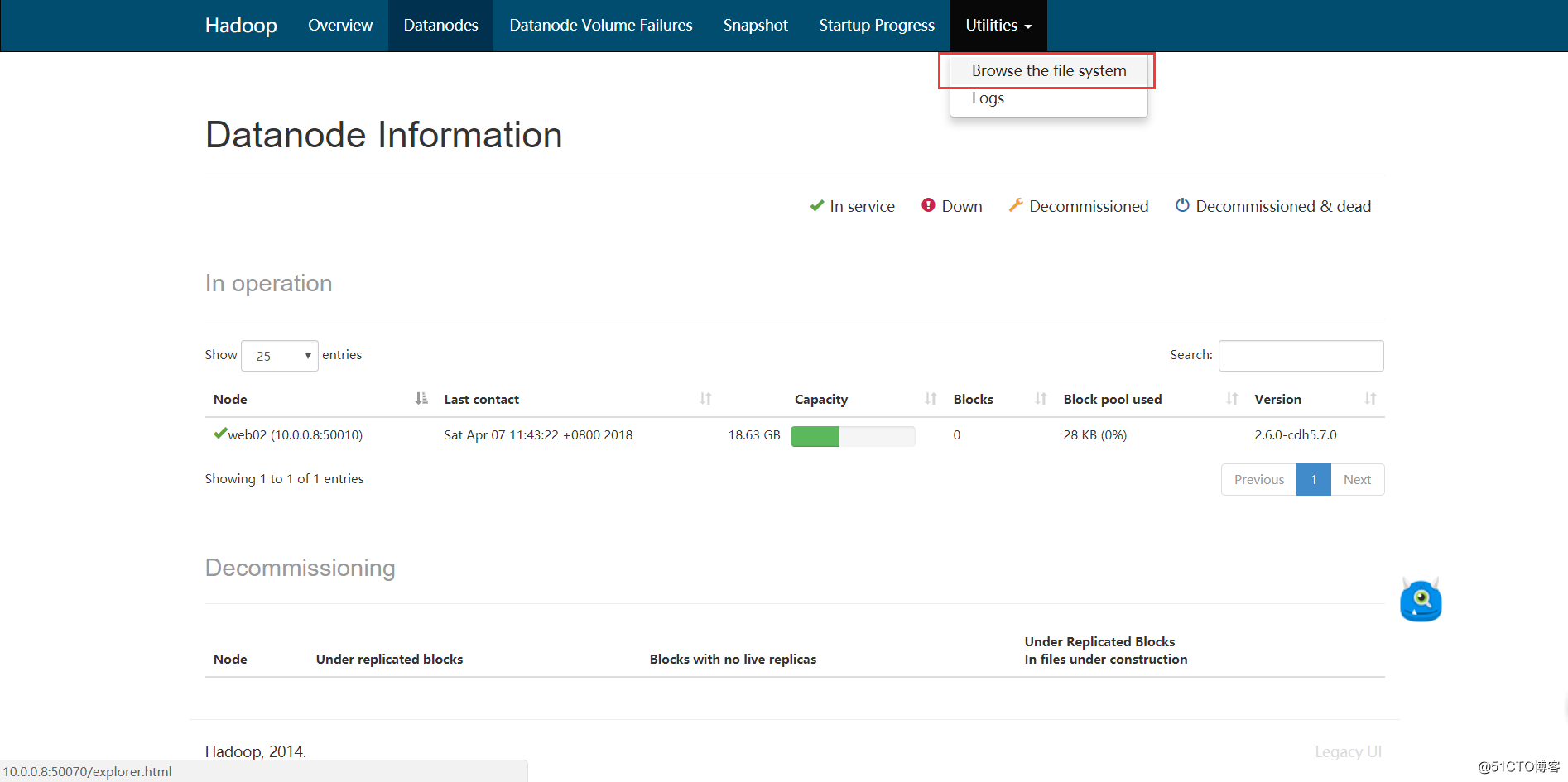

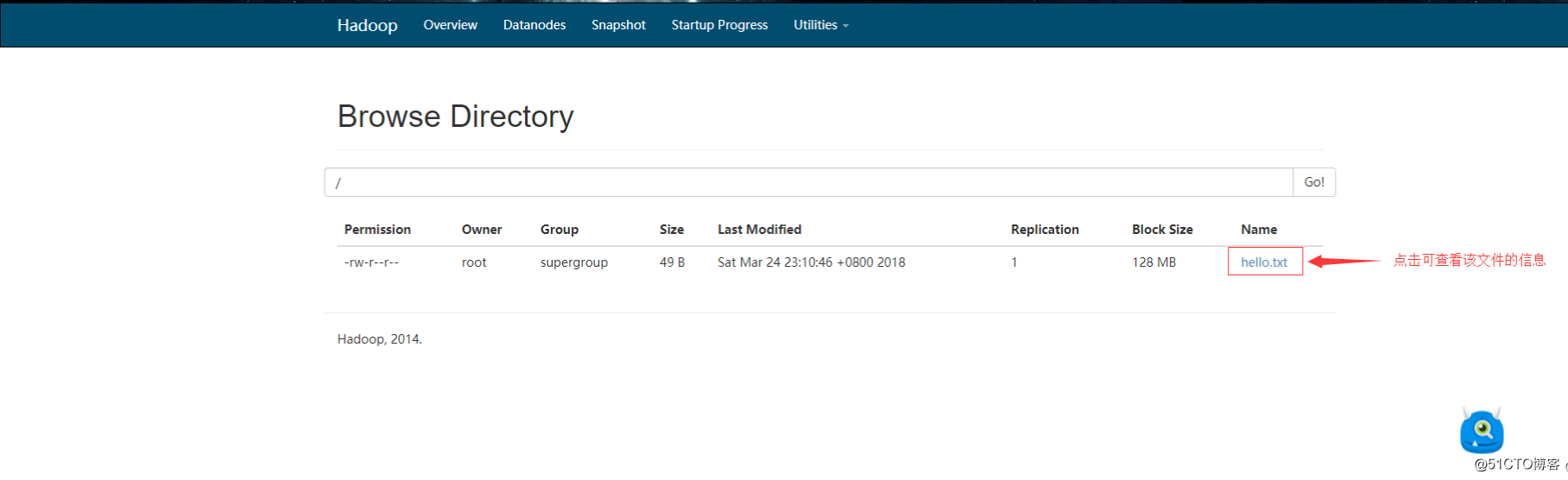

接下来我们在浏览器里查看文件系统,首先将刚刚删除的文件put回去:

2.2查看文件信息

HDFS伪分布式环境搭建的更多相关文章

- 大数据:Hadoop(JDK安装、HDFS伪分布式环境搭建、HDFS 的shell操作)

所有的内容都来源与 Hadoop 官方文档 一.Hadoop 伪分布式安装步骤 1)JDK安装 解压:tar -zxvf jdk-7u79-linux-x64.tar.gz -C ~/app 添加到系 ...

- HDFS 伪分布式环境搭建

HDFS 伪分布式环境搭建 作者:Grey 原文地址: 博客园:HDFS 伪分布式环境搭建 CSDN:HDFS 伪分布式环境搭建 相关软件版本 Hadoop 2.6.5 CentOS 7 Oracle ...

- Hadoop学习笔记1:伪分布式环境搭建

在搭建Hadoop环境之前,请先阅读如下博文,把搭建Hadoop环境之前的准备工作做好,博文如下: 1.CentOS 6.7下安装JDK , 地址: http://blog.csdn.net/yule ...

- Hadoop2.5.0伪分布式环境搭建

本章主要介绍下在Linux系统下的Hadoop2.5.0伪分布式环境搭建步骤.首先要搭建Hadoop伪分布式环境,需要完成一些前置依赖工作,包括创建用户.安装JDK.关闭防火墙等. 一.创建hadoo ...

- 【Hadoop】伪分布式环境搭建、验证

Hadoop伪分布式环境搭建: 自动部署脚本: #!/bin/bash set -eux export APP_PATH=/opt/applications export APP_NAME=Ares ...

- 【Hadoop离线基础总结】CDH版本Hadoop 伪分布式环境搭建

CDH版本Hadoop 伪分布式环境搭建 服务规划 步骤 第一步:上传压缩包并解压 cd /export/softwares/ tar -zxvf hadoop-2.6.0-cdh5.14.0.tar ...

- CentOS7下Hadoop伪分布式环境搭建

CentOS7下Hadoop伪分布式环境搭建 前期准备 1.配置hostname(可选,了解) 在CentOS中,有三种定义的主机名:静态的(static),瞬态的(transient),和灵活的(p ...

- Hadoop 2.7 伪分布式环境搭建

1.安装环境 ①.一台Linux CentOS6.7 系统 hostname ipaddress subnet mask ...

- hive-2.2.0 伪分布式环境搭建

一,实验环境: 1, ubuntu server 16.04 2, jdk,1.8 3, hadoop 2.7.4 伪分布式环境或者集群模式 4, apache-hive-2.2.0-bin.tar. ...

随机推荐

- 【luogu P1314 聪明的质监员】 题解

题目链接:https://www.luogu.org/problemnew/show/P1314 二分答案 但是计算区间贡献的时候 直接暴力会挂 前缀和加速 #include <cstdio&g ...

- 【luogu P1455 搭配购买】 题解

题目链接:https://www.luogu.org/problemnew/show/P1455 一句话题目做法:并查集合并+01背包 启示:要每次再find一遍.路径压缩会快.因为合并的时候如果是1 ...

- PAT1089. Insert or Merge

PAT1089. Insert or Merge 题目大意 给定一个初始序列src, 一个排序当中的序列tar, 问排序方式是 Insert Sort, 或者 Merge Sort. 并输出下一次迭代 ...

- 火狐 SSL 收到了一个弱临时 Diffie-Hellman 密钥

火狐 SSL 收到了一个弱临时 Diffie-Hellman 密钥 最近在用FireFox 调试时使用Https,连接 https网址 时发生错误. 在服务器密钥交换握手信息中 SSL 收到了一个 ...

- 论坛数据转换discuz论坛?

http://www.bbstobbs.com/thread-397-1-1.html

- Web中的中文参数乱码

中文参数乱码 1 get方式传参,中文乱码 修改tomcat中的配置server.xml 在修改端口的标签中添加属性URIEncoding="XXX&quo ...

- Struts2知识点小结(三)--值栈与ognl表达式

1.问题一 : 什么是值栈 ValueStack 回顾web阶段 数据交互问题? 客户端提交数据 到 服务器端 request接受数据+BeanUtils实体封装 ...

- BZOJ1607: [Usaco2008 Dec]Patting Heads 轻拍牛头(模拟 调和级数)

Time Limit: 3 Sec Memory Limit: 64 MBSubmit: 3031 Solved: 1596[Submit][Status][Discuss] Descriptio ...

- eventlet详解

正真工作才发现很懒,没这么多时间写文,毕竟小白,参照大神写的,不喜勿喷 1.eventlet是什么eventlet - 具有WSGI支持的异步框架eventlet是python库函数,一个是处理和网络 ...

- Graylog2日志服务安装配置

软件版本: mongodb-org-3.2.10 jdk-1.8.0 (推荐rpm包,不然要修改Graylog启动脚本定义的JAVA命令路径) elasticsearch-2.4.1 (Graylog ...