pandas:如何保存数据比较好?

我们在使用pandas处理完数据之后,最终总是要把数据作为一个文件保存下来,

那么,保存数据最常用的文件是什么呢?

我想大部分人一定会选择csv或者excel。

刚接触数据分析时,我也是这么选择的,不过,今天将介绍几种不一样的存储数据的文件格式。

这些文件格式各有自己的一些优点,希望本文能让你以后的数据存储方式能有不一样的选择,从而存储的更加专业。

1. 准备数据

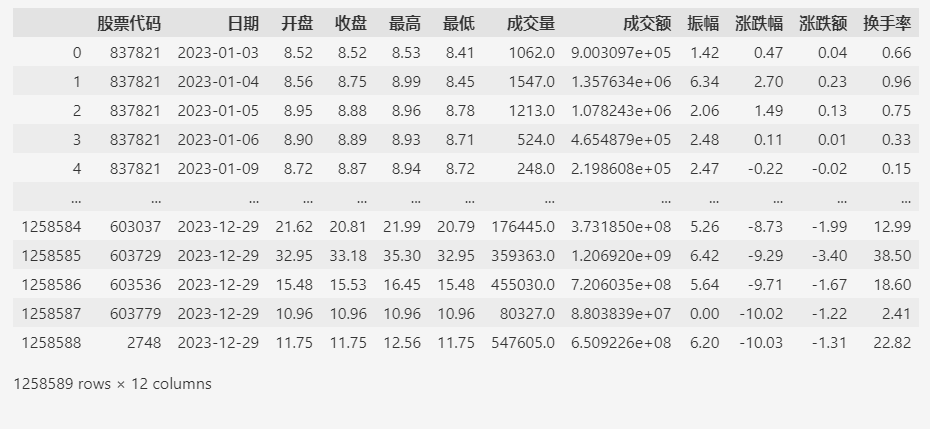

本次使用的数据来自A股2023年全年的日交易数据。

数据下载地址:https://databook.top/。

导入数据:

import pandas as pd

fp = "d:/share/历史行情数据-不复权-2023.csv"

df = pd.read_csv(fp)

df

总共大约120多万条数据。

准备好测试数据之后,开始测试各种文件的效果。

2. CSV

使用pandas做数据分析时,保存数据最常用的格式一定是CSV(或者excel)。

因为CSV格式易于分享,用excel或者文本编辑器都能直接打开。

但是当数据集规模比较大时,它的磁盘利用率和读写效率究竟如何呢?

首先我们把准备的数据保存为一个测试用的test.csv文件。

df = pd.read_csv(fp)

df.to_csv("d:/share/test.csv", index=None)

看看文件大小:

ls .\test.csv

目录: D:\share

Mode LastWriteTime Length Name

---- ------------- ------ ----

-a---- 2024/03/15 10:41:27 101411037 test.csv

test.csv文件大约:\(101411037/1024/1024 \approx 96.7MB\)

读取效率:

%%timeit

df = pd.read_csv("d:/share/test.csv")

1.73 s ± 54.7 ms per loop (mean ± std. dev. of 7 runs, 1 loop each)

写入的效率:

%%timeit

df.to_csv("d:/share/test.csv", index=None)

13.2 s ± 402 ms per loop (mean ± std. dev. of 7 runs, 1 loop each)

3. Pickle

Pickle格式是一种用于序列化和反序列化Python对象结构的二进制格式。

它的主要特点是能够将程序中运行的对象信息保存到文件中。

下面,我们先把准备的数据保存为一个测试用的test.pkl文件。

# pickle file

df = pd.read_csv(fp)

df.to_pickle("d:/share/test.pkl")

文件大小:

ls .\test.pkl

目录: D:\share

Mode LastWriteTime Length Name

---- ------------- ------ ----

-a---- 2024/03/15 10:49:09 116904470 test.pkl

test.pkl文件大约:\(116904470/1024/1024 \approx 111.5MB\)

读取效率:

%%timeit

df = pd.read_pickle("d:/share/test.pkl")

136 ms ± 5.09 ms per loop (mean ± std. dev. of 7 runs, 10 loops each)

写入效率:

%%timeit

df.to_pickle("d:/share/test.pkl")

182 ms ± 7.42 ms per loop (mean ± std. dev. of 7 runs, 1 loop each)

4. Parquet

Parquet格式是一种列式存储格式,被广泛应用于大数据处理领域。

它采用了压缩和编码技术,能够有效地存储和压缩数据,同时保持数据的结构和模式。

下面,我们先把准备的数据保存为一个测试用的test.parquet文件。

# parquet file

df = pd.read_csv(fp)

df.to_parquet("d:/share/test.parquet")

文件大小:

ls .\test.parquet

目录: D:\share

Mode LastWriteTime Length Name

---- ------------- ------ ----

-a---- 2024/03/15 10:52:08 32964728 test.parquet

test.parquet文件大约:\(32964728/1024/1024 \approx 31.4MB\)

读取效率:

%%timeit

df = pd.read_parquet("d:/share/test.parquet")

200 ms ± 8.54 ms per loop (mean ± std. dev. of 7 runs, 1 loop each)

写入效率:

%%timeit

df.to_parquet("d:/share/test.parquet")

1.23 s ± 62.4 ms per loop (mean ± std. dev. of 7 runs, 1 loop each)

5. Feather

Feather格式是一种高速、轻量且易于使用的二进制文件格式,专门用于存储数据帧。

Feather的主要目标是提供高性能的读写操作。

下面,我们先把准备的数据保存为一个测试用的test.feather文件。

# feather file

df = pd.read_csv(fp)

df.to_feather("d:/share/test.feather")

文件大小:

ls .\test.feather

目录: D:\share

Mode LastWriteTime Length Name

---- ------------- ------ ----

-a---- 2024/03/15 11:17:15 57347098 test.feather

test.feather文件大约:\(57347098/1024/1024 \approx 54.7MB\)

读取效率:

%%timeit

df = pd.read_feather("d:/share/test.feather")

130 ms ± 5.29 ms per loop (mean ± std. dev. of 7 runs, 10 loops each)

写入效率:

%%timeit

df.to_feather("d:/share/test.feather")

277 ms ± 14.8 ms per loop (mean ± std. dev. of 7 runs, 1 loop each)

6. 总结

pandas能够保存的文件格式有很多,比如还有XML,JSON,HTML等等,

上面列出的4种是我认为比较典型,且在数据分析领域用的比较多的格式。

4种格式的比较总结如下:

| 磁盘占用 | 读取效率 | 写入效率 | |

|---|---|---|---|

| csv | 96.7 MB | 1.73 s ± 54.7 ms | 13.2 s ± 402 ms |

| pickle | 111.5 MB | 136 ms ± 5.09 ms | 182 ms ± 7.42 ms |

| parquet | 31.4 MB | 200 ms ± 8.54 ms | 1.23 s ± 62.4 ms |

| feather | 54.7 MB | 130 ms ± 5.29 ms | 277 ms ± 14.8 ms |

综合来看,当我们的数据量不大的时候,用CSV格式比较好,分享方便,可以用多种编辑器直接打开查看。

当数据规模变大了之后,如果数据需要长期存储,而且不需要经常的更新写入,那么用parquet格式(它的磁盘占用最低,读取性能好,写入性能略逊);

如果只要短期存储的话,用fetdher格式更好(磁盘占用不算高,读写性能都不错)。

至于pickle格式,它的读写性能也不错,但它的最大优势是可以保存python对象的状态,只用来保存数据的话,这个优势难以体现。

而且它的磁盘占用比较大,单纯保存数据的话,不建议使用这种格式。

pandas:如何保存数据比较好?的更多相关文章

- pandas读取保存数据

将本人使用过的一些操作记录下来 1.读取数据,使用:data = pd.read_csv('./data/file.csv') 2.数据处理,如果你要修改某一个数据,其实把DATAFRAME数据看做是 ...

- pandas+sqlalchemy 保存数据到mysql

import pandas as pd from sqlalchemy import create_engine data3={"lsit1":[1,2],"lsit2& ...

- pandas学习(常用数学统计方法总结、读取或保存数据、缺省值和异常值处理)

pandas学习(常用数学统计方法总结.读取或保存数据.缺省值和异常值处理) 目录 常用数学统计方法总结 读取或保存数据 缺省值和异常值处理 常用数学统计方法总结 count 计算非NA值的数量 de ...

- [数据清洗]-使用 Pandas 清洗“脏”数据

概要 准备工作 检查数据 处理缺失数据 添加默认值 删除不完整的行 删除不完整的列 规范化数据类型 必要的转换 重命名列名 保存结果 更多资源 Pandas 是 Python 中很流行的类库,使用它可 ...

- [数据清洗]-Pandas 清洗“脏”数据(一)

概要 准备工作 检查数据 处理缺失数据 添加默认值 删除不完整的行 删除不完整的列 规范化数据类型 必要的转换 重命名列名 保存结果 更多资源 Pandas 是 Python 中很流行的类库,使用它可 ...

- Python 保存数据的方法(4种方法)

Python 保存数据的方法: open函数保存 使用with open()新建对象 写入数据(这里使用的是爬取豆瓣读书中一本书的豆瓣短评作为例子) import requests from lxml ...

- Pandas透视表处理数据(转)

手把手教你用Pandas透视表处理数据(附学习资料) 2018-01-06 数据派THU 来源:伯乐在线 - PyPer 本文共2203字,建议阅读5分钟.本文重点解释pandas中的函数pivot ...

- Python 保存数据的方法:

open函数保存 使用with open()新建对象 写入数据(这里使用的是爬取豆瓣读书中一本书的豆瓣短评作为例子) 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 ...

- [开发技巧]·pandas如何保存numpy元素

[开发技巧]·pandas如何保存numpy元素 1.问题描述 在开发的过程中遇到一个问题,就是需要把numpy作为pandas的一个元素进行保存,注意不是作为一列元素.但是实践的过程中却不顺利, ...

- EasyUI使用JSON保存数据

目前来说,使用JSON保存数据比较方便,前台可以不用Test.aspx 页面,可以直接用Html页面,使用.aspx页面的弊端就不在这里熬述. 具体步骤如下: 1.新建一个Html页面,命名为Test ...

随机推荐

- P3509 [POI2010] ZAB-Frog 题解

题目链接:ZAB-Frog 基于一个根据距离第 \(k\) 大的事实: 容易知道,对于红色的点而言,与它相近最近的 \(k\) 个点是连续的.而第 \(k\) 远的要么是最左侧要么是最右侧.而我们注意 ...

- [ Skill ] append1, append, nconc, tconc, lconc, cons 效率对比

https://www.cnblogs.com/yeungchie/ 先说结论:cons > tconc, lconc >> nconc > append1, append a ...

- Linux zip常用命令

1.将当前目录下的所有文件和文件夹全部压缩成myfile.zip内联代码块文件zip -r myfile.zip ./*-r表示递归压缩子目录下所有文件. 2.unzip把myfile.zip文件解压 ...

- NEMU PA 2-3 实验报告

课程地址:https://www.bilibili.com/video/BV1yC4y1s74C 一.实验目的 了解ELF符号表的解析 进一步完善调试器的功能,理解编译器的设计原理 二.实验步骤 在P ...

- 延时队列 DelayQueue

当用户超时未支付时,给用户发提醒消息.另一种场景是,超时未付款,订单自动取消.通常,订单创建的时候可以向延迟队列种插入一条消息,到时间自动执行.其实,也可以用临时表,把这些未支付的订单放到一个临时表中 ...

- JavaScript选择器

Js选择器 JS选择器常用的有getElementById().getElementsByClassName().getElementsByName().getElementsByTagName(). ...

- Laravel入坑指南(4)——数据库(Mysql)

来来来,新的一节出炉了.这一节大家一起了解,Laravel如何对Mysql进行CURD. 我们回顾一下,PHP操作Mysql无非就是通过五个要素:host(地址).username(用户名).pass ...

- Java I/O 教程(七) DataOutputStream和DataInputStream

Java DataOutputStream Class Java DataOutputStream class 可以以机器无关方式往指定输出流写入Java原始数据类型,例如int, double, l ...

- shell 定时清理一定时间内未使用的目录下文件脚本

配合crontab即可实现标题 使用 bash + 脚本 + 目录 bash xx.sh /root/xx/ 脚本如下: #!/bin/bash # 将current转换为时间戳,精确到秒 CURRE ...

- [攻防世界][Web]ics-06

打开靶机对应的url,展开是一个网站的样子,其实啥也么有 所有tab都点一遍,发现只有报表中心有内容,url为 http://61.147.171.105:49797/index.php?id=1 猜 ...