TensorFlow.NET机器学习入门【3】采用神经网络实现非线性回归

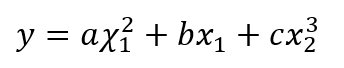

上一篇文章我们介绍的线性模型的求解,但有很多模型是非线性的,比如:

这里表示有两个输入,一个输出。

现在我们已经不能采用y=ax+b的形式去定义一个函数了,我们只能知道输入变量的数量,但不知道某个变量存在几次方的分量,所以我们采用一个神经网络去定义一个函数。

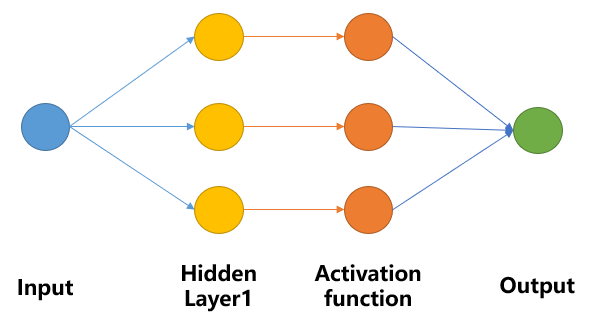

我们假设只有一个输入、一个输出,神经网络模型结构类似上图,其中蓝色的路径仍为线性模型,红色路径为阶跃函数,是非线性模型。

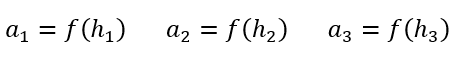

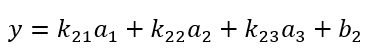

以上模型只有三个神经元,设输入为x,隐藏层为h,激活函数输出为a,最终输出为y,整个数据计算流情况如下:

以上共有6+3+1个变量,整个训练的过程就是要解出这些变量。官方教程内有自定义神经网络模型的求解代码,和解线性模型的流程一致,大致以下几个步骤:

1、默认所有k=1,b=0;

2、将x代入模型,求得pred_y,通过pred_y和y计算损失函数,在通过损失函数来计算梯度;

3、通过梯度调整k、b的值

4、重复上述2、3过程,直到损失函数足够小。

具体代码请参看官方示例代码。

我们这篇文章将采用Keras封装好的方法来进行神经网络的训练和应用。

整个程序包括:创建模型、训练模型和应用模型三个过程。

主线程代码:

public void Run()

{

//1、创建模型

Model model = BuildModel();

model.compile(loss: keras.losses.MeanSquaredError(),

optimizer: keras.optimizers.SGD(0.02f),

metrics: new[] { "mae" });

model.summary(); //2、训练模型

(NDArray train_x, NDArray train_y) = PrepareData(1000);

model.fit(train_x, train_y, batch_size: 64, epochs: 100); //3、应用模型(消费)

test(model);

}

1、创建模型

BuildModel方法定义如下:

/// <summary>

/// 构建网络模型

/// </summary>

private Model BuildModel()

{

// 网络参数

int num_features = 1; // data features

int n_hidden_1 = 16; // 1st layer number of neurons.

int num_out = 1; // total output . var model = keras.Sequential();

model.add(keras.Input(num_features));

model.add(keras.layers.Dense(n_hidden_1));

model.add(keras.layers.LeakyReLU(0.2f));

model.add(keras.layers.Dense(num_out)); return model;

}

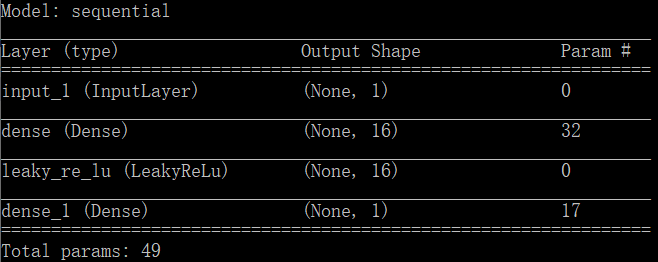

以上:Input为输入层,Dense为全连接层,激活函数可选包括:Sigmod、ReLu、LeakyReLu、tanh

model.compile方法定义该模型的训练方式:

loss: keras.losses.MeanSquaredError()表示损失函数采用均方差公式(MSE),这个公式上一篇文章介绍过

optimizer: keras.optimizers.SGD(0.02f)表示参数更新采用随机梯度下降法(SGD),学习率为0.02

metrics: new[] { "mae" }表示要显示的模型评价方法为平均绝对误差(Mean absolute Error),另外此处还有一个选项为acc,表示准确性( accuracy),后面在进行分类学习时将采用这种评价方法。

model.summary()方法将打印出该模型的摘要信息。

2、训练模型

(NDArray train_x, NDArray train_y) = PrepareData(1000);

model.fit(train_x, train_y, batch_size: 64, epochs: 100);

首先要加载学习数据,然后将学习数据提供给fit方法进行学习,batch_size 表示每次运算取的数据量,epochs表示循环迭代的次数。所有学习数据用完一次就表示一个epoch,1000除以64等于15.625,所以每计算16次就表示一个epoch。

整个训练过程中将打印出下列信息:

PrepareData方法:

/// <summary>

/// 加载训练数据

/// </summary>

/// <param name="total_size"></param>

private (NDArray, NDArray) PrepareData(int total_size)

{

float[,] arrx = new float[total_size, 1];

float[] arry = new float[total_size]; for (int i = 0; i < total_size; i++)

{

float x = (float)random.Next(-400, 400) / 100;

float y = x * x; arrx[i, 0] = x;

arry[i] = y;

} NDArray train_X = np.array(arrx);

NDArray train_Y = np.array(arry); return (train_X, train_Y);

}

该方法生成1000个符合y=x*x的标准数据。

3、应用模型

学习完成以后,该模型就可以用于实际应用了。我们随机生成一下数据,将模型计算的结果和理论实际的数值进行比较,可以判断模型是否有效。

/// <summary>

/// 消费模型

/// </summary>

private void test(Model model)

{

int test_size = 10; for (int i = 0; i < test_size; i++)

{

float x = (float)random.Next(-300, 300) / 100;

float y = x * x; var test_x = np.array(new float[1, 1] { { x } });

var pred_y = model.Apply(test_x); Console.WriteLine($"{i}:x={(float)test_x:0.00}\ty={y:0.0000} Pred:{(float)pred_y[0].numpy():0.0000}");

}

}

运行结果如下:

看结果情况,基本像那么一回事。

【相关资源】

源码:Git: https://gitee.com/seabluescn/tf_not.git

项目名称:NonlinearRegressionWithKeras

TensorFlow.NET机器学习入门【3】采用神经网络实现非线性回归的更多相关文章

- TensorFlow.NET机器学习入门【4】采用神经网络处理分类问题

上一篇文章我们介绍了通过神经网络来处理一个非线性回归的问题,这次我们将采用神经网络来处理一个多元分类的问题. 这次我们解决这样一个问题:输入一个人的身高和体重的数据,程序判断出这个人的身材状况,一共三 ...

- TensorFlow.NET机器学习入门【5】采用神经网络实现手写数字识别(MNIST)

从这篇文章开始,终于要干点正儿八经的工作了,前面都是准备工作.这次我们要解决机器学习的经典问题,MNIST手写数字识别. 首先介绍一下数据集.请首先解压:TF_Net\Asset\mnist_png. ...

- TensorFlow.NET机器学习入门【6】采用神经网络处理Fashion-MNIST

"如果一个算法在MNIST上不work,那么它就根本没法用:而如果它在MNIST上work,它在其他数据上也可能不work". -- 马克吐温 上一篇文章我们实现了一个MNIST手 ...

- TensorFlow.NET机器学习入门【7】采用卷积神经网络(CNN)处理Fashion-MNIST

本文将介绍如何采用卷积神经网络(CNN)来处理Fashion-MNIST数据集. 程序流程如下: 1.准备样本数据 2.构建卷积神经网络模型 3.网络学习(训练) 4.消费.测试 除了网络模型的构建, ...

- TensorFlow.NET机器学习入门【8】采用GPU进行学习

随着网络越来约复杂,训练难度越来越大,有条件的可以采用GPU进行学习.本文介绍如何在GPU环境下使用TensorFlow.NET. TensorFlow.NET使用GPU非常的简单,代码不用做任何修改 ...

- TensorFlow.NET机器学习入门【0】前言与目录

曾经学习过一段时间ML.NET的知识,ML.NET是微软提供的一套机器学习框架,相对于其他的一些机器学习框架,ML.NET侧重于消费现有的网络模型,不太好自定义自己的网络模型,底层实现也做了高度封装. ...

- TensorFlow.NET机器学习入门【1】开发环境与类型简介

项目开发环境为Visual Studio 2019 + .Net 5 创建新项目后首先通过Nuget引入相关包: SciSharp.TensorFlow.Redist是Google提供的TensorF ...

- TensorFlow.NET机器学习入门【2】线性回归

回归分析用于分析输入变量和输出变量之间的一种关系,其中线性回归是最简单的一种. 设: Y=wX+b,现已知一组X(输入)和Y(输出)的值,要求出w和b的值. 举个例子:快年底了,销售部门要发年终奖了, ...

- 45、Docker 加 tensorflow的机器学习入门初步

[1]最近领导天天在群里发一些机器学习的链接,搞得好像我们真的要搞机器学习似的,吃瓜群众感觉好神奇呀. 第一步 其实也是最后一步,就是网上百度一下,Docker Toolbox,下载下来,下载,安装之 ...

随机推荐

- 洛谷 P5897 - [IOI2013]wombats(决策单调性优化 dp+线段树分块)

题面传送门 首先注意到这次行数与列数不同阶,列数只有 \(200\),而行数高达 \(5000\),因此可以考虑以行为下标建线段树,线段树上每个区间 \([l,r]\) 开一个 \(200\times ...

- Rust 指定安装目录

集群home目录被管理员限制了存储空间,rust安装要100多M,默认安装home目录下,查了一圈,没找到rust指定安装目录的办法. 这里记录下解决办法: 在想要安装的目录执行 mkdir -p c ...

- php5.6升级7

1. 检查当前安装的 PHP查看当前 PHP 版本 php -v查看当前 PHP 相关的安装包 yum list installed | grep php2. 更换 RPM 源#Centos 5.X: ...

- EXCEL excel中运用ctrl+D、ctrl+enter、ctrl+E批量填充数据

在excel中,利用鼠标拖动可以快速向下或者向右填充序列或者复制单元格.但是利用快捷键也可以实现多种填充方式,本文就为大家介绍一些ctrl系列快捷键的填充,一起来看看吧. 封面tu 一,ctrl+D/ ...

- lsof之列出已打开的文件

lsof命令常用解析 Linux中常用 lsof 来查看文件调用进程等相关信息,也可用来查看活跃的进程信息和端口监听进程信息等 1. lsof 命令介绍 NAME lsof - list open f ...

- Python获取随机数

Python当中,可用random模块来获取随机数 import random """ random模块,用于获取随机数 """ print ...

- OpenStack之九: 创建一个实例

官网地址 https://docs.openstack.org/install-guide/launch-instance-networks-provider.html #:导入变量 [root@co ...

- css clip样式 属性功能及作用

clip clip 在学前端的小伙伴前,估计是很少用到的,代码中也是很少看见的,但是,样式中有这样的代码,下面让我们来讲讲他吧! 这个我也做了很久的开发没碰到过这个属性,知道我在一个项目中,有一个功能 ...

- 【Java基础】HashMap原理详解

哈希表(hash table) 也叫散列表,是一种非常重要的数据结构,应用场景及其丰富,许多缓存技术(比如memcached)的核心其实就是在内存中维护一张大的哈希表,本文会对java集合框架中Has ...

- 基于注解的方式搭建mybatis开发框架

1.创建工程 <groupId>com.hope</groupId> <artifactId>day01_eesy_01mybatis</artifa ...