强化学习复习笔记 - DEEP

Outline

使用逼近器的特点:

较少数量的参数表达复杂的函数 (计算复杂度)

对一个权重的调整可以影响到很多的点 (泛化能力)

多种特征表示和逼近器结构 (多样性)

激活函数

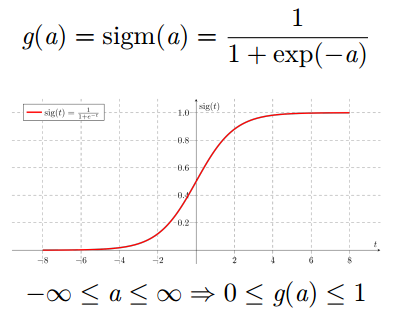

Sigmoid 激活函数

将神经元的输出压缩在 0 和 1 之间

永远都是正数

有界

严格递增

tanh 双曲正切函数

将神经元的输出压缩在

-1 和 1 之间

有正有负

有界

严格递增

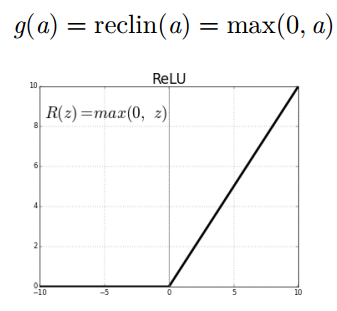

线性整流 (Rectified Linear Unit, ReLU) 激活函数

以 0 作为下界 (永远都是非负的)

容易让神经元产生稀疏的激活行为

无上界

严格递增

通用近似定理 (Hornik, 1991)

“如果一个前馈神经网络具有线性输出层和至少一层隐藏层, 只要给予网络足够数量的神经元,便可以实现以足够高精度来逼近任意一个在 Rn 的紧子集 (Compact subset) 上的连续函数。 ”

定理适用于 sigmoid, tanh, 和其它激活函数

但是定理并不代表一定存在某个学习算法, 能够找到具有满足近似性能的参数

置信风险: 分类器对 未知样本进行分类,得到的误差。

经验风险: 训练好的分类器,对训练样本重新分类得到的误差。即样本误差

结构风险:置信风险 + 经验风险

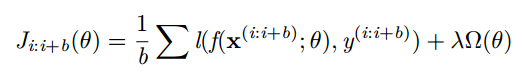

小批量 Mini-batch 梯度下降

更新是基于一组小批量的样本 {(x(i:i+b); y(i:i+b))}(不再是单 一样本)

梯度对应于正则化损失在小批量样本上的平均

可以得到对梯度更加精确的估计

可以使用矩阵运算, 计算效率更高

在训练集 Dtrain上训练你的模型

在验证集 Dvalid上选择模型

-----包括选择超参; 隐含层尺寸; 学习率; 迭代/训练次数; 等等

在测试集 Dtext上评估泛化能力

泛化的含义是模型在未见过的样本上的表现

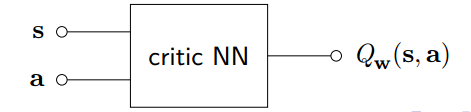

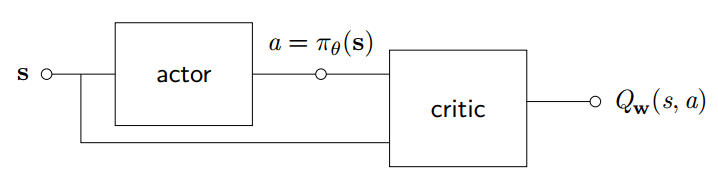

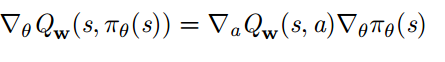

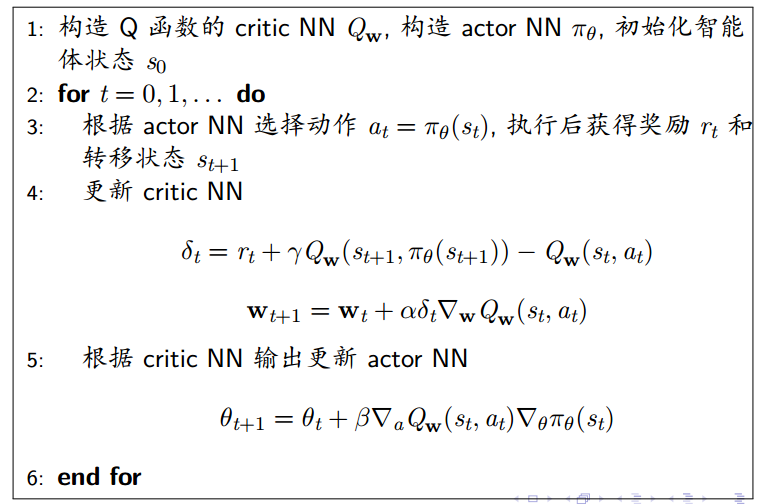

确定性 Actor-Critic

对于确定性策略, 可以使用神经网络逼近器构建 actor, 直接输出策略确定性的动作

设计另一个神经网络构造 Critic 用于逼近 Q 函数

对 Critic NN 可以使用例如 TD 学习算法训练网络权重

对 Actor NN 希望能够输出最优动作使得 Q 函数最大化

强化学习复习笔记 - DEEP的更多相关文章

- 强化学习读书笔记 - 02 - 多臂老O虎O机问题

# 强化学习读书笔记 - 02 - 多臂老O虎O机问题 学习笔记: [Reinforcement Learning: An Introduction, Richard S. Sutton and An ...

- 强化学习读书笔记 - 05 - 蒙特卡洛方法(Monte Carlo Methods)

强化学习读书笔记 - 05 - 蒙特卡洛方法(Monte Carlo Methods) 学习笔记: Reinforcement Learning: An Introduction, Richard S ...

- 强化学习读书笔记 - 06~07 - 时序差分学习(Temporal-Difference Learning)

强化学习读书笔记 - 06~07 - 时序差分学习(Temporal-Difference Learning) 学习笔记: Reinforcement Learning: An Introductio ...

- 强化学习读书笔记 - 13 - 策略梯度方法(Policy Gradient Methods)

强化学习读书笔记 - 13 - 策略梯度方法(Policy Gradient Methods) 学习笔记: Reinforcement Learning: An Introduction, Richa ...

- 强化学习读书笔记 - 12 - 资格痕迹(Eligibility Traces)

强化学习读书笔记 - 12 - 资格痕迹(Eligibility Traces) 学习笔记: Reinforcement Learning: An Introduction, Richard S. S ...

- 强化学习读书笔记 - 11 - off-policy的近似方法

强化学习读书笔记 - 11 - off-policy的近似方法 学习笔记: Reinforcement Learning: An Introduction, Richard S. Sutton and ...

- 强化学习读书笔记 - 10 - on-policy控制的近似方法

强化学习读书笔记 - 10 - on-policy控制的近似方法 学习笔记: Reinforcement Learning: An Introduction, Richard S. Sutton an ...

- 强化学习读书笔记 - 09 - on-policy预测的近似方法

强化学习读书笔记 - 09 - on-policy预测的近似方法 参照 Reinforcement Learning: An Introduction, Richard S. Sutton and A ...

- 强化学习系列之:Deep Q Network (DQN)

文章目录 [隐藏] 1. 强化学习和深度学习结合 2. Deep Q Network (DQN) 算法 3. 后续发展 3.1 Double DQN 3.2 Prioritized Replay 3. ...

随机推荐

- 【Wince-ListView】Wince中的 ListView怎么显示网格?

using System.Runtime.InteropServices; using System.Windows.Forms; namespace CETEST { public class Co ...

- VirtualBox 安装CentOS虚拟机网卡配置

VirtualBox虚拟机网络设置(NAT+HOST-ONLY) 目标: 虚拟机可以像宿主机一样访问互联网和其他主机 宿主机和虚拟机可以相互访问 使用NAT实现目标一 使用Host-Only实现目标二 ...

- js 获取 touch length

window.addEventListener("touchstart", touchHandler, false); function touchHandler(event){ ...

- jquery判断元素是否可见隐藏

<!DOCTYPE html> <html> <head> <meta charset=" utf-8"> <meta nam ...

- jmeter操作登录等简单的使用

一.登录 1.打开jmeter创建“线程组” 2.创建HTTP默认值 3.添加http默认值后,后边的http请求就可以省略填写部分内容 4.添加“HTTP信息管理头”在内添加名称:“Content- ...

- 8.2 HTML表单提交

一.form表单 <form>用于向服务器提交数据,比如账号密码 使用method="get" 提交数据 是常用的提交数据的方式 如果form元素没有提供method属 ...

- Leetcode题目22.括号生成(动态规划-中等)

题目描述: 给出 n 代表生成括号的对数,请你写出一个函数,使其能够生成所有可能的并且有效的括号组合. 例如,给出 n = 3,生成结果为: [ "((()))", "( ...

- 2018-2019-2 20175215 实验三《敏捷开发与XP实践》实验报告

一.实验内容与步骤 1.安装.使用alibaba 插件规范代码 在IDEA的setting中找到plugins并搜索alibaba,点击install进行安装 重启IDEA后,在代码中右击点击编码规约 ...

- Springboot集成MongoDB实现CRUD

特别提示:本人博客部分有参考网络其他博客,但均是本人亲手编写过并验证通过.如发现博客有错误,请及时提出以免误导其他人,谢谢!欢迎转载,但记得标明文章出处:http://www.cnblogs.com/ ...

- Linux Ubuntu 用c++11编译

加上: -std=c++ 例如: g++ test.