The Multilinear Structure of ReLU Networks

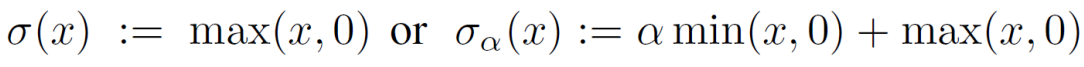

两种非常常见的非线性单元:rectified linear units (ReLUs) 和 leaky ReLUs

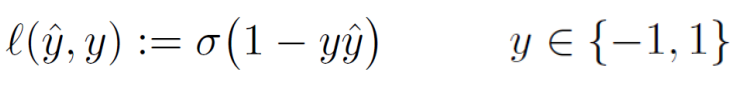

我们选取binary hinge loss进行二分类

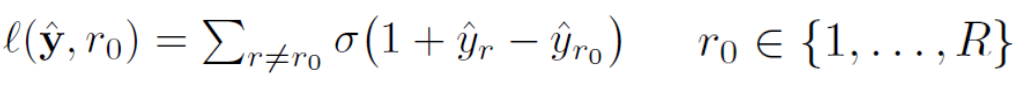

对于多分类,我们可以定义multiclass hinge loss

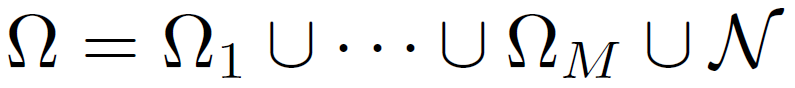

定义Ω为网络的参数空间, L(ω)为loss。

由于我们选了ReLU非线性单元作为loss, 那么L(ω)是分片线性的。对于参数空间,我们可以将其进行一个划分,

分成有限个open cells Ωu 和 边界N,则损失函数L(ω)在cell的内部是光滑的,在边界上是不可微的。

下面我们将loss限制在某个cell Ωu上单独考虑,并且loss拥有multilinear form. 由于multilinear form是调和的,由strong maximum principle知,极值点必定在边界处N. 换句话说,ReLU 神经网络 with hinge loss L(ω)是不存在可微的局部极值点的。

目前为止,我们可以知道局部极值有两种情况,

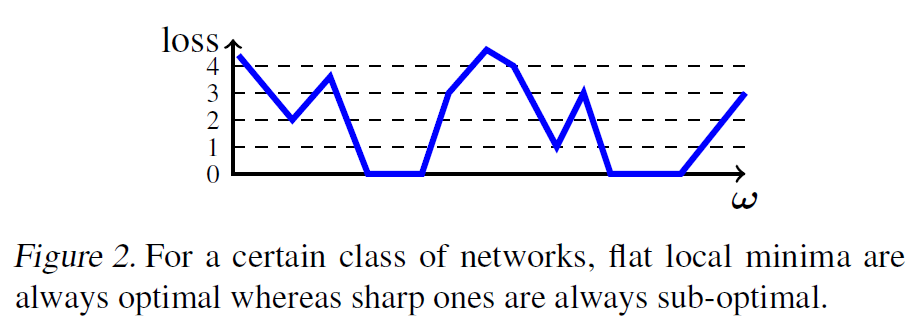

Type I (Flat). 局部极值在cell中,loss为常值。

Type II (Sharp). 局部极值在边界N上。

Main Result 1. 在Type II局部极值点,L(ω)>0.

也就是说,如果存在极值0,那么Type II极值点都是sub-optimal的。

若我们考虑更一般的情况:fully connected networks with leaky ReLU nonlinearities. 那么我们有以下结果,

Main Result 2. 在Type I局部极值点,L(ω)=0. 在Type II局部极值点,L(ω)>0.

在存在极值0的情况下,flat 局部极小值都是optimal的,sharp 局部极小值都是sub-optimal的。若不存在极值0,所有的局部极值点都是sharp的。

未完待续。。。

The Multilinear Structure of ReLU Networks的更多相关文章

- 课程一(Neural Networks and Deep Learning),第四周(Deep Neural Networks) —— 3.Programming Assignments: Deep Neural Network - Application

Deep Neural Network - Application Congratulations! Welcome to the fourth programming exercise of the ...

- DEEP LEARNING WITH STRUCTURE

DEEP LEARNING WITH STRUCTURE Charlie Tang is a PhD student in the Machine Learning group at the Univ ...

- 课程一(Neural Networks and Deep Learning)总结——2、Deep Neural Networks

Deep L-layer neural network 1 - General methodology As usual you will follow the Deep Learning metho ...

- 深度学习材料:从感知机到深度网络A Deep Learning Tutorial: From Perceptrons to Deep Networks

In recent years, there’s been a resurgence in the field of Artificial Intelligence. It’s spread beyo ...

- [综述]Deep Compression/Acceleration深度压缩/加速/量化

Survey Recent Advances in Efficient Computation of Deep Convolutional Neural Networks, [arxiv '18] A ...

- 网络压缩论文集(network compression)

Convolutional Neural Networks ImageNet Models Architecture Design Activation Functions Visualization ...

- CVPR 2017 Paper list

CVPR2017 paper list Machine Learning 1 Spotlight 1-1A Exclusivity-Consistency Regularized Multi-View ...

- (转) Deep Reinforcement Learning: Playing a Racing Game

Byte Tank Posts Archive Deep Reinforcement Learning: Playing a Racing Game OCT 6TH, 2016 Agent playi ...

- 社区发现算法问题&&NetworkX&&Gephi

在做东西的时候用到了社区发现,因此了解了一下有关社区发现的一些问题 1,社区发现算法 (1)SCAN:一种基于密度的社团发现算法 Paper: <SCAN: A Structural Clust ...

随机推荐

- koa cookie使用

1 .Koa 中设置 Cookie 的值 ctx.cookies.set(name, value, [options]) 通过 options 置 设置 cookie name 的 value : ...

- [转]【JVM】调优笔记2-----JVM在JDK1.8以后的新特性以及VisualVM的安装使用

[From]https://www.cnblogs.com/sxdcgaq8080/p/7156227.html 隔壁的,加个引用做书签! [JVM]调优笔记2-----J ...

- 083. Remove Duplicates from Sorted List

题目链接:https://leetcode.com/problems/rotate-list/description/ Given a sorted linked list, delete all d ...

- JavaScript基础入门10

目录 JavaScript 基础入门10 正则表达式 为什么使用正则表达式? 正则表达式的应用场景 如何创建一个正则表达式 基础语法 具有特殊意义的转义字符 量词 字符类 贪婪模式 练习 邮箱验证 中 ...

- python高级 之(零) --- 重点难点

生成式子 列表生成式 字典生成式 深浅拷贝 list0 = [12,24,34,32,[64,23]] # 浅拷贝:浅拷贝只是将最外层容器拷贝一份放在堆里面,内层的容器不会被拷贝还是使用原来的地址 l ...

- Cobalt Strike DLL用于永恒之蓝注入

PDF下载:blob:https://www.52stu.org/9afe109c-f95f-4cb3-a180-90d469a1d001 我们在对存在MS17010的漏洞主机进行DLL注入的时候,一 ...

- 【VS开发】浅谈C/C++中的static和extern关键字

一.C语言中的static关键字 在C语言中,static可以用来修饰局部变量,全局变量以及函数.在不同的情况下static的作用不尽相同. (1)修饰局部变量 一般情况下,对于局部变量是存放在栈区的 ...

- JVM内存结构、Java内存模型和Java对象模型

Java作为一种面向对象的,跨平台语言,其对象.内存等一直是比较难的知识点.而且很多概念的名称看起来又那么相似,很多人会傻傻分不清楚.比如本文要讨论的JVM内存结构.Java内存模型和Java对象模型 ...

- hadoop3.0.0部署

配置前先查下JAVA_HOME的位置vim /etc/profile#set java environment JAVA_HOME=/usr/lib/jvm/java-1.8.0-openjdk-1. ...

- Find Duplicate Subtrees

Given a binary tree, return all duplicate subtrees. For each kind of duplicate subtrees, you only ne ...