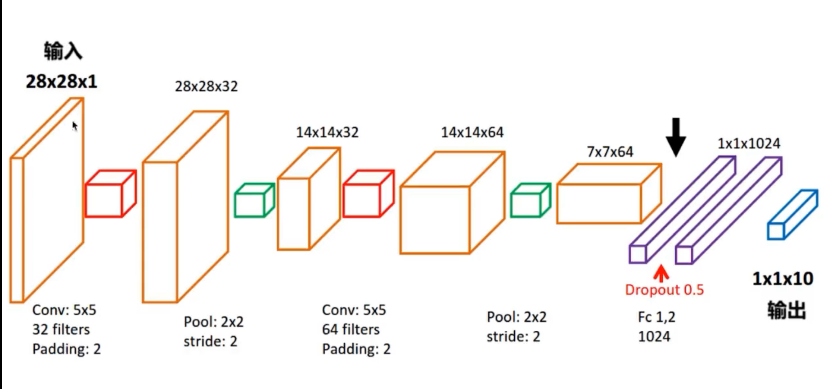

实现CNN卷积神经网络

以上是模型,下面是代码:

import tensorflow as tf

import numpy as np

import time

from tensorflow.examples.tutorials.mnist import input_data import os

os.environ['TF_CPP_MIN_LOG_LEVEL'] = '' start = time.clock() # 下载并载入MNIST 手写数字库

mnist = input_data.read_data_sets("./data/MNIST", one_hot=True) input_x = tf.placeholder(tf.float32, shape=[None, 28 * 28]) / 255 # 灰度的处理

output_y = tf.placeholder(tf.float32, shape=[None, 10]) #输出10个数字的标签

input_x_images = tf.reshape(input_x, shape=[-1, 28, 28, 1]) #改变形状之后的输入 # 从Test(测试)数据集里选取3000个手写数字的图片和对应的标签

test_x = mnist.test.images[:3000]

test_y = mnist.test.labels[:3000] # 构建我们的卷积神经网络

# 第一层卷积

conv1 = tf.layers.conv2d(inputs=input_x_images, # 形状为[28,28,1]

filters=32, # 32个过滤器,输出的深度位32

kernel_size=[5, 5], # 过滤器在二维的大小是(5*5)

strides=1, # 步长是1

padding="same", # snme表示输出大小不变,因此要在外围补零2圈

activation=tf.nn.relu # 表示激活函数是relu

) # 形状[28,28,32] # 第一层池化(亚采样)

pool1 = tf.layers.max_pooling2d(

inputs=conv1, # 形状[28,28,32]

pool_size=[2, 2], # 过滤器在二维的大小是[2,2]

strides=2 # 步长是2

) # 形状[14,14,32] # 第二层卷积

conv2 = tf.layers.conv2d(inputs=pool1, # 形状为[14,14,32]

filters=64, # 64个过滤器,输出的深度位64

kernel_size=[5, 5], # 过滤器在二维的大小是(5*5)

strides=1, # 步长是1

padding="same", # snme表示输出大小不变,因此要在外围补零2圈

activation=tf.nn.relu # 表示激活函数是relu

) # 形状[14,14,64] # 第二层池化(亚采样)

pool2 = tf.layers.max_pooling2d(

inputs=conv2, # 形状[14,14,64]

pool_size=[2, 2], # 过滤器在二维的大小是[2,2]

strides=2 # 步长是2

) # 形状[7,7,64] #平坦化(flat)

flat = tf.reshape(pool2,shape=[-1,7 * 7 * 64]) #形状[7 * 7 * 64] #1024个神经元的全连接层

dense = tf.layers.dense(inputs=flat,units=1024,activation=tf.nn.relu) #Dropout :丢弃 50% rate = 0.5

dropout = tf.layers.dropout(inputs=dense,rate=0.5) #10个神经元的全连接层,这里不用激活函数来做非线性化了。

logits = tf.layers.dense(inputs=dropout,units=10) #输出形状[1,1,10] #计算误差(计算 Cross entropy(交叉熵)),再用softmax计算百分比概率

loss = tf.losses.softmax_cross_entropy(onehot_labels=output_y,logits=logits) # Adam 优化器来最小化误差,学习率0.001

train_op = tf.train.AdadeltaOptimizer(learning_rate=0.001).minimize(loss) #精度,计算,预测值 和 实际标签 的匹配程度

#返回 (accuracy .update_op) 会创建两个局部变量

accuracy = tf.metrics.accuracy(

labels=tf.argmax(input=output_y,axis=1),

predictions=tf.argmax(input=logits,axis=1)

)[1] #创建会话

with tf.Session() as sess:

#初始化变量

init = tf.group(tf.global_variables_initializer(),tf.local_variables_initializer())

sess.run(init)

for i in range(20000):

batch = mnist.train.next_batch(50) #从Train(训练)数据集里下一个50个样本

train_loss,train_op_ = sess.run([loss,train_op],feed_dict={input_x:batch[0],output_y:batch[1]})

if i % 100 == 0:

test_accuracy = sess.run(accuracy,feed_dict={input_x:test_x,output_y:test_y})

print(("Step+%d,Train loss=%.4f,[Test accuracy=%.2f]") % (i,train_loss,test_accuracy)) #测试:打印20个 预测值 和 真实值 的对

test_output = sess.run(logits,feed_dict={input_x:test_x[:20]})

inference_y = np.argmax(test_output,1)

print(inference_y," Inference number") #推测的数字

print(np.argmax(test_y[:20],1),"Real numbers") #真实的数字 #显示时间

end = time.clock()

print(end - start, "秒")

当然CNN还有很长一段路要走。代码不容易,且敲且珍惜。

实现CNN卷积神经网络的更多相关文章

- Deep Learning模型之:CNN卷积神经网络(一)深度解析CNN

http://m.blog.csdn.net/blog/wu010555688/24487301 本文整理了网上几位大牛的博客,详细地讲解了CNN的基础结构与核心思想,欢迎交流. [1]Deep le ...

- [转]Theano下用CNN(卷积神经网络)做车牌中文字符OCR

Theano下用CNN(卷积神经网络)做车牌中文字符OCR 原文地址:http://m.blog.csdn.net/article/details?id=50989742 之前时间一直在看 Micha ...

- Deep Learning论文笔记之(四)CNN卷积神经网络推导和实现(转)

Deep Learning论文笔记之(四)CNN卷积神经网络推导和实现 zouxy09@qq.com http://blog.csdn.net/zouxy09 自己平时看了一些论文, ...

- CNN(卷积神经网络)、RNN(循环神经网络)、DNN(深度神经网络)的内部网络结构有什么区别?

https://www.zhihu.com/question/34681168 CNN(卷积神经网络).RNN(循环神经网络).DNN(深度神经网络)的内部网络结构有什么区别?修改 CNN(卷积神经网 ...

- CNN(卷积神经网络)、RNN(循环神经网络)、DNN,LSTM

http://cs231n.github.io/neural-networks-1 https://arxiv.org/pdf/1603.07285.pdf https://adeshpande3.g ...

- day-16 CNN卷积神经网络算法之Max pooling池化操作学习

利用CNN卷积神经网络进行训练时,进行完卷积运算,还需要接着进行Max pooling池化操作,目的是在尽量不丢失图像特征前期下,对图像进行downsampling. 首先看下max pooling的 ...

- cnn(卷积神经网络)比较系统的讲解

本文整理了网上几位大牛的博客,详细地讲解了CNN的基础结构与核心思想,欢迎交流. [1]Deep learning简介 [2]Deep Learning训练过程 [3]Deep Learning模型之 ...

- Keras(四)CNN 卷积神经网络 RNN 循环神经网络 原理及实例

CNN 卷积神经网络 卷积 池化 https://www.cnblogs.com/peng8098/p/nlp_16.html 中有介绍 以数据集MNIST构建一个卷积神经网路 from keras. ...

- TensorFlow——CNN卷积神经网络处理Mnist数据集

CNN卷积神经网络处理Mnist数据集 CNN模型结构: 输入层:Mnist数据集(28*28) 第一层卷积:感受视野5*5,步长为1,卷积核:32个 第一层池化:池化视野2*2,步长为2 第二层卷积 ...

- tensorflow CNN 卷积神经网络中的卷积层和池化层的代码和效果图

tensorflow CNN 卷积神经网络中的卷积层和池化层的代码和效果图 因为很多 demo 都比较复杂,专门抽出这两个函数,写的 demo. 更多教程:http://www.tensorflown ...

随机推荐

- MySQL运行内存不足时应采取的措施?

排除故障指南:MySQL运行内存不足时应采取的措施? 天一阁@ 老叶茶馆 1周前 导读 排除故障指南:MySQL运行内存不足时应采取的措施? 翻译团队:知数堂藏经阁项目 - 天一阁 团队成员:天一阁- ...

- 【C++】关键字inline

1. 引入inline关键字的原因 在c/c++中,为了解决一些频繁调用的小函数大量消耗栈空间(栈内存)的问题,特别的引入了inline修饰符,表示为内联函数. 栈空间就是指放置程序的局部数据(也就是 ...

- SpringCloud项目启动报错:NoClassDefFoundError: org/springframework/core/env/EnvironmentCapable

报错表象: 当启动SpringClud项目报错: Exception in thread "main" java.lang.NoClassDefFoundError: org/sp ...

- 将NULL值转化为“”

// 将NULL转化为“”,1是需要修改的实体类参数,3是转化后的实体对象 String 2= JSON.toJSONString(1, SerializerFeature.WriteNullStri ...

- 利用redis 漏洞入侵挖矿临时解决办法

top 看到一个bashd的进程占据了cpu ps aux |grep bashd cd /tmp 发现ddg.2011 的文件.root dump.rdb 在/root/.ssh 也有奇怪的文件 ...

- http/https协议

HTTP 1. 概念 HTTP协议是Hyper Text Transfer Protocol(超文本传输协议)的缩写,是用于从万维网(WWW:World Wide Web )服务器传输超文本到本地浏览 ...

- Python 之 __new__() 方法与实例化

原文链接:https://www.cnblogs.com/ifantastic/p/3175735.html __new__() 是在新式类中新出现的方法,它作用在构造方法建造实例之前,可以这么理解, ...

- 设置 P2415Q & P2715Q 显示器使其支持 HDMI 2.0 启用 4k@60hz

简介:2016 年 2 月后购买的 Dell P2415Q 和 P2715Q 显示器,支持 HDMI 2.0,但是默认启用的是 HDMI 1.4. HDMI 2.0 默认没有启用 Dell P2415 ...

- dll导出函数的两种方式的比较

最初的网页链接已经挂了, 在此贴一个中间的转载链接 https://blog.csdn.net/zhazhiqiang/article/details/51577523 一 概要 vs中导出 dll的 ...

- 检查邮箱IP是否在国际反垃圾邮件组织的黑名单中

有时候邮件发不出去,很有可能就是邮件服务器的IP被国际上一些反垃圾组织列入黑名单了,这时你可以通过返回的邮件判断是否进入黑名单,或者通过以下查询地址看是否被列入,然后一个个申请移除: http://m ...