Python中利用LSTM模型进行时间序列预测分析

时间序列模型

时间序列预测分析就是利用过去一段时间内某事件时间的特征来预测未来一段时间内该事件的特征。这是一类相对比较复杂的预测建模问题,和回归分析模型的预测不同,时间序列模型是依赖于事件发生的先后顺序的,同样大小的值改变顺序后输入模型产生的结果是不同的。

举个栗子:根据过去两年某股票的每天的股价数据推测之后一周的股价变化;根据过去2年某店铺每周想消费人数预测下周来店消费的人数等等

RNN 和 LSTM 模型

时间序列模型最常用最强大的的工具就是递归神经网络(recurrent neural network, RNN)。相比与普通神经网络的各计算结果之间相互独立的特点,RNN的每一次隐含层的计算结果都与当前输入以及上一次的隐含层结果相关。通过这种方法,RNN的计算结果便具备了记忆之前几次结果的特点。

典型的RNN网路结构如下:

右侧为计算时便于理解记忆而产开的结构。简单说,x为输入层,o为输出层,s为隐含层,而t指第几次的计算;V,W,U为权重,其中计算第t次的隐含层状态时为St = f(U*Xt + W*St-1),实现当前输入结果与之前的计算挂钩的目的。对RNN想要更深入的了解可以戳这里。

RNN的局限:

由于RNN模型如果需要实现长期记忆的话需要将当前的隐含态的计算与前n次的计算挂钩,即St = f(U*Xt + W1*St-1 + W2*St-2 + ... + Wn*St-n),那样的话计算量会呈指数式增长,导致模型训练的时间大幅增加,因此RNN模型一般直接用来进行长期记忆计算。

LSTM模型

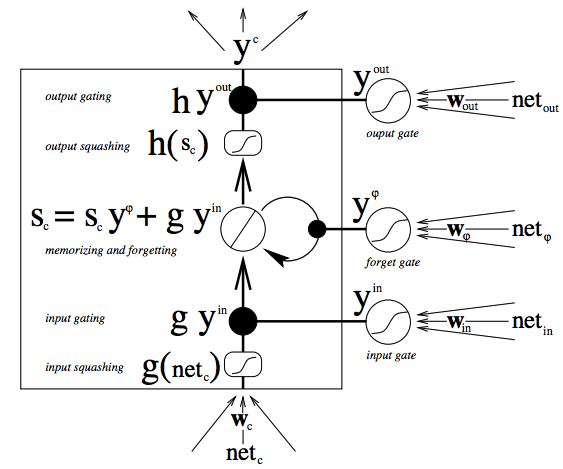

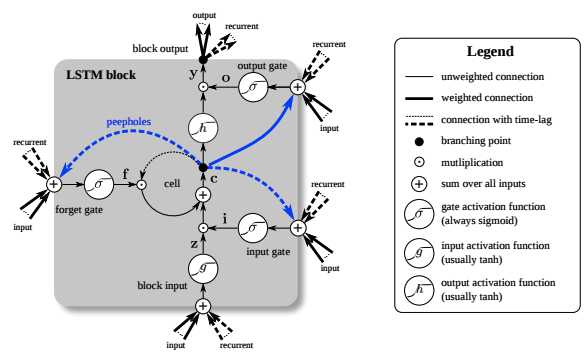

LSTM(Long Short-Term Memory)模型是一种RNN的变型,最早由Juergen Schmidhuber提出的。经典的LSTM模型结构如下:

LSTM的特点就是在RNN结构以外添加了各层的阀门节点。阀门有3类:遗忘阀门(forget gate),输入阀门(input gate)和输出阀门(output gate)。这些阀门可以打开或关闭,用于将判断模型网络的记忆态(之前网络的状态)在该层输出的结果是否达到阈值从而加入到当前该层的计算中。如图中所示,阀门节点利用sigmoid函数将网络的记忆态作为输入计算;如果输出结果达到阈值则将该阀门输出与当前层的的计算结果相乘作为下一层的输入(PS:这里的相乘是在指矩阵中的逐元素相乘);如果没有达到阈值则将该输出结果遗忘掉。每一层包括阀门节点的权重都会在每一次模型反向传播训练过程中更新。更具体的LSTM的判断计算过程如下图所示:

LSTM模型的记忆功能就是由这些阀门节点实现的。当阀门打开的时候,前面模型的训练结果就会关联到当前的模型计算,而当阀门关闭的时候之前的计算结果就不再影响当前的计算。因此,通过调节阀门的开关我们就可以实现早期序列对最终结果的影响。而当你不不希望之前结果对之后产生影响,比如自然语言处理中的开始分析新段落或新章节,那么把阀门关掉即可。(对LSTM想要更具体的了解可以戳这里)

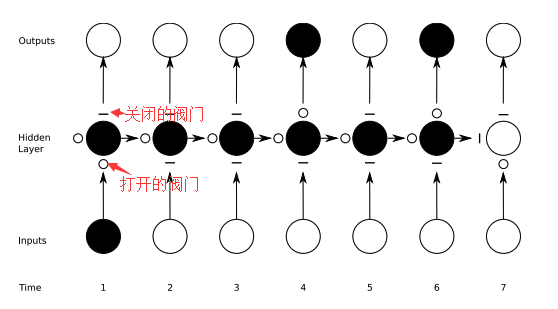

下图具体演示了阀门是如何工作的:通过阀门控制使序列第1的输入的变量影响到了序列第4,6的的变量计算结果。

黑色实心圆代表对该节点的计算结果输出到下一层或下一次计算;空心圆则表示该节点的计算结果没有输入到网络或者没有从上一次收到信号。

Python中实现LSTM模型搭建

Python中有不少包可以直接调用来构建LSTM模型,比如pybrain, kears, tensorflow, cikit-neuralnetwork等(更多戳这里)。这里我们选用keras。(PS:如果操作系统用的linux或者mac,强推Tensorflow!!!)

因为LSTM神经网络模型的训练可以通过调整很多参数来优化,例如activation函数,LSTM层数,输入输出的变量维度等,调节过程相当复杂。这里只举一个最简单的应用例子来描述LSTM的搭建过程。

应用实例

基于某家店的某顾客的历史消费的时间推测该顾客前下次来店的时间。具体数据如下所示:

消费时间

2015-05-15 14:03:51

2015-05-15 15:32:46

2015-06-28 18:00:17

2015-07-16 21:27:18

2015-07-16 22:04:51

2015-09-08 14:59:56

..

..

具体操作:

1. 原始数据转化

首先需要将时间点数据进行数值化。将具体时间转化为时间段用于表示该用户相邻两次消费的时间间隔,然后再导入模型进行训练是比较常用的手段。转化后的数据如下:

消费间隔

0

44

18

0

54

..

..

2.生成模型训练数据集(确定训练集的窗口长度)

这里的窗口指需要几次消费间隔用来预测下一次的消费间隔。这里我们先采用窗口长度为3, 即用t-2, t-1,t次的消费间隔进行模型训练,然后用t+1次间隔对结果进行验证。数据集格式如下:X为训练数据,Y为验证数据。

PS: 这里说确定也不太合适,因为窗口长度需要根据模型验证结果进行调整的。

X1 X2 X3 Y

0 44 18 0

44 18 0 54

..

..

注:直接这样预测一般精度会比较差,可以把预测值Y根据数值bin到几类,然后用转换成one-hot标签再来训练会比较好。比如如果把Y按数值范围分到五类(1:0-20,2:20-40,3:40-60,4:60-80,5:80-100)上式可化为:

X1 X2 X3 Y

0 44 18 0

44 18 0 4

...

Y转化成one-hot以后则是(关于one-hot编码可以参考这里)

1 0 0 0 0

0 0 0 0 1

...

3. 网络模型结构的确定和调整

这里我们使用python的keras库。(用java的同学可以参考下deeplearning4j这个库)。网络的训练过程设计到许多参数的调整:比如

- 需要确定LSTM模块的激活函数(activation fucntion)(keras中默认的是tanh);

- 确定接收LSTM输出的完全连接人工神经网络(fully-connected artificial neural network)的激活函数(keras中默认为linear);

- 确定每一层网络节点的舍弃率(为了防止过度拟合(overfit)),这里我们默认值设定为0.2;

- 确定误差的计算方式,这里我们使用均方误差(mean squared error);

- 确定权重参数的迭代更新方式,这里我们采用RMSprop算法,通常用于RNN网络。

- 确定模型训练的epoch和batch size(关于模型的这两个参数具体解释戳这里)

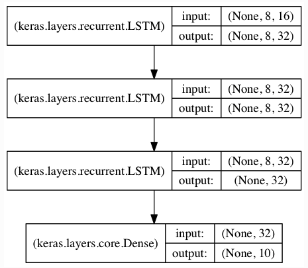

一般来说LSTM模块的层数越多(一般不超过3层,再多训练的时候就比较难收敛),对高级别的时间表示的学习能力越强;同时,最后会加一层普通的神经网路层用于输出结果的降维。典型结构如下:

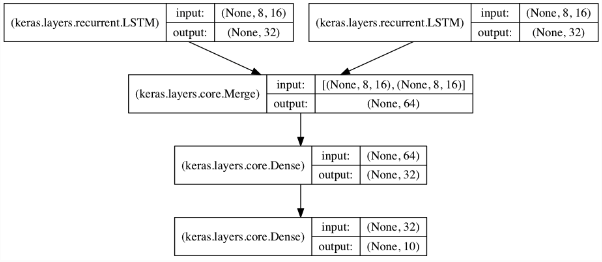

如果需要将多个序列进行同一个模型的训练,可以将序列分别输入到独立的LSTM模块然后输出结果合并后输入到普通层。结构如下:

4. 模型训练和结果预测

将上述数据集按4:1的比例随机拆分为训练集和验证集,这是为了防止过度拟合。训练模型。然后将数据的X列作为参数导入模型便可得到预测值,与实际的Y值相比便可得到该模型的优劣。

实现代码

- 时间间隔序列格式化成所需的训练集格式

import pandas as pd

import numpy as np

def create_interval_dataset(dataset, look_back):

"""

:param dataset: input array of time intervals

:param look_back: each training set feature length

:return: convert an array of values into a dataset matrix.

"""

dataX, dataY = [], []

for i in range(len(dataset) - look_back):

dataX.append(dataset[i:i+look_back])

dataY.append(dataset[i+look_back])

return np.asarray(dataX), np.asarray(dataY)

df = pd.read_csv("path-to-your-time-interval-file")

dataset_init = np.asarray(df) # if only 1 column

dataX, dataY = create_interval_dataset(dataset, lookback=3) # look back if the training set sequence length

这里的输入数据来源是csv文件,如果输入数据是来自数据库的话可以参考这里

2. LSTM网络结构搭建

import pandas as pd

import numpy as np

import random

from keras.models import Sequential, model_from_json

from keras.layers import Dense, LSTM, Dropout

class NeuralNetwork():

def __init__(self, **kwargs):

"""

:param **kwargs: output_dim=4: output dimension of LSTM layer; activation_lstm='tanh': activation function for LSTM layers; activation_dense='relu': activation function for Dense layer; activation_last='sigmoid': activation function for last layer; drop_out=0.2: fraction of input units to drop; np_epoch=10, the number of epoches to train the model. epoch is one forward pass and one backward pass of all the training examples; batch_size=32: number of samples per gradient update. The higher the batch size, the more memory space you'll need; loss='mean_square_error': loss function; optimizer='rmsprop'

"""

self.output_dim = kwargs.get('output_dim', 8)

self.activation_lstm = kwargs.get('activation_lstm', 'relu')

self.activation_dense = kwargs.get('activation_dense', 'relu')

self.activation_last = kwargs.get('activation_last', 'softmax') # softmax for multiple output

self.dense_layer = kwargs.get('dense_layer', 2) # at least 2 layers

self.lstm_layer = kwargs.get('lstm_layer', 2)

self.drop_out = kwargs.get('drop_out', 0.2)

self.nb_epoch = kwargs.get('nb_epoch', 10)

self.batch_size = kwargs.get('batch_size', 100)

self.loss = kwargs.get('loss', 'categorical_crossentropy')

self.optimizer = kwargs.get('optimizer', 'rmsprop')

def NN_model(self, trainX, trainY, testX, testY):

"""

:param trainX: training data set

:param trainY: expect value of training data

:param testX: test data set

:param testY: epect value of test data

:return: model after training

"""

print "Training model is LSTM network!"

input_dim = trainX[1].shape[1]

output_dim = trainY.shape[1] # one-hot label

# print predefined parameters of current model:

model = Sequential()

# applying a LSTM layer with x dim output and y dim input. Use dropout parameter to avoid overfitting

model.add(LSTM(output_dim=self.output_dim,

input_dim=input_dim,

activation=self.activation_lstm,

dropout_U=self.drop_out,

return_sequences=True))

for i in range(self.lstm_layer-2):

model.add(LSTM(output_dim=self.output_dim,

input_dim=self.output_dim,

activation=self.activation_lstm,

dropout_U=self.drop_out,

return_sequences=True))

# argument return_sequences should be false in last lstm layer to avoid input dimension incompatibility with dense layer

model.add(LSTM(output_dim=self.output_dim,

input_dim=self.output_dim,

activation=self.activation_lstm,

dropout_U=self.drop_out))

for i in range(self.dense_layer-1):

model.add(Dense(output_dim=self.output_dim,

activation=self.activation_last))

model.add(Dense(output_dim=output_dim,

input_dim=self.output_dim,

activation=self.activation_last))

# configure the learning process

model.compile(loss=self.loss, optimizer=self.optimizer, metrics=['accuracy'])

# train the model with fixed number of epoches

model.fit(x=trainX, y=trainY, nb_epoch=self.nb_epoch, batch_size=self.batch_size, validation_data=(testX, testY))

# store model to json file

model_json = model.to_json()

with open(model_path, "w") as json_file:

json_file.write(model_json)

# store model weights to hdf5 file

if model_weight_path:

if os.path.exists(model_weight_path):

os.remove(model_weight_path)

model.save_weights(model_weight_path) # eg: model_weight.h5

return model

这里写的只涉及LSTM网络的结构搭建,至于如何把数据处理规范化成网络所需的结构以及把模型预测结果与实际值比较统计的可视化,就需要根据实际情况做调整了。具体脚本可以参考下这个

参考文档:

[力推]: Understanding LSTMs

- Keras Documnet

- What is batch size in neural network?

- Time Series Prediction with LSTM Recurrent Neural Networks in Python with Keras

- Save Your Neural Network Model to JSON

- RECURRENT NEURAL NETWORKS TUTORIAL, PART 1 – INTRODUCTION TO RNNS

- A Beginner’s Guide to Recurrent Networks and LSTMs

- Pybrain time series prediction using LSTM recurrent nets

- PyBrain Document

- Recurrent neural network for predicting next value in a sequence

- What are some good Python libraries that implement LSTM networks?

Python中利用LSTM模型进行时间序列预测分析的更多相关文章

- 基于 Keras 用 LSTM 网络做时间序列预测

目录 基于 Keras 用 LSTM 网络做时间序列预测 问题描述 长短记忆网络 LSTM 网络回归 LSTM 网络回归结合窗口法 基于时间步的 LSTM 网络回归 在批量训练之间保持 LSTM 的记 ...

- 使用tensorflow的lstm网络进行时间序列预测

https://blog.csdn.net/flying_sfeng/article/details/78852816 版权声明:本文为博主原创文章,未经博主允许不得转载. https://blog. ...

- Python中利用函数装饰器实现备忘功能

Python中利用函数装饰器实现备忘功能 这篇文章主要介绍了Python中利用函数装饰器实现备忘功能,同时还降到了利用装饰器来检查函数的递归.确保参数传递的正确,需要的朋友可以参考下 " ...

- python中利用matplotlib绘图可视化知识归纳

python中利用matplotlib绘图可视化知识归纳: (1)matplotlib图标正常显示中文 import matplotlib.pyplot as plt plt.rcParams['fo ...

- Python中利用原始套接字进行网络编程的示例

Python中利用原始套接字进行网络编程的示例 在实验中需要自己构造单独的HTTP数据报文,而使用SOCK_STREAM进行发送数据包,需要进行完整的TCP交互. 因此想使用原始套接字进行编程,直接构 ...

- python中利用队列asyncio.Queue进行通讯详解

python中利用队列asyncio.Queue进行通讯详解 本文主要给大家介绍了关于python用队列asyncio.Queue通讯的相关内容,分享出来供大家参考学习,下面话不多说了,来一起看看详细 ...

- (数据科学学习手札145)在Python中利用yarl轻松操作url

本文示例代码已上传至我的Github仓库https://github.com/CNFeffery/DataScienceStudyNotes 1 简介 大家好我是费老师,在诸如网络爬虫.web应用开发 ...

- Python 3 利用机器学习模型 进行手写体数字识别

0.引言 介绍了如何生成数据,提取特征,利用sklearn的几种机器学习模型建模,进行手写体数字1-9识别. 用到的四种模型: 1. LR回归模型,Logistic Regression 2. SGD ...

- Python 3 利用机器学习模型 进行手写体数字检测

0.引言 介绍了如何生成手写体数字的数据,提取特征,借助 sklearn 机器学习模型建模,进行识别手写体数字 1-9 模型的建立和测试. 用到的几种模型: 1. LR,Logistic Regres ...

随机推荐

- Python (1) - 7 Steps to Mastering Machine Learning With Python

Step 1: Basic Python Skills install Anacondaincluding numpy, scikit-learn, and matplotlib Step 2: Fo ...

- 【jQuery】serializeArray()与serialize()的区别

serialize()序列化表单元素为字符串,用于 Ajax 请求. serializeArray()序列化表单元素为JSON数据. 具体实例如下: 1 <!DOCTYPE html PUBLI ...

- JEECMS v8 发布,java 开源 CMS 系统

JEECMSv8 是国内java开源CMS行业知名度最高.用户量最大的站群管理系统,支持栏目模型.内容模型交叉自定义.以及具备支付和财务结算的内容电商为一体: 对于不懂技术的用户来说,只要通过后台的 ...

- 搭建Android工程的步骤及其第一个安卓程序

1.安卓系统架构 1>底层是Linux系统 2>函数库层 由C或C++写的 3>Application frameWork应用的框架层 4>顶层是应用层 2.JVM与DVM介绍 ...

- jq 操作radio,设置选中、获取选中值

<label><input type="radio" name="sex" value="1">男</labe ...

- 关于if(a<b<c)判断的问题

由于判断时的执行顺序,不要写成if(a<b<c)这种形式,很有可能得出的结果与我们想像的结果不一致,要写成if(a<b && b<c)!

- 18、SQL提高篇(变量的使用 拓展)

一 例题 例题用表:[cost] 注:费用类型个数不定 将上图所示的表根据type列的类型转为下图样式 *用变量将类型名分组动态提取的方法: ) set @sql1='' select @sql1= ...

- [转]概率基础和R语言

概率基础和R语言 R的极客理想系列文章,涵盖了R的思想,使用,工具,创新等的一系列要点,以我个人的学习和体验去诠释R的强大. R语言作为统计学一门语言,一直在小众领域闪耀着光芒.直到大数据的爆发,R语 ...

- C++学习笔记24:makefile文件

makefile make命令:负责c/c++程序编译与链接 make根据指定命令进行建构 建构规则文件:GNUmakefile , makefile,Makefile makefile 文件格式 m ...

- php-访问数据库

建一个连接,造一个连接对象 $db = new MySQLi("host","username","passwd","databa ...