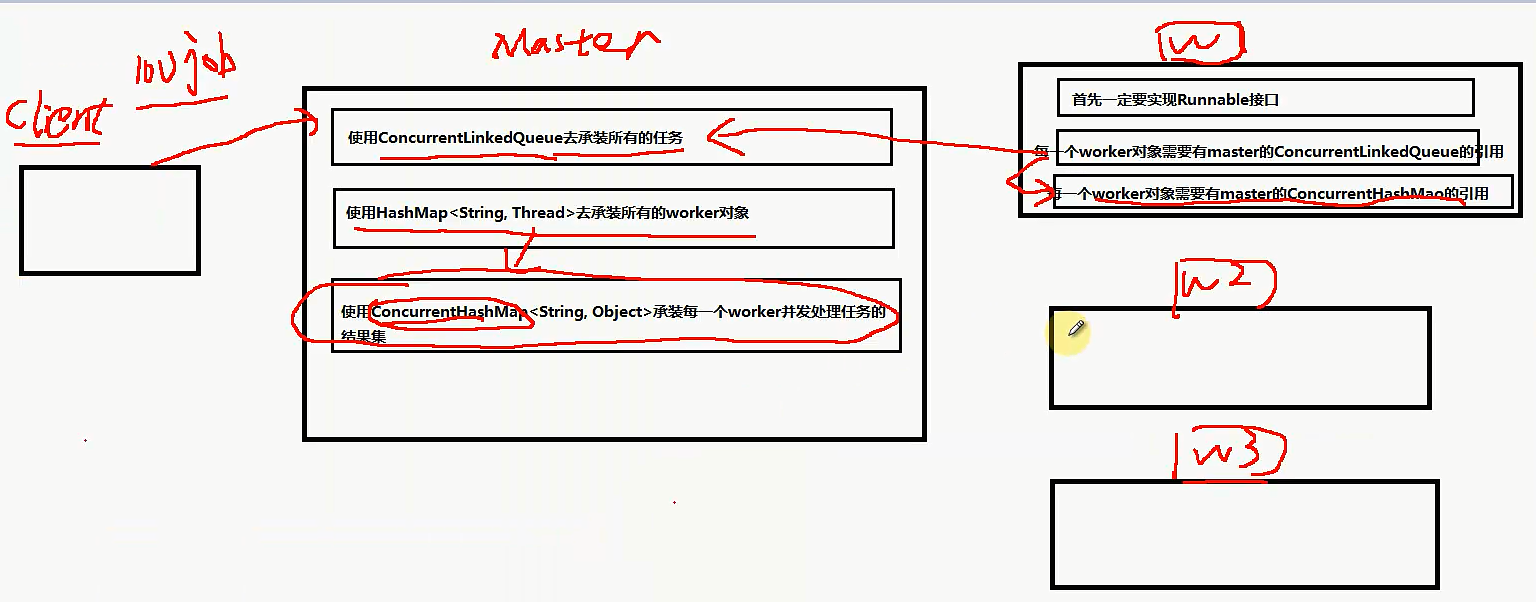

Master和worker模式

让和hadoop的设计思想是一样的,Master负责分配任务和获取任务的结果,worker是真正处理业务逻辑的。

使用ConcurrentLikedQueue去承载所有的任务,因为会有多个worker会并发修改这个队列。

public class Task {

private int id;

private int price ;

public int getId() {

return id;

}

public void setId(int id) {

this.id = id;

}

public int getPrice() {

return price;

}

public void setPrice(int price) {

this.price = price;

}

}

public class Master {

//1 有一个盛放任务的容器

private ConcurrentLinkedQueue<Task> workQueue = new ConcurrentLinkedQueue<Task>();

//2 需要有一个盛放worker的集合

private HashMap<String, Thread> workers = new HashMap<String, Thread>();

//3 需要有一个盛放每一个worker执行任务的结果集合

private ConcurrentHashMap<String, Object> resultMap = new ConcurrentHashMap<String, Object>();

//4 构造方法

public Master(Worker worker , int workerCount){

worker.setWorkQueue(this.workQueue);

worker.setResultMap(this.resultMap);

for(int i = 0; i < workerCount; i ++){

this.workers.put(Integer.toString(i), new Thread(worker));

}

}

//5 需要一个提交任务的方法

public void submit(Task task){

this.workQueue.add(task);

}

//6 需要有一个执行的方法,启动所有的worker方法去执行任务

public void execute(){

for(Map.Entry<String, Thread> me : workers.entrySet()){

me.getValue().start();

}

}

//7 判断是否运行结束的方法

public boolean isComplete() {

for(Map.Entry<String, Thread> me : workers.entrySet()){

if(me.getValue().getState() != Thread.State.TERMINATED){

return false;

}

}

return true;

}

//8 计算结果方法

public int getResult() {

int priceResult = 0;

for(Map.Entry<String, Object> me : resultMap.entrySet()){

priceResult += (Integer)me.getValue();

}

return priceResult;

}

}

public class Worker implements Runnable {

private ConcurrentLinkedQueue<Task> workQueue;

private ConcurrentHashMap<String, Object> resultMap;

public void setWorkQueue(ConcurrentLinkedQueue<Task> workQueue) {

this.workQueue = workQueue;

}

public void setResultMap(ConcurrentHashMap<String, Object> resultMap) {

this.resultMap = resultMap;

}

@Override

public void run() {

while(true){

Task input = this.workQueue.poll();

if(input == null) break;

Object output = handle(input);

this.resultMap.put(Integer.toString(input.getId()), output);

}

}

private Object handle(Task input) {

Object output = null;

try {

//处理任务的耗时。。 比如说进行操作数据库。。。

Thread.sleep(500);

output = input.getPrice();

} catch (InterruptedException e) {

e.printStackTrace();

}

return output;

}

}

public class Main {

public static void main(String[] args) {

Master master = new Master(new Worker(), 20);

Random r = new Random();

for(int i = 1; i <= 100; i++){

Task t = new Task();

t.setId(i);

t.setPrice(r.nextInt(1000));

master.submit(t);

}

master.execute();

long start = System.currentTimeMillis();

while(true){

if(master.isComplete()){

long end = System.currentTimeMillis() - start;

int priceResult = master.getResult();

System.out.println("最终结果:" + priceResult + ", 执行时间:" + end);

break;

}

}

}

}

Master和worker模式的更多相关文章

- Spark技术内幕:Client,Master和Worker 通信源码解析

http://blog.csdn.net/anzhsoft/article/details/30802603 Spark的Cluster Manager可以有几种部署模式: Standlone Mes ...

- Spark技术内幕:Client,Master和Worker 通信源代码解析

Spark的Cluster Manager能够有几种部署模式: Standlone Mesos YARN EC2 Local 在向集群提交计算任务后,系统的运算模型就是Driver Program定义 ...

- Apache的prefork模式和worker模式(转)

prefork模式这个多路处理模块(MPM)实现了一个非线程型的.预派生的web服务器,它的工作方式类似于Apache 1.3.它适合于没有线程安全库,需要避免线程兼容性问题的系统.它是要求将每个请求 ...

- Apache的prefork模式和worker模式

prefork模式这个多路处理模块(MPM)实现了一个非线程型的.预派生的web服务器,它的工作方式类似于Apache 1.3.它适合于没有线程安全库,需要避免线程兼容性问题的系统.它是要求将每个请求 ...

- Spark中master与worker的进程RPC通信实现

1.构建master的actor package SparkRPC import akka.actor.{Actor, ActorSystem, Props}import com.typesafe.c ...

- Spark分析之Master、Worker以及Application三者之间如何建立连接

Master.preStart(){ webUi.bind() context.system.scheduler.schedule( millis, WORKER_TIMEOUT millis, se ...

- [PHP] apache在worker模式配置fastcgi使用php-fpm

1.准备: dpkg -L apache2查看所有安装的apache2的应用 a2query -M查看apache2使用的模式 httpd -l旧版本查看当前apache模式 2.查看apache的进 ...

- redis配置master-slave模式

由于云服务器存在闪断现象,项目线上会存在基于redis的功能在闪断时段内出现异常,所以redis需要做master-slave模式.直接上代码: 原单机redis,RedisConnectionFac ...

- Ubuntu下配置Apache的Worker模式

其实Apache本身的并发能力是足够强大的,但是Ubuntu默认安装的是Prefork模式下的Apache.所以导致很多人后面盲目的去 安装lighttpd或者nginx一类替代软件.但是这类软件有一 ...

随机推荐

- QT 登陆对话框

该文章原创于Qter开源社区(www.qter.org),作者yafeilinux,转载请注明出处! 正文 一.创建项目 1.新建Qt Gui应用,项目名称为“login”,类名和基类保持MainWi ...

- springcloud的fallback与fallbackFactory

- python的tuple()元组数据类型的使用方法以及案例

一.元组的概念介绍 1.元组是列表的二次加工 列表可以被修改 列表的类型 list li = [1,2,3,4,5,6] 2.元组的元素不可被修改,不能被增加或者删除,(只是针对元组的一级元素是不可以 ...

- Hadoop基础-HDFS的读取与写入过程

Hadoop基础-HDFS的读取与写入过程 作者:尹正杰 版权声明:原创作品,谢绝转载!否则将追究法律责任. 为了了解客户端及与之交互的HDFS,NameNode和DataNode之间的数据流是什么样 ...

- vue+element 切换正式和测试环境

1.package.json { "name": "element-starter", "description": "A Vue ...

- Java RMI 简单实现

提供远端访问的时候,我们首先需要定义远端能够访问哪些东西,在Java中,定义这类接口需要实现Remote接口 public interface Business extends Remote{ pub ...

- bzoj千题计划144:bzoj1176: [Balkan2007]Mokia

http://www.lydsy.com/JudgeOnline/problem.php?id=1176 CDQ分治 #include<cstdio> #include<iostre ...

- 2017 清北济南考前刷题Day 7 afternoon

期望得分:100+100+30=230 实际得分:100+100+30=230 1. 三向城 题目描述 三向城是一个巨大的城市,之所以叫这个名字,是因为城市中遍布着数不尽的三岔路口.(来自取名力为0的 ...

- 使用subprocess.Poen注意事项

学习使用python已经有四个月了,subprocess这个执行linux中shell命令的函数已经用过无数次了,踩到的坑也有几个,写出来分享一下,欢迎大家拍砖头. 1.shell命令中若有管道,一定 ...

- Netty URL路由方案探讨

最近在用Netty做开发,需要提供一个http web server,供调用方调用.采用Netty本身提供的HttpServerCodec handler进行Http协议的解析,但是需要自己提供路由. ...