ansible部署EFK

修改自己不确定的配置文件前,先准备备份,防患于未然!!!

Environment:{

目前测试准备三台2m2g虚拟机 详情概略图见EFK的架构图

https://www.cnblogs.com/security-guard/

1、装filebeat 用于客户端web界面 172

2、安装logstash 139

3、安装elasticsearch kibana 128

}

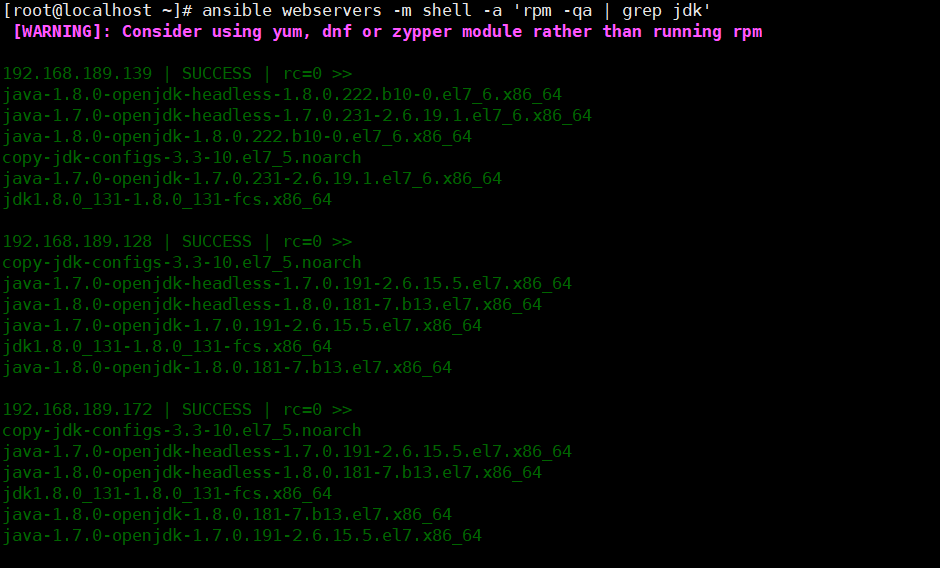

检测环境,确保均安装jdk环境

返回jdk环境数据

查看环境

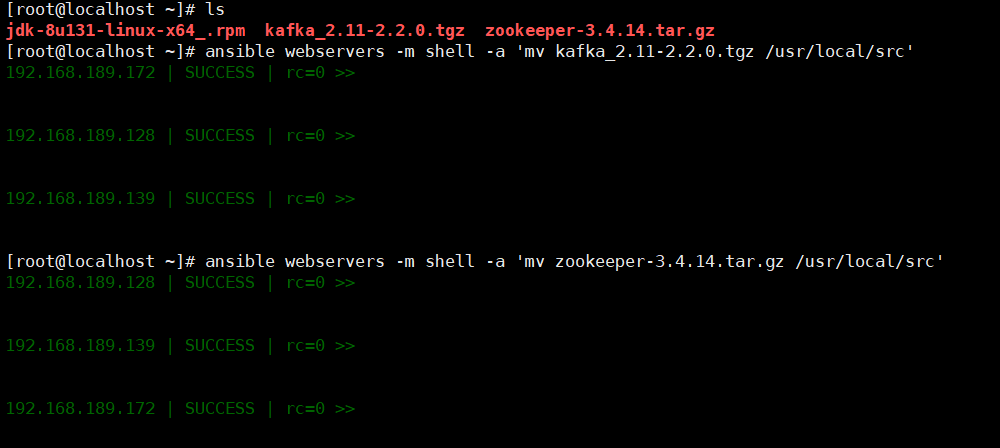

移动压缩包到指定目录

解压准备好的zookeeper kafka

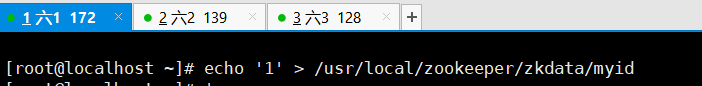

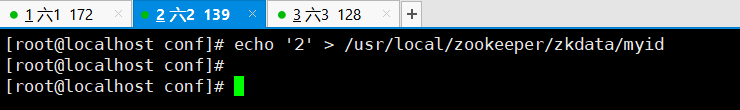

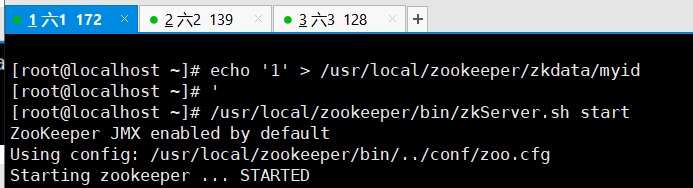

输入本机id,此步骤由于机器少,一次修改即可

开启 zookeeper服务并查看,现在本机器测试

可见是跟班角色

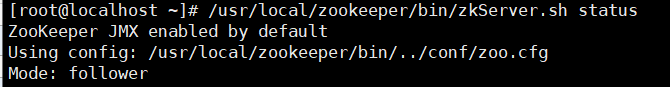

机器查看到状态,第一步完成

二、搭建kafka

vim /usr/local/kafka/config/server.properties

id号为前面echo的ID

各机器添加主机

需要配置的文件如下

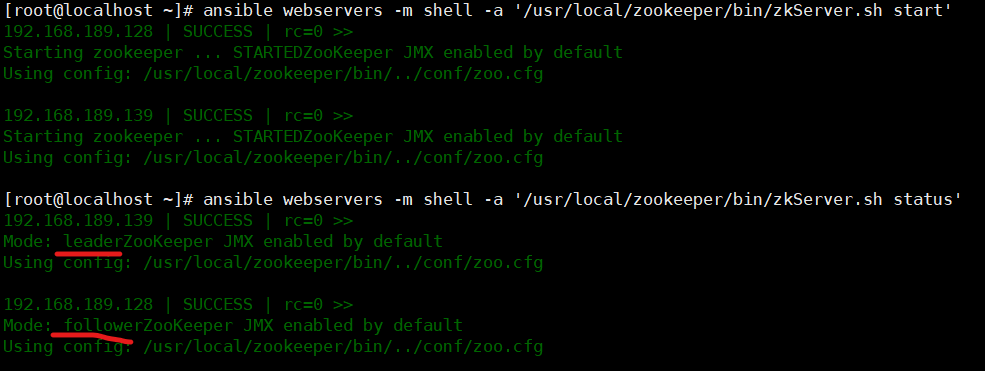

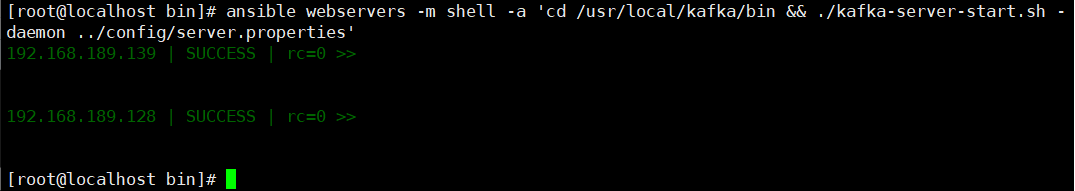

启动kafka,首先进行测试,发现绝对路径不能实现kafka的启动

稍等片刻,查看端口,发现端口监听,kafka启动成功

三、以下操作为单机操作

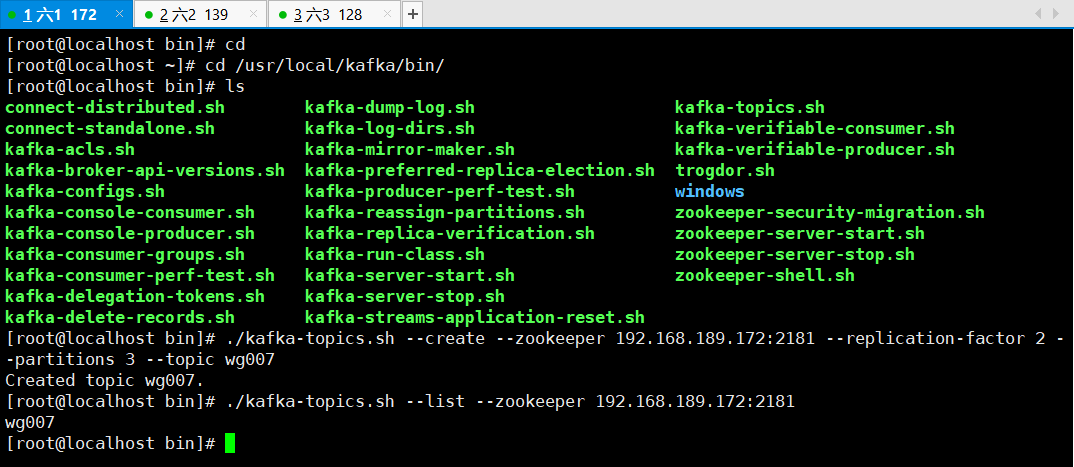

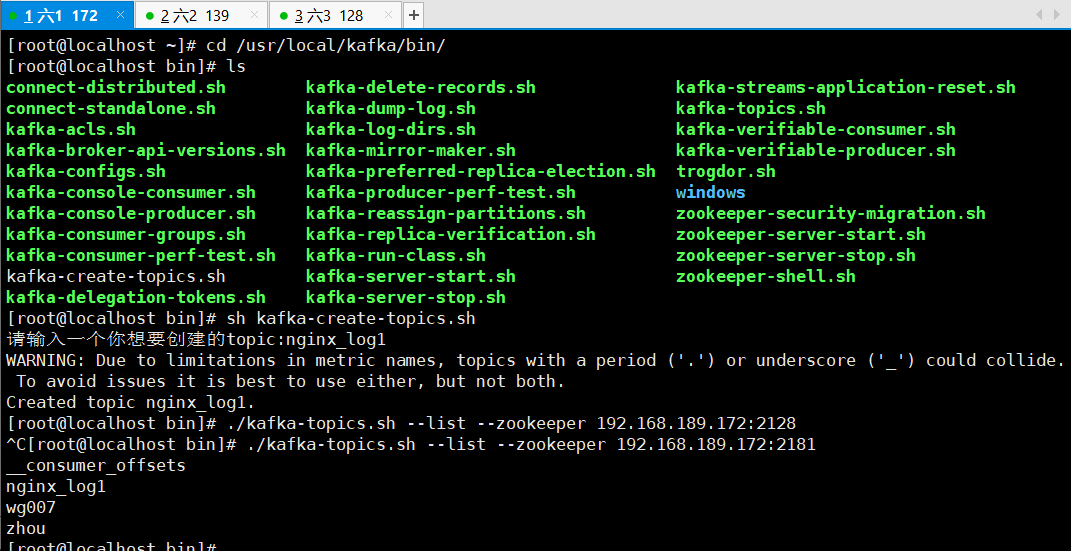

1、创建主题topic

cd /usr/local/kafka/bin/

创建wg007的主题

./kafka-topics.sh --create --zookeeper 192.168.189.172:2181 --replication-factor 2 --partitions 3 --topic wg007

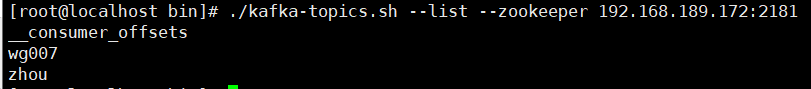

查看本机器有哪些主题

./kafka-topics.sh --list --zookeeper 192.168.189.172:2181

效果图

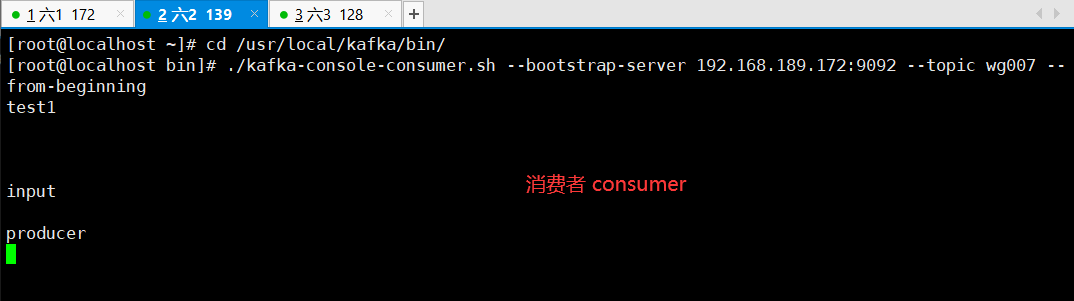

模拟生产者,会有小输入框 " > "

效果如下:

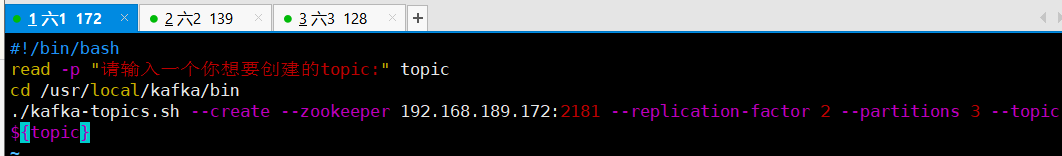

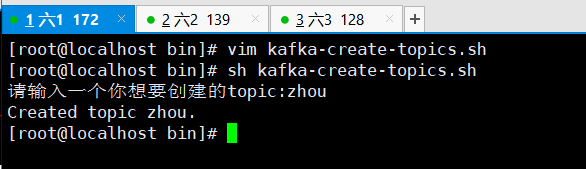

由于命令过长,添加脚本用以方便

四、创建yum源,用以下载filebeat

vim /etc/yum.repo.d/filebeat.repo

***加入以下内容

[filebeat-6.x]

name=Elasticsearch repository for 6.x packages

baseurl=https://artifacts.elastic.co/packages/6.x/yum

gpgcheck=1

gpgkey=https://artifacts.elastic.co/GPG-KEY-elasticsearch

enabled=1

autorefresh=1

type=rpm-md

添加以上内容即可yum直接下载filebeat

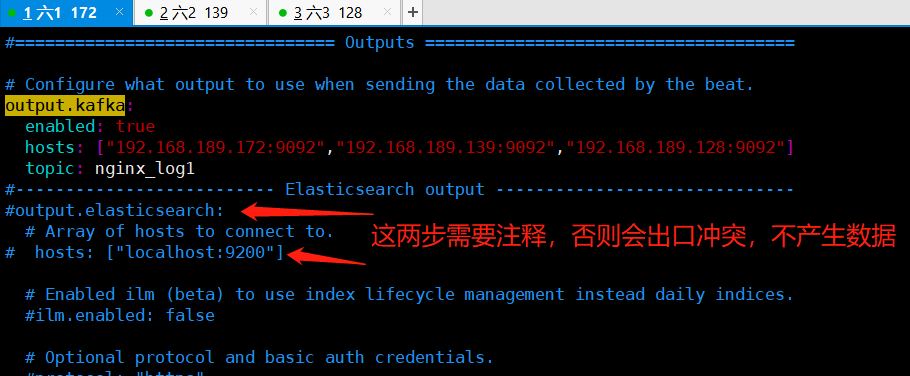

下一步配置filebeat的配置文件

批注:

cd /etc/filebeat

vim filebeat.yml

修改以下内容 enabled: true paths:

- /var/log/nginx/*.log //写这个路径的前提是安装nginx output.kafka:

enabled: true

# Array of hosts to connect to.

hosts: ["192.168.18.140:9092","192.168.18.141:9092","192.168.18.142:9092"]

topic: nginx_log1 //写这个nginx_log1 的前提是有nginx_log1的topic 上面有生产者的脚本

安装nginx

yum -y install epel*

yum -y install nginx

启动filebeat,nginx

systemctl start filebeat

systemctl enable filebeat

systemctl start nginx

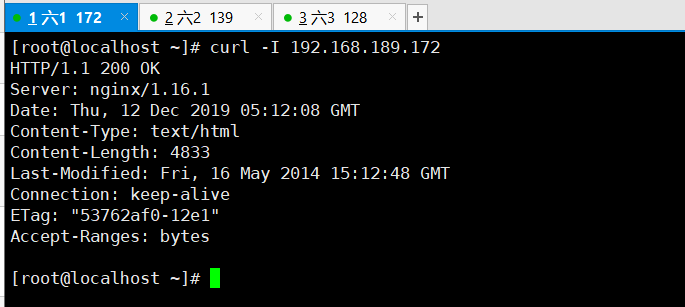

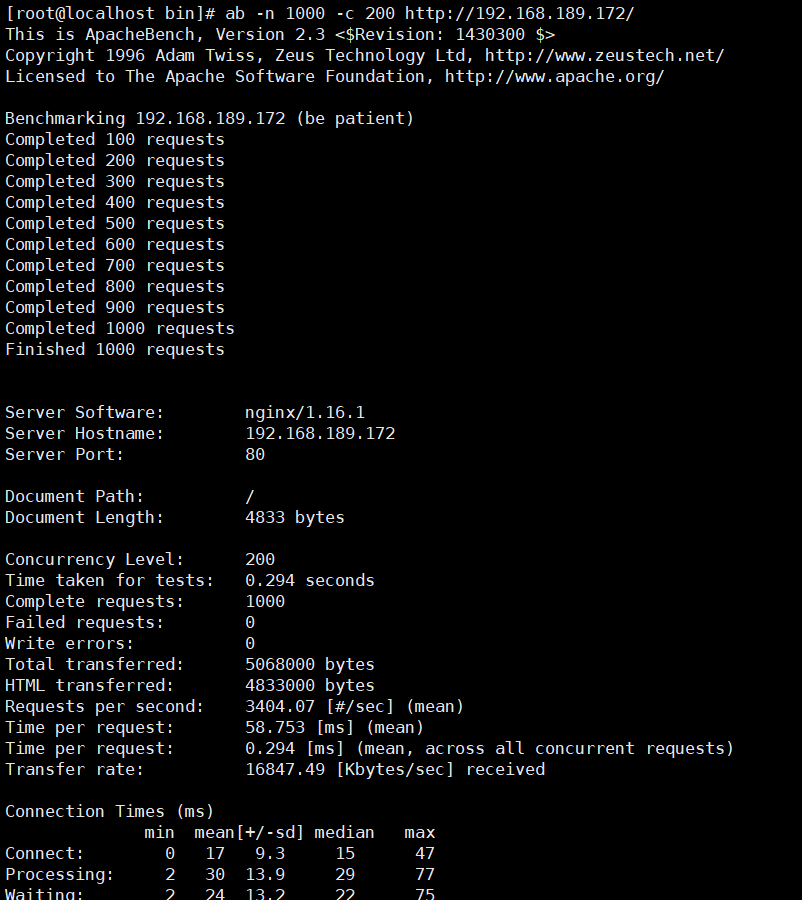

给nginx生产数据,此步骤采用ab压力测试,首先下载压测工具" httpd-tools "

yum -y install httpd-tools

ab -n1000 -c 200 http://127.0.0.1/cccc //这条命令可以多执行几次

可以在安装filebeat的服务器上测试一下nginx的服务

curl -I 192.168.18.140:80

创建nginx_log1 的主题 topic

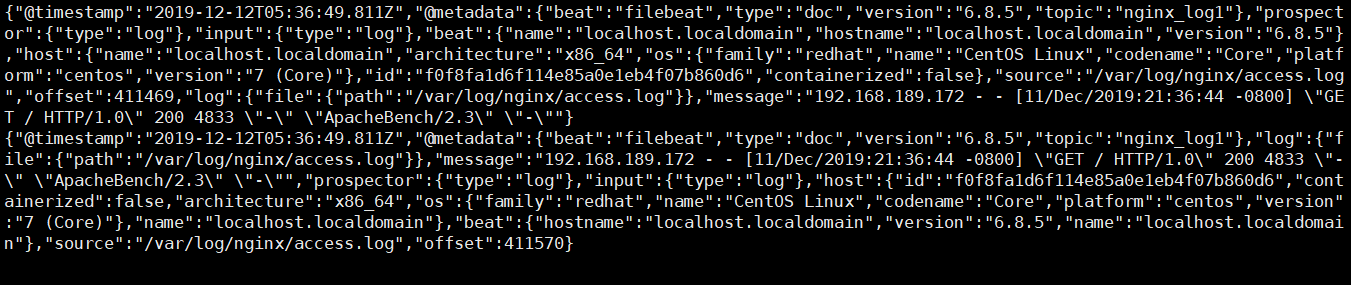

在模拟消费者的服务器上 如果可以显示一下内容 表示成功了

./kafka-console-consumer.sh --bootstrap-server 192.168.18.141:9092 --topic nginx2(这里的topic的名字一定要和filebeat的配置文件里的一致) --from-beginning

这一步的效果显示如下,通俗易懂的说法就是,模拟生产者做nginx压力测试,模拟消费者的服务器会看到nginx的日志

进行即时检测本操作的同步一致性

./kafka-console-consumer.sh --bootstrap-server 192.168.189.139:9092 --topic nginx_log1 --from-beginning

五、 现在开始收集多个日志 system nginx secure 和日志 编辑filebeat的配置文件

修改自己不确定的配置文件前,先准备备份,防患于未然!!!

filebeat.inputs:

- type: log

enabled: true

paths:

- /var/log/nginx/*.log

fields:

log_topics: nginx_log1 - type: log

enabled: true

paths:

- /var/log/messages

fields:

log_topics: messages - type: log

enabled: true

paths:

- /var/log/secure

fields:

log_topics: secure//这个是收集secure的topicoutput.kafka:

enabled: true

hosts: ["192.168.189.172:9092","192.168.189.139:9092","192.168.189.128:9092"]

topic: nginx_log1 #processors:

# - add_host_metadata: ~

# - add_cloud_metadata: ~

注意:创建三个topic 就是上面的配置文件提到的topic 可以使用上面的脚本创建topic 重启filebeat

systemctl restart filebeat

六、接下来在第二台机器安装logstash 在第三台机器安装ES集群(elasticsearch和kibana)

安装logstash在第二台

rpm -ivh logstash-6.6.0.rpm

安装 kibana 和elasticsearch

rpm -ivh elasticsearch-6.6.2.rpm

rpm -ivh kibana-6.6.2-x86_64.rpm

配置elasticsearch文件

vim /etc/elasticsearch/elasticsearch.yml

############################

network.host: 192.168.18.142

http.port: 9200

启动elasticsearch

systemctl restart elasticsearch

配置kibana的配置文件

vim /etc/kibana/kibana.yml

######################

server.port: 5601

server.host: "0.0.0.0"

elasticsearch.hosts: ["http://192.168.18.142:9200"] 然后启动kibana

systemctl restart kibana

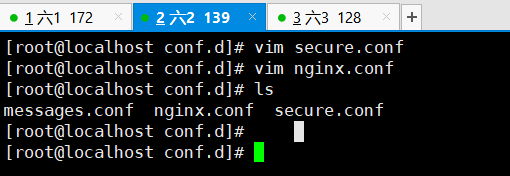

七、现在开始 编写logstash的三个配置文件 cd /etc/logstash/conf.d

cd /etc/logstash/conf.d

在此路径下创建我们之前创建的主题topic的相对配置文件

nginx配置文件

vim nginx.conf

input {

kafka {

bootstrap_servers => ["192.168.189.172:9092,192.168.189.139:9092,192.168.189.128:9092"]

group_id => "logstash"

topics => "nginx_log1"

consumer_threads =>

}

}

filter {

grok {

match => { "message" => "%{NGINXACCESS}" }

}

}

output {

elasticsearch {

hosts => "192.168.189.128:9200"

index => "nginx_log-%{+YYYY.MM.dd}"

}

}

secure配置文件

vim secure.conf

input {

kafka {

bootstrap_servers => ["192.168.189.172:9092,192.168.189.139:9092,192.168.189.128:9092"]

group_id => "logstash"

topics => "secure"

consumer_threads =>

}

}

output {

elasticsearch {

hosts => "192.168.189.128:9200"

index => "secure_log-%{+YYYY.MM.dd}"

}

}

messages配置文件

vim messages.conf

input {

kafka {

bootstrap_servers => ["192.168.189.172:9092,192.168.189.139:9092,192.168.189.128:9092"]

group_id => "logstash"

topics => "messages"

consumer_threads =>

}

}

output {

elasticsearch {

hosts => "192.168.189.128:9200"

index => "_log-%{+YYYY.MM.dd}"

}

}

添加管道

vim /etc/logstash/pipelines.yml

- pipeline.id: messages

path.config: "/etc/logstash/conf.d/messages.conf"

- pipeline.id: nginx

path.config: "/etc/logstash/conf.d/nginx.conf"

- pipeline.id: secure

path.config: "/etc/logstash/conf.d/secure.conf"

正则匹配

cd /usr/share/logstash/vendor/bundle/jruby/2.3./gems/logstash-patterns-core-4.1./patterns

vim nginx_access

URIPARAM1 [A-Za-z0-$.+!*'|(){},~@#%&/=:;_?\-\[\]]*

NGINXACCESS %{IPORHOST:client_ip} (%{USER:ident}|- ) (%{USER:auth}|-) \[%{HTTPDATE:timestamp}\] "(?:%{WORD:verb} (%{NOTSPACE:request}|-)(?: HTTP/%{NUMBER:http_version})?|-)" %{NUMBER:status} (?:%{NUMBER:bytes}|-) "(?:%{URI:referrer}|-)" "%{GREEDYDATA:agent}"

重启logstash systemctl restart logstash

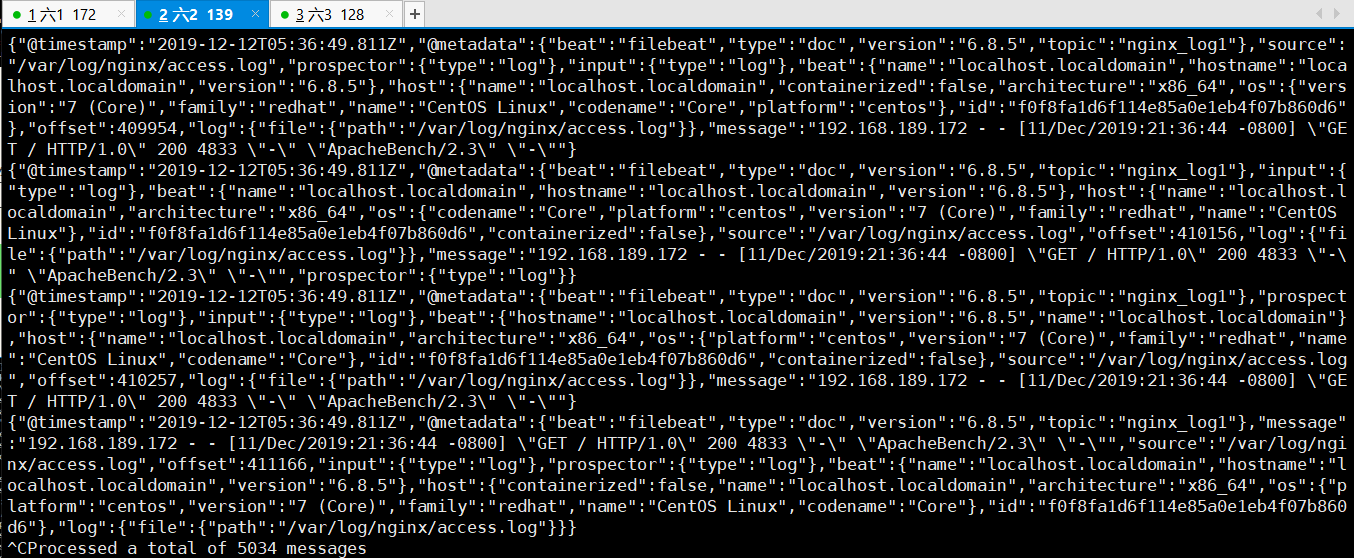

可以在第二台机器上查看模拟消费者的状态 messages的

执行下面的命令可以显示出日志内容就是成功

cd /usr/local/kafka/bin/./kafka-console-consumer.sh --bootstrap-server 192.168.18.141:9092 --topic nginx_log1 --from-beginning

ansible部署EFK的更多相关文章

- 001.Ansible部署RHCS存储集群

一 前期准备 1.1 前置条件 至少有三个不同的主机运行monitor (MON)节点: 至少三个直接存储(非外部SAN硬件)的OSD节点主: 至少两个不同的manager (MGR)节点: 如果使用 ...

- 使用Ansible部署etcd 3.2高可用集群

之前写过一篇手动搭建etcd 3.1集群的文章<etcd 3.1 高可用集群搭建>,最近要初始化一套新的环境,考虑用ansible自动化部署整套环境, 先从部署etcd 3.2集群开始. ...

- docker-compose 部署 EFK

信息: Docker版本($ docker --version):Docker版本18.06.1-ce,版本e68fc7a 系统信息($ cat /etc/centos-release):CentOS ...

- ansible部署,规划

部署管理服务器 第一步:先检查有没有ssh服务 [root@iZm5eeyc1al5vzh8bo57zyZ ~]# rpm -qf /etc/init.d/sshd openssh-server-5. ...

- CentOS7.5 -- Ansible部署与应用

第1章 Ansible概述 Ansible是一个配置管理系统configuration management system python 语言是运维人员必须会的语言 ansible 是一个基于pyth ...

- 使用ansible部署CDH 5.15.1大数据集群

使用ansible离线部署CDH 5.15.1大数据集群 作者:尹正杰 版权声明:原创作品,谢绝转载!否则将追究法律责任. 在此之前,我之前分享过使用shell自定义脚本部署大数据集群,不管是部署CD ...

- SSH与ansible 部署方法与核心模块简介

SSH与ansible 部署方法 部署环境 管理服务器 172.16.1.61 NFS服务器 172.16.1.31 备份服务器 172.16.1.41 1检查SSH服务是否运行并开启服务 netst ...

- 003 ansible部署ceph集群

介绍:在上一次的deploy部署ceph,虽然出了结果,最后的结果并没有满足最初的目的,现在尝试使用ansible部署一遍,看是否会有问题 一.环境准备 ceph1充当部署节点,ceph2,ceph3 ...

- 在kubernetes1.17.2上结合ceph部署efk

简绍 应用程序和系统日志可以帮助我们了解集群内部的运行情况,日志对于我们调试问题和监视集群情况也是非常有用的.而且大部分的应用都会有日志记录,对于传统的应用大部分都会写入到本地的日志文件之中.对于容器 ...

随机推荐

- Sitecore 6.4 升级Sitecore 8.2.7准备

考虑Sitecore升级?尽管这可能是一项令人生畏的任务,但这三个技巧可以帮助您无缝地完成整个过程. 如果您当前正在运行较旧版本的Sitecore并希望升级到最新版本,那么您可能已经瞥了一眼说明,但却 ...

- 一个简单便捷的树形显示Ztree

这是本人在闲时研究的一个用于显示树形列表的小玩意. zTree 是一个依靠 jQuery 实现的多功能 “树插件”.优异的性能.灵活的配置.多种功能的组合是 zTree 最大优点. 下面就说说怎么用吧 ...

- Docker安装Consul集群

Docker 安装Consul集群 使用windows 环境,Docker desktop community 构建consul集群. 1.docker 容器网络 docker安装后,默认会创建三种网 ...

- C# vb .NET读取识别条形码线性条码ean-8

ean-8是比较常见的条形码编码规则类型的一种.如何在C#,vb等.NET平台语言里实现快速准确读取该类型条形码呢?答案是使用SharpBarcode! SharpBarcode是C#快速高效.准确的 ...

- 在.Net Core中使用Swagger制作接口文档

在实际开发过程中后台开发人员与前端(移动端)接口的交流会很频繁.所以需要一个简单的接口文档让双方可以快速定位到问题所在. Swagger可以当接口调试工具也可以作为简单的接口文档使用. 在传统的asp ...

- ASP.NET MVC 允许跨域请求设置

场景:创建一个图片上传的站点,用于其他站点跨域上传附件和图片之类. 上传插件结合百度的 webuploader.js 经常会碰到,跨域的问题,如下, 处理方式呢,是在web.config 中配置允许跨 ...

- 第四周(1):数据分布-Python实战

数据准备 数据集地址:http://jse.amstat.org/datasets/normtemp.dat.txt 数据集描述:总共只有三列:体温.性别.心率 数据集详细描述:Journal of ...

- 【转载】Jupyter Notebook 常用快捷键

原文:http://blog.csdn.net/lawme/article/details/51034543 Jupyter Notebook 有两种键盘输入模式.编辑模式,允许你往单元中键入代码或文 ...

- 浅谈Object.prototype.toString.call()方法

在JavaScript里使用typeof判断数据类型,只能区分基本类型,即:number.string.undefined.boolean.object.对于null.array.function.o ...

- ES6 之 Symbol

1. 基本用法 Symbol 是ES6引入的一种新的原始数据类型,表示独一无二的值. 前六种基础数据类型是 undefined null Boolean String Number Object Sy ...