celery分布式异步框架

1.什么是Celery

Celery是一个简单、灵活且可靠的,处理大量消息的分布式系统

专注于实时处理的异步任务队列

同时也支持任务调度

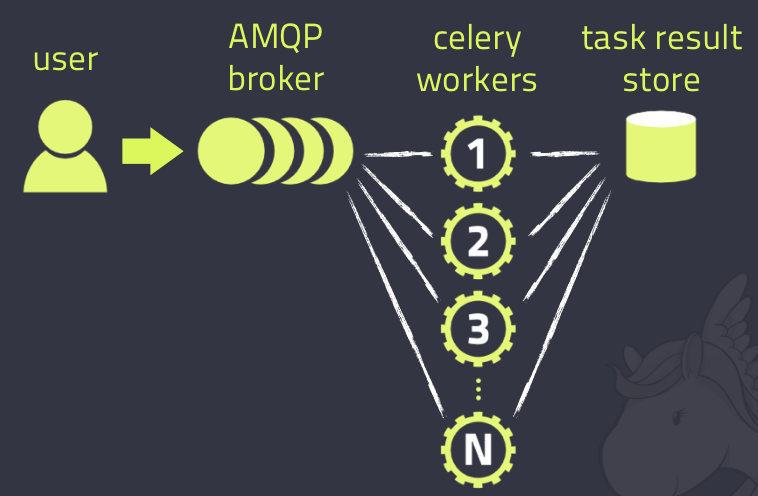

Celery架构

Celery的架构由三部分组成,消息中间件(message broker),任务执行单元(worker)和任务执行结果存储(task result store)组成。

消息中间件

Celery本身不提供消息服务,但是可以方便的和第三方提供的消息中间件集成。包括,RabbitMQ, Redis等等

任务执行单元

Task result store用来存储Worker执行的任务的结果,Celery支持以不同方式存储任务的结果,包括AMQP, redis等

版本支持情况

python 3.6版本支持celery 4.2.1

Celery version 4.0 runs on

Python ❨2.7, 3.4, 3.5❩

PyPy ❨5.4, 5.5❩

This is the last version to support Python 2.7, and from the next version (Celery 5.x) Python 3.5 or newer is required. If you’re running an older version of Python, you need to be running an older version of Celery: Python 2.6: Celery series 3.1 or earlier.

Python 2.5: Celery series 3.0 or earlier.

Python 2.4 was Celery series 2.2 or earlier. Celery is a project with minimal funding, so we don’t support Microsoft Windows. Please don’t open any issues related to that platform.

2.使用场景

异步任务:将耗时操作任务提交给Celery去异步执行,比如发送短信/邮件、消息推送、音视频处理等等

定时任务:定时执行某件事情,比如每天数据统计

3.Celery的安装配置

pip install celery

消息中间件:RabbitMQ/Redis

app=Celery('任务名',backend='xxx',broker='xxx')

4.Celery执行异步任务

基本使用

创建项目celerytest

创建py文件:celery_app_task.py

import celery

import time

# broker='redis://127.0.0.1:6379/2' 不加密码

backend='redis://:123456@127.0.0.1:6379/1'

broker='redis://:123456@127.0.0.1:6379/2'

cel=celery.Celery('test',backend=backend,broker=broker)

@cel.task

def add(x,y):

return x+y

创建py文件:add_task.py,添加任务

from celery_app_task import add

result = add.delay(4,5)

print(result.id)

创建py文件:run.py,执行任务,或者使用命令执行:celery worker -A celery_app_task -l info

注:windows下:celery worker -A celery_app_task -l info -P eventlet

eventlet此模块需要另外安装

from celery_app_task import cel

if __name__ == '__main__':

cel.worker_main()

# cel.worker_main(argv=['--loglevel=info')

创建py文件:result.py,查看任务执行结果

from celery.result import AsyncResult

from celery_app_task import cel async = AsyncResult(id="e919d97d-2938-4d0f-9265-fd8237dc2aa3", app=cel) if async.successful():

result = async.get()

print(result)

# result.forget() # 将结果删除

elif async.failed():

print('执行失败')

elif async.status == 'PENDING':

print('任务等待中被执行')

elif async.status == 'RETRY':

print('任务异常后正在重试')

elif async.status == 'STARTED':

print('任务已经开始被执行')

执行 add_task.py,添加任务,并获取任务ID

执行 run.py ,或者执行命令:celery worker -A celery_app_task -l info

执行 result.py,检查任务状态并获取结果

多任务结构

pro_cel

├── celery_task# celery相关文件夹

│ ├── celery.py # celery连接和配置相关文件,必须叫这个名字

│ └── tasks1.py # 所有任务函数

│ └── tasks2.py # 所有任务函数

├── check_result.py # 检查结果

└── send_task.py # 触发任务

celery.py

from celery import Celery

cel = Celery('celery_demo',

broker='redis://127.0.0.1:6379/1',

backend='redis://127.0.0.1:6379/2',

# 包含以下两个任务文件,去相应的py文件中找任务,对多个任务做分类

include=['celery_task.tasks1',

'celery_task.tasks2'

])

# 时区

cel.conf.timezone = 'Asia/Shanghai'

# 是否使用UTC

cel.conf.enable_utc = False

tasks1.py

import time

from celery_task.celery import cel @cel.task

def test_celery(res):

time.sleep(5)

return "test_celery任务结果:%s"%res

tasks2.py

import time

from celery_task.celery import cel

@cel.task

def test_celery2(res):

time.sleep(5)

return "test_celery2任务结果:%s"%res

check_result.py

from celery.result import AsyncResult

from celery_task.celery import cel async = AsyncResult(id="08eb2778-24e1-44e4-a54b-56990b3519ef", app=cel) if async.successful():

result = async.get()

print(result)

# result.forget() # 将结果删除,执行完成,结果不会自动删除

# async.revoke(terminate=True) # 无论现在是什么时候,都要终止

# async.revoke(terminate=False) # 如果任务还没有开始执行呢,那么就可以终止。

elif async.failed():

print('执行失败')

elif async.status == 'PENDING':

print('任务等待中被执行')

elif async.status == 'RETRY':

print('任务异常后正在重试')

elif async.status == 'STARTED':

print('任务已经开始被执行')

send_task.py

from celery_task.tasks1 import test_celery

from celery_task.tasks2 import test_celery2 # 立即告知celery去执行test_celery任务,并传入一个参数

result = test_celery.delay('第一个的执行')

print(result.id)

result = test_celery2.delay('第二个的执行')

print(result.id)

添加任务(执行send_task.py),开启work:celery worker -A celery_task -l info -P eventlet,检查任务执行结果(执行check_result.py)

5.Celery执行定时任务

设定时间让celery执行一个任务

add_task.py

from celery_app_task import add

from datetime import datetime # 方式一

# v1 = datetime(2019, 2, 13, 18, 19, 56)

# print(v1)

# v2 = datetime.utcfromtimestamp(v1.timestamp())将当前时间转成utc格式

# print(v2)

# result = add.apply_async(args=[1, 3], eta=v2)

# print(result.id) # 方式二

ctime = datetime.now()

# 默认用utc时间,需要转成utc时间格式

utc_ctime = datetime.utcfromtimestamp(ctime.timestamp())

from datetime import timedelta

time_delay = timedelta(seconds=10)

task_time = utc_ctime + time_delay # 使用apply_async并设定时间

result = add.apply_async(args=[4, 3], eta=task_time)

print(result.id)

类似于contab的定时任务

多任务结构中celery.py修改如下

from datetime import timedelta

from celery import Celery

from celery.schedules import crontab cel = Celery('tasks', broker='redis://127.0.0.1:6379/1', backend='redis://127.0.0.1:6379/2', include=[

'celery_task.tasks1',

'celery_task.tasks2',

])

cel.conf.timezone = 'Asia/Shanghai'

cel.conf.enable_utc = False cel.conf.beat_schedule = {

# 名字随意命名

'add-every-10-seconds': {

# 执行tasks1下的test_celery函数

'task': 'celery_task.tasks1.test_celery',

# 每隔2秒执行一次

# 'schedule': 1.0,

# 'schedule': crontab(minute="*/1"),

'schedule': timedelta(seconds=2),

# 传递参数

'args': ('test',)

},

# 'add-every-12-seconds': {

# 'task': 'celery_task.tasks1.test_celery',

# 每年4月11号,8点42分执行

# 'schedule': crontab(minute=42, hour=8, day_of_month=11, month_of_year=4),

# 'schedule': crontab(minute=42, hour=8, day_of_month=11, month_of_year=4),

# 'args': (16, 16)

# },

}

启动一个beat:celery beat -A celery_task -l info

注意:同一个目录下只能开启一个beat

启动work执行:celery worker -A celery_task -l info -P eventlet

6.Django中使用Celery

提示:django-celery模块兼容不太友好建议不使用,可以直接用多任务结构,在任何python框架中都能使用

安装包

celery==3.1.25

django-celery==3.1.20

在项目目录下创建celeryconfig.py

import djcelery

djcelery.setup_loader()

CELERY_IMPORTS=(

'app01.tasks',

)

#有些情况可以防止死锁

CELERYD_FORCE_EXECV=True

# 设置并发worker数量

CELERYD_CONCURRENCY=4

#允许重试

CELERY_ACKS_LATE=True

# 每个worker最多执行100个任务被销毁,可以防止内存泄漏

CELERYD_MAX_TASKS_PER_CHILD=100

# 超时时间

CELERYD_TASK_TIME_LIMIT=12*30

在app01目录下创建tasks.py

from celery import task

@task

def add(a,b):

with open('a.text', 'a', encoding='utf-8') as f:

f.write('a')

print(a+b)

视图函数views.py

from django.shortcuts import render,HttpResponse

from app01.tasks import add

from datetime import datetime

def test(request):

# result=add.delay(2,3)

ctime = datetime.now()

# 默认用utc时间

utc_ctime = datetime.utcfromtimestamp(ctime.timestamp())

from datetime import timedelta

time_delay = timedelta(seconds=5)

task_time = utc_ctime + time_delay

result = add.apply_async(args=[4, 3], eta=task_time)

print(result.id)

return HttpResponse('ok')

settings.py

INSTALLED_APPS = [

...

'djcelery',

'app01'

] ... from djagocele import celeryconfig

BROKER_BACKEND='redis'

BOOKER_URL='redis://127.0.0.1:6379/1'

CELERY_RESULT_BACKEND='redis://127.0.0.1:6379/2'

celery分布式异步框架的更多相关文章

- 分布式异步框架celery

Celery 1.什么是Clelery Celery是一个简单.灵活且可靠的,处理大量消息的分布式系统 专注于实时处理的异步任务队列 同时也支持任务调度 Celery架构 Celery的架构由三部分组 ...

- celery 分布式异步队列框架使用方法

简介: Celery 是一个python开发的异步分布式任务调度模块,是一个消息传输的中间件,可以理解为一个邮箱,每当应用程序调用celery的异步任务时,会向broker传递消息,然后celery ...

- Celery分布式异步任务框架

一.什么是Celery Celery是一个简单.灵活且可靠的,处理大量消息的分布式系统.专注于实时处理的异步任务队列,同时也支持定时任务 二.Celery架构 1.Celery的架构由三部分组成: 消 ...

- Python开发【模块】:Celery 分布式异步消息任务队列

Celery 前言: Celery 是一个 基于python开发的分布式异步消息任务队列,通过它可以轻松的实现任务的异步处理, 如果你的业务场景中需要用到异步任务,就可以考虑使用celery, 举几个 ...

- 安装 rabbitmq ,通过生成器获取redis列表数据 与 Celery 分布式异步队列

一.安装rabbitmq @全体成员 超简易安装rabbitmq文档 1.安装配置epel源rpm -ivh http://dl.fedoraproject.org/pub/epel/6/i386/ ...

- celery 分布式异步任务框架(celery简单使用、celery多任务结构、celery定时任务、celery计划任务、celery在Django项目中使用Python脚本调用Django环境)

一.celery简介: Celery 是一个强大的 分布式任务队列 的 异步处理框架,它可以让任务的执行完全脱离主程序,甚至可以被分配到其他主机上运行.我们通常使用它来实现异步任务(async tas ...

- django celery的分布式异步之路(一) 起步

如果你看完本文还有兴趣的话,可以看看进阶篇:http://www.cnblogs.com/kangoroo/p/7300433.html 设想你遇到如下场景: 1)高并发 2)请求的执行相当消耗机器资 ...

- Celery—分布式的异步任务处理系统

Celery 1.什么是Clelery Celery是一个简单.灵活且可靠的,处理大量消息的分布式系统 专注于实时处理的异步任务队列 同时也支持任务调度 Celery架构 Celery的架构由三部分组 ...

- django项目学习之异步框架celery

最近用django一个网上商城项目的时候用两个扩展,感觉还不错,所以在此记录一下. 首先来说下celery,celery是一个处理异步任务的框架,需要下载celery包,一般在项目需要进行耗时操作的时 ...

随机推荐

- Redis事物

redis事物定义: >Redis事务是一个单独的隔离操作:事务中的所有命令都会序列化.按顺序地执行.事务在执行的过程中,不会被其他客户端发送来的命令请求所打断. >Redis事务的主要作 ...

- table index & delete array item

table index & delete array item https://www.iviewui.com/components/table#ZDYLMB 编辑 row = { " ...

- 集合之HashMap(含JDK1.8源码分析)

一.前言 之前的List,讲了ArrayList.LinkedList,反映的是两种思想: (1)ArrayList以数组形式实现,顺序插入.查找快,插入.删除较慢 (2)LinkedList以链表形 ...

- SpringBoot Junit Maven JaCoCo

写一下最近写单体测试的一些笔记. SrpingBoot的测试用例: @RunWith(SpringJUnit4ClassRunner.class) @SpringBootTest(classes = ...

- MySQL 索引长度和区分度

首先 索引长度和区分度是相互矛盾的, 索引长度太短,那么区分度就很低,吧索引长度加长,区分度就高,但是索引也是要占内存的,所以我们需要找到一个平衡点: 那么这个平衡点怎么来定? 比如用户表有个字段 ...

- 14.statefulset服务

有状态的控制器有以下几个特点 稳定,独特的网络标识符. 稳定,持久的存储. 有序,优雅的部署和扩展. 有序的自动滚动更新. 使用限制 StatefulSet是1.9之前的beta资源,在1.5之前的任 ...

- sed命令参数之-r -i

对于初学linux的朋友来说,能记住命令附带的一大帮参数就以及非常不容易了.好不容易把该用的参数都想全了.sed -irns 后面一大片脚本 ,一执行出错了 what!!!! 创建一下测试环境 hea ...

- 保密工作与linux系统的发展

保密工作从性质上可以分成商业方面的保密和国家安全方面的保密.由于自己从事的是IT方面的工作,工作中必然会接触涉及到计算机信息方面的相关文件.加上单位已近通过武器装备科研生产单位二级保密资格认证,今天就 ...

- puppet的常用语法

检查语法错误 puppet parser validate xx.pp 在客户端测试但是不应用 puppet agent --test --noop 基于安全的考虑,使用预签名证书 puppet ce ...

- 【XSY2111】Chef and Churus 分块 树状数组

题目描述 有一个长度为\(n\)的数组\(A\)和\(n\)个区间\([l_i,r_i]\),有\(q\)次操作: \(1~x~y\):把\(a_x\)改成\(y\) \(2~x~y\):求第\(l\ ...