Intel MKL函数之 cblas_sgemm、cblas_sgemm_batch

cblas_sgemm

int m = 40;

int k = 20;

int n = 40;

std::vector<float> a(m*k, 1.0);

std::vector<float> b(k*n, 1.0);

std::vector<float> c(m*n, 0.0);

float alpha = 1.0;

float beta = 0.0;

cblas_sgemm(CblasRowMajor, CblasNoTrans, CblasNoTrans,

m, n, k, alpha,

a.data(), k,

b.data(), n, beta,

c.data(), n);

std::cout << "a.size(): " << a.size() << std::endl;

for (int i = 0; i < a.size(); ++i) {

std::cout << a[i] << " ";

if ((i + 1) % k == 0)

std::cout << std::endl;

}

std::cout << "b.size(): " << b.size() << std::endl;

for (int i = 0; i < b.size(); ++i) {

std::cout << b[i] << " ";

if ((i + 1) % n == 0)

std::cout << std::endl;

}

std::cout << "c.size(): " << c.size() << std::endl;

for (int i = 0; i < c.size(); ++i) {

std::cout << c[i] << " ";

if ((i + 1) % n == 0)

std::cout << std::endl;

}

std::cout << std::endl;

output:

a.size(): 800 ( 40 * 20 )

1 1 ... 1 1

...

1 1 ... 1 1

b.size(): 800 ( 20 * 40 )

1 1 ... 1 1

...

1 1 ... 1 1

c_array.size(): 1600 (40 * 40)

20 20 ... 20 20

...

20 20 ... 20 20

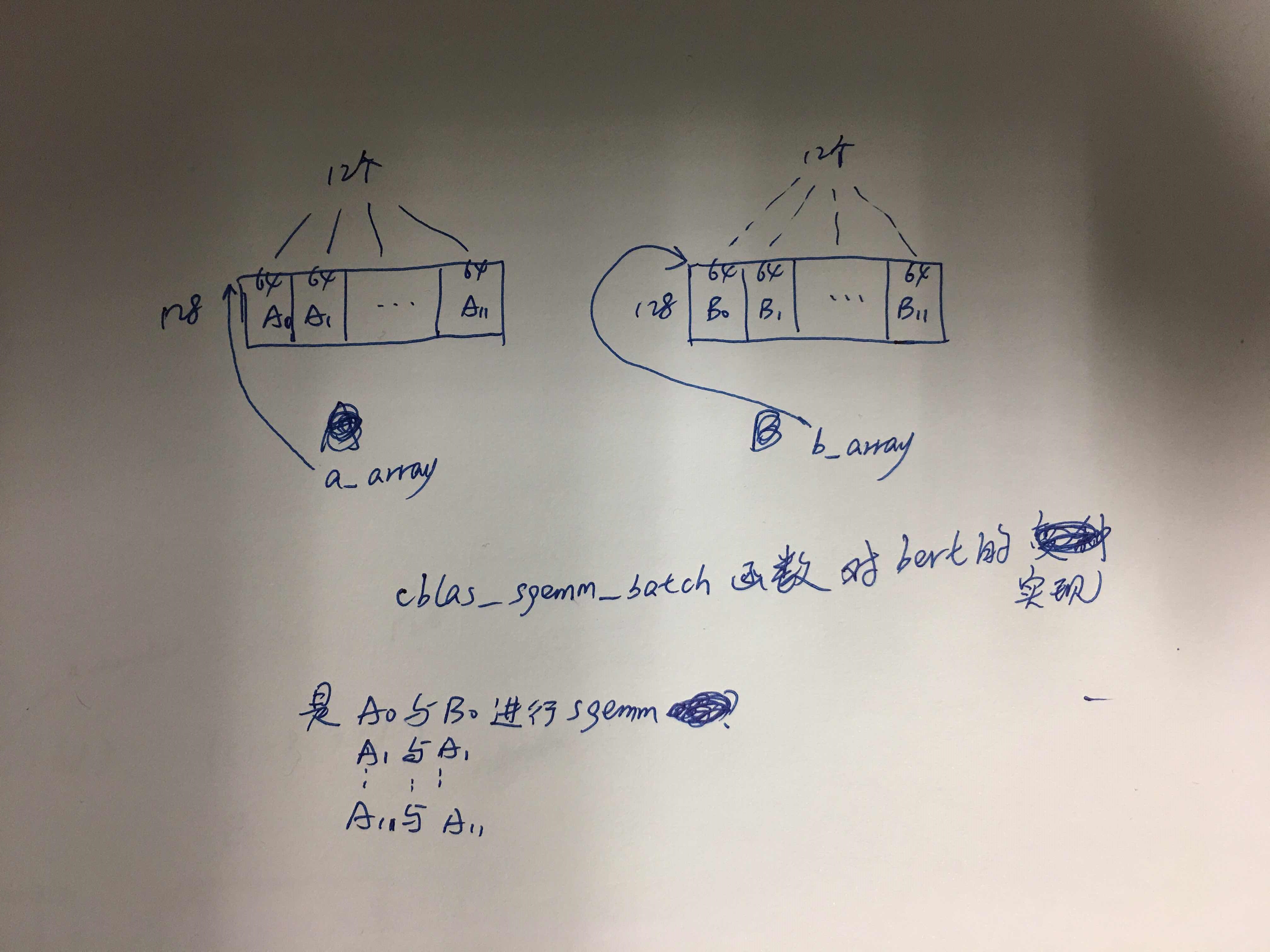

cblas_sgemm_batch

int raw_rows = 20;

int raw_cols = 40;

std::vector<float> a(raw_rows * raw_cols, 1.0);

std::vector<float> b(raw_rows * raw_cols, 1.0);

std::vector<float> c(1600, 0.0);

#define GRP_COUNT 1

MKL_INT m[GRP_COUNT] = {20};

MKL_INT k[GRP_COUNT] = {10};

MKL_INT n[GRP_COUNT] = {20};

MKL_INT lda[GRP_COUNT] = {40};

MKL_INT ldb[GRP_COUNT] = {40};

MKL_INT ldc[GRP_COUNT] = {80};

CBLAS_TRANSPOSE transA[GRP_COUNT] = { CblasNoTrans };

CBLAS_TRANSPOSE transB[GRP_COUNT] = { CblasTrans };

float alpha[GRP_COUNT] = {1.0};

float beta[GRP_COUNT] = {0.0};

const MKL_INT size_per_grp[GRP_COUNT] = {4};

const float *a_array[4], *b_array[4];

float *c_array[4];

for (int i = 0; i < 4; ++i) {

a_array[i] = a.data() + i * 10;

b_array[i] = b.data() + i * 10;

c_array[i] = c.data() + i * 20;

}

cblas_sgemm_batch (CblasRowMajor, transA, transB,

m, n, k, alpha,

a_array, lda,

b_array, ldb, beta,

c_array, ldc,

GRP_COUNT, size_per_grp);

std::cout << "a.size(): " << a.size() << std::endl;

for (int i = 0; i < a.size(); ++i) {

std::cout << a[i] << " ";

if ((i + 1) % 40 == 0)

std::cout << std::endl;

}

std::cout << "b.size(): " << b.size() << std::endl;

for (int i = 0; i < b.size(); ++i) {

std::cout << b[i] << " ";

if ((i + 1) % 40 == 0)

std::cout << std::endl;

}

std::cout << "c_array.size(): " << 20 * 20 * 4 << std::endl;

for (int i = 0; i < 1600; ++i) {

std::cout << c[i] << " ";

if ((i + 1) % 80 == 0)

std::cout << std::endl;

}

std::cout << std::endl;

output:

a.size(): 800 ( 20 * 40 )

1 1 ... 1 1

...

1 1 ... 1 1

b.size(): 800 ( 20 * 40 )

1 1 ... 1 1

...

1 1 ... 1 1

c_array.size(): 1600 (40 * 40)

10 10 ... 10 10

...

10 10 ... 10 10

int raw_rows = 20;

int raw_cols = 40;

std::vector<float> a(raw_rows * raw_cols, 1.0);

std::vector<float> b(raw_rows * raw_cols, 1.0);

std::vector<float> c(400, 0.0);

#define GRP_COUNT 1

MKL_INT m[GRP_COUNT] = {5};

MKL_INT k[GRP_COUNT] = {10};

MKL_INT n[GRP_COUNT] = {5};

MKL_INT lda[GRP_COUNT] = {40};

MKL_INT ldb[GRP_COUNT] = {40};

MKL_INT ldc[GRP_COUNT] = {20};

CBLAS_TRANSPOSE transA[GRP_COUNT] = { CblasNoTrans };

CBLAS_TRANSPOSE transB[GRP_COUNT] = { CblasTrans };

float alpha[GRP_COUNT] = {1.0};

float beta[GRP_COUNT] = {0.0};

const MKL_INT size_per_grp[GRP_COUNT] = {16};

const float *a_array[16], *b_array[16];

float *c_array[16];

for (int i = 0; i < 4; ++i) {

for (int j = 0; j < 4; ++j) {

a_array[i*4+j] = a.data() + i * 5 * 40 + j * 10;

b_array[i*4+j] = b.data() + i * 5 * 40 + j * 10;

c_array[i*4+j] = c.data() + i * 5 * 20 + j * 5;

}

}

cblas_sgemm_batch (CblasRowMajor, transA, transB,

m, n, k, alpha,

a_array, lda,

b_array, ldb, beta,

c_array, ldc,

GRP_COUNT, size_per_grp);

std::cout << "a.size(): " << a.size() << std::endl;

for (int i = 0; i < a.size(); ++i) {

std::cout << a[i] << " ";

if ((i + 1) % 40 == 0)

std::cout << std::endl;

}

std::cout << "b.size(): " << b.size() << std::endl;

for (int i = 0; i < b.size(); ++i) {

std::cout << b[i] << " ";

if ((i + 1) % 40 == 0)

std::cout << std::endl;

}

std::cout << "c_array.size(): " << 5 *5 * 16 << std::endl;

for (int i = 0; i < 400; ++i) {

std::cout << c[i] << " ";

if ((i + 1) % 20 == 0)

std::cout << std::endl;

}

std::cout << std::endl;

output:

a.size(): 800 ( 20 * 40 )

1 1 ... 1 1

...

1 1 ... 1 1

b.size(): 800 ( 20 * 40 )

1 1 ... 1 1

...

1 1 ... 1 1

c_array.size(): 400 (20 * 20)

10 10 ... 10 10

...

10 10 ... 10 10

Intel MKL函数之 cblas_sgemm、cblas_sgemm_batch的更多相关文章

- Intel MKL函数,如何得到相同的计算结果?【转】

在运行程序时,我们总希望多次运行的结果,是完全一致,甚至在不同的机器与不同的OS中,程序运行的结果每一位都完全相同. 事实上,程序往往很难保证做到这一点. 为什么呢? 我们先看一个简单的例子: 当程序 ...

- Intel MKL 多线程设置

对于多核程序,多线程对于程序的性能至关重要. 下面,我们将对Intel MKL 有关多线程方面的设置做一些介绍: 我们提到MKL 支持多线程,它包括的两个概念:1>MKL 是线程安全的: MKL ...

- Intel MKL(Math Kernel Library)

1.Intel MKL简介 Intel数学核心函数库(MKL)是一套高度优化.线程安全的数学例程.函数,面向高性能的工程.科学与财务应用.英特尔 MKL 的集群版本包括 ScaLAPACK 与分布式内 ...

- BLAS 与 Intel MKL 数学库

0. BLAS BLAS(Basic Linear Algebra Subprograms)描述和定义线性代数运算的规范(specification),而不是一种具体实现,对其的实现包括: AMD C ...

- 【神经网络与深度学习】【C/C++】比较OpenBLAS,Intel MKL和Eigen的矩阵相乘性能

比较OpenBLAS,Intel MKL和Eigen的矩阵相乘性能 对于机器学习的很多问题来说,计算的瓶颈往往在于大规模以及频繁的矩阵运算,主要在于以下两方面: (Dense/Sparse) Matr ...

- Intel MKL FATAL ERROR: Cannot load mkl_intel_thread.dll

Intel MKL FATAL ERROR: Cannot load mkl_intel_thread.dll 在使用Anaconda创建一个虚拟环境出来,然后安装了scikit-learn.nump ...

- 遇到Intel MKL FATAL ERROR: Cannot load libmkl_avx2.so or libmkl_def.so问题的解决方法

运行一个基于tensorflow的模型时,遇到Intel MKL FATAL ERROR: Cannot load libmkl_avx2.so or libmkl_def.so问题. 解决方法:打开 ...

- ubuntu配置机器学习环境(四) 安装intel MKL

在这一模块可以选择(ATLAS,MKL或者OpenBLAS),我这里使用MKL,首先下载并安装英特尔® 数学内核库 Linux* 版MKL,下载链接, 请下载Student版,先申请,然后会立马收到一 ...

- 在NVIDIA(CUDA,CUBLAS)和Intel MKL上快速实现BERT推理

在NVIDIA(CUDA,CUBLAS)和Intel MKL上快速实现BERT推理 直接在NVIDIA(CUDA,CUBLAS)或Intel MKL上进行高度定制和优化的BERT推理,而无需tenso ...

随机推荐

- shell后台进程

建立duplicate_removal.sh文件,内容如下:#!/bin/bashmysql -vvv -u root -p123456 test -e "truncate t_target ...

- Android Build System Ultimate Guide

Android Build System Ultimate Guide April 8,2013 Lately, Android Open Source Project has gone throug ...

- skip a transaction in goldengate

skip a transaction in goldengate [oracle@db ]$ ggsci Oracle GoldenGate Command Interpreter for Oracl ...

- 十一、python函数学习

1. 定义函数 def 函数名(形参): 函数体 return xxx--------其下面的内容不再执行 ---------------------------------------- ...

- jobs的后台进程程序如何终止?

好像没有专门的jobs相关的命令来终止后台进程, 只有通过 jobs -l看 后台进程的pid, 然后用kill来终止. 摘录: (( 进程的终止 后台进程的终止: 方法一: 通过jobs命令查看jo ...

- 44 答疑(三)--join的写法/Simple nested loop join的性能问题/Distinct和group by的性能/备库自增主键问题

44 答疑(三) Join的写法 35节介绍了join执行顺序,加了straight_join,两个问题: --1 如果用left join,左边的表一定是驱动表吗 --2 如果两个表的join包含多 ...

- Bootstrap 学习笔记 项目实战 响应式轮播图

左右两个箭头可以随浏览器缩放进行移动 保持在图片中间 Html代码: <!DOCTYPE html> <html lang="zh-cn"> <hea ...

- debian下使用shell脚本时出现了 declare:not found 解决方法

问题:出现declare:not found的提示 解决:原来,UBUNTU用的是dash(后来证明这个其实这个不是错误的原因:从#!/bin/bash到#!/bin/dash,依旧无法运行,在这写出 ...

- IDEA开发环境设置

IDEA开发环境设置 1.关闭自动更新 IntelliJ IDEA默认会自动进行版本的更新,在网络异常时经常会导致各种各样的问题,因此强烈建议关闭自动更新. File->Settings 2.隐 ...

- 关于toString()和valueOf()以及Object.prototype.toString.call()的结合理解

一.先说说String(): String()是全局函数,把对象的值转换为字符串. 语法:String(obj); 任何值(对象)都有String()方法,执行过程是这样的:首先,如果该对象上有toS ...