大数据学习之HDFS的工作机制07

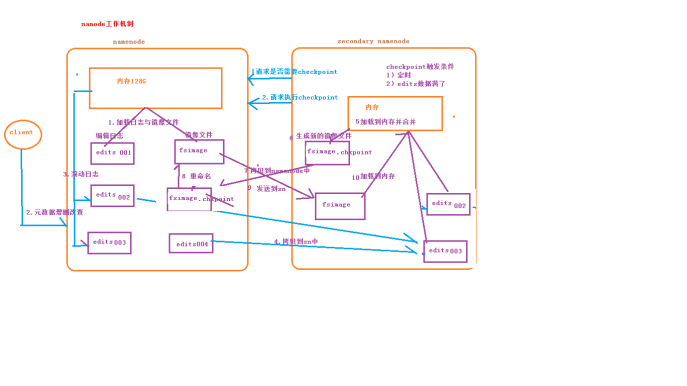

1:namenode+secondaryNameNode工作机制

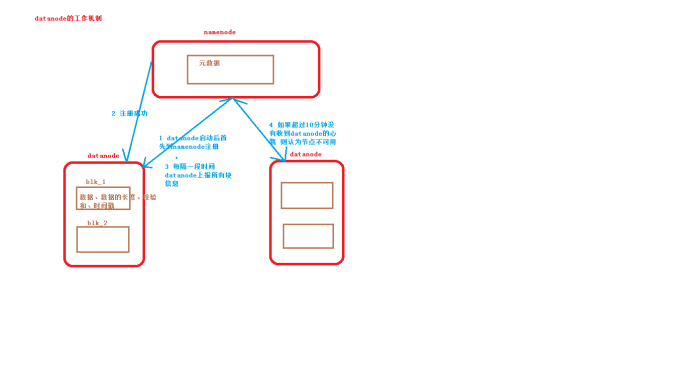

2:datanode工作机制

3:HDFS中的通信(代理对象RPC)

下面用代码来实现基本的原理

1:服务端代码

package it.dawn.HDFSPra.RPC.server; import java.io.IOException; import org.apache.hadoop.HadoopIllegalArgumentException;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.ipc.RPC;

import org.apache.hadoop.ipc.RPC.Builder;

import org.apache.hadoop.ipc.RPC.Server; import it.dawn.HDFSPra.RPC.protocol.RpcProtocol; /**

* @version 1.0

* @author Dawn

* @date 2019年4月29日17:10:25

* @return 模拟了一个rpc通信。该类是服务端

*/

public class RpcServer {

public static void main(String[] args) throws HadoopIllegalArgumentException, IOException {

//1.构建rpc框架

Builder builder = new RPC.Builder(new Configuration()); //2.绑定地址

builder.setBindAddress("localhost"); //3.绑定端口号

builder.setPort(6666); //4.绑定协议

builder.setProtocol(RpcProtocol.class); //5.调用协议的实现类

builder.setInstance(new MyRpcProtocol()); //6.创建服务

Server servers= builder.build();

servers.start();

} }

2:代理对象接口

package it.dawn.HDFSPra.RPC.protocol;

public interface RpcProtocol {

//1.定义协议的id

public static final long versionID=1L;

//2.定义方法(拿到元数据的方式)

public String getMetaData(String path);

}

3:代理对象的实现

package it.dawn.HDFSPra.RPC.server;

import it.dawn.HDFSPra.RPC.protocol.RpcProtocol;

public class MyRpcProtocol implements RpcProtocol{

@Override

public String getMetaData(String path) {

return path+": 3 - {BLK_1,blk_2,BLK_3...}";

}

}

4:客服端

package it.dawn.HDFSPra.RPC.client; import java.io.IOException;

import java.net.InetSocketAddress; import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.ipc.RPC; import it.dawn.HDFSPra.RPC.protocol.RpcProtocol; /**

* @version 1.0

* @author Dawn

* @date 2019年4月29日17:10:25

* @return 模拟了一个rpc通信。该类是客服端

*/

public class Client {

public static void main(String[] args) throws IOException {

//1.拿到协议

RpcProtocol protocol =RPC.getProxy(RpcProtocol.class, 1L, new InetSocketAddress("localhost", 6666), new Configuration()); //2.发送请求

String result=protocol.getMetaData("/dawnhahhaha"); //3.拿到元数据信息

System.out.println(result);

}

}

大数据学习之HDFS的工作机制07的更多相关文章

- 大数据学习day11------hbase_day01----1. zk的监控机制,2动态感知服务上下线案例 3.HDFS-HA的高可用基本的工作原理 4. HDFS-HA的配置详解 5. HBASE(简介,安装,shell客户端,java客户端)

1. ZK的监控机制 1.1 监听数据的变化 (1)监听一次 public class ChangeDataWacher { public static void main(String[] arg ...

- 大数据 --> 分布式文件系统HDFS的工作原理

分布式文件系统HDFS的工作原理 Hadoop分布式文件系统(HDFS)是一种被设计成适合运行在通用硬件上的分布式文件系统.HDFS是一个高度容错性的系统,适合部署在廉价的机器上.它能提供高吞吐量的数 ...

- 大数据学习笔记——HDFS写入过程源码分析(2)

HDFS写入过程注释解读 & 源码分析 此篇博客承接上一篇未讲完的内容,将会着重分析一下在Namenode获取到元数据后,具体是如何向datanode节点写入真实的数据的 1. 框架图展示 在 ...

- 大数据学习之HDFS基本API操作(上)06

package it.dawn.HDFSPra; import java.io.FileNotFoundException; import java.io.IOException; import ja ...

- 大数据学习之hdfs集群安装部署04

1-> 集群的准备工作 1)关闭防火墙(进行远程连接) systemctl stop firewalld systemctl -disable firewalld 2)永久修改设置主机名 vi ...

- 大数据学习笔记——HDFS写入过程源码分析(1)

HDFS写入过程方法调用逻辑 & 源码注释解读 前一篇介绍HDFS模块的博客中,我们重点从实践角度介绍了各种API如何使用以及IDEA的基本安装和配置步骤,而从这一篇开始,将会正式整理HDFS ...

- 大数据学习笔记——HDFS理论知识之编辑日志与镜像文件

HDFS文件系统——编辑日志和镜像文件详细介绍 我们知道,启动Hadoop之后,在主节点下会产生Namenode,即名称节点进程,该节点的目录下会保存一份元数据,用来记录文件的索引,而在从节点上即Da ...

- 大数据学习之HDFS基本API操作(下)06

hdfs文件流操作方法一: package it.dawn.HDFSPra; import java.io.BufferedReader; import java.io.FileInputStream ...

- 大数据学习之HDFS基本命令操作05

1)hdfs的客户端 1.网页形式->测试用 http://192.168.40.11:50070/dfshealth.html#tab-overview 2.命令行形式->测试用 3.企 ...

随机推荐

- Java枚举、静态导入、自动拆装箱、增强for循环、可变参数

一.枚举简介 1.什么是枚举? 需要在一定范围内取值,这个值只能是这个范围内中的任意一个 现实场景:交通信号灯,有三种颜色,但是每次只能亮三种颜色里面的任意一个 2.使用一个关键字 enum enum ...

- jQuery处理JSONP

http://www.g7blogs.com/?p=821 作为一枚前端,提起jsonp大家都不会陌生.特别是在我们组内的业务中,和服务器端交互的数据几乎都是采用这种形式.但假如要让你用原生的JS写出 ...

- 关于log4j知识

今天下午接触到log4j知识,花了几个小时,百度了一圈,总算是懂了一些. log4j的作用:log4j是一个日志输出的插件专门用来进行日志管理的,根据我的理解就是用来执行我们用来检测程序bug的Sys ...

- CSS Align bottom

<html> <head> <meta http-equiv="Content-Type" content="text/html; char ...

- ionic--分模块

1. app.js var app=angular.module("myApp",["ionic","myController"," ...

- angular排序

说点小案例angular的排序 <!DOCTYPE html> <html ng-app="mk"> <head> <meta chars ...

- 【一些简单的jQuery选择器】

学习[js DOM 编程艺术],最后面有许多jQuery的选择器,每个都动手敲了一遍. jQuery 提供了高级选择器的方法. js获取元素的三个基本方法分别是通过标签名,类名和id,即(getEle ...

- 007Spring Security

01.基于Spring AOP 和 Servlet规范中Filter实现 的安全框架 <dependency> <groupId>org.springframework.se ...

- 设置Web AppBuilder的HTTP代理

在使用Web AppBuilder快速搭建webgis应用时,我们往往需要访问外部互联网的在线gis服务资源.假如要通过代理服务器才能访问互联网的在线gis服务资源,那么则需要预先配置web appb ...

- LeetCode赛题394----Decode String

394. Decode String Given an encoded string, return it's decoded string. The encoding rule is: k[enco ...