011.Kubernetes二进制部署kube-scheduler

一 部署高可用kube-scheduler

1.1 高可用kube-scheduler介绍

- 与 kube-apiserver 的安全端口通信;

- 在安全端口(https,10251) 输出 prometheus 格式的 metrics。

1.2 创建kube-scheduler证书和私钥

1 [root@k8smaster01 ~]# cd /opt/k8s/work

2 [root@k8smaster01 work]# cat > kube-scheduler-csr.json <<EOF

3 {

4 "CN": "system:kube-scheduler",

5 "hosts": [

6 "127.0.0.1",

7 "172.24.8.71",

8 "172.24.8.72",

9 "172.24.8.73"

10 ],

11 "key": {

12 "algo": "rsa",

13 "size": 2048

14 },

15 "names": [

16 {

17 "C": "CN",

18 "ST": "Shanghai",

19 "L": "Shanghai",

20 "O": "system:kube-scheduler",

21 "OU": "System"

22 }

23 ]

24 }

25 EOF

26 #创建kube-scheduler的CA证书请求文件

1 [root@k8smaster01 ~]# cd /opt/k8s/work

2 [root@k8smaster01 work]# cfssl gencert -ca=/opt/k8s/work/ca.pem \

3 -ca-key=/opt/k8s/work/ca-key.pem -config=/opt/k8s/work/ca-config.json \

4 -profile=kubernetes kube-scheduler-csr.json | cfssljson -bare kube-scheduler #生成CA密钥(ca-key.pem)和证书(ca.pem)

1.3 分发证书和私钥

1 [root@k8smaster01 ~]# cd /opt/k8s/work

2 [root@k8smaster01 work]# source /opt/k8s/bin/environment.sh

3 [root@k8smaster01 work]# for master_ip in ${MASTER_IPS[@]}

4 do

5 echo ">>> ${master_ip}"

6 scp kube-scheduler*.pem root@${master_ip}:/etc/kubernetes/cert/

7 done

1.4 创建和分发kubeconfig

1 [root@k8smaster01 ~]# cd /opt/k8s/work

2 [root@k8smaster01 work]# source /opt/k8s/bin/environment.sh

3 [root@k8smaster01 work]# kubectl config set-cluster kubernetes \

4 --certificate-authority=/opt/k8s/work/ca.pem \

5 --embed-certs=true \

6 --server=${KUBE_APISERVER} \

7 --kubeconfig=kube-scheduler.kubeconfig

8

9 [root@k8smaster01 work]# kubectl config set-credentials system:kube-scheduler \

10 --client-certificate=kube-scheduler.pem \

11 --client-key=kube-scheduler-key.pem \

12 --embed-certs=true \

13 --kubeconfig=kube-scheduler.kubeconfig

14

15 [root@k8smaster01 work]# kubectl config set-context system:kube-scheduler \

16 --cluster=kubernetes \

17 --user=system:kube-scheduler \

18 --kubeconfig=kube-scheduler.kubeconfig

19

20 [root@k8smaster01 work]# kubectl config use-context system:kube-scheduler --kubeconfig=kube-scheduler.kubeconfig

21

22 [root@k8smaster01 ~]# cd /opt/k8s/work

23 [root@k8smaster01 work]# source /opt/k8s/bin/environment.sh

24 [root@k8smaster01 work]# for master_ip in ${MASTER_IPS[@]}

25 do

26 echo ">>> ${master_ip}"

27 scp kube-scheduler.kubeconfig root@${master_ip}:/etc/kubernetes/

28 done

1.5 创建kube-scheduler 配置文件

1 [root@k8smaster01 ~]# cd /opt/k8s/work

2 [root@k8smaster01 work]# cat >kube-scheduler.yaml.template <<EOF

3 apiVersion: kubescheduler.config.k8s.io/v1alpha1

4 kind: KubeSchedulerConfiguration

5 bindTimeoutSeconds: 600

6 clientConnection:

7 burst: 200

8 kubeconfig: "/etc/kubernetes/kube-scheduler.kubeconfig"

9 qps: 100

10 enableContentionProfiling: false

11 enableProfiling: true

12 hardPodAffinitySymmetricWeight: 1

13 healthzBindAddress: ##MASTER_IP##:10251

14 leaderElection:

15 leaderElect: true

16 metricsBindAddress: ##MASTER_IP##:10251

17 EOF

1 [root@k8smaster ~]# cd /opt/k8s/work

2 [root@k8smaster work]# source /opt/k8s/bin/environment.sh

3 [root@k8smaster work]# for (( i=0; i < 3; i++ ))

4 do

5 sed -e "s/##MASTER_NAME##/${MASTER_NAMES[i]}/" -e "s/##MASTER_IP##/${MASTER_IPS[i]}/" kube-scheduler.yaml.template > kube-scheduler-${MASTER_IPS[i]}.yaml

6 done #替换模板文件中的变量

7 [root@k8smaster01 work]# ls kube-scheduler*.yaml

8 #MASTER_NAMES 和 MASTER_IPS 为相同长度的 bash 数组,分别为节点名称和对应的 IP

1.6 分发配置文件

1 [root@k8smaster01 ~]# cd /opt/k8s/work

2 [root@k8smaster01 work]# source /opt/k8s/bin/environment.sh

3 [root@k8smaster01 work]# for master_ip in ${MASTER_IPS[@]}

4 do

5 echo ">>> ${master_ip}"

6 scp kube-scheduler-${master_ip}.yaml root@${master_ip}:/etc/kubernetes/kube-scheduler.yaml

7 done

1.7 创建kube-scheduler的systemd

1 [root@k8smaster01 ~]# cd /opt/k8s/work

2 [root@k8smaster01 work]# source /opt/k8s/bin/environment.sh

3 [root@k8smaster01 work]# cat > kube-scheduler.service.template <<EOF

4 [Unit]

5 Description=Kubernetes Scheduler

6 Documentation=https://github.com/GoogleCloudPlatform/kubernetes

7

8 [Service]

9 WorkingDirectory=${K8S_DIR}/kube-scheduler

10 ExecStart=/opt/k8s/bin/kube-scheduler \\

11 --config=/etc/kubernetes/kube-scheduler.yaml \\

12 --bind-address=##MASTER_IP## \\

13 --secure-port=10259 \\

14 --port=0 \\

15 --tls-cert-file=/etc/kubernetes/cert/kube-scheduler.pem \\

16 --tls-private-key-file=/etc/kubernetes/cert/kube-scheduler-key.pem \\

17 --authentication-kubeconfig=/etc/kubernetes/kube-scheduler.kubeconfig \\

18 --client-ca-file=/etc/kubernetes/cert/ca.pem \\

19 --requestheader-allowed-names="" \\

20 --requestheader-client-ca-file=/etc/kubernetes/cert/ca.pem \\

21 --requestheader-extra-headers-prefix="X-Remote-Extra-" \\

22 --requestheader-group-headers=X-Remote-Group \\

23 --requestheader-username-headers=X-Remote-User \\

24 --authorization-kubeconfig=/etc/kubernetes/kube-scheduler.kubeconfig \\

25 --logtostderr=true \\

26 --v=2

27 Restart=always

28 RestartSec=5

29 StartLimitInterval=0

30

31 [Install]

32 WantedBy=multi-user.target

33 EOF

1.8 分发systemd

1 [root@k8smaster01 ~]# cd /opt/k8s/work

2 [root@k8smaster01 work]# source /opt/k8s/bin/environment.sh

3 [root@k8smaster01 work]# for (( i=0; i < 3; i++ ))

4 do

5 sed -e "s/##MASTER_NAME##/${MASTER_NAMES[i]}/" -e "s/##MASTER_IP##/${MASTER_IPS[i]}/" kube-scheduler.service.template > kube-scheduler-${MASTER_IPS[i]}.service

6 done #修正相应IP

7 [root@k8smaster01 work]# ls kube-scheduler*.service

8 [root@k8smaster01 ~]# cd /opt/k8s/work

9 [root@k8smaster01 work]# source /opt/k8s/bin/environment.sh

10 [root@k8smaster01 work]# for master_ip in ${MASTER_IPS[@]}

11 do

12 echo ">>> ${master_ip}"

13 scp kube-scheduler-${master_ip}.service root@${master_ip}:/etc/systemd/system/kube-scheduler.service

14 done #分发system

二 启动并验证

2.1 启动kube-scheduler 服务

1 [root@k8smaster01 ~]# cd /opt/k8s/work

2 [root@k8smaster01 work]# source /opt/k8s/bin/environment.sh

3 [root@k8smaster01 work]# for master_ip in ${MASTER_IPS[@]}

4 do

5 echo ">>> ${master_ip}"

6 ssh root@${master_ip} "mkdir -p ${K8S_DIR}/kube-scheduler"

7 ssh root@${master_ip} "systemctl daemon-reload && systemctl enable kube-scheduler && systemctl restart kube-scheduler"

8 done #启动服务前必须先创建工作目录

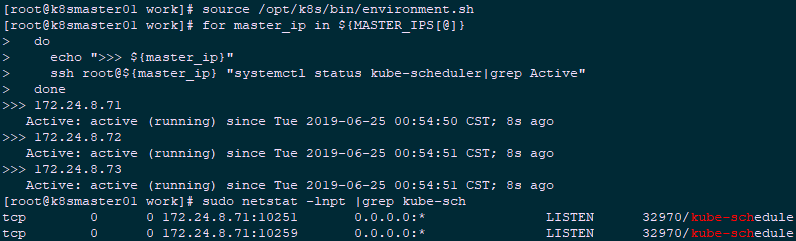

2.2 检查kube-scheduler 服务

1 [root@k8smaster01 ~]# source /opt/k8s/bin/environment.sh

2 [root@k8smaster01 ~]# for master_ip in ${MASTER_IPS[@]}

3 do

4 echo ">>> ${master_ip}"

5 ssh root@${master_ip} "systemctl status kube-scheduler|grep Active"

6 done

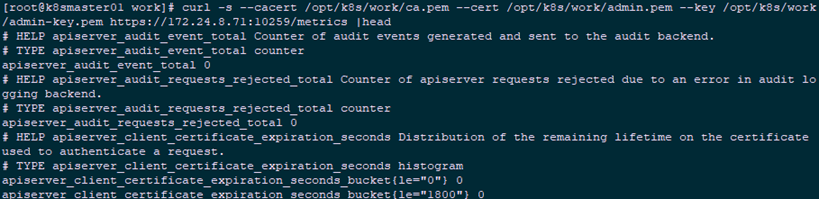

2.3 查看输出的 metrics

- 10251:接收 http 请求,非安全端口,不需要认证授权;

- 10259:接收 https 请求,安全端口,需要认证授权。

- 两个接口都对外提供 /metrics 和 /healthz 的访问。

1 [root@k8smaster01 ~]# sudo netstat -lnpt |grep kube-sch

1 [root@k8smaster01 ~]# curl -s http://127.0.0.1:10251/metrics |head

2 [root@k8smaster01 ~]# curl -s --cacert /opt/k8s/work/ca.pem --cert /opt/k8s/work/admin.pem --key /opt/k8s/work/admin-key.pem https://172.24.8.71:10259/metrics |head

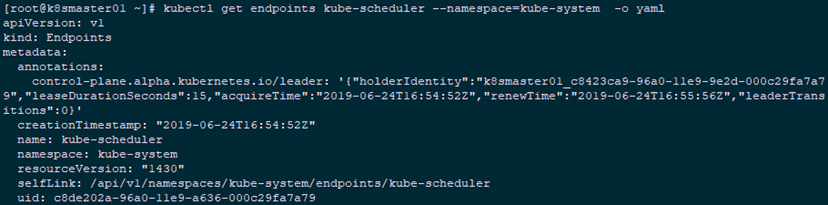

2.4 查看当前leader

1 [root@k8smaster01 ~]# kubectl get endpoints kube-scheduler --namespace=kube-system -o yaml

011.Kubernetes二进制部署kube-scheduler的更多相关文章

- Kubernetes 二进制部署(一)单节点部署(Master 与 Node 同一机器)

0. 前言 最近受“新冠肺炎”疫情影响,在家等着,入职暂时延后,在家里办公和学习 尝试通过源码编译二进制的方式在单一节点(Master 与 Node 部署在同一个机器上)上部署一个 k8s 环境,整理 ...

- kubernetes二进制部署k8s-master集群controller-manager服务unhealthy问题

一.问题现象 我们使用二进制部署k8s的高可用集群时,在部署多master时,kube-controller-manager服务提示Unhealthy [root@ceph-01 system]# k ...

- Kubernetes 二进制部署(二)集群部署(多 Master 节点通过 Nginx 负载均衡)

0. 前言 紧接上一篇,本篇文章我们尝试学习多节点部署 kubernetes 集群 并通过 haproxy+keepalived 实现 Master 节点的负载均衡 1. 实验环境 实验环境主要为 5 ...

- 003.Kubernetes二进制部署准备

一 前置准备 1.1 前置条件 相应的充足资源的Linux服务器: 设置相应的主机名,参考命令: hostnamectl set-hostname k8smaster Mac及UUID唯一: 若未关闭 ...

- 008.Kubernetes二进制部署Nginx实现高可用

一 Nginx代理实现kube-apiserver高可用 1.1 Nginx实现高可用 基于 nginx 代理的 kube-apiserver 高可用方案. 控制节点的 kube-controller ...

- 009.Kubernetes二进制部署kube-apiserver

一 部署master节点 1.1 master节点服务 kubernetes master 节点运行如下组件: kube-apiserver kube-scheduler kube-controlle ...

- 013.Kubernetes二进制部署worker节点Nginx实现高可用

一 Nginx代理实现kube-apiserver高可用 1.1 Nginx实现高可用 基于 nginx 代理的 kube-apiserver 高可用方案. 控制节点的 kube-controller ...

- 015.Kubernetes二进制部署所有节点kubelet

一 部署 kubelet kubelet 运行在每个 worker 节点上,接收 kube-apiserver 发送的请求,管理 Pod 容器,执行交互式命令,如 exec.run.logs 等. k ...

- 016.Kubernetes二进制部署所有节点kube-proxy

一 部署 kube-proxy kube-proxy 运行在所有节点上,它监听 apiserver 中 service 和 endpoint 的变化情况,创建路由规则以提供服务 IP 和负载均衡功能. ...

随机推荐

- ACM-ICPC 2018 焦作赛区网络预赛 H题 String and Times(SAM)

Now you have a string consists of uppercase letters, two integers AA and BB. We call a substring won ...

- ESP8266调试(UDP调试)

1.设置STA模式 AT+CWMODE=1 2.加入热点 AT+CWJAP="Admin_name","password" 3.开启单路连接 AT+CIPMUX ...

- Django ContentType 的使用

引入 一切优化,最终都是关于需求的优化.本文介绍需求确定之后的数据库表结构设计优化. 程序员应该都知道,编程是数据结构和算法的结合.所谓数据就是用户需要访问和操作的资源,比如购物类App里面的商品,图 ...

- servlet读取请求参数后流失效的问题

在用reset接口的时候,常常会使用request.getInputStream()方法,但是流只能读取一次,一旦想要加上一个过滤器用来检测用户请求的数据时就会出现异常. 在过滤器中通过流读取出用户p ...

- 【Java Web开发学习】Spring环境profile

[Java Web开发学习]Spring 环境profile 转载:http://www.cnblogs.com/yangchongxing/p/8890702.html 开发.测试.生产环境往往是不 ...

- Elasticsearch系列---补充几个知识点

概要 bulk api有趣的json格式 前面<简单入门实战>一节中,有介绍bulk的使用示例,大家一定很奇怪,还有这么有趣的JSON格式,必须严格照他的换行来做,我想把JSON搞得美观可 ...

- C语言每日一练——第4题

一.题目要求 已知数据文件in.dat中有300个四位数,并调用readDat()函数把这些数存储数组a中,编写函数jsValue(),其功能是:求出所有这些四位数是素数的个数cnt,再把所有满足此条 ...

- linux目录的读(r)、写(w)、执行(x)权限说明

linux目录的读.写.执行权限说明 1.可读r #表示具有浏览目录下面文件及子目录的权限.即ls dir 1)如果没有x权限,不能进到目录里,即无法 cd dir 2)如果没有x权限,ls列表可以看 ...

- Rabbit安装(单机及集群,阿里云)

Rabbit安装(单机及集群,阿里云) 前言 虽然我并不是部署人员,但是自己私人测试环境的各类东东还是得自己安装的. 尤其在规模不大的公司,基本安装部署工作都是后端的份内之事. 那么最令人痛苦的,莫过 ...

- Elasticsearch系列---搜索分页和deep paging问题

概要 本篇从介绍搜索分页为起点,简单阐述分页式数据搜索与原有集中式数据搜索思维方式的差异,就分页问题对deep paging问题的现象进行分析,最后介绍分页式系统top N的案例. 搜索分页语法 El ...