lagou数据爬取

1. 使用的工具

selenium+xpath+ 手动输入登录

2. 实现的功能:

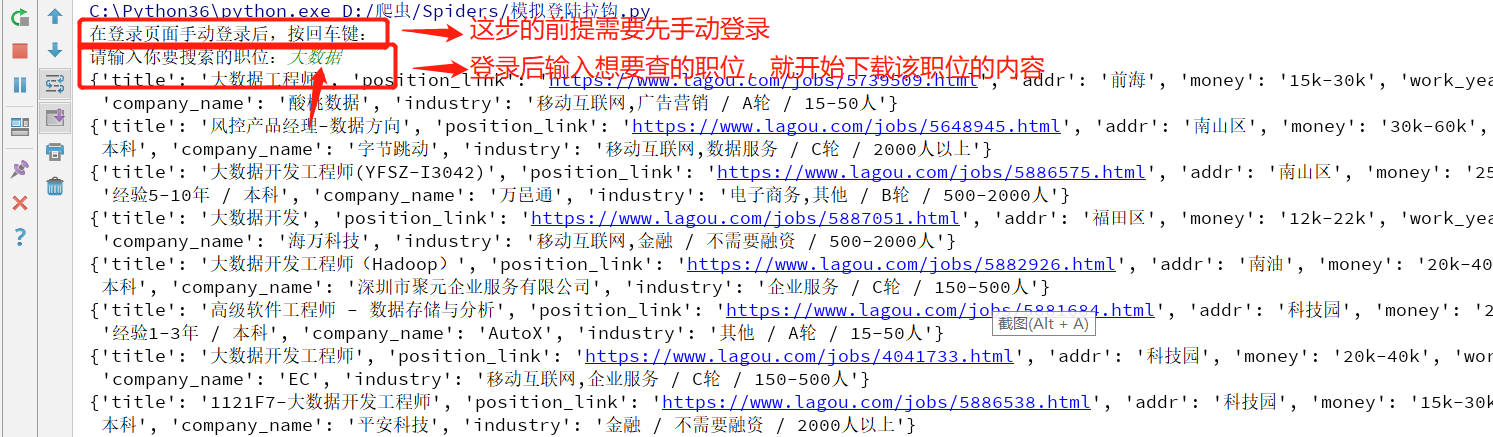

1.手动登录后,按终端提示,就能下载所需要的内容

import requests

import json

import time

import random

from lxml import etree

from concurrent.futures import ThreadPoolExecutor

from selenium import webdriver import pymongo # 连接mongo 数据库

client = pymongo.MongoClient()

db = client.lougou

collention =db.lou # 进入拉钩首页

url ='https://www.lagou.com/'

bro = webdriver.Chrome() bro.get(url) input('在登录页面手动登录后,按回车键:') # 进入了自己登录页面

# 找到收缩框

search_input = bro.find_element_by_id('search_input') # 找到搜索按钮

search_button = bro.find_element_by_id('search_button') # 输入你需要搜索的职位

search_msg = input('请输入你要搜索的职位:') # 在输入框自动填入搜索内容

search_input.send_keys(search_msg) # 自动点击搜索按钮

search_button.click() def get_data():

'''

提取页面数据 将数据存入 mongo 数据库

'''

time.sleep(1) # 获取页面内容

page=bro.page_source

time.sleep(2) tree = etree.HTML(page) li_list =tree.xpath("//ul[@class='item_con_list']/li") for li in li_list:

item={} item['title'] =li.xpath('.//h3/text()')[0] # 职位标题

item['position_link'] = li.xpath(".//a[@class='position_link']/@href")[0] # 职位详情链接

item['addr'] = li.xpath(".//span[@class='add']/em/text()")[0].strip() # 公司区域

item['money'] = li.xpath(".//div[@class='li_b_l']/span/text()")[0] # 岗位工资

item['work_year'] = li.xpath(".//div[@class='p_bot']/div[@class='li_b_l']//text()") #

item['work_year'] = [i.strip() for i in item['work_year'] if i.strip()]

item['work_year'] =item['work_year'][1] # 工作经历

item['company_name'] = li.xpath(".//div[@class='company_name']/a/text()")[0] # 公司名字

item['industry'] = li.xpath(".//div[@class='industry']/text()")[0].strip() # 公司所属行业 print(item)

# 将数据存到MongoDB 中 collention.insert(item) get_data() # 翻页下载该搜索也的所有页的数据

while 1: try:

# 下一页

next =bro.find_element_by_xpath('//span[@class="pager_next "]')

next.click() get_data() except : print('没有下一页了。。。。。') break # 进入循环 ,实现 用户再次 输入 不同职位进行下载该类职位的信息 ,用户可以按 q 或 Q 退出下载

while 1: keyword_input = bro.find_element_by_id('keyword') # 搜索框

submit_btn = bro.find_element_by_id('submit') # 搜索按钮 # 清空输入搜索框的内容

keyword_input.clear() # 重新进行搜索

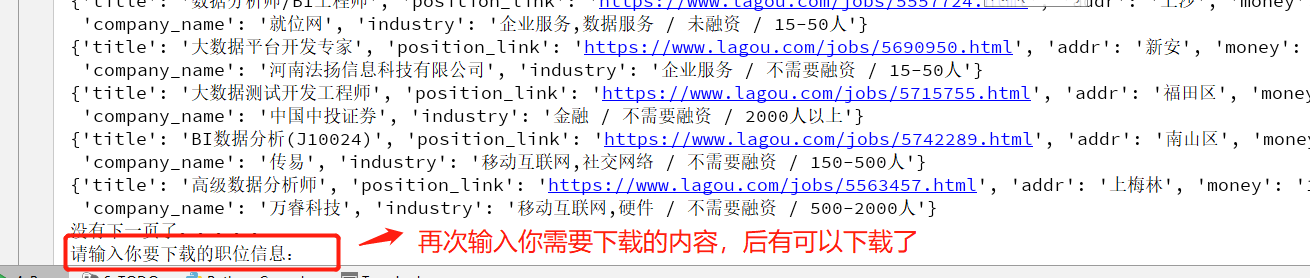

msg2 =input('请输入你要下载的职位信息:') # 退出循环条件,退出下载

if msg2.upper()=='Q':

break keyword_input.send_keys(msg2)

# 点击搜索

submit_btn.click() # 下载该页面的数据

get_data() while 1: try:

# 下一页

next =bro.find_element_by_xpath('//span[@class="pager_next "]')

next.click() # 进入下一页,进行下载该页的数据

get_data() except : print('没有下一页了。。。。。') break # 关闭数据库

client.close() # 关闭浏览器 bro.quit()

代码

2. 你第一次输入的职位下载完会提醒你,你可以再次下载你所需要的其他职位的数据

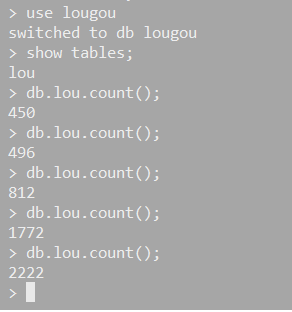

3. 数据保存在了 mongo中,此处没有做扩展,存文件或其他数据库

lagou数据爬取的更多相关文章

- 爬虫1.5-ajax数据爬取

目录 爬虫-ajax数据爬取 1. ajax数据 2. selenium+chromedriver知识准备 3. selenium+chromedriver实战拉勾网爬虫代码 爬虫-ajax数据爬取 ...

- python实现人人网用户数据爬取及简单分析

这是之前做的一个小项目.这几天刚好整理了一些相关资料,顺便就在这里做一个梳理啦~ 简单来说这个项目实现了,登录人人网并爬取用户数据.并对用户数据进行分析挖掘,终于效果例如以下:1.存储人人网用户数据( ...

- 芝麻HTTP:JavaScript加密逻辑分析与Python模拟执行实现数据爬取

本节来说明一下 JavaScript 加密逻辑分析并利用 Python 模拟执行 JavaScript 实现数据爬取的过程.在这里以中国空气质量在线监测分析平台为例来进行分析,主要分析其加密逻辑及破解 ...

- Python爬虫 股票数据爬取

前一篇提到了与股票数据相关的可能几种数据情况,本篇接着上篇,介绍一下多个网页的数据爬取.目标抓取平安银行(000001)从1989年~2017年的全部财务数据. 数据源分析 地址分析 http://m ...

- quotes 整站数据爬取存mongo

安装完成scrapy后爬取部分信息已经不能满足躁动的心了,那么试试http://quotes.toscrape.com/整站数据爬取 第一部分 项目创建 1.进入到存储项目的文件夹,执行指令 scra ...

- Ajax数据爬取

Ajax的基本原理 以菜鸟教程的代码为例: XMLHTTPRequest对象是JS对Ajax的底层实现: var xmlhttp; if (window.XMLHttpRequest) { // IE ...

- Python爬虫入门教程 15-100 石家庄政民互动数据爬取

石家庄政民互动数据爬取-写在前面 今天,咱抓取一个网站,这个网站呢,涉及的内容就是 网友留言和回复,特别简单,但是网站是gov的.网址为 http://www.sjz.gov.cn/col/14900 ...

- 基于 PHP 的数据爬取(QueryList)

基于PHP的数据爬取 官方网站站点 简单. 灵活.强大的PHP采集工具,让采集更简单一点. 简介: QueryList使用jQuery选择器来做采集,让你告别复杂的正则表达式:QueryList具有j ...

- Scrapy 框架 CrawlSpider 全站数据爬取

CrawlSpider 全站数据爬取 创建 crawlSpider 爬虫文件 scrapy genspider -t crawl chouti www.xxx.com import scrapy fr ...

随机推荐

- Robin Hood

Robin Hood 题目链接 题意 给你n个人和他们的钱数,然后给你k天,每天可以从最高钱数的人那边取一块钱给最少钱数的人,问最后钱数最多的人和钱数最少的人相差多少: 思路 二分最钱数,能下降到的位 ...

- 【Java例题】4.2 级数求和2

2. 计算级数之和: y=1/1!*x-1/3!*x^3+1/5!*x^5+...+ (-1)^n/(2n+1)!*x^(2n+1). 这里的"^"表示乘方,"!&quo ...

- 【算法】01-数据结构概述(注意区分jvm堆与堆/jvm栈与栈)

[算法]01-数据结构概述(注意区分jvm堆与堆/jvm栈与栈) 欢迎关注b站账号/公众号[六边形战士夏宁],一个要把各项指标拉满的男人.该文章已在github目录收录. 屏幕前的大帅比和大漂亮如果有 ...

- 编写Java程序,在硬盘中选取一个 txt 文件,读取该文档的内容后,追加一段文字“[ 来自新华社 ]”,保存到一个新的 txt 文件内

查看本章节 查看作业目录 需求说明: 在硬盘中选取一个 txt 文件,读取该文档的内容后,追加一段文字"[ 来自新华社 ]",保存到一个新的 txt 文件内 实现思路: 创建 Sa ...

- 使用.NET 6开发TodoList应用(16)——实现查询排序

系列导航及源代码 使用.NET 6开发TodoList应用文章索引 需求 关于查询的另一个需求是要根据前端请求的排序字段进行对结果相应的排序. 目标 实现根据排序要求返回排序后的结果 原理与思路 要实 ...

- Oracle数据库用法汇总

一些Oracle数据库用法的小总结 1.使用insert into创建新表 insert into destdb.sub_contract (userid,contractid) select msi ...

- .net core的配置介绍(一):IConfiguration

说到配置,绝大部分系统都会有配置,不需要配置的系统是非常少的,想想以前做.net 开发时,我们常常将配置放到web.config中,然后使用ConfigurationManager去读取. 初次接触到 ...

- [Docker] 制作并运行 Nginx 镜像

环境 操作系统(cat /etc/redhat-release):CentOS Linux release 7.6.1810 (Core) Docker:18.09.6 文件 Dockerfile F ...

- 第10组 Beta冲刺 (5/5)

1.1基本情况 ·队名:今晚不睡觉 ·组长博客:https://www.cnblogs.com/cpandbb/p/14018671.html ·作业博客:https://edu.cnblogs.co ...

- Linux上天之路(十)之Linux磁盘管理

主要内容 磁盘介绍 磁盘管理 磁盘限额 逻辑卷管理 磁盘阵列 1. 磁盘介绍 硬盘最基本的组成部分是由坚硬金属材料制成的涂以磁性介质的盘片,不同容量硬盘的盘片数不等.每个盘片有两面,都可记录信息.盘片 ...