[PGM] Markov Networks

6 Markov Networks 系列

因果影响的独立性

noisy-or模型 和 广义线性模型

略,暂时不感兴趣。

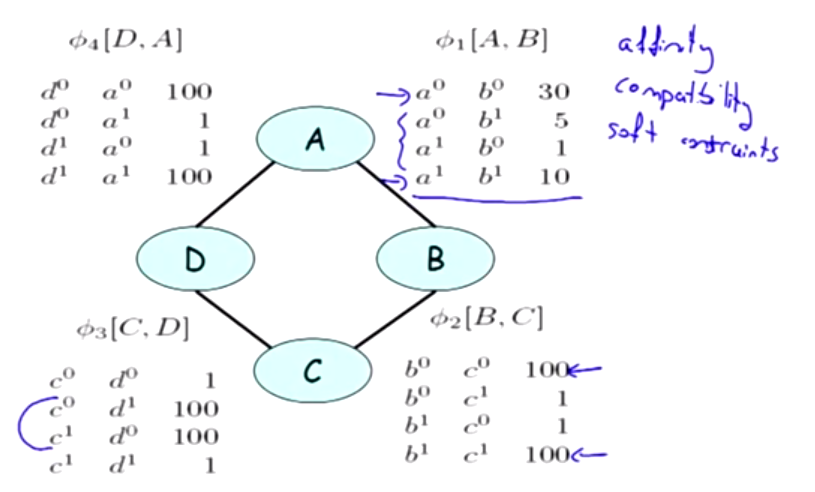

Pairwise Markov Networks

The last col is Happy value; [B,C]可见对课程的评价非常一致, they really agree with each other.

Markov Random Field 为何有归一化的问题,解释如下:

全连接网络,n个结点,每个结点有d种取值,那么parameter有多少个呢?

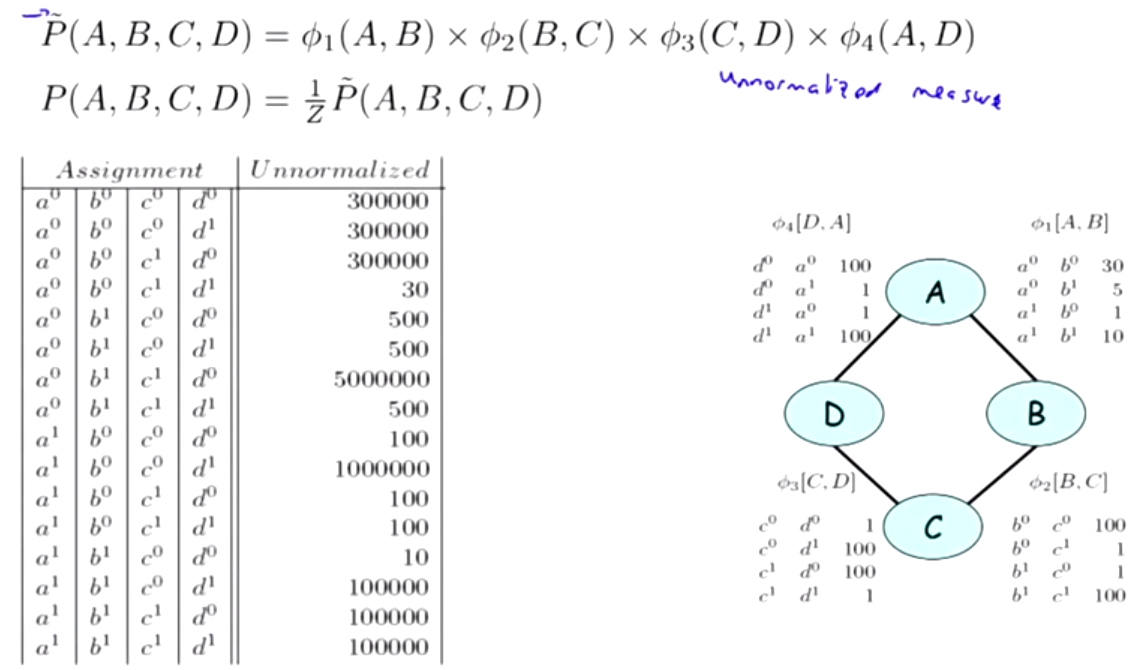

Gibbs distribution

6.Markov Network Fundamentals

- Pairwise 的 Markov Network各个相邻元素之间用Factor(Potential)来联系。

- factor并不与概率成正比,因为真正的联合概率要受到其他与之联系的元素所影响。

- Pairwise的network提供的信息远远无法表达整个网络里所有节点之间的概率关系。所以要引入Gibbs分布。

- Gibbs分布由一些Factor组成。

- Gibbs分布可以表达多个节点之间的联合概率(不只是pairwise的,可以是3个、4个一起)。Gibbs分布有能力表述整个网络里所有节点之间的概率关系。因为它至少可以用一个包含所有节点的Factor来表示。

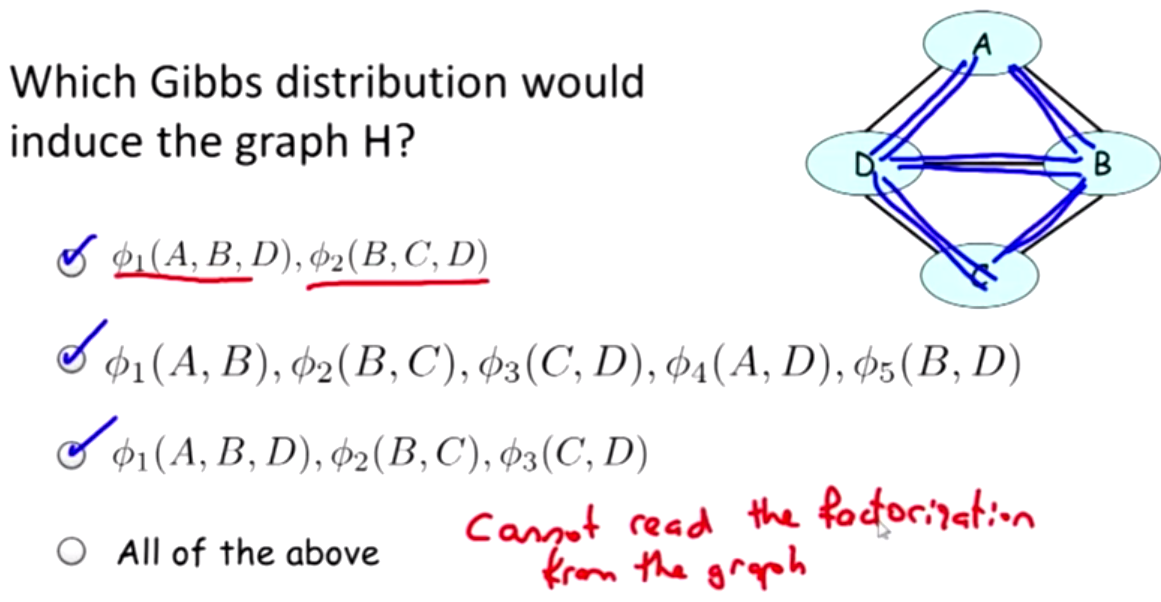

- Gibbs分布可以induce出Markov Network。

- Induced Markov Network,就是把Gibbs分布的Factor里的节点都连起来。

- 假设有一组Factor,做一下Factor product,然后归一化,求出所有元素的联合概率P。同时,这组Factor又可以induce出一个图H。那么P可以factorize over H。

- CRF是MRF的一种变形,非常相似,但用处不同。CRF用来解决Task specific prediction。其实就是labelling problem。(好像MRF也是干这个的啊?)

- CRF也是由一组Factor表示。看起来很像Gibbs分布的表示方式。但是它们的归一化方式不同,CRF把概率归一化成条件概率。

- BN使用联合概率表示,它假设X1....Xn导致Y,而且各个X之间是独立的。如果各X之间不独立,则会出现Correlated feature,使概率的判断失真。而CRF使用条件概率表示,这样不管各X之间是否独立,都不会影响最后概率的判断。

- CRF与logistics regression的关系。sigmoid函数也是一种CRF???

- Separation in MN.只要active trail中的一个节点已知了,这个trail就断了。

- 如果概率P factorizes over 图H,那么P也满足H表达出的independencies,所以H就是P的一个I-map。

- 反过来,independency也可以推出factorization。假设有一个正分布P,H是它的一个I-Map,则P factorizes over 图H。

6.5 I-maps and perfect maps

- P factorizes over G,则G是P的I-map。G表达了P中的某些independencies,但不一定是全部。

- 最小I-map是指除了P中表达的independencies没有多余的路径的map。

- Perfect map是指 I(G)= I(P),但是Perfect map不一定存在。

- 这里Koller举了两个例子说明Perfect map有时候不存在,但是没怎么听懂。I-map必须是有向图??P可以等效于无向图???

- I-map也不是唯一的,不同的I-map可以表示相同的independencies,它们是I-equivalent的。多数的图都有很多I-equivalence。

- BN和MN互相转换表示,会丢失independencies。

6.6 Log Linear Models

- 把factor前面加log,本来factor product要做乘法,现在变成做加法。

- Koller举了一个自然语言识别的例子,来说明我们可以用单词的feature来判断概率,而不是单词本身。

- Ising model的例子,有点像用MRF做图像分割。温度高的时候原子之间的联系弱,温度低时联系强。但没明白她举这个例子想说明啥。这跟Log linear model有啥关系?

- Metric MRFs。MRF可以提供局部平滑的假设,但首先我们要定义一个Metric,也就是定义MRF元素取值空间的距离函数。

- 后面就讲了一些如何利用MRF做图像分割和图像去噪。这部分比较熟了。

6.7 Shared Feature in Log-Linear Model

- 举了Ising model和NLP两个例子来说明有些条件(feature)是可以重复利用的。所以叫做Shared feature,这种feature对于所有的元素都适用。

- 还是不明白这根log-linear model有啥关系。

- 这部分讲的是关于技巧方面的内容,不太涉及理论。

- Knowledge engineering有多种选择:基于模板的(图像分割)还是特殊设计的(医学诊断)?用有向图还是无向图?通用的(适合无label的数据,可以应对未知的数据)还是专用的(需要直接编写条件概率,可以人工简化高维的数据)?

- Variable Types。网络中的变量有三类:目标变量,已观察到的变量,latent变量

- Structure。要不要在网络中表达出因果关系。因果关系可以简化网络,使它更加直观。

- Parameter:Value。手工建立网络时需要注意的问题。

- Parameter:Local structure。这里讨论了几种网络的形式,但是没有具体例子,不是很明白。

[PGM] Markov Networks的更多相关文章

- 本人AI知识体系导航 - AI menu

Relevant Readable Links Name Interesting topic Comment Edwin Chen 非参贝叶斯 徐亦达老板 Dirichlet Process 学习 ...

- [Scikit-learn] Dynamic Bayesian Network - Conditional Random Field

李航,第十一章,条件随机场 参考:[PGM] Markov Networks 携代码:用 Python 通过马尔可夫随机场(MRF)与 Ising Model 进行二值图降噪[推荐!] CRF:htt ...

- pgm13

这部分开始,我们将讨论 learning 相关的内容.PGM 为 frequentist 与 Bayesian 系的 model 提供了同一种语言,对前者来说 learning 就是确定一种对“未知但 ...

- CRF资料

与最大熵模型相似,条件随机场(Conditional random fields,CRFs)是一种机器学习模型,在自然语言处理的许多领域(如词性标注.中文分词.命名实体识别等)都有比较好的应用效果.条 ...

- 随机场(Random field)

一.随机场定义 http://zh.wikipedia.org/zh-cn/随机场 随机场(Random field)定义如下: 在概率论中, 由样本空间Ω = {0, 1, …, G − 1}n取样 ...

- ECCV 2014 Results (16 Jun, 2014) 结果已出

Accepted Papers Title Primary Subject Area ID 3D computer vision 93 UPnP: An optimal O(n) soluti ...

- MLN 讨论 —— inference

We consider two types of inference: finding the most likely state of the world consistent with some ...

- MLN 讨论 —— 基础知识

一. MLN相关知识的介绍 1. First-order logic A first-order logic knowledge base (KB) is a set of formulas in f ...

- 斯坦福CS课程列表

http://exploredegrees.stanford.edu/coursedescriptions/cs/ CS 101. Introduction to Computing Principl ...

随机推荐

- unity 对象旋转,自转

1.对象具体的围绕哪个轴旋转,对应的设置值: transform.Rotate(new Vector3(1,0,0)); //绕x轴旋转 //默认是物体围绕世界坐标的XYZ轴旋转,即物体绕着世 ...

- Linux 下建立 Git 与 GitHub 的连接

Git 是一款开源的分布式版本控制系统,而 GitHub 是依托 Git 的代码托管平台. GitHub 利用 Git 极其强大的克隆和分支功能,使得社区成员能够自由地参与到开源项目中去. 不过,在开 ...

- libreoffice.在Centos中使用时碰到X11 error的解决办法

先安装 libreoffice yum install libreoffice -y 尝试DOC转PDF是碰到报错 解决办法, 要安装多一个东西 yum install libreoffice-hea ...

- Oozie分布式工作流——EL表达式

oozie支持使用EL(expression language)表达式. 基本的EL常量 KB MB GB TB PB 基本EL函数 string firstNotNull(String value1 ...

- iptables为什么需要增加loopback回环的规则

先说loopback回环的大致个人理解: 1.lo的主要作用是基于本地访问本地的数据包会经过lo这张网卡. 2.比如ping 127.0.0.1时,你在eth0抓不到,只能在lo这张网卡捕获. 再来看 ...

- 针对UDP丢包问题,进行系统层面和程序层面调优

转自:https://blog.csdn.net/xingzheouc/article/details/49946191 1. UDP概念 用户数据报协议(英语:User Datagram Proto ...

- 【T06】记住TCP是一种流协议

1.TCP是一种流协议(stream protocol),这意味着数据是以字节流的形式发给接收者的,没有固定的报文和报文边界的概念. 接收端读取tcp数据,无法预知在这一次读操作中会返回多少个字节. ...

- WIN10平板如何打开文件夹选项

打开计算机,然后查看,最后可以找到选项

- 微软BI 之SSIS 系列 - Merge, Merge Join, Union All 合并组件的使用以及Sort 排序组件同步异步的问题

开篇介绍 SSIS Data Flow 中有几个组件可以实现不同数据源的数据合并功能,比如 Merger, Merge Join 和 Union All.它们的功能比较类似,同时也比较容易混淆,下面是 ...

- swagger搭建(基于springBoot)详解

前后端分离后,api接口文档的维护就成了一个让人头疼的问题,api接口更新慢,或因开发工作量大,没时间整理文档,导致前后端分离后前端同学和后端同 学都纠结于文档的问题.而swagger的出现,不亚于一 ...