大数据量情况下高效比较两个list

比如,对两个list<object>进行去重,合并操作时,一般的写法为两个for循环删掉一个list中重复的,然后再合并。

如果数据量在千条级别,这个速度还是比较快的。但如果数据量超过20W+(比如大批量的导入数据并对数据进行处理)时,则这块代码执行时间会比较长,非常影响用户体验和程序功能。这时我们可以用差集(Except)来处理重复数据。

下面MSDN上的代码示例演示了如何使用 Except<TSource>(IEnumerable<TSource>, IEnumerable<TSource>) 方法来比较两个数字序列,并返回仅在第一个序列中出现的元素。

double[] numbers1 = { 2.0, 2.1, 2.2, 2.3, 2.4, 2.5 };

double[] numbers2 = { 2.2 };

IEnumerable<double> onlyInFirstSet = numbers1.Except(numbers2);

foreach (double number in onlyInFirstSet)

outputBlock.Text += number + "\n";

/*

This code produces the following output:

2

2.1

2.3

2.4

2.5

*/

需要注意的是A.Except(B)与B.Except(A)结果是不一样的。

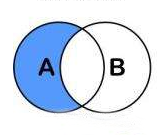

A.Except(B):

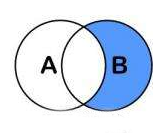

B.Except(A):

如果希望比较某种自定义数据类型对象的序列,则必须在您的类中实现 IEqualityComparer<T> 泛型接口。 下面的代码演示了如何在自定义数据类型中实现此接口并提供 GetHashCode 和 Equals 方法。

假设有需求是:在oldlist中过滤掉和list有相同ContractNo值的数据。

public class AssetPoolDataComparer : IEqualityComparer<AssetPoolData>

{

public bool Equals(AssetPoolData x, AssetPoolData y)

{

if (Object.ReferenceEquals(x, y)) return true;

//设置比较条件为两个ContractNo相同

return x != null && y != null && x.ContractNo.Equals(y.ContractNo);

} public int GetHashCode(AssetPoolData obj)

{

int hashContractNo = obj.ContractNo == null ? : obj.ContractNo.GetHashCode();

//主键ID

int hashProductID = obj.Id.GetHashCode(); return hashContractNo ^ hashProductID;

}

} var exceptList = oldlist.Except(list, new AssetPoolDataComparer()).ToList();

修改完代码,测试前后代码块运行时间,效果还是非常可观的。

ByQJL

大数据量情况下高效比较两个list的更多相关文章

- 大数据量情况下求top N的问题

上周五的时候去参加了一个面试,被问到了这个问题.问题描述如下: 假如存在一个很大的文件,文件中的每一行是一个字符串.请问在内存有限的情况下(内存无法加载这个文件中的所有内容),如何计算出出现频率最高的 ...

- phpExcel导入大数据量情况下内存溢出解决方案

PHPExcel版本:1.7.6+ 在不进行特殊设置的情况下,phpExcel将读取的单元格信息保存在内存中,我们可以通过 PHPExcel_Settings::setCacheStorageMeth ...

- phpExcel大数据量情况下内存溢出解决

版本:1.7.6+ 在不进行特殊设置的情况下,phpExcel将读取的单元格信息保存在内存中,我们可以通过 PHPExcel_Settings::setCacheStorageMethod() 来设置 ...

- C#拼接SQL语句,SQL Server 2005+,多行多列大数据量情况下,使用ROW_NUMBER实现的高效分页排序

/// <summary>/// 单表(视图)获取分页SQL语句/// </summary>/// <param name="tableName"&g ...

- MYSQL的大数据量情况下的分页查询优化

最近做的项目需要实现一个分页查询功能,自己先看了别人写的方法: <!-- 查询 --> <select id="queryMonitorFolder" param ...

- 大数据量冲击下Windows网卡异常分析定位

背景 mqtt的服务端ActiveMQ在windows上,多台PC机客户端不停地向MQ发送消息. 现象 观察MQ自己的日志data/activemq.log里显示,TCP链接皆异常断开.此时尝试从服务 ...

- 大数据量场景下storm自定义分组与Hbase预分区完美结合大幅度节省内存空间

前言:在系统中向hbase中插入数据时,常常通过设置region的预分区来防止大数据量插入的热点问题,提高数据插入的效率,同时可以减少当数据猛增时由于Region split带来的资源消耗.大量的预分 ...

- 由“大数据量Excel入库高效方式”瞥见“并联系统”之优势

使用场景: 当你有一个Excel文件,需要把其中的数据高速录入到数据库中,文件中包含10万条以上数据. 设计方案: 我们将整个过程分成三个阶段,A(装载Excel文件). ...

- java 导出Excel 大数据量,自己经验总结!

出处: http://lyjilu.iteye.com/ 分析导出实现代码,XLSX支持: /** * 生成<span style="white-space: normal; back ...

随机推荐

- yml 文件操作方法

文件读取方法示例: import yaml fr = open('yml_file_address', 'r',encoding='utf-8') data = yaml.load(fr) print ...

- Dubbo广播模式下报错:Can't assign requested address解决办法

原因: 尝试使用Dubbo的multicast模式,发现一运行就报Can't assign requested address的错误,造成这种原因的主要是系统中开启了IPV6协议(比如window7) ...

- MySQL的BlackHole引擎在主从架构中的作用

MySQL在5.x系列提供了Blackhole引擎–“黑洞”. 其作用正如其名字一样:任何写入到此引擎的数据均会被丢弃掉, 不做实际存储:Select语句的内容永远是空. 和Linux中的 /dev/ ...

- Hive分区表动态添加字段

场景描述: 公司埋点项目,数据从接口服务写入kafka集群,再从kafka集群消费写入HDFS文件系统,最后通过Hive进行查询输出.这其中存在一个问题就是:埋点接口中的数据字段是变化,后续会有少量字 ...

- hdu1061(2015-N1):1.快速幂;2.找规律

1.快速幂 原理:求a的b次方,将b转化为二进制数,该二进制位第i位的权是2^(i-1), 例如 11的二进制是1011 11 = 2³×1 + 2²×0 + 2¹×1 + 2º×1 因此,我们将a¹ ...

- POJ - 1797 Heavy Transportation 单源最短路

思路:d(i)表示到达节点i的最大能运输的重量,转移方程d(i) = min(d(u), limit(u, i));注意优先队列应该以重量降序排序来重载小于符号. AC代码 #include < ...

- CodeForces-731A

每次找到最短距离,然后更新指针的位置. AC代码: #include<cstdio> #include<cmath> const int maxn=100+5; char s[ ...

- FusionCharts MSBar3D图

1.静态页面 <!DOCTYPE HTML PUBLIC "-//W3C//DTD HTML 4.01 Transitional//EN"> <html> ...

- MP4文件格式的解析

MP4文件格式的解析,以及MP4文件的分割算法 mp4应该算是一种比较复杂的媒体格式了,起源于QuickTime.以前研究的时候就花了一番的功夫,尤其是如何把它完美的融入到视频点播应用中,更是费尽了心 ...

- LAMP应用部署

LAMP+wordpress 部署博客 软件安装 yum -y install httpd yum -y install php yum -y install php-mysql yum -y ins ...