S1_搭建分布式OpenStack集群_01 准备虚拟机

Openstack版本:openstack-queen 版本

一、环境准备

网络规划:

Management + API Network:10.10.11.0/24 eth1 网桥:br1

VM (Tenant Network: 10.10.12.0/24 eth2 网桥:br2

External Network: 10.10.10.0/24 eth0 网桥vbr

集群环境:Centos7.4 x86_64

Controller: 2C + 8G + 50G eth0 eth1 eth2

Compute1:2C + 8G + 50G eth0 eth1

Neutron: 2C + 8G + 50G eth0 eth1

Cinder: 2C + 8G + 50G eth0 eth1

附加节点 为集群提供本地yum源

Yum节点: 2C + 8G + 50G eth0 网桥:br1 IP:10.10.11.200

二、搭建网桥

2.1 创建网桥文件

创建网桥文件:vbr.xml

networks]# cd /etc/libvirt/qemu/networks/

networks]# cat vbr.xml

<network>

<name>vbr</name>

<forward mode='nat'/>

<bridge name='vbr' stp='on' delay='0'/>

<ip address='10.10.10.1' netmask='255.255.255.0'>

<dhcp>

<range start='10.10.10.10' end='10.10.10.254'/>

</dhcp>

</ip>

</network>

创建网桥文件:br1.xml

networks]# cat br1.xml

<network>

<name>br1</name>

<bridge name='br1' stp='on' delay='0'/>

<ip address='10.10.11.1' netmask='255.255.255.0'>

<dhcp>

<range start='10.10.11.10' end='10.10.11.254'/>

</dhcp>

</ip>

创建网桥文件:br2.xml

networks]# cat br2.xml

<network>

<name>br2</name>

<uuid>f06b24c9-963b-4239-a75a-25d4814df099</uuid>

<ip address='10.10.12.1' netmask='255.255.255.0'>

<dhcp>

<range start='10.10.12.10' end='10.10.12.254'/>

</dhcp>

</ip>

</network>

2.2 启用网桥

定义:

networks]# for i in `ls *.xml`

> do

> virsh net-define $i

> done

Network br1 defined from br1.xml

Network br2 defined from br2.xml

Network vbr defined from vbr.xml

启动:

networks]# for i in vbr br1 br2

> do

> virsh net-start $i

> done

开机自启:

networks]# for i in vbr br1 br2

> do

> virsh net-autostart $i

> done

Network vbr marked as autostarted

Network br1 marked as autostarted

Network br2 marked as autostarted

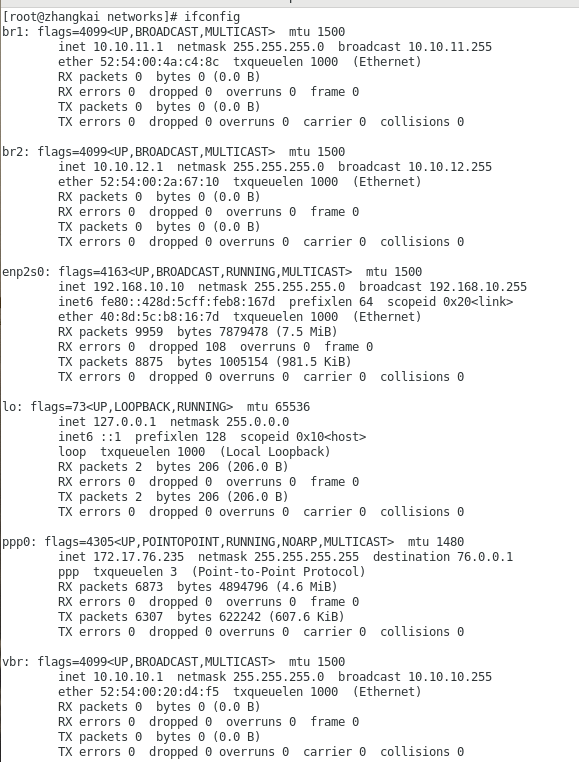

ifconfig 可见:

三、创建4台虚拟机

3.1 准备 镜像模板 + 虚拟机定义文件

提前准备好:node.qcow2 和node.xml 并作对应修改,否则无法使用:

node.xml关键信息:

qemu]# cd /etc/libvirt/qemu/

qemu]# cat node.xml | grep "<name>"

<name>node</name>

qemu]# cat node.xml | grep "<memory"

<memory unit='KiB'>8848000</memory>

qemu]# cat node.xml | grep "<currentMemory"

<currentMemory unit='KiB'>8848000</currentMemory>

qemu]# cat node.xml | grep "<source file"

<source file='/var/lib/libvirt/images/node.img'/>

3.2 创建脚本 build.sh

sh]# ls

build.sh

sh]# cat build.sh

#!/bin/bash

read -p "How many VMs do you want:" Num

for((i=1;i<=$Num;i++));

do

read -p "Name:" name

cd /var/lib/libvirt/images

qemu-img create -f qcow2 -b node.qcow2 $name.img 50G

cd /etc/libvirt/qemu

sed "s,node,$name," node.xml > $name.xml

virsh define $name.xml

done

3.3 创建虚拟机

sh]# bash build.sh

How many dou you want:4

Name:controller

Formatting 'controller.img', fmt=qcow2 size=53687091200 backing_file='node.qcow2' encryption=off cluster_size=65536 lazy_refcounts=off

Domain controller defined from controller.xml

Name:compute1

Formatting 'compute1.img', fmt=qcow2 size=53687091200 backing_file='node.qcow2' encryption=off cluster_size=65536 lazy_refcounts=off

Domain compute1 defined from compute1.xml

Name:neutron

Formatting 'neutron.img', fmt=qcow2 size=53687091200 backing_file='node.qcow2' encryption=off cluster_size=65536 lazy_refcounts=off

Domain neutron defined from neutron.xml

Name:cinder

Formatting 'cinder.img', fmt=qcow2 size=53687091200 backing_file='node.qcow2' encryption=off cluster_size=65536 lazy_refcounts=off

Domain cinder defined from cinder.xml

sh]# virsh list --all

Id Name State

----------------------------------------------------

1 yum running

- cinder shut off

- compute1 shut off

- controller shut off

- neutron shut off

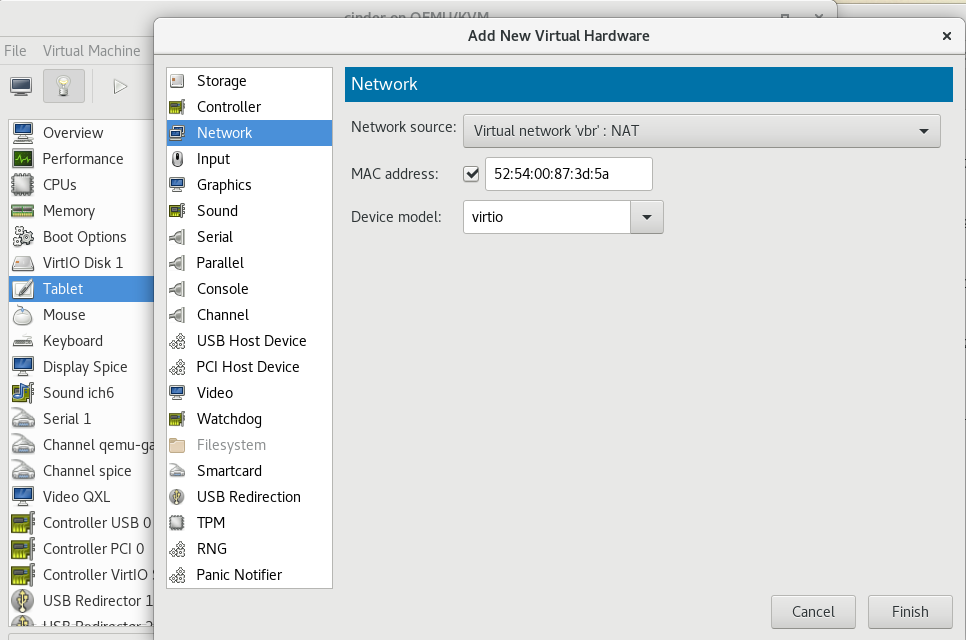

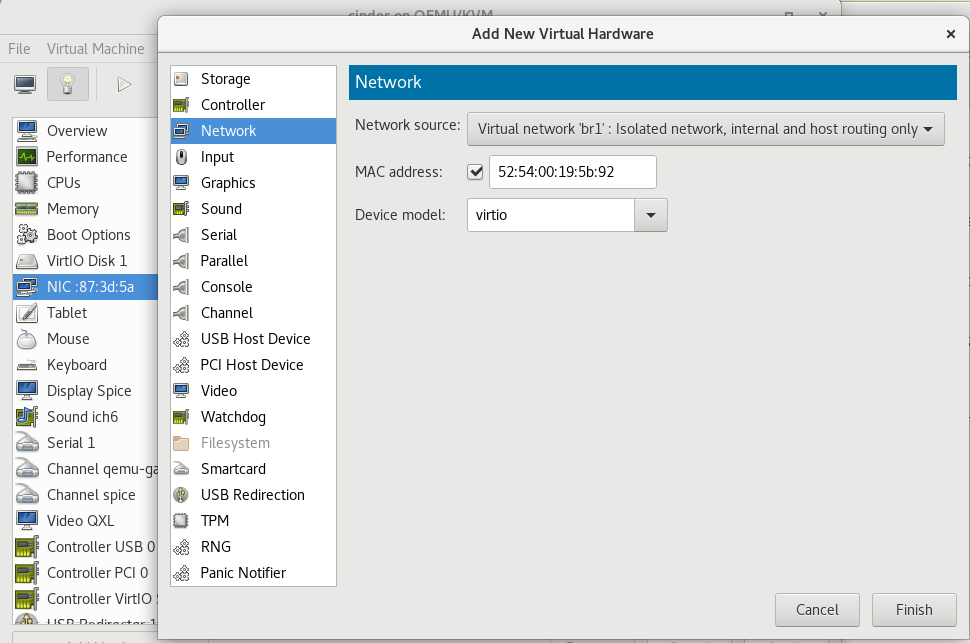

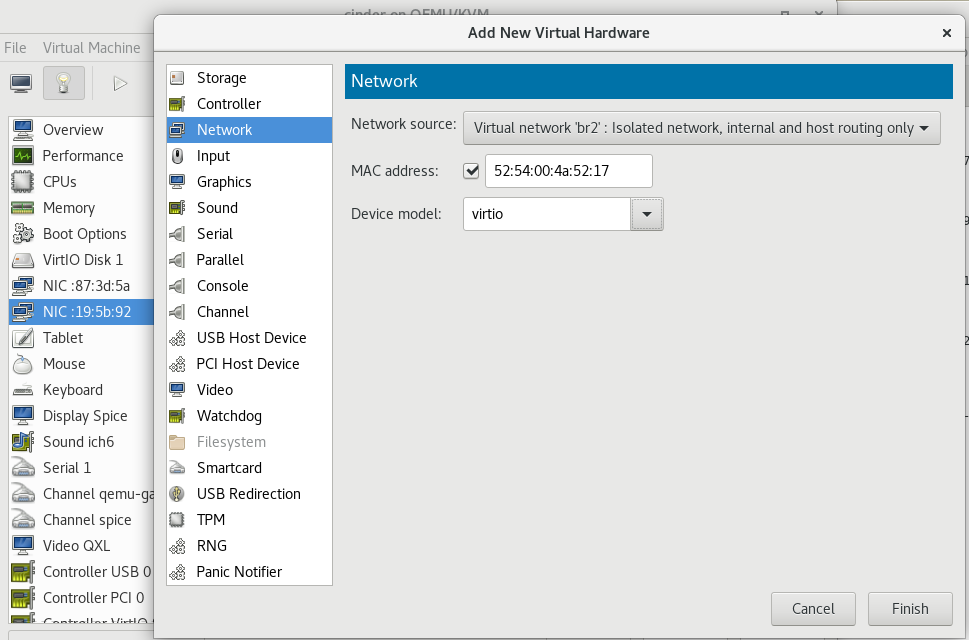

3.4 根据配置分别给虚拟机添加网卡

打开virt-manager,这里只演示给controller添加网卡:

添加vbr:

添加br1:

添加br2:

其他主机一样,不需要添加vbr,只需要添加br1和br2。

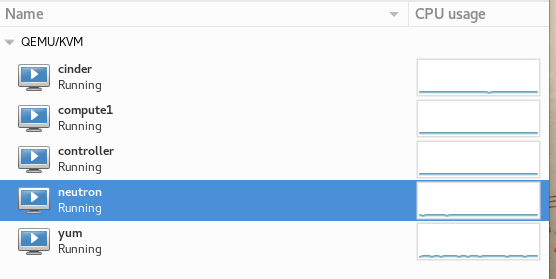

启动虚拟机:

]# for i in controller compute1 neutron cinder

> do

> virsh start $i

> done

S1_搭建分布式OpenStack集群_01 准备虚拟机的更多相关文章

- S1_搭建分布式OpenStack集群_03 Mysql、MQ、Memcached、ETCD安装配置

一.安装mysql(contorller)controller ~]# yum -y install mariadb mariadb-server python2-PyMySQL 配置my.cnf文件 ...

- S1_搭建分布式OpenStack集群_02 虚拟机环境配置

一.配置主机名及hosts和防火墙(只演示一台,其他机器配置方式一样)vim /etc/hosts 加入 10.10.11.11 controller10.10.11.12 compute11 ...

- S1_搭建分布式OpenStack集群_11 虚拟机创建

一.创建网络环境环境变量生效一下创建一个网络:# openstack network create --share --external \--provider-physical-network ph ...

- S1_搭建分布式OpenStack集群_10 cinder 存储节点配置

一.安装配置lvm2安装LVM包:# yum install -y lvm2 启动LVM元数据服务,并将其配置为在系统启动时启动:# systemctl enable lvm2-lvmetad.ser ...

- S1_搭建分布式OpenStack集群_09 cinder 控制节点配置

一.创建数据库创建数据库以及用户:# mysql -uroot -p12345678MariaDB [(none)]> CREATE DATABASE cinder;MariaDB [(none ...

- S1_搭建分布式OpenStack集群_08 网络服务(neutron)安装部署

一.数据库配置(控制节点)创建数据库以及用户:# mysql -uroot -p12345678MariaDB [(none)]> CREATE DATABASE neutron;MariaDB ...

- S1_搭建分布式OpenStack集群_07 nova服务配置 (计算节点)

一.服务安装(计算节点)安装软件:# yum install openstack-nova-compute -y 编辑/etc/nova/nova.conf文件并设置如下内容:# vim /etc/n ...

- S1_搭建分布式OpenStack集群_06 nova服务配置 (控制节点)

一.创建数据库(控制节点)创建数据库以及用户:# mysql -uroot -p12345678MariaDB [(none)]> CREATE DATABASE nova_api;MariaD ...

- S1_搭建分布式OpenStack集群_05 glance安装配置

一.基本简介 镜像服务(glance)使用户能够发现,注册和检索虚拟机镜像. 它提供了一个REST API,使您可以查询虚拟机镜像元数据并检索实际镜像. 您可以将通过镜像服务提供的虚拟 ...

随机推荐

- SpringBoot 多数据库支持:

SpringBoot 多数据库支持: springboot2.0+mybatis多数据源集成 https://www.cnblogs.com/cdblogs/p/9275883.html Spring ...

- 传统IDC 部署网站

选择IDC机房 1.选择云主机. 2.传统IDC a购买服务器 b服务器托管 c装系统 装系统 虚拟机软件 vmware workstation virtualbox hyper-v 下载:r.ami ...

- AIR面向IOS设备的原生扩展

来源:http://www.cnblogs.com/alex-tech/archive/2012/03/22/2411264.html ANE组成部分 在IOS平台中,ANE的组成部分基本分为AS 3 ...

- 安装node.js->npm->vue

我们研究vue时,首先操作的就是vue的引用,大部分人为了方便直接在页面上引用vue.js,但是一些大型网站还是比较喜欢用vue的npm命令来安装vue并使用,之前研究vue时,研究过使用npm安装的 ...

- urlib库

urllib库是python中最基本的网络请求库,可以模拟浏览器的行为,向指定的服务器发送请求,并可以保存服务器返回的数据. urlopen() urllib.request模块提供了最基本的构造ht ...

- Android笔记(六十三) android中的动画——逐帧动画( frame-by-frame animation)

就好像演电影一样,播放实现准备好的图片,来实现动画效果. 逐帧动画需要用到AnimationDrawable类,该类主要用于创建一个逐帧动画,然后我们把这个动画设置为view的背景即可. androi ...

- ansible之基础篇(三)

setup ansible_all_ipv4_addresses # ipv4的所有地址 ansible_all_ipv6_addresses # ipv6的所有地址 ansible_date_tim ...

- centos7 编译安装redis

1.下载redis源码包 cd /opt wget http://download.redis.io/releases/redis-4.0.12.tar.gz 2.解压源码包 tar zxf redi ...

- CPNtools 模拟工具适合分析什么样的协议

最近梳理和CPNtools和Scyther之间的性能和差别.方便后面整理使用 1.库所的托肯值是什么? 托肯值也叫作令牌, 即网络系统中的资源,托肯的数目值代表了网络赋予的资源大小.在一个活的网络系统 ...

- 使用maven导入module时,报java.security.InvalidAlgorithmParameterException: the trustAnchors parameter must be non-empty

在新装IDEA导入Flink源码时出现一些问题,在此记录,希望能帮到大伙! 一.环境 IDEA2019.1.2(破解版):OpenJDK 1.8.0_40:Maven 3.5.3/3.2.5/3.6. ...