重新认识mapreduce

写这篇文章,是因为最近遇到了mapreduce的二次排序问题。以前的理解不完全正确。首先看一下mapreduce的过程

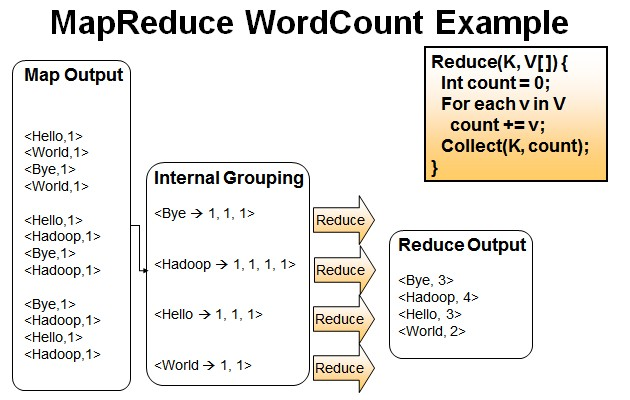

相信这张图熟悉MR的人都应该见过,再来一张图

wordcount也不细说了,hadoop里面的hello,world

之前我的理解是map过来的<k,v>会形成(k,<v1,v2,v3...>)的格式,并且按照这种思路写出来不少的mapreduce程序,而且没有错。

后来自定义Writable对象,封装一组值作为key,也没有什么问题,而且一直认为key只要在compareTo中重写 了方法就万事大吉,而且compareTo返回0的会作为相同的key。误区就在这里,之前一直认为key相同的value会合并到一个"list"中-。这句话就有错,key是key,value是value,根本不会将key对应的value合并在一起,真实情况是默认将key相同(compareTo返回0的)的合并成了一组,在组相同的里面去foreach里面的value,如果是自定义key的话你可以将key打印一下,或发现key并不相同。

上代码:

public class Entry implements WritableComparable<Entry> {

private String yearMonth;

private int count;

public Entry() {

}

@Override

public int compareTo(Entry entry) {

int result = this.yearMonth.compareTo(entry.getYearMonth());

if (result == 0) {

result = Integer.compare(count, entry.getCount());

}

return result;

}

@Override

public void write(DataOutput dataOutput) throws IOException {

dataOutput.writeUTF(yearMonth);

dataOutput.writeInt(count);

}

@Override

public void readFields(DataInput dataInput) throws IOException {

this.yearMonth = dataInput.readUTF();

this.count = dataInput.readInt();

}

public String getYearMonth() {

return yearMonth;

}

public void setYearMonth(String yearMonth) {

this.yearMonth = yearMonth;

}

public int getCount() {

return count;

}

public void setCount(int count) {

this.count = count;

}

@Override

public String toString() {

return yearMonth;

}

}

自定义分区 EntryPartitioner.java

public class EntryPartitioner extends Partitioner<Entry, Text> {

@Override

public int getPartition(Entry entry, Text paramVALUE, int numberPartitions) {

return Math.abs((entry.getYearMonth().hashCode() % numberPartitions));

}

}

自定义分组

public class EntryGroupingComparator extends WritableComparator {

public EntryGroupingComparator() {

super(Entry.class, true);

}

@Override

public int compare(WritableComparable a, WritableComparable b) {

Entry a1 = (Entry) a;

Entry b1 = (Entry) b;

return a1.getYearMonth().compareTo(b1.getYearMonth());

}

}

mapper类

public class SecondarySortMapper extends

Mapper<LongWritable, Text, Entry, Text> { private Entry entry = new Entry();

private Text value = new Text(); @Override

protected void map(LongWritable key, Text lines, Context context)

throws IOException, InterruptedException {

String line = lines.toString();

String[] tokens = line.split(",");

String yearMonth = tokens[0] + "-" + tokens[1];

int count = Integer.parseInt(tokens[2]); entry.setYearMonth(yearMonth);

entry.setCount(count);

value.set(tokens[2]);

context.write(entry, value); }

}

reducer类

public class SecondarySortReducer extends Reducer<Entry, Text, Entry, Text> {

@Override

protected void reduce(Entry key, Iterable<Text> values, Context context)

throws IOException, InterruptedException {

System.out.println("-----------------华丽的分割线-----------------");

StringBuilder builder = new StringBuilder();

for (Text value : values) {

System.out.println(key+"==>"+value);

builder.append(value.toString());

builder.append(",");

}

context.write(key, new Text(builder.toString()));

}

}

reducer中打印出来的跟原来想的不一样,一组的值除了自定义分组的属性相同外,其他的属性有不同的。看来以前是自己理解不够深入啊,特此写出,以示警戒

重新认识mapreduce的更多相关文章

- Mapreduce的文件和hbase共同输入

Mapreduce的文件和hbase共同输入 package duogemap; import java.io.IOException; import org.apache.hadoop.co ...

- mapreduce多文件输出的两方法

mapreduce多文件输出的两方法 package duogemap; import java.io.IOException; import org.apache.hadoop.conf ...

- mapreduce中一个map多个输入路径

package duogemap; import java.io.IOException; import java.util.ArrayList; import java.util.List; imp ...

- Hadoop 中利用 mapreduce 读写 mysql 数据

Hadoop 中利用 mapreduce 读写 mysql 数据 有时候我们在项目中会遇到输入结果集很大,但是输出结果很小,比如一些 pv.uv 数据,然后为了实时查询的需求,或者一些 OLAP ...

- [Hadoop in Action] 第5章 高阶MapReduce

链接多个MapReduce作业 执行多个数据集的联结 生成Bloom filter 1.链接MapReduce作业 [顺序链接MapReduce作业] mapreduce-1 | mapr ...

- MapReduce

2016-12-21 16:53:49 mapred-default.xml mapreduce.input.fileinputformat.split.minsize 0 The minimum ...

- 使用mapreduce计算环比的实例

最近做了一个小的mapreduce程序,主要目的是计算环比值最高的前5名,本来打算使用spark计算,可是本人目前spark还只是简单看了下,因此就先改用mapreduce计算了,今天和大家分享下这个 ...

- MapReduce剖析笔记之八: Map输出数据的处理类MapOutputBuffer分析

在上一节我们分析了Child子进程启动,处理Map.Reduce任务的主要过程,但对于一些细节没有分析,这一节主要对MapOutputBuffer这个关键类进行分析. MapOutputBuffer顾 ...

- MapReduce剖析笔记之七:Child子进程处理Map和Reduce任务的主要流程

在上一节我们分析了TaskTracker如何对JobTracker分配过来的任务进行初始化,并创建各类JVM启动所需的信息,最终创建JVM的整个过程,本节我们继续来看,JVM启动后,执行的是Child ...

- MapReduce剖析笔记之六:TaskTracker初始化任务并启动JVM过程

在上面一节我们分析了JobTracker调用JobQueueTaskScheduler进行任务分配,JobQueueTaskScheduler又调用JobInProgress按照一定顺序查找任务的流程 ...

随机推荐

- Tsung测试Tigase

用两台主机坐Tigase的Tsung测试,其中1台运行Tigase,另1台运行Tsung. 1.Tigase服务器设置 tigase.conf: #osgiEnabled=(true|false) # ...

- 算法:欧几里得求最大公约数(python版)

#欧几里得求最大公约数 #!/usr/bin/env python #coding -*- utf:8 -*- #iteration def gcd(a,b): if b==0: return a e ...

- Java中使用Jedis操作Redis

使用Java操作Redis需要jedis-2.1.0.jar,下载地址:http://files.cnblogs.com/liuling/jedis-2.1.0.jar.zip 如果需要使用Redis ...

- windows / linux系统中,端口被占用解决方法

一.在windows操作系统中,查询端口占用和清除端口占用的程序 提升权限后用:netstat -b或用 1.查询端口占用的进程ID 点击"开始"-->"运行&qu ...

- Lisp学习--Windows下面的开发环境搭建

很久以前,就准备学习Lisp,但是遇到不少困难,社区太凌乱,也一直很犹豫,直到看了<Common Lisp - 想说爱你不容易>,想看看Common Lisp怎么样,之前都是拿Lisp的方 ...

- java内存模型-总结

处理器内存模型 顺序一致性内存模型是一个理论参考模型,JMM 和处理器内存模型在设计时通常会把顺序一致性内存模型作为参照.JMM 和处理器内存模型在设计时会对顺序一致性模型做一些放松,因为如果完全按照 ...

- Spring4学习笔记 - SpEL表达式

- VS2010添加类失败问题,弹出错误框,提示 CodeModel操作失败,无法访问标记数据库

我在使用VS2010添加类的时候,会弹出一个错误框,提示 CodeModel操作失败,可以无法访问标记数据库 英文版是 CodeModel operation failed,Possibly cann ...

- a标签的href值

<a href='#'>click</a>实验证明,页面上能不用这个值就最好不要用这个#,这个#会让你的页面瞬间滚动到页面的顶部,我不知道已经踩了多少次坑了,就是因为这个'#' ...

- jQuery cxScroll 间歇式无缝滚动

版本: jQuery v1.7+ jQuery cxScroll v1.2.2 注意事项: 内部会自动创建 prev 及 next 切换按钮,也可以在外部直接创建,若外部已创建或设置prevBtn: ...