webcollector 2.x 爬取搜狗搜索结果页

/**

* 使用搜狗搜索检索关键字并爬取结果集的标题

* @author tele

*

*/

public class SougouCrawler extends RamCrawler{ public SougouCrawler() { } public SougouCrawler(String keyword,int maxnum) {

for(int i=1;i<=maxnum;i++) {

//拼接url

String url ="https://www.sogou.com/web?query="+keyword+"&s_from=result_up&cid=&page="+ i +"&ie=utf8&p=40040100&dp=1&w=01029901&dr=1";

CrawlDatum crawlDatum = new CrawlDatum(url).meta("pageNum",i);

addSeed(crawlDatum);

addRegex(".*");

}

} @Override

public void visit(Page page, CrawlDatums next) {

String pageNum = page.meta("pageNum");

Elements results = page.doc().select("div.results div[^class] h3 a");

for(int i=0;i<results.size();i++) {

System.out.println("第"+ pageNum +"页第"+ (i+1) +"条结果------" + results.get(i).text());

}

} public static void main(String[] args) throws Exception {

String keyword="淘宝";

SougouCrawler crawler = new SougouCrawler(keyword,3);

crawler.setThreads(8); Configuration conf = Configuration.copyDefault();

conf.setExecuteInterval(3000);

conf.setReadTimeout(5000);

conf.setWaitThreadEndTime(3000); crawler.setConf(conf);

crawler.start(1);//只有一层

}

}

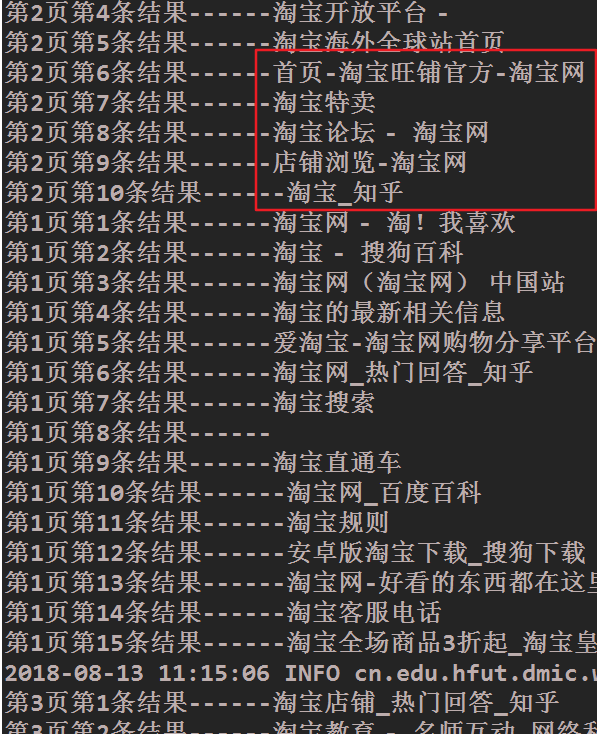

输出截图(部分)

验证第二页数据标题

webcollector 2.x 爬取搜狗搜索结果页的更多相关文章

- 第三百三十节,web爬虫讲解2—urllib库爬虫—实战爬取搜狗微信公众号—抓包软件安装Fiddler4讲解

第三百三十节,web爬虫讲解2—urllib库爬虫—实战爬取搜狗微信公众号—抓包软件安装Fiddler4讲解 封装模块 #!/usr/bin/env python # -*- coding: utf- ...

- 九 web爬虫讲解2—urllib库爬虫—实战爬取搜狗微信公众号—抓包软件安装Fiddler4讲解

封装模块 #!/usr/bin/env python # -*- coding: utf-8 -*- import urllib from urllib import request import j ...

- requests利用selenium,代理Ip,云打码,验证码抠图操作 爬取搜狗微信公众号内容

爬取思路,爬取搜狗微信公众号内容,爬取第一层url时请求太快出现验证码,我这里用的蘑菇云代理,并在程序中我判断什么情况下是否+代理,做到合理运用代理ip.爬取第二层url时验证码出现次数更严重(和第一 ...

- 用scrapy爬取搜狗Lofter图片

用scrapy爬取搜狗Lofter图片 # -*- coding: utf-8 -*- import json import scrapy from scrapy.http import Reques ...

- 用WebCollector制作一个爬取《知乎》并进行问题精准抽取的爬虫(JAVA)

简单介绍: WebCollector是一个无须配置.便于二次开发的JAVA爬虫框架(内核),它提供精简的的API.仅仅需少量代码就可以实现一个功能强大的爬虫. 怎样将WebCollector导入项目请 ...

- python3 爬取搜狗微信的文章

目标地址:http://weixin.sogou.com/weixin? 这个地址是搜狗微信的文章搜索,可以搜索到微信的文章,而我们目标就是这些文章内容 这个url经过测试,当我们没登陆微信只能看到1 ...

- scrapy实战7爬取搜狗微信:

爬取微信热门文章标题,内容,内容地址,微信公众号,公众号地址,发布日期等 如图 源码地址:https://github.com/huwei86/sougouweixin

- 使用php的curl根据关键词爬取百度搜索结果页

http://bbs.csdn.net/wap/topics/390938327 正则表达式匹配Html标签 查找所有的TD区域(最短):<td\s*.*>\s*.*<\/td& ...

- Python爬虫 爬取搜狗搜索到的内容页面

废话不多说,直接上代码 import requests def main(): url='https://www.sogou.com/web' headers={ 'User_Agent':'Mozi ...

随机推荐

- [D3] Creating a D3 Force Layout in React

Learn how to leverage d3's layout module to create a Force Layout inside of React. We'll take a look ...

- [D3] Debug D3 v4 with Dev Tools

Since D3 outputs standard markup, you can use familiar dev tools and inspectors to debug your visual ...

- Codeforces #144 (Div. 1) B. Table (组合数学+dp)

题目链接: B.Table 题意: \(n*m\)的矩阵使每个\(n*n\)矩阵里面准确包含\(k\)个点,问你有多少种放法. \((1 ≤ n ≤ 100; n ≤ m ≤ 10^{18}; 0 ≤ ...

- Fragment Summary 2/2

出处:http://blog.csdn.net/lmj623565791/article/details/37992017 上篇博客中已经介绍了Fragment产生原因,以及一些基本的用法和各种API ...

- Hamming correct

从数的最左边开始,并标记为1 将2的平方的位置留出来,做为校验位例如,8位2进制数10011010===>_ _ 1 _ 0 0 1 _ 1 0 1 0 位置1用来校验最右边的位位1的位置1 3 ...

- GridView与ArrayAdapter的结合

activity_main.xml: <RelativeLayout xmlns:android="http://schemas.android.com/apk/res/android ...

- orabbix自定义监控oracle

前提:安装orabbix 好后能正常运行, 检验条件(1). 最新数据有数据 (2).图形有显示 (3).日志不报错 /opt/orabbix/logs/orabbix.log 添加方法: 1. ...

- 高效的敏感词过滤方法(PHP)

方法一: ? 1 2 3 4 5 6 7 $badword = array( '张三','张三丰','张三丰田' ); $badword1 = array_combine($badwor ...

- UICollectionView使用方法补充(照片轮播墙)

一 整体功能图和实现思路 1 完整的功能图: 2 实现功思路: 1> 流水布局(实现UICollectionView必需要的条件) 2> 自己定义cell(实现UICollectionVi ...

- 【SPOJ QTREE】树链剖分模板

用线段树求解,这里注意因为求的是路径最大值,注意一下细节. #include<cstdio> #include<cstring> #include<algorithm&g ...