在线学习和在线凸优化(online learning and online convex optimization)—凸化方法4

一些在线预测问题可以转化到在线凸优化框架中。下面介绍两种凸化技术:

一些在线预测问题似乎不适合在线凸优化框架。例如,在线分类问题中,预测域(predictions domain)或损失函数不是凸的。我们描述了两种凸化技术,它们允许我们在其他场景中使用在线凸优化框架。

1.Convexification by Randomization

为了演示randomization技术,我们考虑一个专家建议的预测问题:每个在线回合中,学习者必须从d位给定专家的建议中进行选择。

表示选到的专家,然后学习机收到一个向量

,其中

表示听从第

个专家的建议所遭受的损失,学习机需要支付的损失为

。在这种情况下,decision space是离散的,因此非凸。

有限假设类(finite hypothesis class)的在线分类问题可以很容易地作为具有专家建议问题的预测的特例。 因此,Cover’s impossibility result意味着没有算法可以通过专家建议问题获得预测的low Regret。

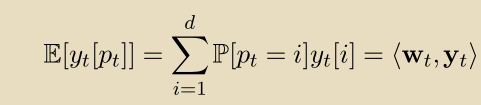

然而,正如我们在下面所示,通过允许学习者随机化他的预测,我们可以将问题转化为在线凸优化框架,因此可以获得针对该问题的low Regret算法。令是probability simplex,S是一个凸集。

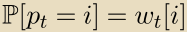

在第 t回合,学习者选择 ,并且基于

,并且基于 根据

根据 随机抽取一个专家,学习机支付期望损失:

随机抽取一个专家,学习机支付期望损失:

现在,我们将问题转化成了在线凸优化。

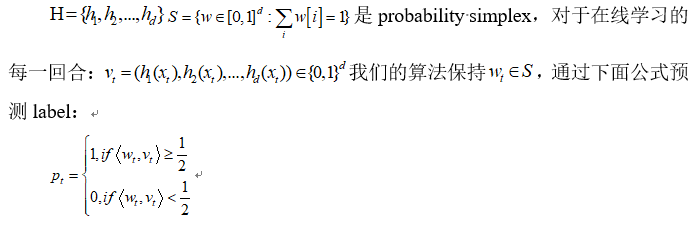

2.Convexification by Surrogate Loss Functions

为了解释第二种凸化技术,我们再次从有限假设类的在线分类具体问题开始。 回想一下,我们用来回避 Cover’s impossibility result的技术之一依赖于可实现性假设(realizability assumption)。我们假设存在使得对于所有的t有

。有了这个假设,我们描述了Halving算法并且表明它最多

个预测错误。我们现在使用在线凸优化语言得出类似的保证:

S是一个凸集,对于所有t是一个凸函数,我们转化得到一个在线凸优化问题。

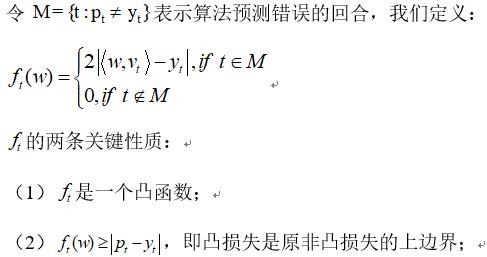

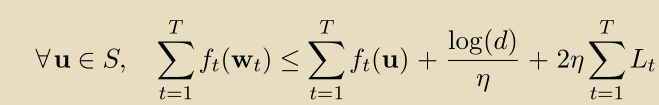

接下来的部分中,我们将推导出在线凸优化问题的算法。 特别是,这些算法之一具有如下的regret bound:

其中,是一个参数,在这里设置为1/4,

是函数

关于L1范数的Lipschitz参数。在我们的案例中,

,因此:

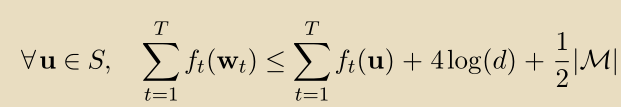

通过的 surrogate property,我们获得:

这种类型的界限,其中错误的数量受到 competing hypothesis的convex surrogate loss的上限,通常被称为relative loss bound。

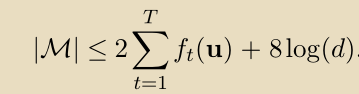

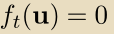

在realizable的情况下,我们可以进一步简化 relative loss bound如下。 由于bound适用于所有u∈S,因此它特别适用于向量u=(0,...,0,1,0,...,0),其中1位于对应于 true hypothesis 的位置。

通过我们的构造,对于所有t, ,产生:

,产生:

未完,待续。。。。。。

下一节分析FTL算法

在线学习和在线凸优化(online learning and online convex optimization)—凸化方法4的更多相关文章

- 在线学习和在线凸优化(online learning and online convex optimization)—FTL算法5

最自然的学习规则是使用任何在过去回合中损失最小的向量. 这与Consistent算法的精神相同,它在在线凸优化中通常被称为Follow-The-Leader,最小化累积损失. 对于任何t: 我们谈到了 ...

- 在线学习和在线凸优化(online learning and online convex optimization)—基础介绍1

开启一个在线学习和在线凸优化框架专题学习: 1.首先介绍在线学习的相关概念 在线学习是在一系列连续的回合(rounds)中进行的: 在回合,学习机(learner)被给一个question:(一个向量 ...

- 在线学习和在线凸优化(online learning and online convex optimization)—在线凸优化框架3

近年来,许多有效的在线学习算法的设计受到凸优化工具的影响. 此外,据观察,大多数先前提出的有效算法可以基于以下优雅模型联合分析: 凸集的定义: 一个向量 的Regret定义为: 如前所述,算法相对于竞 ...

- 在线学习和在线凸优化(online learning and online convex optimization)—在线分类问题2

紧接上文,我们讲述在线分类问题 令,为0-1损失,我们做出如下的简化假设: 学习者的目标是相对于hypotheses set: H具有low regret,其中H中的每个函数是从到{0,1}的映射,并 ...

- CMU Convex Optimization(凸优化)笔记1--凸集和凸函数

CMU凸优化笔记--凸集和凸函数 结束了一段时间的学习任务,于是打算做个总结.主要内容都是基于CMU的Ryan Tibshirani开设的Convex Optimization课程做的笔记.这里只摘了 ...

- Convex optimization 凸优化

zh.wikipedia.org/wiki/凸優化 以下问题都是凸优化问题,或可以通过改变变量而转化为凸优化问题:[5] 最小二乘 线性规划 线性约束的二次规划 半正定规划 Convex functi ...

- 在线学习和在线凸优化(online learning and online convex optimization)—FTRL算法6

- 在线学习--online learning

在线学习 online learning Online learning并不是一种模型,而是模型的训练方法.能够根据线上反馈数据,实时快速的进行模型调优,使得模型能够及时反映线上的变化,提高线上预测的 ...

- 各大公司广泛使用的在线学习算法FTRL详解

各大公司广泛使用的在线学习算法FTRL详解 现在做在线学习和CTR常常会用到逻辑回归( Logistic Regression),而传统的批量(batch)算法无法有效地处理超大规模的数据集和在线数据 ...

随机推荐

- 开机或者安装系统时提示tsc: Fast TSC calibration failed解决方法

其实这个问题很简单,主要是时间不对的问题. 就拿我遇到这个问题来说.我是在vm虚拟机中安装了xenserver,然后在物理机安装xencenter连接xenserver,然后在安装新的虚拟机时遇到这个 ...

- Cassandra基础3

cassandra读性能优化:1.禁用read repair每次读操作,无论读请求设置读一个节点还是多个节点,cassandra返回给客户端最新的数据后,都会后台对比所有副本的数据并对差异数据进行修复 ...

- Python_TCP/IP简介

本篇将开始介绍Python的网络编程,更多内容请参考:Python学习指南 自从互联网诞生以来,现在基本上所有的程序都是网络程序,很少有单机版的程序了. 计算机网络就是把各个计算机连接在一起,让网络中 ...

- js获取上传图片大小,判断上传图片类型,获取图片真实宽度和高度

html部分 <div class="form-group col-md-12"> <label class="col-md-2 text-right& ...

- php调用c#的dll(转)

这几天,一直在做DES ecb模式的加解密,刚用.net实现了加解密,完了由于需要又要转型成PHP代码,费了九牛二虎之力单独用PHP没能实现,结构看到一篇php直接调用c#里生成的.dll文件的方法, ...

- tornado请求头/状态码/接口 笔记

set_header()/set_default_headers() set_header():设置请求头数据 set_default_headers():设置默认请求头数据 import torna ...

- mysql 主从复制--启动操作start slave, stop slave

在MySQL配置主从关系时,会用到start slave, stop slave命令,本文简单介绍两个命令的使用方法和作用. start slave mysql> start slave 不带任 ...

- Java利用hanlp完成语句相似度分析的案例详解

分享一篇hanlp分词工具使用的小案例,即利用hanlp分词工具分析两个中文语句的相似度的案例.供大家一起学习参考! 在做考试系统需求时,后台题库系统提供录入题目的功能.在录入题目的时候,由于题目来源 ...

- Oracle和SQL语句的优化策略(基础篇)

转载自: http://blog.csdn.net/houpengfei111/article/details/9245337 http://blog.csdn.net/uniqed/article/ ...

- 转:使用 Go-Ethereum 1.7.2搭建以太坊私有链

使用 Go-Ethereum 1.7.2搭建以太坊私有链 目录 [toc] 1.什么是Ethereum(以太坊) 以太坊(Ethereum)并不是一个机构,而是一款能够在区块链上实现智能合约.开源的底 ...