Java爬虫学习(3)之用对象保存新浪微博博文

package com.mieba; import us.codecraft.webmagic.Page;

import us.codecraft.webmagic.Site;

import us.codecraft.webmagic.processor.PageProcessor; public class SinaPageProcessor implements PageProcessor

{

public static final String URL_LIST = "http://blog\\.sina\\.com\\.cn/s/articlelist_1487828712_0_\\d+\\.html"; public static final String URL_POST = "http://blog\\.sina\\.com\\.cn/s/blog_\\w+\\.html"; private Site site = Site.me().setTimeOut(10000).setRetryTimes(3).setSleepTime(1000).setCharset("UTF-8").setUserAgent( "Mozilla/5.0 (Macintosh; Intel Mac OS X 10_7_2) AppleWebKit/537.31 (KHTML, like Gecko) Chrome/26.0.1410.65 Safari/537.31");; @Override

public Site getSite()

{

// TODO Auto-generated method stub

return site;

} @Override

public void process(Page page)

{

// TODO Auto-generated method stub

// 列表页 if (page.getUrl().regex(URL_LIST).match())

{

// 从页面发现后续的url地址来抓取

page.addTargetRequests(page.getHtml().xpath("//div[@class=\"articleList\"]").links().regex(URL_POST).all()); page.addTargetRequests(page.getHtml().links().regex(URL_LIST).all()); // 文章页 } else

{

String title = new String();

String content = new String();

Article ar = new Article(title, content);

// 定义如何抽取页面信息,并保存下来

ar.setTitle(page.getHtml().xpath("//div[@class='articalTitle']/h2/text()").toString()); ar.setContent(

page.getHtml().xpath("//div[@id='articlebody']//div[@class='articalContent']/text()").toString());

System.out.println("title:"+ar.getTitle());

System.out.println(ar.getContent());

page.putField("repo", ar);

// page.putField("date", page.getHtml().xpath("//div[@id='articlebody']//span[@class='time SG_txtc']/text()").regex("\\((.*)\\)")); }

} }

package com.mieba; import java.io.FileNotFoundException;

import java.io.FileWriter;

import java.io.IOException;

import java.io.PrintWriter;

import java.util.Vector; import us.codecraft.webmagic.ResultItems;

import us.codecraft.webmagic.Task;

import us.codecraft.webmagic.pipeline.Pipeline; public class SinaPipeline implements Pipeline

{ @Override

public void process(ResultItems resultItems, Task arg1)

{

// TODO Auto-generated method stub

Article vo = resultItems.get("repo");

PrintWriter pw = null;

try

{

pw = new PrintWriter(new FileWriter("sina.txt", true)); pw.println(vo);

pw.flush(); }catch(FileNotFoundException e) {

e.printStackTrace();

}catch (IOException e)

{

e.printStackTrace();

} finally

{

pw.close();

}

} }

package com.mieba; public class Article

{

private String title;

private String content;

public String getTitle()

{

return title;

}

public void setTitle(String title)

{

this.title = title;

}

public String getContent()

{

return content;

}

public void setContent(String content)

{

this.content = content;

}

public Article(String title, String content)

{

super();

this.title = title;

this.content = content;

}

@Override

public String toString()

{

return "Article [title=" + title + ", content=" + content + "]";

} }

package com.mieba; import us.codecraft.webmagic.Spider; public class Demo

{ public static void main(String[] args)

{ // 爬取开始

Spider

// 爬取过程

.create(new SinaPageProcessor())

// 爬取结果保存

.addPipeline(new SinaPipeline())

// 爬取的第一个页面

.addUrl("http://blog.sina.com.cn/s/articlelist_1487828712_0_1.html")

// 启用的线程数

.thread(5).run();

}

}

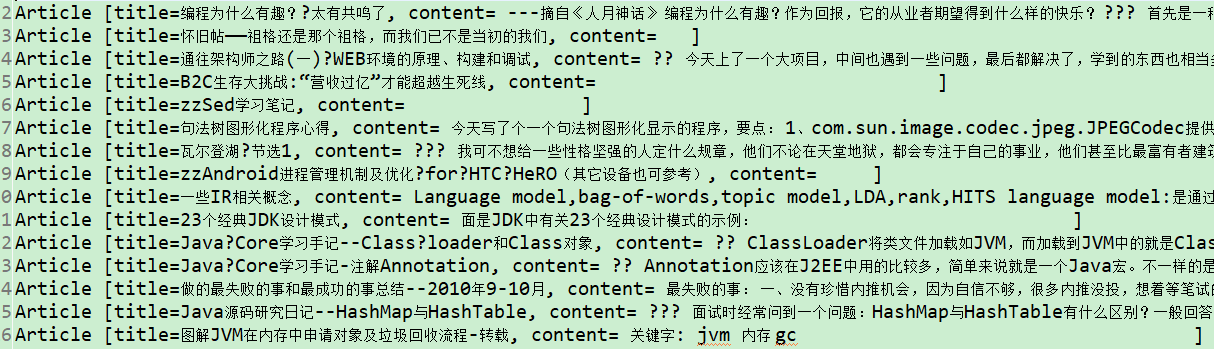

运行结果

爬取到的数据

总结:

关于简单的页面基本可以实现爬取,并且用对象进行存储数据,并最终保存为txt文档。

目前存在的问题,在于一些前端渲染的页面,还找不到url链接去完成相应的爬取,还需要进一步学习模拟登录页面,以获得隐藏的url等数据。

Java爬虫学习(3)之用对象保存新浪微博博文的更多相关文章

- Java爬虫一键爬取结果并保存为Excel

Java爬虫一键爬取结果并保存为Excel 将爬取结果保存为一个Excel表格 官方没有给出导出Excel 的教程 这里我就发一个导出为Excel的教程 导包 因为个人爱好 我喜欢用Gradle所以这 ...

- Java 爬虫学习

Java爬虫领域最强大的框架是JSoup:可直接解析具体的URL地址(即解析对应的HTML),提供了一套强大的API,包括可以通过DOM.CSS选择器,即类似jQuery方式来取出和操作数据.主要功能 ...

- 半途而废的Java爬虫学习经历

最近在面试,发现Java爬虫对于小数据量数据的爬取的应用还是比较广,抽空周末学习一手,留下学习笔记 Java网络爬虫 简单介绍 爬虫我相信大家都应该知道什么,有什么用,主要的用途就是通过程序自动的去获 ...

- 《java JDK7 学习笔记》之对象封装

1.构造函数实现对象初始化流程的封装.方法封装了操作对象的流程.java中还可以使用private封装对象私有数据成员.封装的目的主要就是隐藏对象细节,将对象当做黑箱子进行操作. 2.在java命名规 ...

- Java反射学习-5 - 反射复制对象

通过反射方式复制对象: package cn.tx.reflect; import java.lang.reflect.Constructor; import java.lang.reflect.Fi ...

- Java爬虫学习(2)之用对象保存文件demo(1)

package com.mieba.spider; import java.util.ArrayList; import java.util.List; import java.util.Vector ...

- java web学习总结(十) -------------------HttpServletRequest对象

一.HttpServletRequest介绍 HttpServletRequest对象代表客户端的请求,当客户端通过HTTP协议访问服务器时,HTTP请求头中的所有信息都封装在这个对象中,通过这个对象 ...

- java web学习总结(七) -------------------HttpServletResponse对象(一)

Web服务器收到客户端的http请求,会针对每一次请求,分别创建一个用于代表请求的request对象.和代表响应的response对象.request和response对象即然代表请求和响应,那我们要 ...

- java web 学习十(HttpServletRequest对象1)

一.HttpServletRequest介绍 HttpServletRequest对象代表客户端的请求,当客户端通过HTTP协议访问服务器时,HTTP请求头中的所有信息都封装在这个对象中,通过这个对象 ...

随机推荐

- Android_AsyncTask异步类

·AsyncTask是一个轻量级的异步抽象类 ·Android程序刚启动时,会同时启动一个像一个的主线程,这个主线程主要负责处理与UI有关的事件,有时也被称为UI线程,Android app中必须遵循 ...

- CTS、CLS、CLR

CTS.CLS和CLR是.NET框架的3个核心部分,下面分别对它们进行介绍. 1)CTS Common Type System CTS即通用类型系统,它定义了如何在.NET Framework运行库 ...

- [CF1303B] National Project - 数学

Solution \(2a>n\),一次性结束,直接输出 \(n\) \(a \geq b\),那么一直修即可,直接输出 \(n\) 否则,\(a\) 占弱势,我们考虑用 \(a\) 修一半需要 ...

- 关于SkinTextBox中SkinTxt的事件使用

SkinTxt的事件中的事件不能像一般的事件那样在属性中直接双击生成,它里面的事件都需要进行一定的转换间接使用,具体用法如下: 1.手动编写事件需要做的操作的方法 public void txtCod ...

- matlab HW求法笔记

for i=1:9400 Sbox_out_11(i) = length(findstr(num2str(dec2bin(Sbox_out_1(i,:))),'1')); end

- 字符串积累ing

明天就要上网课拉拉啦啦! 数据库先在手机端登录然后转战客户端试之! 操作系统在客户端登录试一试! 马原用学习通试试啦! 首先,介绍一下strlen,strcpy,strcmp函数! 参考:https: ...

- 华为高斯 GaussDB 100 OLTP 单机在 RHEL 7.6 上的安装

目录 你需要知道的 操作系统安装 GaussDB 100 安装 环境设置 创建用户组/用户/文件夹 软件上传/解压/安装 启动数据库 DataStudio 连接 服务器环境设置 DataStudio ...

- 设置Eclipse中的字符集为UTF-8

Eclipse 修改字符集 默认情况下 Eclipse 字符集为 GBK,但现在很多项目采用的是 UTF-8,这是我们就需要设置我们的 Eclipse 开发环境字符集为 UTF-8, 设置步骤如下: ...

- Linux下tomcat端口被占用

首先查看占用端口的程序 netstat -alnp | grep 8080 然后出现 tcp6 2 0 :::8080 :: LISTEN 1392/java 杀死端口号 kill -9 1392(进 ...

- Git学习笔记-上传一个新的项目到GitHub上

前提: 已有Github账号,已在Github上建立了仓库,已在Github上配置了SSH,已上传过一些项目到Github上 目标: 目前有一个新的项目,需要上传到github上 我的做法记录: 1. ...