Spark之UDF

package big.data.analyse.udfudaf

import org.apache.spark.sql.types.{IntegerType, StringType, StructField, StructType}

import org.apache.spark.sql.{Row, SparkSession}

/**

* Created by zhen on 2018/11/25.

*/

object SparkUdfUdaf {

def isAdult(age : Int) ={

if(age > 18){

true

}else{

false

}

}

def main(args: Array[String]) {

val spark = SparkSession

.builder()

.appName("UdfUdaf")

.master("local[2]")

.getOrCreate()

val userData = Array(

"2015,11,www.baidu.com",

"2016,14,www.google.com",

"2017,13,www.apache.com",

"2015,21,www.spark.com",

"2016,32,www.hadoop.com",

"2017,18,www.solr.com",

"2017,14,www.hive.com"

)

val sc = spark.sparkContext

val sqlContext = spark.sqlContext

val userDataRDD = sc.parallelize(userData) // 转化为RDD

val userDataType = userDataRDD.map(line => {

val Array(age, id, url) = line.split(",")

Row(

age, id.toInt, url

)

})

val structTypes = StructType(Array(

StructField("age", StringType, true),

StructField("id", IntegerType, true),

StructField("url", StringType, true)

))

// RDD转化为DataFrame

val userDataFrame = sqlContext.createDataFrame(userDataType,structTypes)

// 注冊临时表

userDataFrame.createOrReplaceTempView("udf")

// 注册udf(方式一)

spark.udf.register("getLength", (str : String) => str.length)

// 注册udf(方式二)

spark.udf.register("isAdult", isAdult _)

//执行sql

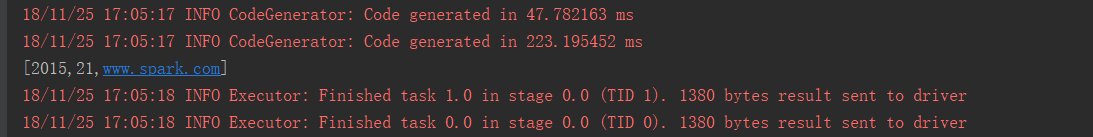

val sql = "select * from udf where getLength(udf.url)=13 and isAdult(udf.id)"

val result = sqlContext.sql(sql)

result.foreach(println(_))

}

}

结果:

Spark之UDF的更多相关文章

- Kafka:ZK+Kafka+Spark Streaming集群环境搭建(十五)Spark编写UDF、UDAF、Agg函数

Spark Sql提供了丰富的内置函数让开发者来使用,但实际开发业务场景可能很复杂,内置函数不能够满足业务需求,因此spark sql提供了可扩展的内置函数. UDF:是普通函数,输入一个或多个参数, ...

- 转】 Spark SQL UDF使用

原博文出自于: http://blog.csdn.net/oopsoom/article/details/39401391 感谢! Spark1.1推出了Uer Define Function功能,用 ...

- spark编写UDF和UDAF

UDF: 一.编写udf类,在其中定义udf函数 package spark._sql.UDF import org.apache.spark.sql.functions._ /** * AUTHOR ...

- Spark SQL UDF示例

UDF即用户自定函数,注册之后,在sql语句中使用. 基于scala-sdk-2.10.7,Spark2.0.0. package UDF_UDAF import java.util import o ...

- spark使用udf给dataFrame新增列

在 spark 中给 dataframe 增加一列的方法一般使用 withColumn // 新建一个dataFrame val sparkconf = new SparkConf() .setMas ...

- Spark注册UDF函数,用于DataFrame DSL or SQL

import org.apache.spark.sql.SparkSession import org.apache.spark.sql.functions._ object Test2 { def ...

- Pyspark 使用 Spark Udf 的一些经验

起初开始写一些 udf 的时候感觉有一些奇怪,在 spark 的计算中,一般通过转换(Transformation) 在不触发计算(Action) 的情况下就行一些预处理.udf 就是这样一个好用的东 ...

- Spark笔记之使用UDF(User Define Function)

一.UDF介绍 UDF(User Define Function),即用户自定义函数,Spark的官方文档中没有对UDF做过多介绍,猜想可能是认为比较简单吧. 几乎所有sql数据库的实现都为用户提供了 ...

- 王家林 大数据Spark超经典视频链接全集[转]

压缩过的大数据Spark蘑菇云行动前置课程视频百度云分享链接 链接:http://pan.baidu.com/s/1cFqjQu SCALA专辑 Scala深入浅出经典视频 链接:http://pan ...

随机推荐

- Vagrant Ansible Playbook 安装一群虚拟机

https://docs.ansible.com/ https://favoorr.github.io/2017/01/06/vagrant-virtualbox-vagrantfile-config ...

- intellij idea maven project 无法显示dependencies

Intellj 自动载入Mave依赖是一个很人性化的功能,但不排除有时候会碰到问题,导致pom文件修改却没有触发自动重新载入的动作或者加载中途出现弱网的情况中断载入的,此时需要手动强制更新依赖. 如下 ...

- 不得不提的volatile及指令重排序(happen-before)

微信公众号[程序员江湖] 作者黄小斜,斜杠青年,某985硕士,阿里 Java 研发工程师,于 2018 年秋招拿到 BAT 头条.网易.滴滴等 8 个大厂 offer,目前致力于分享这几年的学习经验. ...

- centos 7 linux系统默认ftp安装配置和部署(详细讲解)

小生接触 Linux 系统时间不长,想解决linux系统ftp安装及部署问题,折腾了大半天,终于弄出来了,将各路高手的配置方法综合了一下,如有不对之处,欢迎各位看客指正,感谢! 一.声明: 本文采用操 ...

- HBase 架构脑图

https://docs.transwarp.io/5.0/goto?file=HyperbaseManual_intro-hbase.html#intro-hbase

- netty源码解解析(4.0)-14 Channel NIO实现:读取数据

本章分析Nio Channel的数据读取功能的实现. Channel读取数据需要Channel和ChannelHandler配合使用,netty设计数据读取功能包括三个要素:Channel, Eve ...

- Go语言学习笔记(六) [包]

日期:2014年7月30日 1.定义:包时函数和数据的集合.使用package关键字定义一个包,文件名不需要与包名一致,包名约定使用小写字符,Go包可以由多个文件组成,但是需要使用相同的packa ...

- 绝对路径的表示方式为什么是"/usr"而不是"//usr"

今天闲逛贴吧,竟然看到有个人问绝对路径的表示方式为什么不是//usr/local而是/usr/local.原文: 我想99%的人都没想过这个问题,都理所当然的认为:它不就是根"/" ...

- 关于 Cortex-M3 的双堆栈机制

CM3 的堆栈分为两个:主堆栈和进程堆栈. 那么,这两个栈分别在什么情况下使用呢? 我们看一下CM3的控制寄存器(CONTROL):控制寄存器用于定义特权级别,还用于选择当前使用哪个堆栈指针. CON ...

- Javascript Cookie小插件

var ManagerCookie = function(){ //添加cookie function addCookie(key,value,time,path){ key = encodeURI( ...