马士兵hadoop第二课:hdfs集群集中管理和hadoop文件操作(转)

马士兵hadoop第一课:虚拟机搭建和安装hadoop及启动

马士兵hadoop第二课:hdfs集群集中管理和hadoop文件操作

马士兵hadoop第四课:Yarn和Map/Reduce配置启动和原理讲解

(1)观察集群配置情况

[root@master ~]# hdfs dfsadmin -report

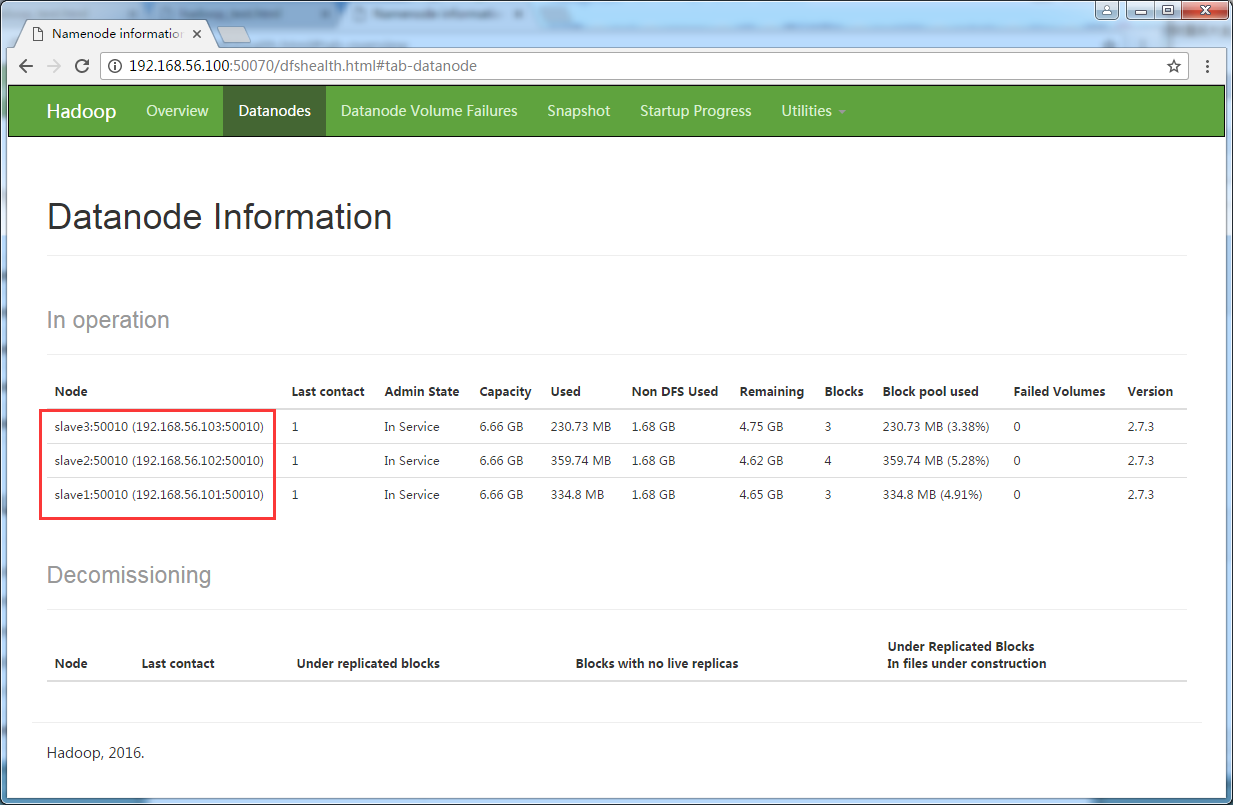

(2)web界面观察集群运行情况

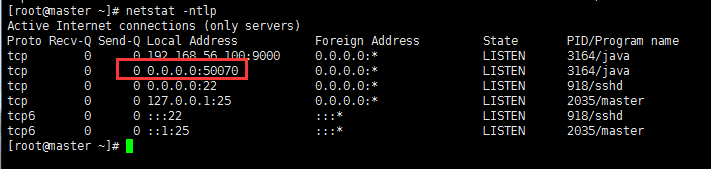

使用netstat命令查看端口监听

[root@master ~]# netstat -ntlp

浏览器地址栏输入:http://192.168.56.100:50070

(3)对集群进行集中管理

a) 修改master上的/usr/local/hadoop/etc/hadoop/slaves文件

[root@master hadoop]# vim slaves

#编辑内容如下

slave1

slave2

slave3

先使用hadoop-daemon.sh stop namenode(datanode)手工关闭集群。

b) 使用start-dfs.sh启动集群

[root@master hadoop]# start-dfs.sh

发现需要输入每个节点的密码,太过于繁琐,于是需要配置免密ssh远程登陆。

在master上用ssh连接一台slave,需要输入密码slave的密码,

[root@master hadoop]# ssh slave1

需要输入密码,输入密码登陆成功后,使用exit指令退回到master。

c) 免密ssh远程登陆

生成rsa算法的公钥和私钥

[root@master hadoop]# ssh-keygen -t rsa (然后四个回车)

进入到/root/.ssh文件夹,可看到生成了id_rsa和id_rsa.pub两个文件。

使用以下指令完成免密ssh登陆

[root@master hadoop]# ssh-copy-id slaveX

更多细节讲解,请查看马士兵hadoop第二课视频讲解:http://pan.baidu.com/s/1qYNNrxa

使用stop-dfs.sh停止集群,然后使用start-dfs.sh启动集群。

[root@master ~]# stop-dfs.sh

[root@master ~]# stop-dfs.sh

(3)修改windows上的hosts文件,通过名字来访问集群web界面

编辑C:\Windows\System32\drivers\etc\hosts

192.168.56.100 master

然后就可以使用http://master:50070代替http://192.168.56.100:50070

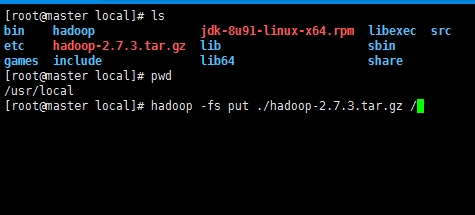

(4) 使用hdfs dfs 或者 hadoop fs命令对文件进行增删改查的操作

1 hadoop fs -ls /

2 hadoop fs -put file /

3 hadoop fs -mkdir /dirname

4 hadoop fs -text /filename

5 hadoop fs -rm /filename

将hadoop的安装文件put到了hadoop上操作如下

[root@master local]# hadoop -fs put ./hadoop-2.7.3.tar.gz /

通过网页观察文件情况

(5)将dfs-site.xml的replication值设为2

replication参数是分块拷贝份数,hadoop默认为3。

也就是说,一块数据会至少在3台slave上都存在,假如slave节点超过3台了。

vim hdfs-site.xml

1 <?xml version="1.0" encoding="UTF-8"?>

2 <?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

3 <configuration>

4 <property>

5 <name>dfs.replication</name>

6 <value>2</value>

7 </property>

8 <property>

9 <name>dfs.namenode.heartbeat.recheck-interval</name>

10 <value>10000</value>

11 </property>

12 </configuration>

为了方便测试,同时需要修改另外一个参数dfs.namenode.heartbeat.recheck-interval,这个值默认为300s,

将其修改成10000,单位是ms,这个参数是定期间隔时间后检查slave的运行情况并更新slave的状态。

可以通过 hadoop-2.7.3\share\doc\hadoop\index.html里面查找这些默认的属性

修改完hdf-size.xml文件后,重启hadoop集群,

stop-dfs.sh #停止hadoop集群

start-dfs.sh #启动hadoop集权

hadoop -fs put ./jdk-8u91-linux-x64.rpm / #将jdk安装包上传到hadoop的根目录

到web页面上去观察jdk安装包文件分块在slave1,slave2,slave3的存储情况

hadoop-daemon.sh stop datanode #在slave3上停掉datanode

等一会时间后(大概10s,前面修改了扫描slave运行情况的间隔时间为10s),刷新web页面

观察到slave3节点挂掉

hadoop-daemon.sh start datanode #在slave3上启动datanode

然后再去观察jdk安装包文件分块在slave1,slave2,slave3的存储情况

原文地址:http://www.cnblogs.com/yucongblog/p/6650834.html

马士兵hadoop第二课:hdfs集群集中管理和hadoop文件操作(转)的更多相关文章

- 马士兵hadoop第二课:hdfs集群集中管理和hadoop文件操作

马士兵hadoop第一课:虚拟机搭建和安装hadoop及启动 马士兵hadoop第二课:hdfs集群集中管理和hadoop文件操作 马士兵hadoop第三课:java开发hdfs 马士兵hadoop第 ...

- Hadoop(八)Java程序访问HDFS集群中数据块与查看文件系统

前言 我们知道HDFS集群中,所有的文件都是存放在DN的数据块中的.那我们该怎么去查看数据块的相关属性的呢?这就是我今天分享的内容了 一.HDFS中数据块概述 1.1.HDFS集群中数据块存放位置 我 ...

- Hadoop(四)HDFS集群详解

前言 前面几篇简单介绍了什么是大数据和Hadoop,也说了怎么搭建最简单的伪分布式和全分布式的hadoop集群.接下来这篇我详细的分享一下HDFS. HDFS前言: 设计思想:(分而治之)将大文件.大 ...

- Hadoop(五)搭建Hadoop与Java访问HDFS集群

前言 上一篇详细介绍了HDFS集群,还有操作HDFS集群的一些命令,常用的命令: hdfs dfs -ls xxx hdfs dfs -mkdir -p /xxx/xxx hdfs dfs -cat ...

- Hadoop(五)搭建Hadoop客户端与Java访问HDFS集群

阅读目录(Content) 一.Hadoop客户端配置 二.Java访问HDFS集群 2.1.HDFS的Java访问接口 2.2.Java访问HDFS主要编程步骤 2.3.使用FileSystem A ...

- Hadoop集群-HDFS集群中大数据运维常用的命令总结

Hadoop集群-HDFS集群中大数据运维常用的命令总结 作者:尹正杰 版权声明:原创作品,谢绝转载!否则将追究法律责任. 本篇博客会简单涉及到滚动编辑,融合镜像文件,目录的空间配额等运维操作简介.话 ...

- Hadoop学习笔记1 - 使用Java API访问远程hdfs集群

转载请标注原链接 http://www.cnblogs.com/xczyd/p/8570437.html 2018年3月从新司重新起航了.之前在某司过了的蛋疼三个月,也算给自己放了个小假了. 第一个小 ...

- Hadoop基础-HDFS集群中大数据开发常用的命令总结

Hadoop基础-HDFS集群中大数据开发常用的命令总结 作者:尹正杰 版权声明:原创作品,谢绝转载!否则将追究法律责任. 本盘博客仅仅列出了我们在实际生成环境中常用的hdfs命令,如果想要了解更多, ...

- hbase+hadoop+hdfs集群搭建 集成spring

序言 最近公司一个汽车项目想用hbase做存储,然后就有了这篇文字,来,来,来, 带你一起征服hbase,并推荐一本书<hbase权威指南> 这是一本极好的hbase入门书籍,我花了一个晚 ...

随机推荐

- String java

https://www.golinuxcloud.com/java-interview-questions-answers-experienced-2/ 75. What is the meaning ...

- 访问URI地址

//发送消息到服务器 public string HttpConnectToServer(string ServerPage) { byte[] dataArray = Encoding.Defaul ...

- localStorage对象

localStorage对象存储的数据没有时间限制,比如:它可以存储到第二天,第三周,半年,或二三年,只要您的电脑没有重新安装系统或更换硬盘,数据仍然会被保留着. 实例: <!DOCTYPE h ...

- IDEA项目显示树形结构

- Java面向对象基础 ——面试题

1面向对象基础 JAVA基础语法自行掌握. 三大特性: 一 封装:★★★★★ 概念:是指隐藏对象的属性和实现细节,仅对外提供公共访问方式. 好处:将变化隔离:便于使用:提高重用性:安全性. 封装原则: ...

- c++ 创建路径方法

linux.unix平台 #include "stdio.h" #include "stdlib.h" #include <sys/types.h> ...

- sphinx 快速使用

建立配置文件 例可以参照之前的模板新建一个配置文件 sphinx/etc目录 #MySQL数据源配置,详情请查看:http://www.coreseek.cn/products-install/mys ...

- Linux菜鸟起飞之路【十】进程管理

一.基本概念 进程:程序的一次动态执行 守护进程:在后台运行并提供系统服务的进程 僵尸进程:完成了生命周期但却依然留在进程表中的进程,我们称之为 “僵尸进程” 父进程:指已创建一个或多个子进程的进程. ...

- 实验二 JSP基本动态元素的使用

实验二 JSP基本动态元素的使用 实验性质:验证性 实验学时: 2学时 实验地点: 一 .实验目的与要求 1.掌握JSP中声明变量.定义方法.java程序片及表达式的使 ...

- zoj 4049

Halting Problem Time Limit: 1 Second Memory Limit: 65536 KB In computability theory, the haltin ...