scrapy 基础组件专题(四):信号运用

一、scrapy信号使用的简单实例

import scrapy

from scrapy import signals

from ccidcom.items import CcidcomItem class CcidcomSpider(scrapy.Spider):

name = 'ccidcomSpider'

start_urls = ['http://www.ccidcom.com/yaowen/index.html']

item_count = 0 @classmethod

def from_crawler(cls, crawler, *args, **kwargs):

spider = super(CcidcomSpider,

cls).from_crawler(crawler, *args, **kwargs)

crawler.signals.connect(spider.item_scraped,

signal=signals.item_scraped)

crawler.signals.connect(spider.spider_closed, signal=signals.spider_closed)

return spider def parse(self, response):

lists = response.css('div.article-item div.title a::attr("href")')

for info in lists:

item = CcidcomItem()

item['url'] = info.get()

yield item def item_scraped(self, item, response, spider):

if item:

self.item_count += 1

self.logger.info('--------item_scraped') def spider_closed(self, spider, reason):

spider.logger.info('一共抓取到了{}个item'.format(self.item_count))

运行爬虫scrapy crawl ccidcomSpider

2019-11-20 13:14:11 [ccidcomSpider] INFO: --------item_scraped

2019-11-20 13:14:11 [ccidcomSpider] INFO: --------item_scraped

2019-11-20 13:14:11 [ccidcomSpider] INFO: --------item_scraped

2019-11-20 13:14:11 [ccidcomSpider] INFO: --------item_scraped

2019-11-20 13:14:11 [ccidcomSpider] INFO: --------item_scraped

2019-11-20 13:14:11 [ccidcomSpider] INFO: --------item_scraped

2019-11-20 13:14:11 [ccidcomSpider] INFO: --------item_scraped

2019-11-20 13:14:11 [ccidcomSpider] INFO: --------item_scraped

2019-11-20 13:14:11 [ccidcomSpider] INFO: --------item_scraped

2019-11-20 13:14:11 [ccidcomSpider] INFO: --------item_scraped

2019-11-20 13:14:11 [scrapy.core.engine] INFO: Closing spider (finished)

2019-11-20 13:14:11 [ccidcomSpider] INFO: 一共抓取到了10个item

from_crawler是在爬虫被初始化时执行的入口方法 spider = super(CcidcomSpider, cls).from_crawler(crawler, *args, **kwargs) 是调用父类的方法, 获取到实例化的爬虫 crawler.signals.connect(spider.item_scraped, signal=signals.item_scraped)是将爬虫的spider.item_scraped方法注入到signals.item_scraped信号的位置上 当我们yield返回一个item时, 就会调用我们自己写的item_scraped方法, 将item的数量+1

我们也注册了一个spider_closed的信号, 在爬虫结束以后, 输出我们一共抓取到了多少个item

这就是scrapy信号的简单的例子, 而且这个例子可以写在很多地方(扩展、中间件、pipeline...)

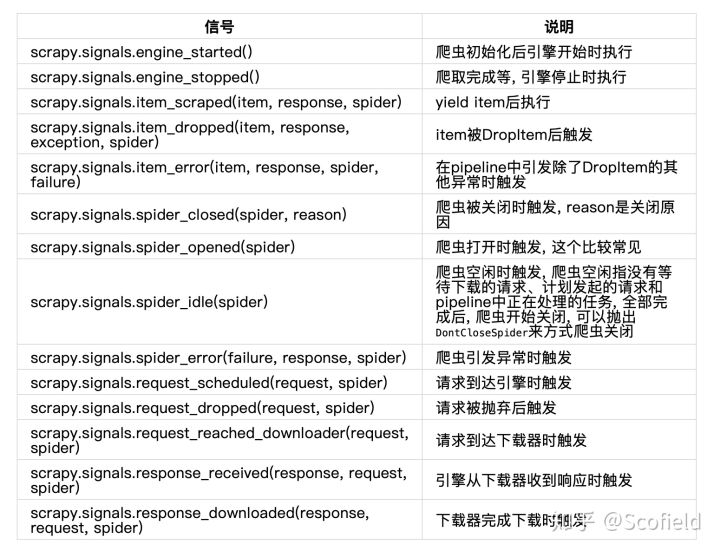

二、scrapy内置的信号

以上就是scrapy所有内置的信号列表, 这些信号的最大功能就是用来做统计, 或者别的一些处理

1. 统计被Drop的item

2. 统计被Drop的请求

3. 监控爬虫的空闲状态(实现调试爬虫)

4. 统计pipeline或爬虫中的异常发生情况

scrapy 基础组件专题(四):信号运用的更多相关文章

- scrapy 基础组件专题(八):scrapy-redis 框架分析

scrapy-redis简介 scrapy-redis是scrapy框架基于redis数据库的组件,用于scrapy项目的分布式开发和部署. 有如下特征: 分布式爬取 您可以启动多个spider工 ...

- scrapy 基础组件专题(十四):scrapy CookiesMiddleware源码

一 Scrapy框架--cookie的获取/传递/本地保存 1. 完成模拟登陆2. 登陆成功后提取出cookie,然后保存到本地cookie.txt文件中3. 再次使用时从本地的cookie.txt中 ...

- scrapy 基础组件专题(二):下载中间件

下载器中间件是介于Scrapy的request/response处理的钩子框架,是用于全局修改Scrapy request和response的一个轻量.底层的系统. 1.激活Downloader Mi ...

- scrapy 基础组件专题(一):scrapy框架中各组件的工作流程

Scrapy 使用了 Twisted 异步非阻塞网络库来处理网络通讯,整体架构大致如下(绿线是数据流向): Scrapy主要包括了以下组件: 引擎(Scrapy)用来处理整个系统的数据流处理, 触发事 ...

- scrapy 基础组件专题(九):scrapy-redis 源码分析

下面我们来看看,scrapy-redis的每一个源代码文件都实现了什么功能,最后如何实现分布式的爬虫系统: connection.py 连接得配置文件 defaults.py 默认得配置文件 dupe ...

- scrapy 基础组件专题(五):自定义扩展

通过scrapy提供的扩展功能, 我们可以编写一些自定义的功能, 插入到scrapy的机制中 一.编写一个简单的扩展 我们现在编写一个扩展, 统计一共获取到的item的条数我们可以新建一个extens ...

- scrapy 基础组件专题(十二):scrapy 模拟登录

1. scrapy有三种方法模拟登陆 1.1直接携带cookies 1.2找url地址,发送post请求存储cookie 1.3找到对应的form表单,自动解析input标签,自动解析post请求的u ...

- scrapy 基础组件专题(七):scrapy 调度器、调度器中间件、自定义调度器

一.调度器 配置 SCHEDULER = 'scrapy.core.scheduler.Scheduler' #表示scrapy包下core文件夹scheduler文件Scheduler类# 可以通过 ...

- scrapy 基础组件专题(六):自定义命令

写好自己的爬虫项目之后,可以自己定制爬虫运行的命令. 一.单爬虫 在项目的根目录下新建一个py文件,如命名为start.py,写入如下代码: from scrapy.cmdline import ex ...

随机推荐

- Jmeter使用beanshell对数据进行加密传输

首先,来看一下接口签名加密规则 1.需要参于签名的参数: a. 在请求参数列表中,除去 cliSign 参数外,其他需要使用到的参数皆是要签名的参数. 2.生成签名字符串 a. 没有值的参数无需传递, ...

- [noi.ac省选模拟赛]第10场题解集合

题目 比赛界面. T1 不难想到,对于一个与\(k\)根棍子连接的轨道,我们可以将它拆分成\(k+1\)个点,表示这条轨道不同的\(k+1\)段. 那么,棍子就成为了点与点之间的边.可以发现,按照棍子 ...

- Docker学习 ,超全文档!

我们的口号是:再小的帆也能远航,人生不设限!! 一.学习规划: Docker概述 Docker安装 Docker命令 Docker镜像 镜像命令 容器命令 操作命令 容器数据卷 Doc ...

- Elasticsearch去重查询/过滤重复数据(聚合)

带家好,我是马儿,这次来讲一下最近遇到的一个问题 我司某个环境的es中被导入了重复数据,导致查询的时候会出现一些重复数据,所以要我们几个开发想一些解决方案,我们聊了聊,相出了下面一些方案: 1.从源头 ...

- Linux下,如何监控某个进程到底向哪个地址发起了网络调用

Linux下,如何监控某个进程到底向哪个地址发起了网络调用 有时候,有些应用,比如idea,你发起某个操作时,其底层会去请求网络,获取一些数据. 但是不知道,请求了什么地址.举个例子,在idea中,m ...

- 消息队列——Kafka基本使用及原理分析

文章目录 一.什么是Kafka 二.Kafka的基本使用 1. 单机环境搭建及命令行的基本使用 2. 集群搭建 3. Java API的基本使用 三.Kafka原理浅析 1. topic和partit ...

- MongoDB——基本使用及集群搭建

文章目录 什么是MongoDb? 基本概念 与关系型数据库的比较 Mongo的高效性 文件存储 基本使用 启动/连接服务 基础操作命令 高可用集群搭建 概念 环境准备 实践 应用场景 总结 什么是Mo ...

- S7-200 PLC内部+5VDC电源的负载能力

S7-200 PLC内部+5VDC电源的负载能力 S7-200 CPU模块提供DC5V和24V电源:当有扩展模块时,CPU通过I/O总线为其提供5V电源,所有扩展模块的SV电源消耗之和不能超过该CPU ...

- Java架构师如何学习?

引言 古人云:"活到老,学到老."互联网算是最辛苦的行业之一,"加班"对工程师来说已是"家常便饭",同时互联网技术又日新月异,很多工程师都疲 ...

- SpringBoot -- 项目结构+启动流程

一.简述: 项目结构 二.简述:启动流程 说springboot的启动流程,当然少不了springboot启动入口类 @SpringBootApplication public class Sprin ...