Mapreduce-实现webcount代码

参考博文:https://blog.csdn.net/qq_41035588/article/details/90514824

首先安装一个Hadoop-Eclipse-Plugin 方便来对于hdfs进行管理

参考地址:http://dblab.xmu.edu.cn/blog/hadoop-build-project-using-eclipse/

配置好Hadoop-Ecllipse-Plugin之后

建立一个txt文档,里面的内容如下:

买家id 商品id 收藏日期

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

-- ::

然后建立一个java项目

然后把所有的包都导进去,重点是mapreduce,common,yarn,hdfs的包

然后再输入代码:

package mapreduce; import java.io.IOException;

import java.util.StringTokenizer;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.mapreduce.Reducer;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat; public class WordCount { public static class doMapper extends Mapper<Object, Text, Text, IntWritable>{

//第一个object表示输入key的类型,第二个text表示输入value的类型;第三个text表示输出建的类型;

//第四个INtWritable表示输出值的类型 public static final IntWritable one = new IntWritable(1);

public static Text word = new Text();

@Override

protected void map(Object key, Text value, Context context)

//key value是输入的key value context是记录输入的key,value

throws IOException, InterruptedException {

StringTokenizer tokenizer = new StringTokenizer(value.toString(), "\t");

//StringTokenizer是Java的工具包中的一个类,用于将字符串进行拆分

word.set(tokenizer.nextToken());

//返回当前位置到下一个分隔符之间的字符串

context.write(word, one);

//讲word存到容器中计一个数

}

}

public static class doReducer extends Reducer<Text, IntWritable, Text, IntWritable>{

//输入键类型,输入值类型 输出建类型,输出值类型

private IntWritable result = new IntWritable();

@Override

protected void reduce(Text key, Iterable<IntWritable> values, Context context)

throws IOException, InterruptedException {

int sum = 0;

for (IntWritable value : values) {

sum += value.get();

}

result.set(sum);

context.write(key, result);

}

}

public static void main(String[] args) throws IOException, ClassNotFoundException, InterruptedException {

Job job = Job.getInstance();

job.setJobName("WordCount");

job.setJarByClass(WordCount.class);

job.setMapperClass(doMapper.class);

job.setReducerClass(doReducer.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

Path in = new Path("hdfs://localhost:9000/mymapreduce1/in/buyer_favorite1");

Path out = new Path("hdfs://localhost:9000/mymapreduce1/out");

FileInputFormat.addInputPath(job, in);

FileOutputFormat.setOutputPath(job, out);

System.exit(job.waitForCompletion(true) ? 0 : 1);

}

}

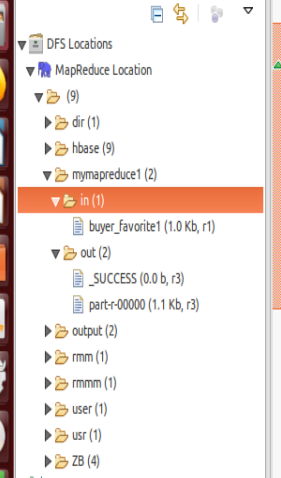

然后运行之后查看左边的菜单:

双击part-r-00000就有返回的值了

最重要的问题就是分隔的问题

- StringTokenizer tokenizer = new StringTokenizer(value.toString(),"\t");

这个是根据tab键来进行分割,但是我们复制粘贴后就是空格所以要换成空格

Mapreduce-实现webcount代码的更多相关文章

- MapReduce框架结构及代码示例

一个完整的 mapreduce 程序在分布式运行时有三类实例进程: 1.MRAppMaster:负责整个程序的过程调度及状态协调 2.MapTask:负责 map 阶段的整个数据处理流程 3.Redu ...

- [大牛翻译系列]Hadoop(15)MapReduce 性能调优:优化MapReduce的用户JAVA代码

6.4.5 优化MapReduce用户JAVA代码 MapReduce执行代码的方式和普通JAVA应用不同.这是由于MapReduce框架为了能够高效地处理海量数据,需要成百万次调用map和reduc ...

- 使用mapreduce计算环比的实例

最近做了一个小的mapreduce程序,主要目的是计算环比值最高的前5名,本来打算使用spark计算,可是本人目前spark还只是简单看了下,因此就先改用mapreduce计算了,今天和大家分享下这个 ...

- MapReduce工作流多种实现方式

学习 hadoop,必不可少的就是编写 MapReduce 程序.当然,对于简单的分析程序,我们只需一个 MapReduce 任务就能搞定,然而对于比较复杂的分析程序,我们可能需要多个Job或者多个M ...

- Hadoop学习笔记—11.MapReduce中的排序和分组

一.写在之前的 1.1 回顾Map阶段四大步骤 首先,我们回顾一下在MapReduce中,排序和分组在哪里被执行: 从上图中可以清楚地看出,在Step1.4也就是第四步中,需要对不同分区中的数据进行排 ...

- [大牛翻译系列]Hadoop(19)MapReduce 文件处理:基于压缩的高效存储(二)

5.2 基于压缩的高效存储(续) (仅包括技术27) 技术27 在MapReduce,Hive和Pig中使用可分块的LZOP 如果一个文本文件即使经过压缩后仍然比HDFS的块的大小要大,就需要考虑选择 ...

- MapReduce链接作业

对于简单的分析程序,我们只需一个MapReduce就能搞定,然而对于比较复杂的分析程序,我们可能需要多个Job或者多个Map或者Reduce进行计算.下面我们来说说多个Job或者多个MapReduce ...

- 十九、Hadoop学记笔记————Hbase和MapReduce

概要: hadoop和hbase导入环境变量: 要运行Hbase中自带的MapReduce程序,需要运行如下指令,可在官网中找到: 如果遇到如下问题,则说明Hadoop的MapReduce没有权限访问 ...

- 从分治算法到 Hadoop MapReduce

从分治算法说起 要说 Hadoop MapReduce 就不得不说分治算法,而分治算法其实说白了,就是四个字 分而治之 .其实就是将一个复杂的问题分解成多组相同或类似的子问题,对这些子问题再分,然后再 ...

随机推荐

- ubuntu装openssh-client和openssh-server

1. 修改update源 进入/etc/apt/目录,首先用cp命令将sources.list备份成sources.list.bk,然后复制http://www.cnblogs.com/eastson ...

- 前端开发 Vue -0前言

Vue2.0 新手完全填坑攻略——从环境搭建到发布 Vue2 入门,读这篇就够了 Jinkey原创感谢 showonne.yubang 技术指导Demo 地址:http://demo.jinkey.i ...

- github 远程仓库名或地址修改,本地如何同步

1. 背景 远程服务器迁移,服务器IP改变:或者远程仓库名变更,导致本地仓库失效.如何在原有仓库的基础上让本地仓库和新的远程仓库建立关联. 例如: 本地git项目目录为:SingTel/ 本地添加的远 ...

- stm32 独立看门狗 IWDG

独立看门狗IWDG 独立看门狗简单理解就是一个12位递减计数器,当计数器从某一个值递减到0时,系统就会产生一次复位 独立看门狗由专用低速时钟LSI驱动,其频率一般在30-60KHz之间,通常选择40K ...

- 操作系统 (OS)

1. 操作系统(Operation System,OS) 操作系统作为接口的示意图 没有安装操作系统的计算机,通常被称为 裸机 如果想在 裸机 上运行自己所编写的程序,就必须用机器语言书写程序 如果计 ...

- Image Processing and Analysis_8_Edge Detection:Statistical edge detection_ learning and evaluating edge cues——2003

此主要讨论图像处理与分析.虽然计算机视觉部分的有些内容比如特 征提取等也可以归结到图像分析中来,但鉴于它们与计算机视觉的紧密联系,以 及它们的出处,没有把它们纳入到图像处理与分析中来.同样,这里面也有 ...

- mongodb索引 复合索引

当我们的查询条件不只有一个时,就需要建立复合索引,比如插入一条{x:1,y:2,z:3}记录,按照我们之前建立的x为1的索引,可是使用x查询,现在想按照x与y的值查询,就需要创建如下的索引 创 ...

- nginx用指针的值的最后一位来判断过期事件

nginx中,将地址的最后一位取出来,用Instace变量标识,用来判断是否连接已经被释放成为过期时间 为什么指针地址最后一位一定是0呢? 这里的内存地址,一定是内存分配器分配出来的地址,如new . ...

- 算法:统计1-n中,1出现的次数

package edu.cqu.algorithmTest; import java.util.Scanner; /* * 给定一个十进制正整数N,写下从1开始,到N的所有整数,然后数一下其中出现的所 ...

- WebLogic 12c 版 下载与安装(ubuntu)

下载地址:https://www.oracle.com/middleware/technologies/fusionmiddleware-downloads.html 参考地址:https://blo ...